Step-Video-T2V:下一代文本到视频生成技术

- 引言

- Step-Video-T2V 项目概述

- 核心技术

- 1. 视频变分自编码器(Video-VAE)

- 2. 3D 全注意力扩散 Transformer(DiT w/ 3D Full Attention)

- 3. 视频直接偏好优化(Video-DPO)

- 项目运行方式与执行步骤

- 1. 环境准备

- 2. 安装依赖

- 3. 模型下载

- 4. 推理脚本

- 多 GPU 并行部署

- 单 GPU 推理和量化

- 5. 最佳实践推理设置

- 6. 性能基准

- 执行报错与问题解决

- 1. 显存不足

- 2. 环境依赖问题

- 3. 模型下载问题

- 相关论文与研究

- 1. 扩散模型(Diffusion Models)

- 2. Transformer 架构

- 3. 3D 变分自编码器(3D VAE)

- 4. 直接偏好优化(Direct Preference Optimization, DPO)

- 总结

引言

随着人工智能技术的飞速发展,文本到视频生成(Text-to-Video, T2V)技术逐渐成为研究和应用的热点领域。这种技术能够根据文本描述生成相应的视频内容,具有广泛的应用前景,如视频创作、广告制作、教育娱乐等。Step-Video-T2V 是一个由 Stepfun-AI 团队开发的先进文本到视频生成模型,它以其卓越的性能和高效的实现方式,为这一领域带来了新的突破。

Step-Video-T2V 项目概述

Step-Video-T2V 是一个具有 300 亿参数的先进文本到视频生成模型,能够生成长达 204 帧的视频。为了提高训练和推理效率,Step-Video-T2V 提出了一种深度压缩的视频变分自编码器(Video-VAE),实现了 16x16 空间和 8x 时间压缩比。此外,Step-Video-T2V 还采用了直接偏好优化(Direct Preference Optimization, DPO)技术,进一步提升了生成视频的视觉质量。

核心技术

1. 视频变分自编码器(Video-VAE)

Step-Video-T2V 的 Video-VAE 是一种深度压缩的变分自编码器,能够实现 16x16 空间和 8x 时间压缩比,同时保持卓越的视频重建质量。这种压缩不仅加速了训练和推理过程,还与扩散过程对压缩表示的偏好相一致。

2. 3D 全注意力扩散 Transformer(DiT w/ 3D Full Attention)

Step-Video-T2V 基于扩散 Transformer(DiT)架构,包含 48 层,每层有 48 个注意力头,每个头的维度为 128。AdaLN-Single 用于引入时间步条件,QK-Norm 机制确保训练的稳定性,3D RoPE 在处理不同长度和分辨率的视频序列中发挥关键作用。

3. 视频直接偏好优化(Video-DPO)

Step-Video-T2V 通过直接偏好优化(DPO)技术进一步提升生成视频的视觉质量。DPO 利用人类偏好数据对模型进行微调,确保生成内容更符合人类期望。

项目运行方式与执行步骤

1. 环境准备

在开始运行 Step-Video-T2V 之前,需要确保你的开发环境已经准备好。以下是推荐的环境配置:

- 操作系统:推荐使用 Linux,Windows 用户可能需要额外配置 WSL 或虚拟机。

- Python 版本:建议使用 Python 3.10 或更高版本。

- CUDA 和 GPU:确保你的系统安装了 CUDA,并且 GPU 驱动程序是最新的。推荐使用具有 80GB 内存的 GPU 以获得更好的生成质量。

2. 安装依赖

首先,需要克隆项目仓库并安装依赖项:

git clone https://github.com/stepfun-ai/Step-Video-T2V.git

cd Step-Video-T2V

创建并激活 Conda 环境:

conda create -n stepvideo python=3.10

conda activate stepvideo

安装项目依赖:

pip install -e .

pip install flash-attn --no-build-isolation ## flash-attn 是可选的

3. 模型下载

Step-Video-T2V 提供了多种模型版本,可以通过 Hugging Face 或 ModelScope 下载。例如,下载 Step-Video-T2V 模型:

# Hugging Face

huggingface-cli download stepfun-ai/Step-Video-T2V --local-dir ./Step-Video-T2V

# ModelScope

modelscope-cli download stepfun-ai/Step-Video-T2V --local_dir ./Step-Video-T2V

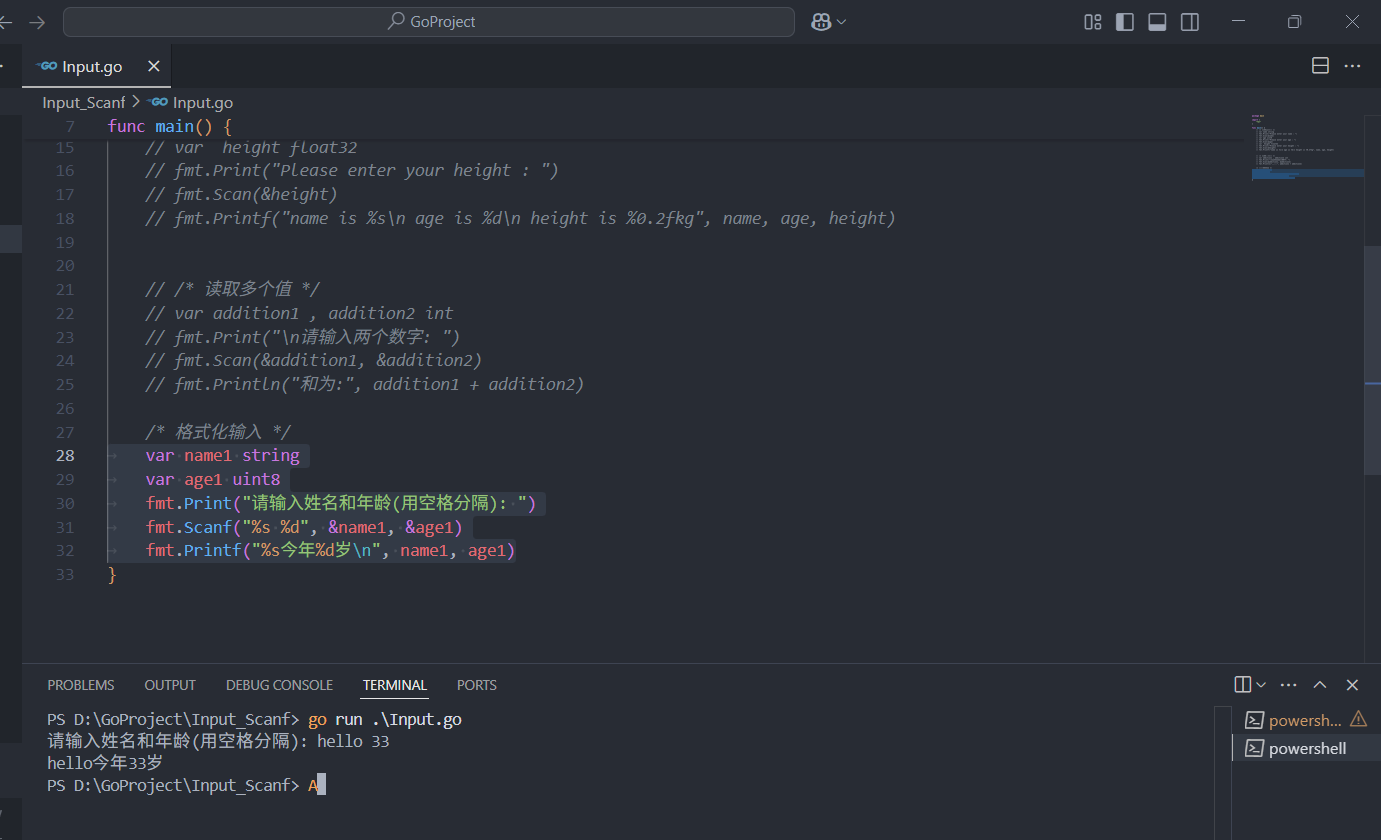

4. 推理脚本

多 GPU 并行部署

Step-Video-T2V 采用了文本编码器、VAE 解码和 DiT 的解耦策略,以优化 DiT 对 GPU 资源的利用。因此,需要一个专用 GPU 来处理文本编码器的嵌入和 VAE 解码的 API 服务。

python api/call_remote_server.py --model_dir where_you_download_dir & ## 假设你有超过 4 个 GPU 可用。此命令将返回文本编码器 API 和 VAE API 的 URL。请在以下命令中使用返回的 URL。

parallel=4 # 或 parallel=8

url='127.0.0.1'

model_dir=where_you_download_dir

tp_degree=2

ulysses_degree=2

# 确保 tp_degree x ulysses_degree = parallel

torchrun --nproc_per_node $parallel run_parallel.py --model_dir $model_dir --vae_url $url --caption_url $url --ulysses_degree $ulysses_degree --tensor_parallel_degree $tp_degree --prompt "一名宇航员在月球上发现一块石碑,上面印有‘stepfun’字样,闪闪发光" --infer_steps 50 --cfg_scale 9.0 --time_shift 13.0

单 GPU 推理和量化

对于单 GPU 推理,ModelScope 的 DiffSynth-Studio 项目提供了单 GPU 推理和量化支持,可以显著减少所需的显存。具体信息请参考其示例。

5. 最佳实践推理设置

Step-Video-T2V 在推理设置中表现出色,能够生成高保真和动态的视频。然而,实验表明,推理超参数的变化对视频保真度和动态性的权衡有显著影响。为了获得最佳结果,推荐以下最佳实践推理参数:

| 模型 | infer_steps | cfg_scale | time_shift | num_frames |

|---|---|---|---|---|

| Step-Video-T2V | 30-50 | 9.0 | 13.0 | 204 |

| Step-Video-T2V-Turbo (推理步数蒸馏) | 10-15 | 5.0 | 17.0 | 204 |

6. 性能基准

Step-Video-T2V 发布了一个新的基准测试 Step-Video-T2V-Eval,包含 128 个来自真实用户的中文提示,涵盖 11 个不同类别:体育、美食、风景、动物、节日、组合概念、超现实、人物、3D 动画、电影摄影和风格。

执行报错与问题解决

在运行 Step-Video-T2V 项目时,可能会遇到一些常见的问题。以下是一些常见问题及其解决方法:

1. 显存不足

如果在运行时遇到显存不足的错误,可以尝试以下方法:

- 使用量化技术:通过量化技术减少模型的显存占用。

- 降低分辨率:降低生成视频的分辨率,例如从 768x768 降低到 544x992。

- 减少推理步数:通过调整

infer_steps参数来减少推理步数。

2. 环境依赖问题

如果在安装依赖时遇到问题,可以尝试以下方法:

- 更新 pip 和 setuptools:确保 pip 和 setuptools 是最新版本。

- 手动安装依赖:对于某些依赖项,可以尝试手动安装,例如

torch和transformers。

3. 模型下载问题

如果在下载模型时遇到问题,可以尝试以下方法:

- 检查网络连接:确保你的网络连接正常,能够访问 Hugging Face 或 ModelScope。

- 手动下载模型:如果自动下载失败,可以手动下载模型文件并放置到指定目录。

相关论文与研究

Step-Video-T2V 的开发基于多项前沿研究,其中一些关键的论文和技术包括:

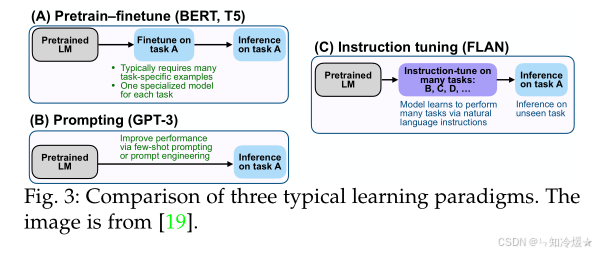

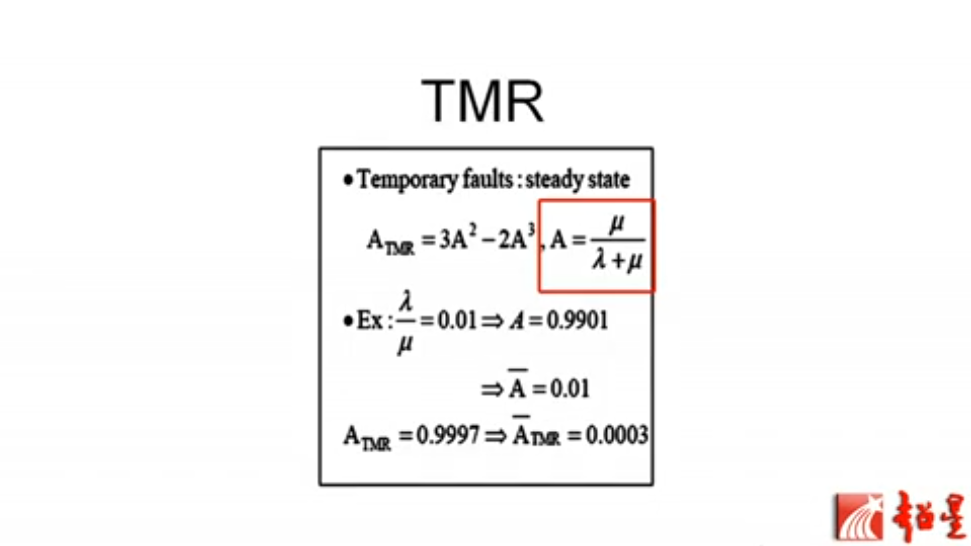

1. 扩散模型(Diffusion Models)

扩散模型是一种基于噪声扩散和去噪过程的生成模型。其核心思想是通过逐步添加噪声将数据分布转换为先验分布,然后通过去噪过程恢复原始数据分布。Step-Video-T2V 使用了扩散模型的框架,结合了 Flow Matching 技术,显著提高了生成视频的质量。

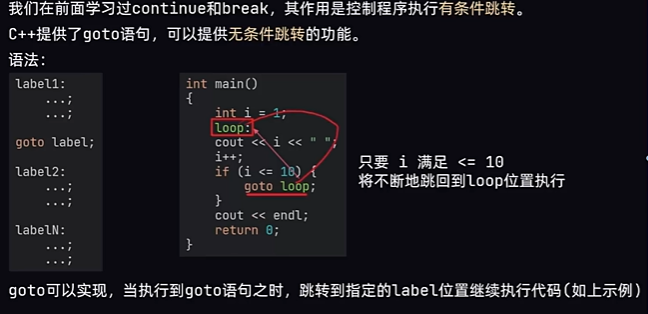

2. Transformer 架构

Step-Video-T2V 的模型架构基于 Transformer,这种架构在自然语言处理和计算机视觉领域都取得了巨大成功。Transformer 的自注意力机制能够有效地捕捉长距离依赖关系,使其在视频生成任务中表现出色。

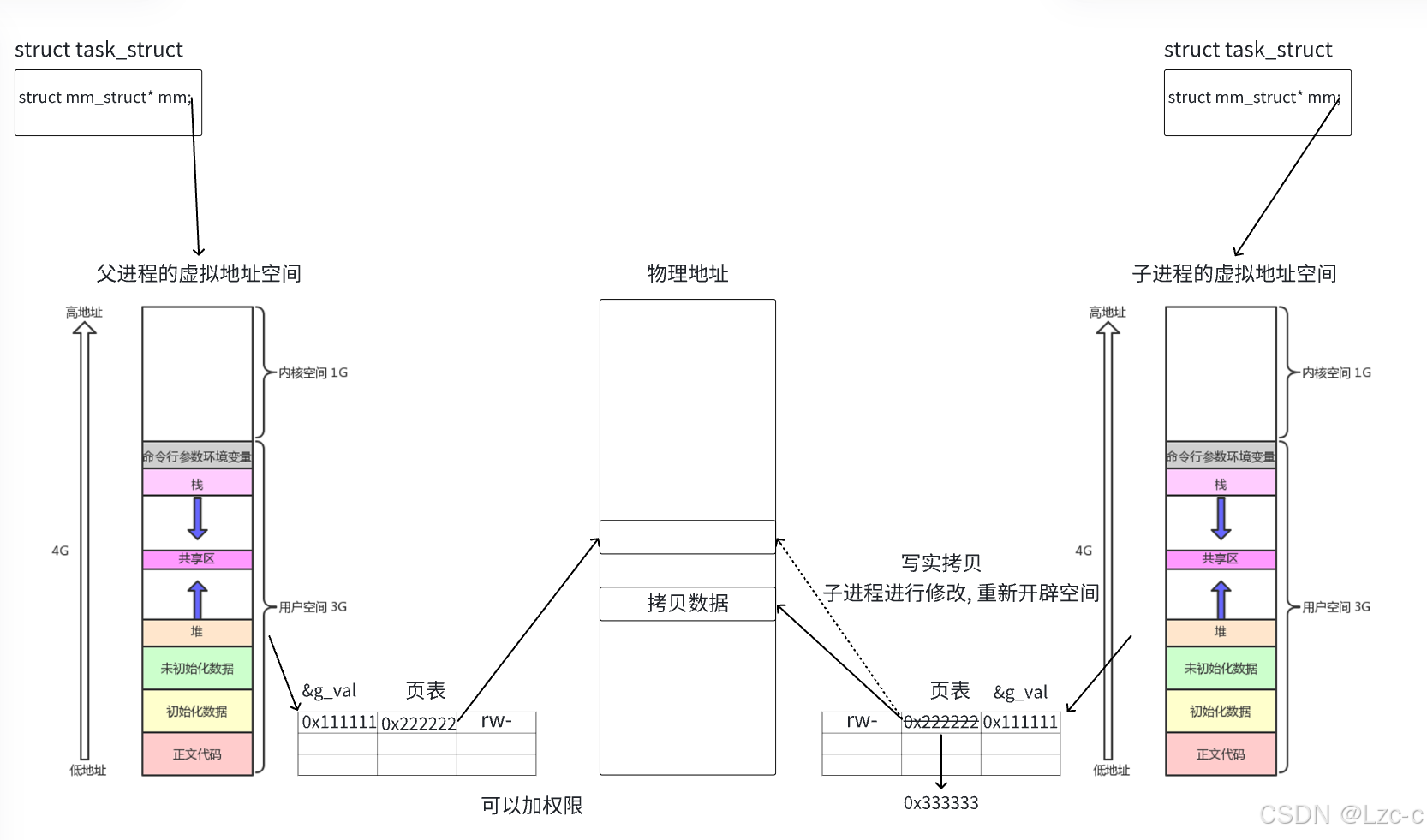

3. 3D 变分自编码器(3D VAE)

Step-Video-T2V 的 Video-VAE 是一种深度压缩的变分自编码器,专门用于视频生成。它通过结合多种策略,显著提高了时空压缩效率,并保留了时间信息。

4. 直接偏好优化(Direct Preference Optimization, DPO)

DPO 是一种基于人类偏好数据的优化技术,通过微调模型以生成更符合人类期望的内容。Step-Video-T2V 在最终阶段应用了 DPO 技术,进一步提升了生成视频的视觉质量。

总结

Step-Video-T2V 项目以其卓越的性能、高效的实现方式和开源性,为文本到视频生成领域提供了一个强大的工具。通过本文的详细介绍,读者可以全面了解 Step-Video-T2V 的技术架构,并掌握如何在实际项目中应用这一模型。无论是研究人员还是开发者,都可以从 Step-Video-T2V 中受益,推动视频生成技术的发展和应用。

未来,随着技术的不断进步,Step-Video-T2V 有望在更多领域发挥更大的作用,为人类创造更加丰富多彩的视觉内容。