简介

在人工智能技术飞速发展的今天,Transformer模型凭借其强大的序列处理能力和自注意力机制,成为自然语言处理、计算机视觉、语音识别等领域的核心技术。本文将从基础理论出发,结合企业级开发实践,深入解析Transformer模型的原理与实现方法。通过完整的代码示例、优化策略及实际应用场景,帮助开发者从零构建高性能AI系统。文章涵盖模型架构设计、训练优化技巧、多模态应用案例等内容,并通过Mermaid流程图直观展示关键概念。无论你是初学者还是进阶开发者,都能通过本文掌握Transformer模型的核心技术,并将其高效应用于实际项目中。

一、Transformer模型的核心原理

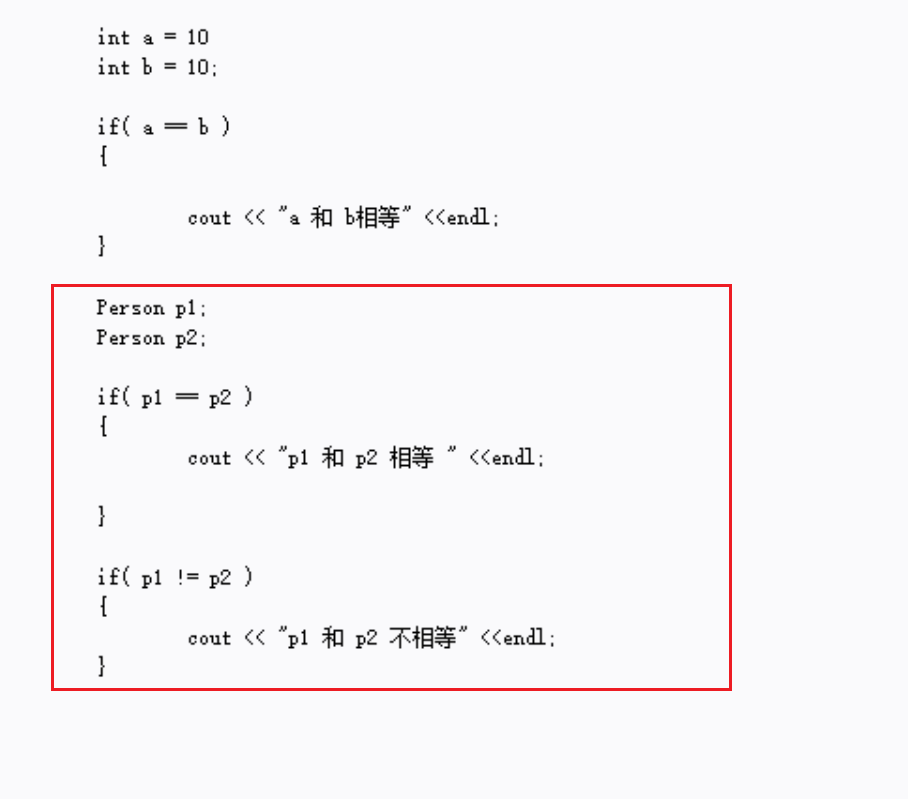

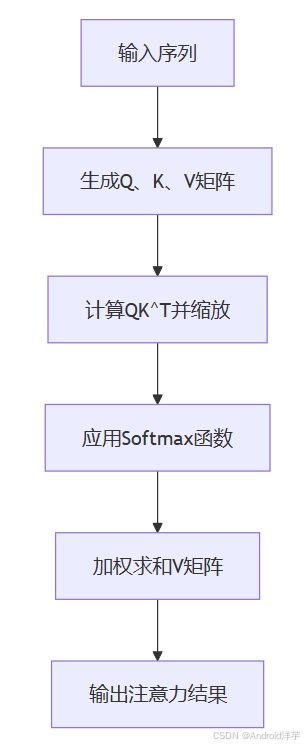

1.1 自注意力机制(Self-Attention)

Transformer模型的核心在于自注意力机制,它允许模型动态计算输入序列中每个元素与其他元素的相关性,从而捕捉长距离依赖关系。自注意力机制的计算公式如下:

Attention ( Q , K , V ) = softmax ( Q K T d k ) V \text{Attention}(Q, K, V) = \text{softmax}\left(\frac{QK^T}{\sqrt{d_k}}\right)V Attention(Q,K,V)=softmax(dkQKT)V

其中, Q Q Q、 K K K、 V V V分别表示查询矩阵、键矩阵和值矩阵, d k d_k dk是缩放因子。

流程图:

1.2 多头注意力(Multi-Head Attention)

多头注意力通过并行计算多个自注意力子层,增强模型对不同特征的关注能力。每个注意力头独立计算,最终结果通过线性变换合并:

MultiHead ( Q , K , V ) = Concat ( h 1 , h 2 , . . . , h h ) W O \text{MultiHead}(Q, K, V) = \text{Concat}(h_1, h_2, ..., h_h)W^O MultiHead(Q,K,V)=Concat(h1,h2,...,hh)WO

其中, h i h_i hi表示第 i i i个注意力头的输出, W O W^O WO是合并权重矩阵。

代码示例(PyTorch实现):

import torch

import torch.nn as nn

class MultiHeadAttention(nn.Module):

def __init__(self, embed_dim, num_heads):

super(MultiHeadAttention, self).__init__()

self.embed_dim = embed_dim

self.num_heads = num_heads

self.head_dim = embed_dim // num_heads

assert self.head_dim * num_heads == embed_dim, "Embedding dimension must be divisible by number of heads"

self.qkv = nn.Linear(embed_dim, 3 * embed_dim)

self.out = nn.Linear(embed_dim, embed_dim)

def forward(self, x):

batch_size, seq_len, embed_dim = x.size()

qkv = self.qkv(x).reshape(batch_size, seq_len, 3, self.num_heads, self.head_dim)

q, k, v = qkv.unbind(2)

# 计算注意力分数

scores = torch.einsum("bqhd,bkhd->bhqk", q, k) / (self.head_dim ** 0.5)

attn_weights = torch.softmax(scores, dim=-1)

# 应用注意力权重

out = torch.einsum("bhqk,bkhd->bqhd", attn_weights, v)

out = out.reshape(batch_size, seq_len, embed_dim)

out = self.out(out)

return out

1.3 位置编码(Positional Encoding)

Transformer模型通过位置编码引入序列的位置信息。常见的编码方式包括正弦和余弦函数组合:

P E ( p o s , 2 i ) = sin ( p o s 10000 2 i / d ) , P E ( p o s , 2 i + 1 ) = cos ( p o s 10000 2 i / d ) PE_{(pos, 2i)} = \sin\left(\frac{pos}{10000^{2i/d}}\right), \quad PE_{(pos, 2i+1)} = \cos\left(\frac{pos}{10000^{2i/d}}\right) PE(pos,2i)=sin(100002i/dpos),PE(pos,2i+1)=cos(100002i/dpos)

流程图:

二、企业级AI开发实战

2.1 模型架构设计

企业级AI应用通常需要处理大规模数据集和复杂任务。以下是Transformer模型的完整架构设计:

2.1.1 编码器-解码器结构

Transformer模型由编码器和解码器组成。编码器将输入序列转换为中间表示,解码器根据编码器输出生成目标序列。

代码示例(PyTorch实现):

class TransformerEncoder(nn.Module):

def __init__(self, embed_dim, num_heads, ff_dim, num_layers):

super(TransformerEncoder, self).__init__()

self.layers = nn.ModuleList([

TransformerLayer(embed_dim, num_heads, ff_dim)

for _ in range(num_layers)

])

def forward(self, x):

for layer in self.layers:

x = layer(x)

return x

class TransformerDecoder(nn.Module):

def __init__(self, embed_dim, num_heads, ff_dim, num_layers):

super(TransformerDecoder, self).__init__()

self.layers = nn.ModuleList([

TransformerLayer(embed_dim, num_heads, ff_dim)

for _ in range(num_layers)

])

def forward(self, x, encoder_output):

for layer in self.layers:

x = layer(x, encoder_output)

return x

2.1.2 前馈神经网络(FFN)

每个Transformer层包含两个子层:自注意力子层和前馈神经网络子层。FFN用于增加模型的非线性表达能力:

FFN ( x ) = max ( 0 , x W 1 + b 1 ) W 2 + b 2 \text{FFN}(x) = \max(0, xW_1 + b_1)W_2 + b_2 FFN(x)=max(0,xW1+b1)W2+b2

代码示例(PyTorch实现):

class FeedForward(nn.Module):

def __init__(self, embed_dim, ff_dim):

super(FeedForward, self).__init__()

self.linear1 = nn.Linear(embed_dim, ff_dim)

self.linear2 = nn.Linear(ff_dim, embed_dim)

self.relu = nn.ReLU()

def forward(self, x):

x = self.linear1(x)

x = self.relu(x)

x = self.linear2(x)

return x

2.2 模型训练与优化

2.2.1 混合精度训练

混合精度训练通过使用半精度浮点数(FP16)加速计算,同时保持模型精度。以下是一个使用PyTorch实现混合精度训练的示例:

代码示例(PyTorch实现):

from torch.cuda.amp import autocast, GradScaler

model = TransformerModel().to(device)

optimizer = torch.optim.Adam(model.parameters(), lr=1e-4)

scaler = GradScaler()

for epoch in range(num_epochs):

for inputs, targets in dataloader:

optimizer.zero_grad()

with autocast():

outputs = model(inputs)

loss = criterion(outputs, targets)

scaler.scale(loss).backward()

scaler.step(optimizer)

scaler.update()

2.2.2 分布式训练

分布式训练通过多GPU并行计算加速模型训练。以下是一个使用PyTorch分布式数据并行(DDP)的示例:

代码示例(PyTorch实现):

import torch.distributed as dist

from torch.nn.parallel import DistributedDataParallel as DDP

dist.init_process_group(backend="nccl")

model = TransformerModel().to(device)

model = DDP(model)

optimizer = torch.optim.Adam(model.parameters(), lr=1e-4)

for epoch in range(num_epochs):

for inputs, targets in dataloader:

optimizer.zero_grad()

outputs = model(inputs)

loss = criterion(outputs, targets)

loss.backward()

optimizer.step()

2.3 模型部署与加速

2.3.1 TensorRT加速

TensorRT是NVIDIA推出的深度学习推理加速工具。以下是一个使用TensorRT优化Transformer模型的示例:

代码示例(Python实现):

import tensorrt as trt

TRT_LOGGER = trt.Logger(trt.Logger.WARNING)

builder = trt.Builder(TRT_LOGGER)

network = builder.create_network(1 << int(trt.NetworkDefinitionCreationFlag.EXPLICIT_BATCH))

parser = trt.OnnxParser(network, TRT_LOGGER)

with open("model.onnx", "rb") as f:

parser.parse(f.read())

config = builder.create_builder_config()

config.max_workspace_size = 1 << 30 # 1GB

engine = builder.build_engine(network, config)

三、Transformer的多模态应用

3.1 机器翻译

Transformer模型在机器翻译任务中表现出色。以下是一个基于Transformer的英德翻译模型示例:

代码示例(PyTorch实现):

class TransformerTranslationModel(nn.Module):

def __init__(self, src_vocab_size, tgt_vocab_size, embed_dim, num_heads, ff_dim, num_layers):

super(TransformerTranslationModel, self).__init__()

self.encoder = TransformerEncoder(embed_dim, num_heads, ff_dim, num_layers)

self.decoder = TransformerDecoder(embed_dim, num_heads, ff_dim, num_layers)

self.src_embedding = nn.Embedding(src_vocab_size, embed_dim)

self.tgt_embedding = nn.Embedding(tgt_vocab_size, embed_dim)

self.fc = nn.Linear(embed_dim, tgt_vocab_size)

def forward(self, src, tgt):

src_emb = self.src_embedding(src)

tgt_emb = self.tgt_embedding(tgt)

encoder_output = self.encoder(src_emb)

decoder_output = self.decoder(tgt_emb, encoder_output)

output = self.fc(decoder_output)

return output

3.2 医疗影像分析

Transformer模型在医学影像分析中也展现出强大能力。以下是一个基于Vision Transformer的乳腺癌分类模型示例:

代码示例(PyTorch实现):

class VisionTransformer(nn.Module):

def __init__(self, image_size, patch_size, num_classes, embed_dim, num_heads, num_layers):

super(VisionTransformer, self).__init__()

self.patch_emb = PatchEmbedding(image_size, patch_size, embed_dim)

self.cls_token = nn.Parameter(torch.randn(1, 1, embed_dim))

self.pos_emb = PositionalEncoding(embed_dim, image_size, patch_size)

self.transformer = TransformerEncoder(embed_dim, num_heads, embed_dim * 4, num_layers)

self.fc = nn.Linear(embed_dim, num_classes)

def forward(self, x):

x = self.patch_emb(x)

cls_tokens = self.cls_token.expand(x.shape[0], -1, -1)

x = torch.cat((cls_tokens, x), dim=1)

x = self.pos_emb(x)

x = self.transformer(x)

x = x[:, 0]

x = self.fc(x)

return x

四、企业级AI应用案例

4.1 客服机器人

Transformer模型结合业务知识库,可构建高效的客服机器人。以下是一个基于Hugging Face Transformers库的示例:

代码示例(Python实现):

from transformers import AutoTokenizer, AutoModelForCausalLM

tokenizer = AutoTokenizer.from_pretrained("gpt2")

model = AutoModelForCausalLM.from_pretrained("gpt2")

def respond_to_query(query):

input_ids = tokenizer.encode(query, return_tensors="pt")

reply_ids = model.generate(input_ids, max_length=100, num_return_sequences=1)

reply = tokenizer.decode(reply_ids[0], skip_special_tokens=True)

return reply

user_query = "How can I track my order?"

bot_reply = respond_to_query(user_query)

print("Bot:", bot_reply)

4.2 异常交易检测

Transformer模型可用于银行异常交易检测。以下是一个基于BERT+BiLSTM的示例:

代码示例(PyTorch实现):

class AnomalyDetectionModel(nn.Module):

def __init__(self, bert_model, hidden_dim):

super(AnomalyDetectionModel, self).__init__()

self.bert = BertModel.from_pretrained(bert_model)

self.lstm = nn.LSTM(bert.config.hidden_size, hidden_dim, bidirectional=True)

self.fc = nn.Linear(hidden_dim * 2, 1)

def forward(self, x):

outputs = self.bert(x)

sequence_output = outputs.last_hidden_state

lstm_out, _ = self.lstm(sequence_output)

out = self.fc(lstm_out)

return out

五、总结

Transformer模型凭借其强大的序列处理能力和自注意力机制,已成为企业级AI应用的核心技术。本文从基础理论出发,结合企业级开发实践,深入解析了Transformer模型的原理与实现方法。通过完整的代码示例、优化策略及实际应用场景,开发者能够高效构建高性能AI系统。未来,随着技术的不断进步,Transformer模型将在更多领域发挥重要作用,推动人工智能技术迈向新的高度。