人脸检测添加注意力机制

- 简介

- 人脸检测的核心挑战与注意力机制的作用

- 人脸检测中的注意力机制

- 作用

- 选型参考

- 基础选择(空间注意力 vs 通道注意力)

- 空间注意力(关注“哪里”重要)

- 通道注意力(关注“什么特征”重要)

- 进阶选择:结合多机制

- CBAM(Convolutional Block Attention Module)

- 多头自注意力(Transformer变体)

- 轻量化选择(稀疏注意力)

- 局部窗口注意力

- 轴向注意力(Axial Attention)

- 针对具体问题的注意力设计

- 多尺度人脸检测

- 遮挡人脸检测

- 小目标检测

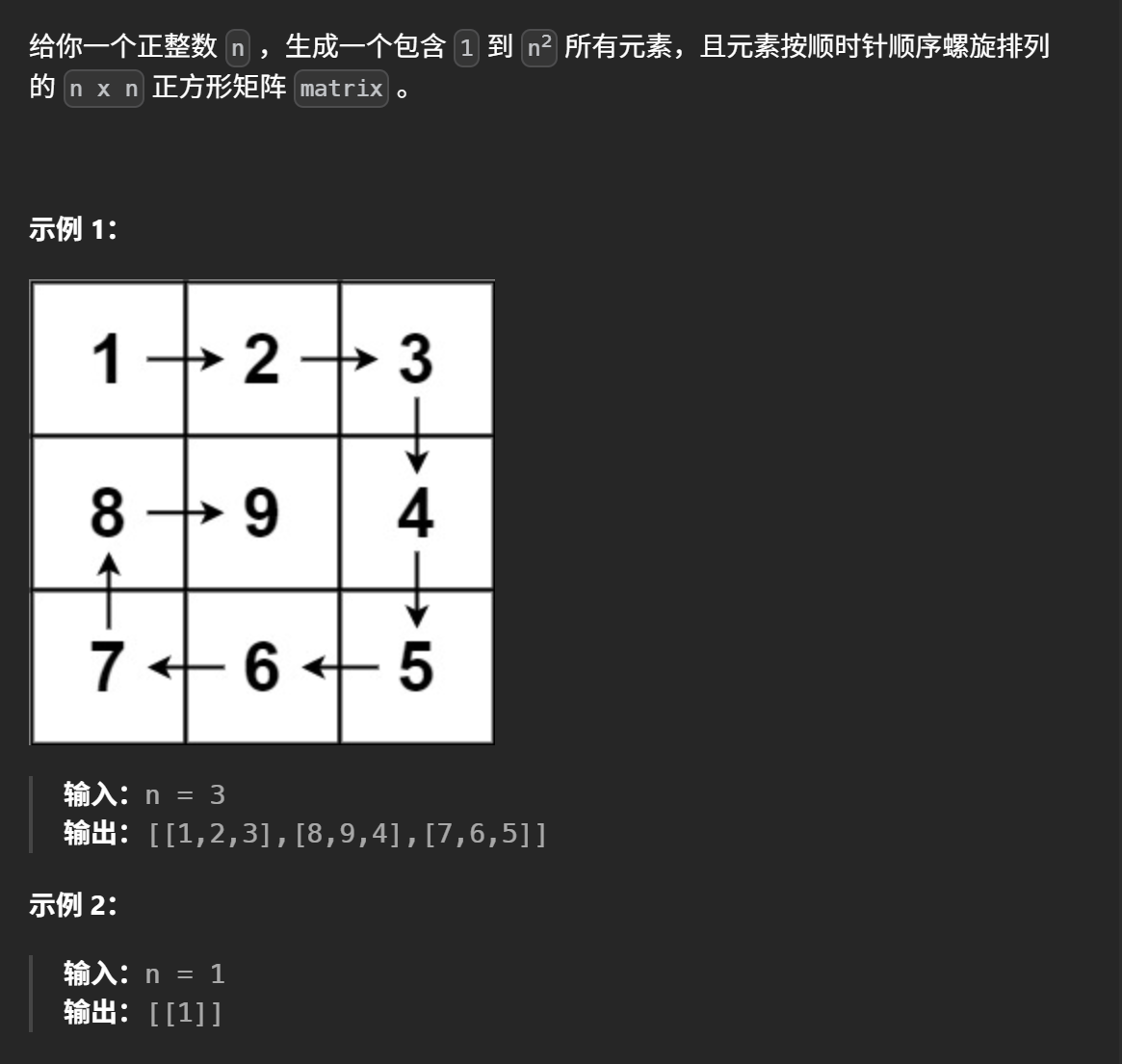

简介

人脸检测的核心挑战与注意力机制的作用

| 挑战 | 注意力机制的解决方案 |

|---|---|

| 局部关键特征(如眼睛、嘴巴) | 空间注意力聚焦人脸局部区域 |

| 多尺度人脸(大小差异) | 多尺度注意力或金字塔注意力 |

| 遮挡问题 | 动态抑制遮挡区域的权重 |

| 背景干扰 | 通道注意力增强人脸相关特征通道 |

| 计算效率(实时性要求) | 稀疏注意力或局部窗口注意力 |

人脸检测中的注意力机制

在人脸检测模型中,注意力机制通常添加到特征提取网络(如Backbone)或特征融合模块中

作用

增强关键区域的特征:注意力机制能够动态调整特征图中不同区域的权重,使模型更关注人脸区域,抑制背景噪声

处理遮挡和多尺度问题:在遮挡或多尺度人脸的情况下,注意力机制可以帮助模型聚焦于人脸的可见部分或关键特征(如眼睛、鼻子等)

提升检测精度:通过引入注意力机制,模型可以更准确地定位人脸边界框,减少误检和漏检

改善小目标检测:对于小尺度人脸,注意力机制可以增强其特征表示,提升检测效果

选型参考

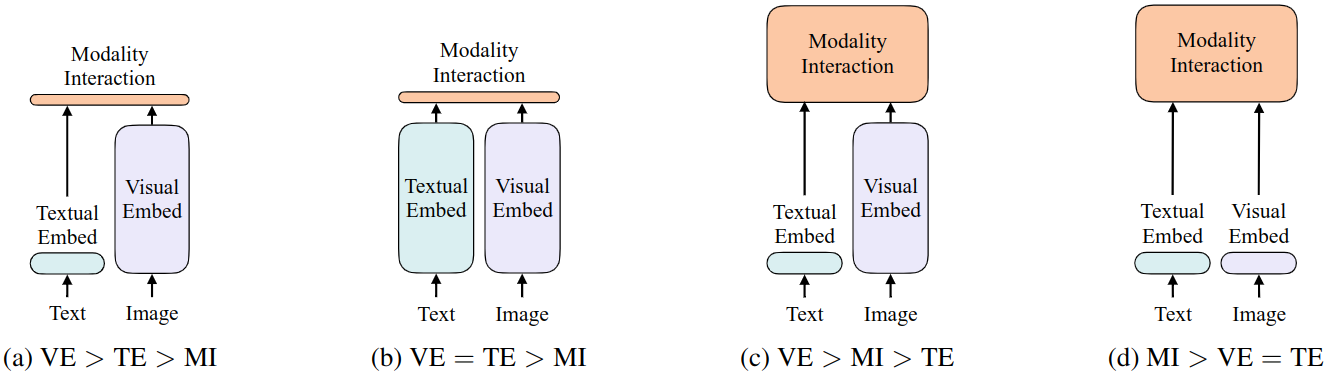

基础选择(空间注意力 vs 通道注意力)

空间注意力(关注“哪里”重要)

适用场景:需要定位人脸或关键点(如边界框回归)。

典型结构:

# 示例:空间注意力模块(CBAM中的空间注意力)

def spatial_attention(feature):

avg_pool = torch.mean(feature, dim=1, keepdim=True) # 通道平均

max_pool, _ = torch.max(feature, dim=1, keepdim=True) # 通道最大

concat = torch.cat([avg_pool, max_pool], dim=1)

spatial_weights = torch.sigmoid(conv(concat)) # 通过卷积生成权重

return feature * spatial_weights

通道注意力(关注“什么特征”重要)

适用场景:增强人脸相关特征(如肤色、纹理通道)。

典型结构(SENet风格)

def channel_attention(feature):

gap = torch.mean(feature, dim=[2,3], keepdim=True) # 全局平均池化

channel_weights = torch.sigmoid(fc(gap)) # 全连接层生成权重

return feature * channel_weights

进阶选择:结合多机制

CBAM(Convolutional Block Attention Module)

结构:串联通道注意力 + 空间注意力。

优势:同时优化特征通道和空间位置。

代码实现:

class CBAM(nn.Module):

def __init__(self, channels):

super().__init__()

self.channel_att = ChannelAttention(channels)

self.spatial_att = SpatialAttention()

def forward(self, x):

x = self.channel_att(x)

x = self.spatial_att(x)

return x

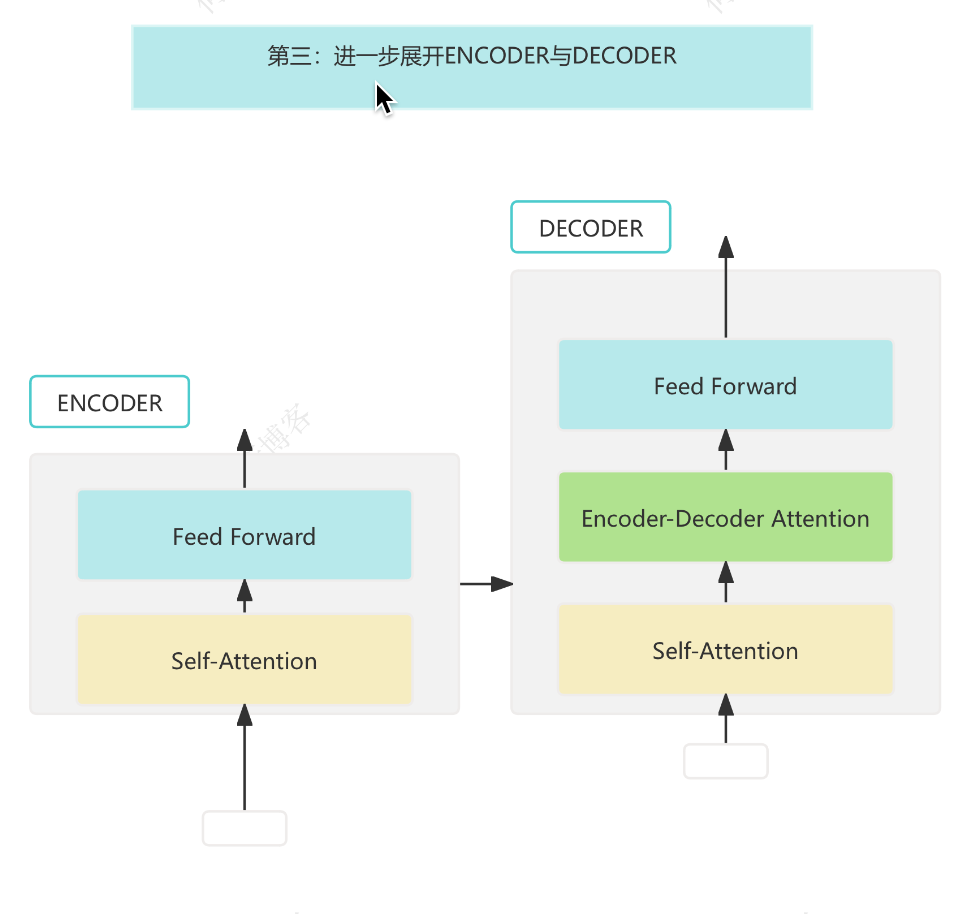

多头自注意力(Transformer变体)

适用场景:需要建模长距离依赖(如遮挡人脸的部分关系)。

注意点:计算成本高,适合小分辨率特征图或轻量化设计。

改进方案:

- 使用局部窗口注意力(如Swin Transformer)

- 在Backbone的高层特征(低分辨率)应用自注意力

轻量化选择(稀疏注意力)

局部窗口注意力

适用场景:移动端或实时检测(如YOLO + 注意力)。

示例:仅在3×3邻域内计算注意力权重。

轴向注意力(Axial Attention)

特点:按行和列分别计算注意力,降低计算复杂度。

针对具体问题的注意力设计

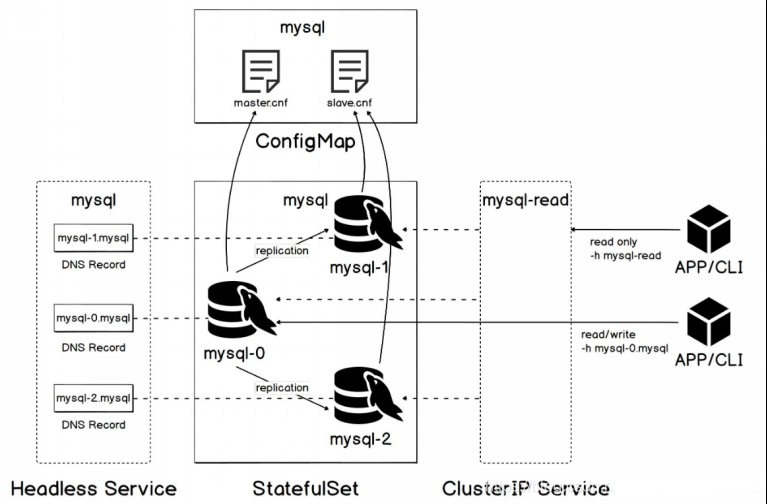

多尺度人脸检测

方案:金字塔注意力(PANet、FPN + Attention)

- 在特征金字塔(FPN)的每一层独立应用注意力

- 高层特征(小目标)用自注意力,低层特征(大目标)用通道注意力。

遮挡人脸检测

方案:动态遮挡感知注意力

- 通过额外分支预测遮挡区域掩码,抑制被遮挡区域的权重。

- 参考论文:Occlusion-Aware R-CNN。

小目标检测

方案:高频细节注意力

- 在浅层网络(高分辨率特征图)应用空间注意力,聚焦细节纹理。