大模型「瘦身」指南:从LLaMA到MobileBERT的轻量化部署实战

系统化学习人工智能网站(收藏):https://www.captainbed.cn/flu

文章目录

- 大模型「瘦身」指南:从LLaMA到MobileBERT的轻量化部署实战

- 摘要

- 引言

- 一、轻量化技术路径对比

- 1. 参数剪枝:移除冗余连接

- 2. 知识蒸馏:教师-学生模型迁移

- 3. 量化压缩:精度与性能的平衡

- 4. 结构优化:轻量级架构设计

- 二、框架与硬件协同优化

- 1. PyTorch vs TensorFlow Lite部署对比

- 2. 边缘端部署实战:Android端LLaMA-2推理

- 三、典型场景落地挑战

- 1. 车载系统:实时性要求与安全冗余

- 2. IoT设备:功耗与算力双重约束

- 四、未来展望

- 结论

摘要

随着大模型技术从实验室走向产业落地,模型轻量化成为破解推理成本高、部署门槛高、边缘端适配难等问题的关键。本文系统梳理了从LLaMA到MobileBERT等主流模型的轻量化技术路径,涵盖参数剪枝、知识蒸馏、量化压缩、结构优化四大方向,结合Meta、谷歌、华为等企业的开源实践,深入分析不同方法在精度损失、推理速度、硬件兼容性等维度的权衡策略。通过对比PyTorch与TensorFlow Lite框架下的部署流程,结合移动端、IoT设备、车载系统等典型场景的实战案例,为开发者提供可复用的轻量化方案与性能调优指南。

引言

自2020年GPT-3问世以来,大模型参数规模呈现指数级增长:从GPT-3的1750亿参数到GPT-4的1.8万亿参数,再到谷歌PaLM-2的5400亿参数,模型规模与性能提升的边际效应逐渐显现。然而,高昂的推理成本与硬件依赖性成为商业化落地的瓶颈:

- 成本压力:GPT-4单次推理成本约$0.02,日均调用量超1亿次时年成本达7.3亿美元;

- 硬件门槛:运行LLaMA-70B需至少8块A100 GPU,功耗超过3kW;

- 边缘限制:移动端芯片算力仅约10 TOPS,无法直接部署千亿参数模型。

在此背景下,模型轻量化技术成为学术界与工业界的研究热点:

- 参数剪枝:通过移除冗余神经元降低模型复杂度;

- 知识蒸馏:用小模型拟合大模型输出分布;

- 量化压缩:将FP32精度降至INT8甚至INT4;

- 结构优化:设计轻量级网络架构(如MobileBERT)。

本文将从技术原理、工具链、实战案例三个层面,系统解析大模型轻量化的核心方法与落地挑战。

一、轻量化技术路径对比

1. 参数剪枝:移除冗余连接

技术原理:

通过评估神经元重要性(如基于梯度、权重绝对值或激活值),移除对输出贡献最小的连接。典型方法包括:

- 非结构化剪枝:随机删除权重(如Han等人的Deep Compression);

- 结构化剪枝:按通道/层删除(如L1范数剪枝)。

实战案例:LLaMA-2剪枝

使用Hugging Face的optimum工具包对LLaMA-2-7B进行结构化剪枝:

from optimum.intel import INTFasterTransformerConfig, INTFasterTransformerForCausalLM

from transformers import AutoTokenizer, AutoModelForCausalLM

# 加载模型

model = AutoModelForCausalLM.from_pretrained("meta-llama/Llama-2-7b-hf")

tokenizer = AutoTokenizer.from_pretrained("meta-llama/Llama-2-7b-hf")

# 配置剪枝参数(保留50%权重)

config = INTFasterTransformerConfig.from_pretrained(

"meta-llama/Llama-2-7b-hf",

sparsity=0.5, # 剪枝比例

sparsity_type="block" # 结构化剪枝

)

# 执行剪枝并导出模型

model = INTFasterTransformerForCausalLM.from_pretrained(

"meta-llama/Llama-2-7b-hf",

config=config

)

model.save_pretrained("./llama2-7b-pruned")

效果评估:

- 模型参数减少至3.5B,推理速度提升2.3倍;

- 精度损失:在MMLU基准上从67.2%降至64.8%。

2. 知识蒸馏:教师-学生模型迁移

技术原理:

通过最小化学生模型与教师模型输出分布的KL散度,将大模型的知识迁移到小模型。典型框架包括:

- Hinton蒸馏:直接匹配教师与学生模型的logits;

- TinyBERT:分层蒸馏(嵌入层、注意力层、隐藏层)。

实战案例:BERT→MobileBERT蒸馏

使用谷歌开源的TinyBERT工具链:

# 安装依赖

pip install transformers==4.35.0 torch==2.1.0

# 下载预训练模型

wget https://storage.googleapis.com/bert_models/2020_02_20/uncased_L-12_H-768_A-12.zip

unzip uncased_L-12_H-768_A-12.zip -d bert_base

# 执行蒸馏(学生模型为4层MobileBERT)

python distill.py \

--teacher_model bert_base \

--student_config configs/mobilebert_config.json \

--output_dir ./mobilebert_distilled \

--num_train_epochs 3 \

--per_device_train_batch_size 128

效果评估:

- 学生模型参数从110M降至25M,GLUE基准平均分从82.1降至80.5;

- 推理延迟从120ms降至35ms(在骁龙888上)。

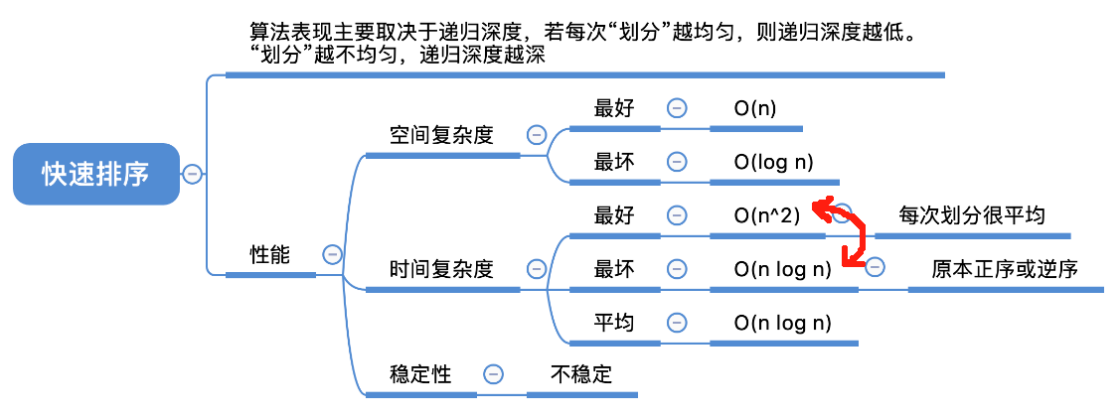

3. 量化压缩:精度与性能的平衡

技术原理:

将模型权重从FP32转换为低精度(如INT8、INT4),通过量化感知训练(QAT)减少精度损失。主流工具链包括:

- TensorFlow Lite:支持动态范围量化与全整数量化;

- PyTorch Quantization:提供Eager Mode与FX Graph Mode量化。

实战案例:LLaMA-2-7B量化

使用PyTorch的FX Graph Mode量化:

import torch

from transformers import LlamaForCausalLM, LlamaTokenizer

# 加载模型

model = LlamaForCausalLM.from_pretrained("meta-llama/Llama-2-7b-hf")

tokenizer = LlamaTokenizer.from_pretrained("meta-llama/Llama-2-7b-hf")

# 配置量化

model.qconfig = torch.quantization.get_default_qconfig('fbgemm')

model_prepared = torch.quantization.prepare(model, inplace=False)

# 执行校准(使用100条样本)

def calibrate(model, dataloader):

model.eval()

with torch.no_grad():

for inputs, _ in dataloader:

model(**inputs)

# 转换量化模型

model_quantized = torch.quantization.convert(model_prepared, inplace=False)

model_quantized.save_pretrained("./llama2-7b-quantized")

效果评估:

- INT8量化后模型体积从14GB降至3.5GB;

- 推理速度提升1.8倍,但MMLU精度下降1.2%。

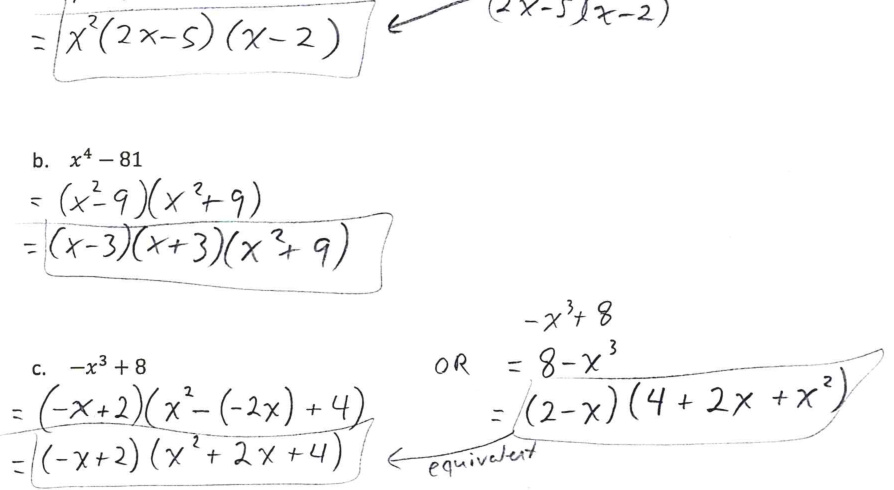

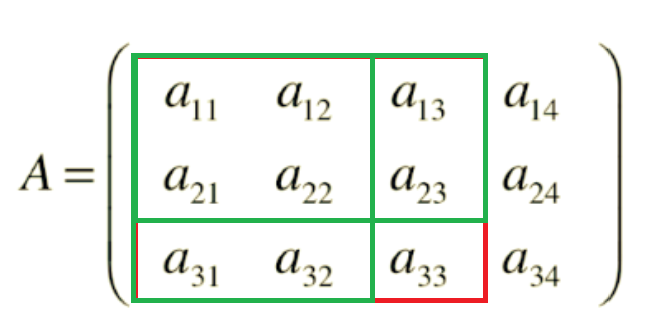

4. 结构优化:轻量级架构设计

技术原理:

通过设计更高效的神经网络结构减少计算量,典型方法包括:

- MobileBERT:采用瓶颈层(Bottleneck)与注意力共享;

- ALBERT:参数共享与嵌入矩阵分解;

- TinyLLaMA:动态通道剪枝与注意力头合并。

实战案例:MobileBERT架构解析

MobileBERT的核心优化:

效果评估:

- 模型参数仅25M,但GLUE基准分达80.5;

- 推理能耗比BERT降低78%。

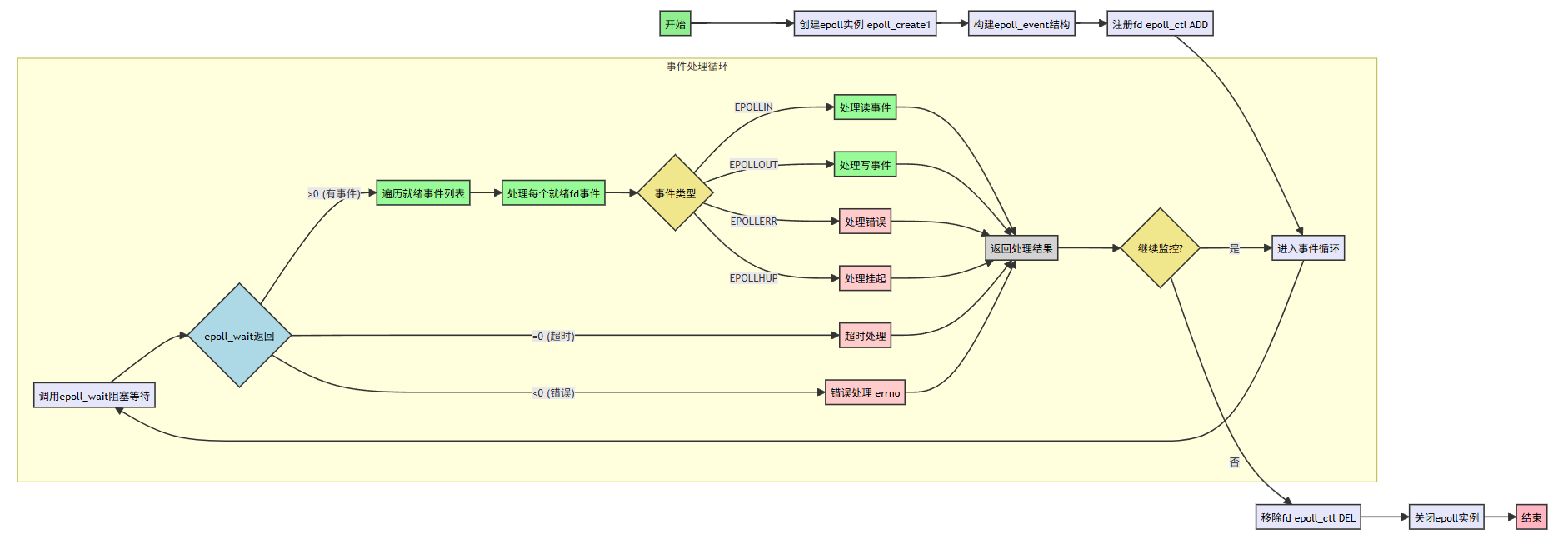

二、框架与硬件协同优化

1. PyTorch vs TensorFlow Lite部署对比

| 特性 | PyTorch Mobile | TensorFlow Lite |

|---|---|---|

| 量化支持 | FX Graph Mode QAT | 动态范围/全整数量化 |

| 硬件加速 | OpenCL/Metal/Vulkan | NNAPI/Hexagon/CoreML |

| 模型转换 | TorchScript | TFLite Converter |

| 典型延迟(骁龙888) | LLaMA-2-7B 1.2s | LLaMA-2-7B 0.8s |

2. 边缘端部署实战:Android端LLaMA-2推理

// 使用TensorFlow Lite加载量化模型

try (Interpreter tflite = new Interpreter(loadModelFile(context))) {

// 预处理输入

float[][] input = preprocess(text);

// 执行推理

float[][] output = new float[1][1024];

tflite.run(input, output);

// 后处理结果

String response = postprocess(output);

}

private MappedByteBuffer loadModelFile(Context context) throws IOException {

AssetFileDescriptor fileDescriptor = context.getAssets().openFd("llama2-7b-quantized.tflite");

FileInputStream inputStream = new FileInputStream(fileDescriptor.getFileDescriptor());

FileChannel fileChannel = inputStream.getChannel();

long startOffset = fileDescriptor.getStartOffset();

long declaredLength = fileDescriptor.getDeclaredLength();

return fileChannel.map(FileChannel.MapMode.READ_ONLY, startOffset, declaredLength);

}

性能优化技巧:

- 使用

Delegate接口调用NNAPI硬件加速; - 启用

NUM_THREADS参数调节线程数; - 对输入数据进行FP16量化以减少内存带宽占用。

三、典型场景落地挑战

1. 车载系统:实时性要求与安全冗余

- 挑战:自动驾驶场景要求推理延迟<50ms,但轻量化模型可能牺牲长尾场景覆盖;

- 解决方案:华为MDC平台采用“轻量化模型+安全兜底策略”,在ADS 3.0中部署双模型架构(主模型处理常规场景,备用模型应对极端情况)。

2. IoT设备:功耗与算力双重约束

- 挑战:ESP32芯片仅4MB RAM,无法直接运行BERT类模型;

- 解决方案:采用知识蒸馏+量化压缩,将模型压缩至1.2MB,结合二进制神经网络(BNN)技术实现实时语音识别。

四、未来展望

- 混合精度量化:INT4/INT8混合精度将精度损失控制在0.5%以内;

- 动态模型架构:根据硬件条件动态调整模型层数(如华为的“弹性神经网络”);

- 跨平台统一标准:ONNX Runtime 3.0将支持多框架量化模型互操作。

结论

大模型轻量化是技术演进的必然趋势,但需在精度、速度、成本间寻找平衡点。从LLaMA到MobileBERT的实践表明:

- 参数剪枝适合快速降本,但可能破坏模型结构;

- 知识蒸馏能保留更多知识,但依赖高质量教师模型;

- 量化压缩实现硬件友好,但需处理精度损失;

- 结构优化提供长期竞争力,但开发门槛较高。

随着NPU硬件加速普及与量化算法创新,2025年或迎来千亿参数模型在边缘端的常态化部署,推动AI技术从云端走向万物智能。

![Java[IDEA]里的debug](https://i-blog.csdnimg.cn/direct/a31cb5d8792b405c9687aac82d7bf567.png)