Windows下安装Spark

- 一、Spark安装前提

- 1.1、JDK安装(version:1.8)

- 1.1.1、JDK官网下载

- 1.1.2、JDK网盘下载

- 1.1.3、JDK安装

- 1.2、Scala安装(version:2.11.12)

- 1.2.1、Scala官网下载

- 1.2.2、Scala网盘下载

- 1.2.3、Scala安装

- 1.2.4、验证Scala是否安装成功

- 1.3、Hadoop安装(version:2.7.2)

- 二、安装Spark(version:2.4.7)

- 1.1.1、Spark官网下载

- 1.1.2、Spark网盘下载

- 1.1.3、Spark安装

- 1.2.4、验证Spark是否安装成功

一、Spark安装前提

安装Spark之前,需要安装JDK、Hadoop、Scala。

本次安装版本选择:

JDK:1.8

Hadoop:2.7.2

Scala:2.11.12

Spark:2.4.7

1.1、JDK安装(version:1.8)

1.1.1、JDK官网下载

官网下载地址(需要oracle账号)

https://www.oracle.com/java/technologies/javase/javase-jdk8-downloads.html

1.1.2、JDK网盘下载

或者网盘下载:https://pan.baidu.com/s/1MMkFbzcf8ZYvGwdHreXtUg?pwd=yyds

1.1.3、JDK安装

安装方法就不赘述了。

1.2、Scala安装(version:2.11.12)

1.2.1、Scala官网下载

官网下载地址:https://downloads.lightbend.com/scala/2.11.12/scala-2.11.12.msi

1.2.2、Scala网盘下载

网盘下载地址:https://pan.baidu.com/s/1Qiy1aEndKn_Xs-zSSLaWIA?pwd=yyds

1.2.3、Scala安装

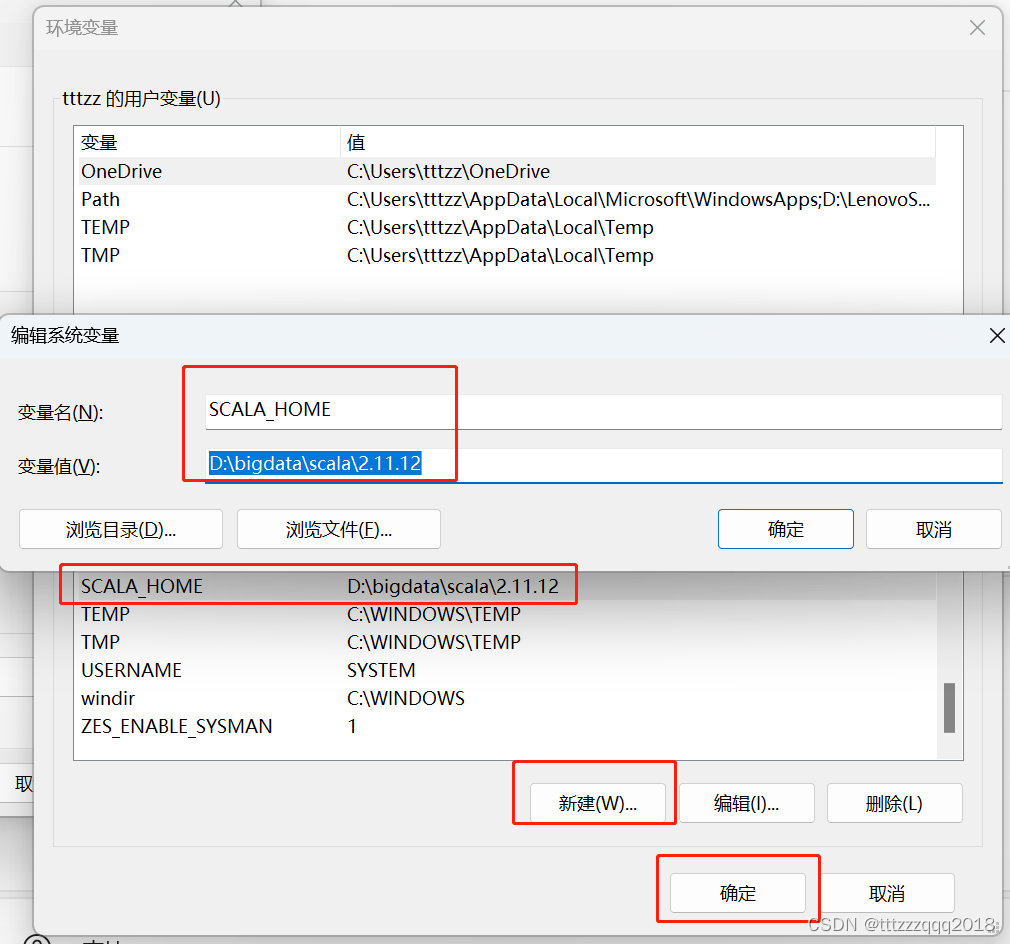

本地点击msi文件安装,安装目录为 D:\bigdata\scala\2.11.12\

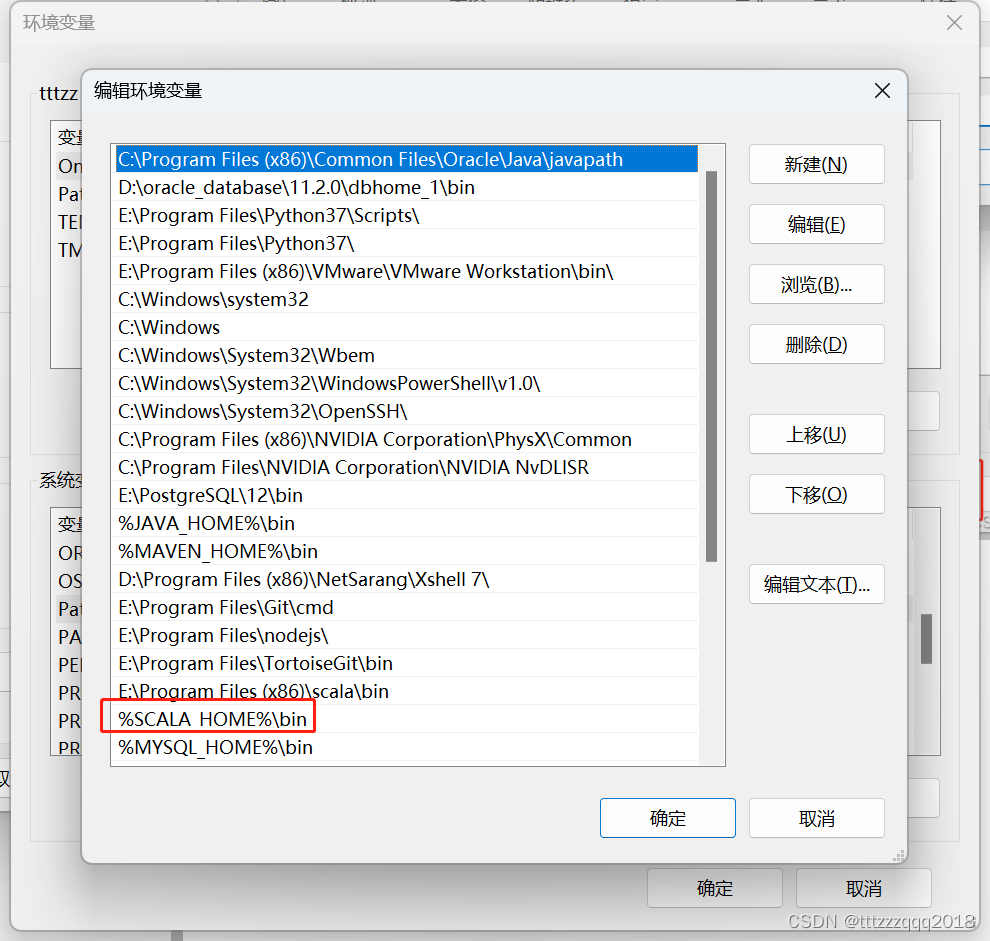

设置环境变量 %SCALA_HOME%

环境变量Path添加条目%SCALA_HOME%\bin

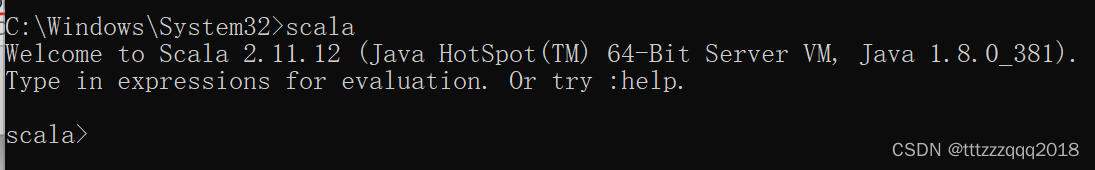

1.2.4、验证Scala是否安装成功

为了验证Scala是否安装成功,开启一个新的cmd窗口。

输入:Scala

可以看到Scala安装成功。

1.3、Hadoop安装(version:2.7.2)

参考博文:Windows下安装Hadoop(手把手包成功安装)

二、安装Spark(version:2.4.7)

1.1.1、Spark官网下载

官网下载地址:https://archive.apache.org/dist/spark/spark-2.4.7/spark-2.4.7-bin-hadoop2.7.tgz

1.1.2、Spark网盘下载

网盘下载地址:https://pan.baidu.com/s/1VyVLwnSvdMzSocj37xlErQ?pwd=yyds

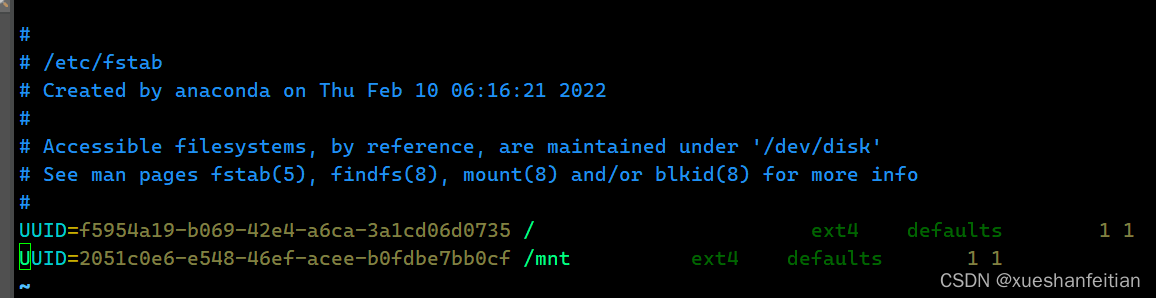

1.1.3、Spark安装

本地解压spark文件,目录为 D:\bigdata\spark\2.4.7\

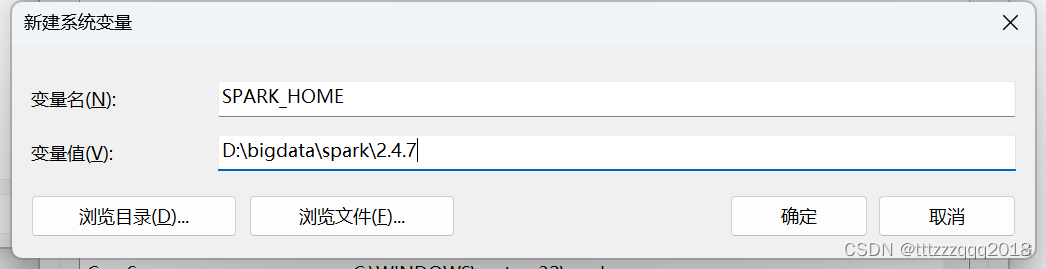

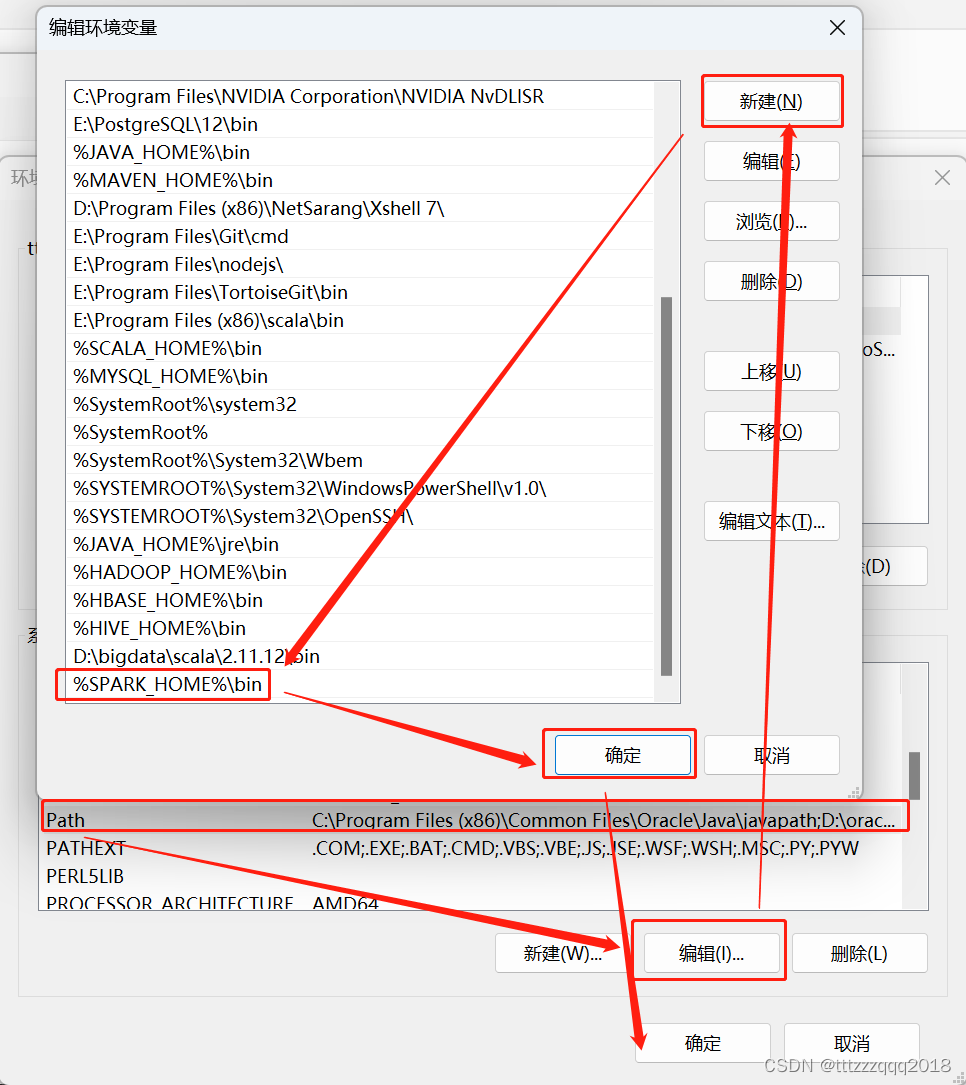

设置环境变量 %SPARK_HOME%

环境变量Path添加条目%SPARK_HOME%\bin

跟上面配置环境变量一样的配置方法。

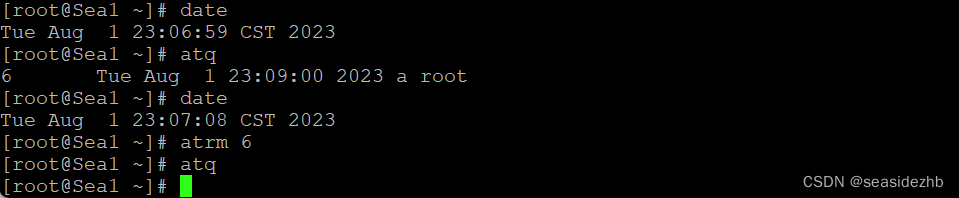

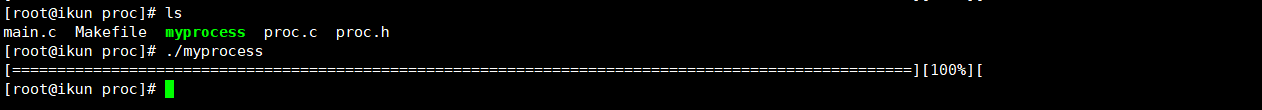

1.2.4、验证Spark是否安装成功

为了验证Spark是否安装成功,开启一个新的cmd窗口。

输入:spark-shell

显示上面的正常运行界面,表示本地的spark环境已搭建完成!

![[代码案例] pytorch快速上手写机器学习](https://img-blog.csdnimg.cn/e47c7e93587f4c5c9f64c3f3376492ac.png)