🔍 PART 1:目标检测(Object Detection)

1️⃣ 什么是目标检测?

目标检测是计算机视觉中的一个任务,目标是让模型“在图像中找到物体”,并且判断:

-

它是什么类别(classification)

-

它在哪里(localization)

输出通常是:一个或多个 bounding box + 对应类别

🧠 举例:看一张街景图,目标检测系统会输出:

[

{"class": "car", "bbox": [50, 80, 200, 300]},

{"class": "person", "bbox": [210, 100, 250, 300]}

]

2️⃣ 传统方法演变史

(1)R-CNN(Region-based CNN)

关键词:提候选区域 + 独立分类器

🛠️ 步骤:

-

使用 Selective Search 等方法,生成 2000+ 候选框(region proposals)

-

对每个框裁剪、resize,送入 CNN 提取特征(如 AlexNet)

-

用 SVM 对特征进行分类(猫狗车人等)

-

用边框回归器微调预测框的位置

✅ 优点:

-

检测准确率高,首次将 CNN 引入目标检测

-

引领了后续目标检测研究方向

❌ 缺点:

-

每张图像跑 2000 多次 CNN,速度慢如蜗牛

-

整个流程是分步骤训练,不能端到端训练

-

中间特征要保存,占用大量磁盘空间

(2)Fast R-CNN

关键词:共享特征图 + ROI Pooling + 单阶段训练

🔁 改进方法:

-

整张图只跑一次 CNN,生成特征图

-

使用 ROI Pooling 从特征图中裁剪候选框区域

-

在一个网络中同时做分类 + 边框回归

✅ 优点:

-

更快、更省内存

-

可端到端训练(使用 Softmax + Smooth L1 Loss)

❌ 缺点:

-

仍然依赖外部模块(如 Selective Search)来生成候选框

(3)Faster R-CNN

关键词:自带 RPN(Region Proposal Network)

Faster R-CNN 把“提候选框”的模块也变成一个神经网络,称为 RPN。

🚀 模型结构:

图像 → CNN → 特征图

↘→ RPN 生成候选框

↘→ ROI Pooling → 分类 + 回归

🧠 RPN 工作方式:

-

用卷积滑窗在特征图上滑动

-

每个滑窗预测:

-

是不是物体?(二分类)

-

如果是,框在哪里?(坐标回归)

-

✅ 总结优点:

-

全模型端到端训练(backprop 到最前面)

-

精度高,速度比前两者快

-

成为基准检测器(benchmark)

❌ 缺点:

-

实时性差(约 7 FPS)

-

对小物体不敏感(因层次深、特征粗)

3️⃣ YOLO(You Only Look Once)

关键词:单阶段、速度极快、端到端预测

YOLO 不再分“提框”和“分类”两步,而是一次性直接输出所有框和类别。

🧠 工作原理:

-

把输入图像划分为 S×S 网格

-

每个格子负责预测若干个 bounding box + 置信度 + 类别概率

-

最后筛选 + NMS(非极大值抑制)去掉重复框

✅ 优点:

-

快!(可达 45–155 FPS)

-

训练和预测都是端到端的

-

特别适合实时场景,如无人车、机器人

❌ 缺点:

-

精度不如 Faster R-CNN(特别是小物体)

-

对重叠目标不够敏感(因为格子限制)

4️⃣ SSD(Single Shot Detector)

关键词:多层多尺度预测、一次性输出

-

相比 YOLO,SSD 在不同尺度的 feature maps 上都进行预测

-

每个位置使用多个 aspect ratio 的 anchor box

✅ 特点:

-

保留 YOLO 的速度

-

提升对小物体、多物体的适应能力

-

应用广泛,如移动端部署

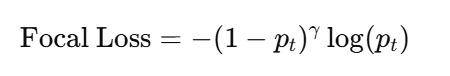

5️⃣ RetinaNet(高精度 + 快)

关键词:Focal Loss + Feature Pyramid Network

-

面对的问题:正负样本极度不平衡(99% 都是背景框)

-

引入 Focal Loss,使容易分类的样本损失变小,专注难样本

-

同时使用 FPN(从低层和高层抽取特征)

✅ 优势:

-

精度接近 Faster R-CNN,速度接近 SSD

-

成为很多工业检测系统的首选

✅ 小结对比表

| 方法 | 速度 | 精度 | 优势 |

|---|---|---|---|

| R-CNN | 慢 | 高 | 思想开创,流程复杂 |

| Fast R-CNN | 较慢 | 高 | 特征共享,训练简单 |

| Faster R-CNN | 中 | 非常高 | RPN 端到端 |

| YOLO | 非常快 | 一般 | 实时场景首选 |

| SSD | 非常快 | 中高 | 多尺度处理,小目标好 |

| RetinaNet | 快 + 准 | 很高 | 焦点损失 + 多层检测 |

🧠 Part 2:语义分割 & 实例分割

🔍 1️⃣ 什么是语义分割(Semantic Segmentation)?

就是要让模型对图像中的“每一个像素”做出分类。

换句话说,它不再是识别整张图里有没有狗,而是要把“狗的每个像素”标出来。

📷 举个例子:

一张图片里有:

-

天空

-

建筑

-

一辆车

-

一只狗

那么语义分割模型就要把:

-

所有天空像素 → 标记为 class 0

-

所有建筑像素 → class 1

-

所有车的像素 → class 2

-

所有狗的像素 → class 3

结果输出是一张和原图一样大小的图片,每个像素是一个类别编号(mask)。

🎯 用处有哪些?

| 应用场景 | 解释 |

|---|---|

| 自动驾驶 | 车道线、人、车、障碍物像素级分割 |

| 医学图像分析 | 脑肿瘤、器官、血管等结构分割 |

| 卫星遥感 | 地表分类(农田、建筑、道路) |

🧱 2️⃣ 怎么实现语义分割?——FCN

🏗️ FCN:Fully Convolutional Network

🧠 思想:

我们不能再用全连接层(FC),因为它把图像“压成一维向量”了。

所以我们把原来分类网络的 FC 层去掉,全部换成卷积层!

✅ FCN 架构:

-

编码器部分(像 VGG、ResNet):提取图像高级语义特征(但大小变小)

-

上采样部分(Upsampling / Transposed Conv):把特征图“放大回原图大小”

-

像素级预测层:对每个像素输出分类结果(比如 softmax over 21 类)

📐 下采样 → 上采样:

-

原图输入:512×512

-

编码器卷积后:32×32(高层抽象)

-

上采样恢复回 512×512,每个像素分类!

🚧 问题:上采样后信息模糊

FCN 中的上采样有时候会“糊掉”细节,比如边缘不清晰、物体轮廓不完整。

🧬 3️⃣ U-Net:更强的语义分割网络

U-Net 是专为医学图像设计的分割网络,结构长得像字母 “U”。

🧱 U-Net 结构:

| 编码器部分(左边) | 解码器部分(右边) |

|---|---|

| 多层卷积 + Pooling | 多层转置卷积 + 上采样 |

| 把图像越压越小,提取特征 | 把特征图还原成原图尺寸 |

🌉 核心创新点:Skip Connections(跳跃连接)

-

将编码器中每层的特征图 直接连接到解码器的对应层

-

这样就把 低层的边缘细节 + 高层的语义信息融合起来了!

🔍 好处:

-

保留边界、轮廓信息

-

不会因为上采样而“糊”掉小物体

-

极其适合小样本学习,医学图像超常用!

👨👩👧 4️⃣ 什么是实例分割(Instance Segmentation)?

和语义分割的区别在于:

-

语义分割:你知道哪些像素是“人”,但不知道有几个“人”

-

实例分割:你不仅知道哪些像素是“人”,还知道是第1个人、第2个人…

比如:

-

语义分割 → 把 3 个苹果都标为 class=apple

-

实例分割 → 给 3 个苹果不同 mask(Apple1, Apple2, Apple3)

🧰 实例分割的代表:Mask R-CNN

Mask R-CNN 是在 Faster R-CNN 的基础上加了“像素级掩膜预测”的分支。

🧠 Mask R-CNN = Faster R-CNN + Mask head

架构如下:

输入图像 → → CNN backbone 提取特征 → → RPN 生成候选框 → → ROIAlign → 分类 & 回归(原来 Faster R-CNN 的输出) → + 额外的 Mask 分支 → 输出 28×28 的像素掩膜

💡 关键技术:ROIAlign

ROI Pooling 是把框中的区域裁剪为固定大小。但它会导致像素 misalignment(对不齐)。

ROIAlign 使用双线性插值方法保留空间对齐关系,大幅提升 mask 的像素级精度。

✅ 小结表:语义分割 vs 实例分割

| 特征 | 语义分割 | 实例分割 |

|---|---|---|

| 每个像素分类? | ✅ | ✅ |

| 能区分实例? | ❌ 所有人都一样 | ✅ 每个对象单独编号 |

| 适用模型 | FCN, U-Net | Mask R-CNN |

| 应用场景 | 自动驾驶、遥感、医学图 | 智能标注、COCO竞赛 |

🎓 PART 3:训练技巧与优化方法(Training & Regularization)

🎯 为什么要学习训练技巧?

在深度学习中,构建一个模型不是最难的,真正让它训练成功才是挑战!

常见训练中的“坑”包括:

| 问题 | 描述 |

|---|---|

| 过拟合 Overfitting | 在训练集表现很好,测试集效果很差 |

| 梯度爆炸/消失 | 网络太深或参数初始化不当 |

| 收敛慢、震荡大 | 学习率不合适、训练不稳定 |

| 数据不平衡 | 有些类别样本很多,有些很少 |

📌 我们将介绍的核心训练技巧:

| 技术名 | 用处 |

|---|---|

| ✅ 数据增强 | 让数据更多样,减少过拟合 |

| ✅ 正则化(L2) | 限制模型复杂度 |

| ✅ Dropout | 训练时随机“关掉”一部分神经元 |

| ✅ Batch Normalization | 训练更稳定,加快收敛 |

| ✅ Early Stopping | 验证集不再变好时就提前终止训练 |

| ✅ 迁移学习 | 用别人训练好的模型做自己任务 |

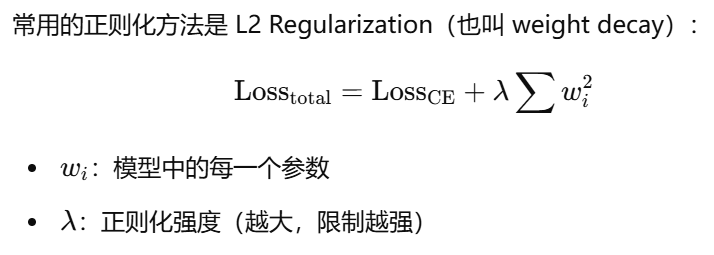

🧪 1️⃣ 正则化(Regularization)

📌 什么是正则化?

就是在损失函数中“惩罚”太复杂的模型,避免模型过拟合训练集。

🎯 目标:

-

想让模型在新数据上也表现好(泛化能力强)

-

而不是只会“记住”训练数据

✍️ 数学上怎么做?

💡 简单理解:

你给模型加了个“规则”:参数别乱搞太大,除非你真的很需要这么大。

🎛️ 2️⃣ Dropout(随机失活)

在训练过程中,随机让部分神经元“暂时消失”。

为什么这么做?

-

强迫模型不能依赖某个特定神经元

-

等于模拟多个不同的子网络 → 提高泛化能力

🧠 举例:

假设某一层有 100 个神经元,设置 Dropout rate = 0.5

-

每次前向传播,随机“屏蔽”掉 50 个神经元

在测试时:

-

不 Dropout,而是保留全部神经元,但乘以 0.5(期望值保持一致)

✅ 效果:

-

减少 co-adaptation(神经元之间互相依赖)

-

显著减轻过拟合

🧪 3️⃣ Batch Normalization(BN)

在每一层之后对输出进行标准化(均值为 0,方差为 1)

✨ 为什么 BN 有用?

-

深层网络中,分布会不断变动(叫 Internal Covariate Shift)

-

BN 让每一层的输入“保持稳定”,训练更快更稳

🎯 效果:

-

网络可以用更大学习率

-

收敛更快

-

训练更不容易陷入震荡

⏱️ 4️⃣ Early Stopping(早停)

如果验证集准确率不再提升,就提前停止训练

📌 为什么?

-

一般训练久了后,模型会开始过拟合

-

我们使用验证集判断模型什么时候“学得刚刚好”

怎么实现?

-

每训练一个 epoch,监控 validation loss

-

如果连续 N 次验证都没有变好,就停!

✅ 常见参数:

EarlyStopping(monitor='val_loss', patience=5)

📸 5️⃣ 数据增强(Data Augmentation)

用各种“微小变换”生成更多样的训练数据

🤸♀️ 举例:

| 方法 | 作用 |

|---|---|

| 翻转 | 让模型识别左右翻的图像 |

| 随机裁剪 | 学会注意局部信息 |

| 加噪声 | 增强鲁棒性 |

| 颜色扰动 | 提高模型对亮度/饱和度容忍 |

| Cutout/Mixup | 深度增强方法 |

📈 数据增强效果:

-

让模型看到“更多样的情况”

-

减少模型对背景、位置、颜色的依赖

-

显著提高模型在测试集的性能

🔄 6️⃣ 迁移学习(Transfer Learning)

利用别人已经训练好的模型来解决你的问题

💡 举例:

-

用别人训练好的 ResNet50(在 ImageNet 上)来做猫狗分类

-

你可以:

-

冻结原始网络参数,只训练最后几层(特征提取)

-

或 整体微调,重新训练所有层(fine-tune)

-

✅ 优点:

-

训练更快(因为预训练模型已经学了“通用特征”)

-

减少对大量标注数据的依赖

-

特别适合小样本任务!

🧠 总结:常见训练技巧一览表

| 技术 | 作用 | 是否减轻过拟合 |

|---|---|---|

| L2 正则化 | 限制权重增长 | ✅ |

| Dropout | 模拟多个子网络 | ✅ |

| Batch Norm | 稳定训练,提高效率 | ❌(但有辅助效果) |

| Early Stopping | 只训练到最优点 | ✅ |

| Data Augmentation | 提高泛化能力 | ✅ |

| Transfer Learning | 加速训练,提高性能 | ✅(尤其小数据) |

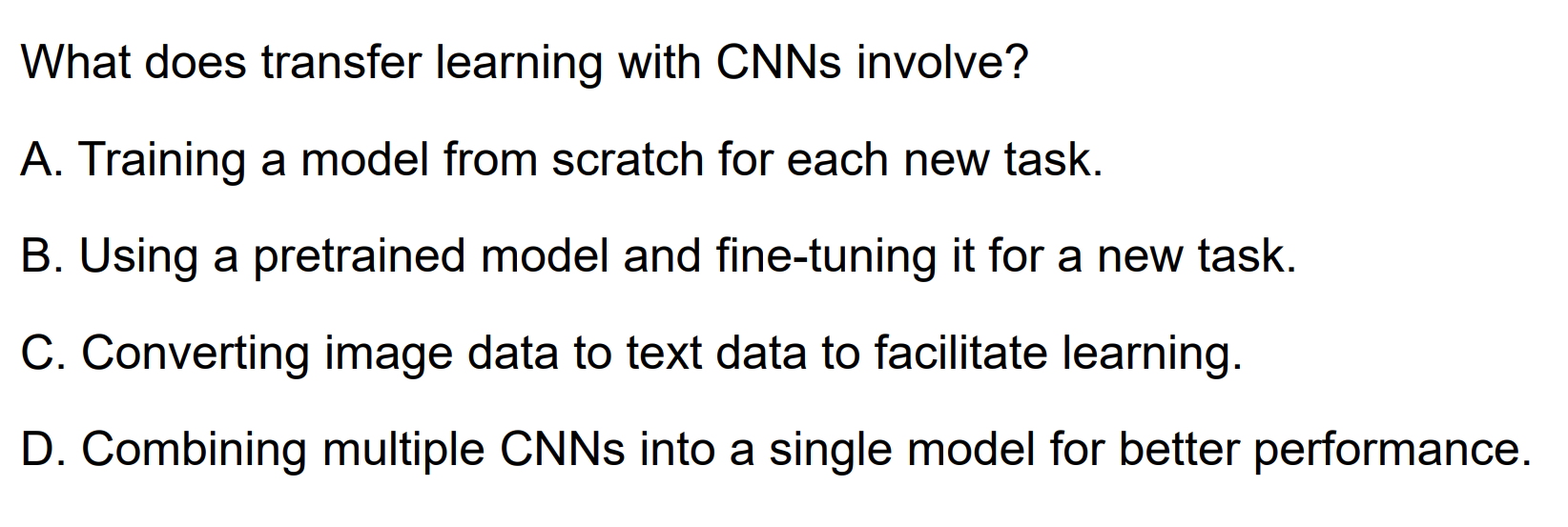

4.例题

🧠 通俗+专业解释如下:

✅ 什么是 Transfer Learning?

迁移学习(Transfer Learning) 是指:我们不从头开始训练模型,而是使用别人已经训练好的模型来解决我们的新任务。

💡 举个现实例子:

比如你要训练一个识别“古代陶瓷”的模型,但你没有几千张图,也没有 GPU 跑几天:

你可以下载一个别人训练好的模型(如 ResNet50)

然后用它来“提取图像特征”

最后只在最后一两层训练自己的分类任务

这就叫 迁移学习

✅ 为什么要这样做?

训练 CNN 非常耗资源(数据 + 时间 + 算力)

很多低层卷积层学到的特征是“通用”的(比如边缘、角、纹理)

复用别人的模型能:

节省时间

提升小样本任务效果

加快收敛速度

📌 回到选项分析:

选项 内容 正确与否 理由 A 从零开始训练每个新任务 ❌ 正好是迁移学习的反面 B 使用预训练模型 + 微调 ✅ ✅ 完整迁移学习流程 C 把图像转文字再学 ❌ 不相关,混淆概念 D 合并多个 CNN 提升性能 ❌ 那叫集成学习,不是迁移学习

![[react]Next.js之自适应布局和高清屏幕适配解决方案](https://i-blog.csdnimg.cn/direct/4494b56f3c2b419681cb1cdf6d04361d.png)