BIFPN是一种比较经典有效的特征融合手段,在很多检测模型中都有集成应用,实际表现也验证了BIFPN的有效性,这里并不是要探讨BIFPN的原理内容,而是想集成这项技术,提升原有模型的性能表现,在我之前的一些文章中也有使用到BIFPN这项技术,感兴趣的话可以自行移步阅读。

《基于yolov5s+bifpn实践隧道裂缝裂痕检测》

《基于融合SPD+BIFPN+CBAM改进YOLOv5的奶牛检测识别分析系统开发》

《激情绿茵,助力2022卡塔尔世界杯——基于改进的YOLO模型玩转足球检测分析系统》

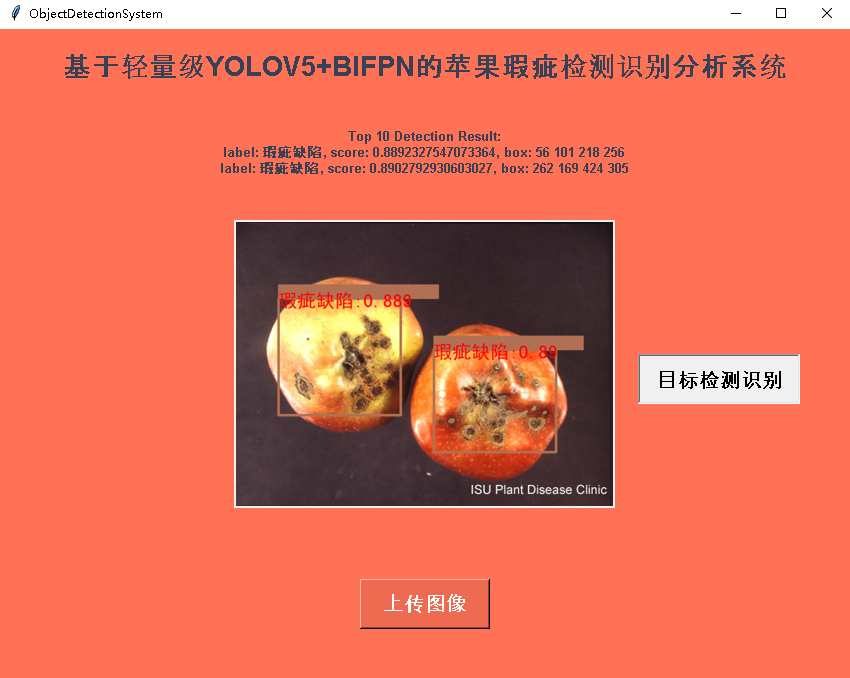

本文主要是基于苹果缺陷瑕疵的数据集来构建yolov5+bifpn模型完成瑕疵缺陷的检测模型的开发,首先看下效果图:

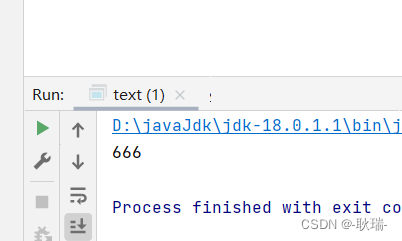

接下来看下对应的模型yaml文件,如下:

#Parameters

nc: 1 # number of classes

depth_multiple: 1.0 # model depth multiple

width_multiple: 1.0 # layer channel multiple

anchors:

- [10,13, 16,30, 33,23] # P3/8

- [30,61, 62,45, 59,119] # P4/16

- [116,90, 156,198, 373,326] # P5/32

#Backbone

backbone:

# [from, number, module, args]

[[-1, 1, Conv, [64, 6, 2, 2]], # 0-P1/2

[-1, 1, Conv, [128, 3, 2]], # 1-P2/4

[-1, 3, C3, [128]],

[-1, 1, Conv, [256, 3, 2]], # 3-P3/8

[-1, 6, C3, [256]],

[-1, 1, Conv, [512, 3, 2]], # 5-P4/16

[-1, 9, C3, [512]],

[-1, 1, Conv, [1024, 3, 2]], # 7-P5/32

[-1, 3, C3, [1024]],

[-1, 1, SPPF, [1024, 5]], # 9

]

#Head

head:

[[-1, 1, Conv, [512, 1, 1]],

[-1, 1, nn.Upsample, [None, 2, 'nearest']],

[[-1, 6], 1, Concat, [1]], # cat backbone P4

[-1, 3, C3, [512, False]], # 13

[-1, 1, Conv, [256, 1, 1]],

[-1, 1, nn.Upsample, [None, 2, 'nearest']],

[[-1, 4], 1, Concat, [1]], # cat backbone P3

[-1, 3, C3, [256, False]], # 17 (P3/8-small)

[-1, 1, Conv, [256, 3, 2]],

[[-1, 14, 6], 1, Concat, [1]], # cat P4

[-1, 3, C3, [512, False]], # 20 (P4/16-medium)

[-1, 1, Conv, [512, 3, 2]],

[[-1, 10], 1, Concat, [1]], # cat head P5

[-1, 3, C3, [1024, False]], # 23 (P5/32-large)

[[17, 20, 23], 1, Detect, [nc, anchors]], # Detect(P3, P4, P5)

]

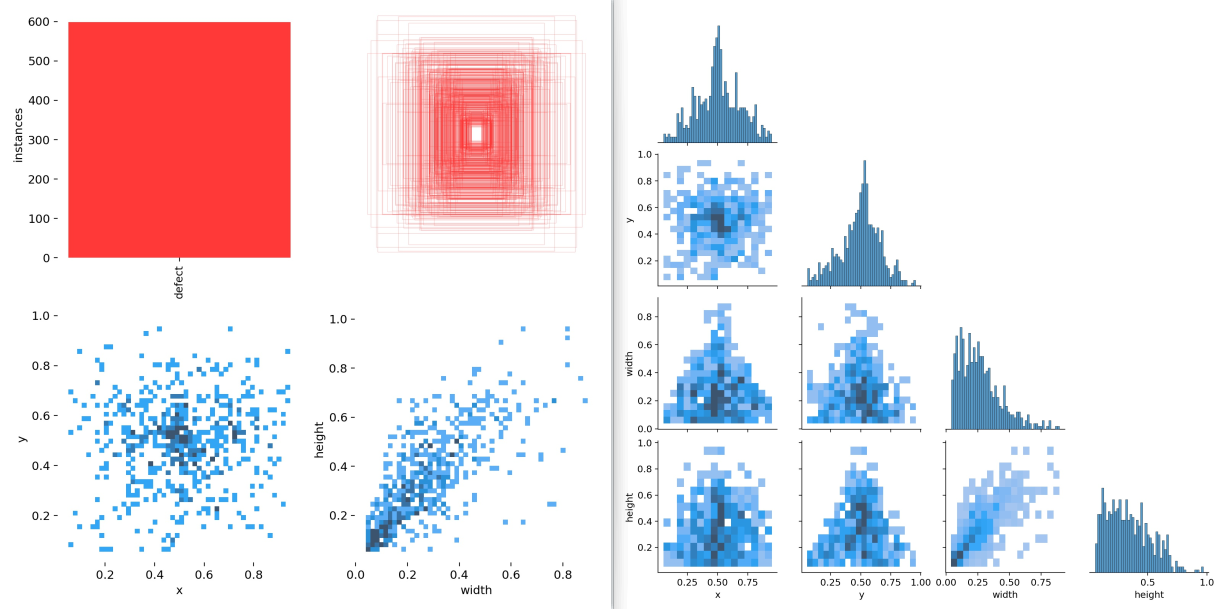

接下来看下使用的数据集:

大部分来自于网络源数据采集获取,这里不管任何形式的虫害、皲裂、腐败等都归类为缺陷瑕疵,所以这里待检测的目标对象就只有一类了。

YOLO格式标注数据如下所示:

实例标注内容如下:

0 0.590734 0.474227 0.200772 0.319588

0 0.374317 0.630909 0.431694 0.243636

0 0.659449 0.394472 0.389764 0.396985VOC格式标注数据如下:

实例标注内容如下:

<annotation>

<folder>images</folder>

<filename>0bb23687-1599-4069-a024-68e2ff0b32d2</filename>

<path>0bb23687-1599-4069-a024-68e2ff0b32d2</path>

<source>

<database>Unknown</database>

</source>

<size>

<width>225</width>

<height>225</height>

<depth>3</depth>

</size>

<segmented>0</segmented>

<object>

<name>defect</name>

<pose>Unspecified</pose>

<truncated>0</truncated>

<difficult>0</difficult>

<bndbox>

<xmin>16</xmin>

<ymin>46</ymin>

<xmax>78</xmax>

<ymax>114</ymax>

</bndbox>

</object>

<object>

<name>defect</name>

<pose>Unspecified</pose>

<truncated>0</truncated>

<difficult>0</difficult>

<bndbox>

<xmin>72</xmin>

<ymin>117</ymin>

<xmax>135</xmax>

<ymax>200</ymax>

</bndbox>

</object>

<object>

<name>defect</name>

<pose>Unspecified</pose>

<truncated>0</truncated>

<difficult>0</difficult>

<bndbox>

<xmin>130</xmin>

<ymin>76</ymin>

<xmax>215</xmax>

<ymax>147</ymax>

</bndbox>

</object>

<object>

<name>defect</name>

<pose>Unspecified</pose>

<truncated>0</truncated>

<difficult>0</difficult>

<bndbox>

<xmin>84</xmin>

<ymin>35</ymin>

<xmax>144</xmax>

<ymax>87</ymax>

</bndbox>

</object>

</annotation>

因为数据量不大,这里在GPU模式下面完成训练花费的时长很短,训练完成结果文件如下:

LABEL数据可视化如下所示:

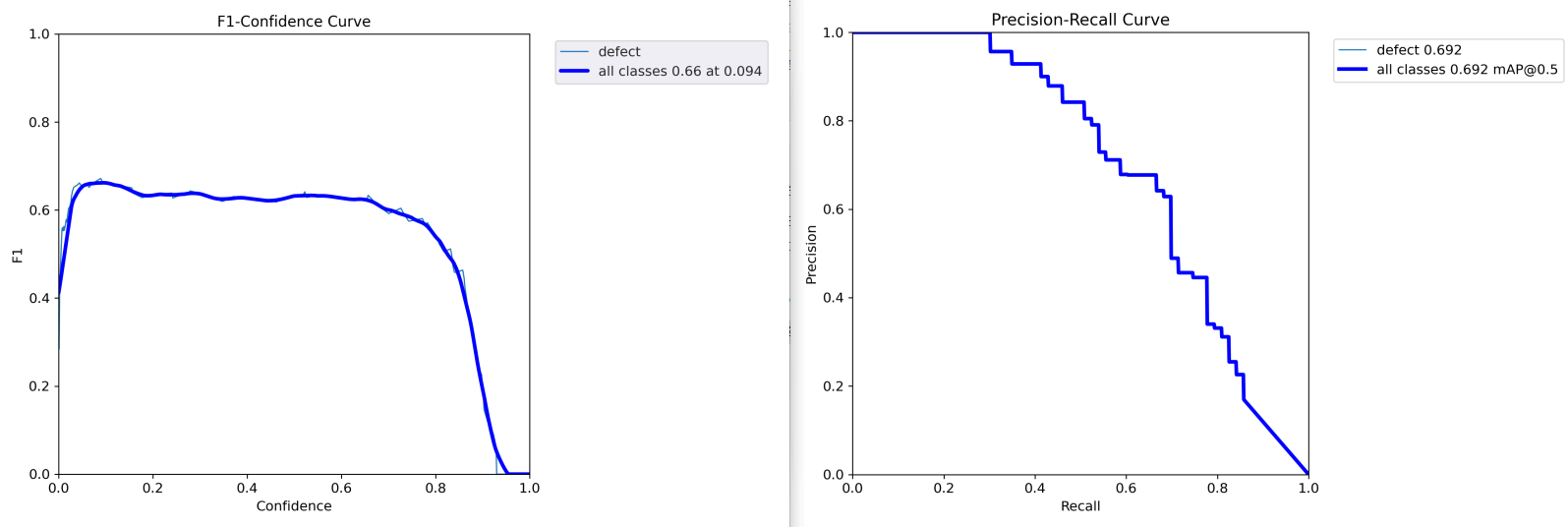

F1值曲线和PR曲线如下所示:

混淆矩阵如下:

训练batch检测实例如下:

最后基于专用的界面完成可视化推理,如下所示:

上传图像:

检测推理:

](https://img-blog.csdnimg.cn/8b67be67d0914fe1975858410531041e.png)