文章目录

- STGM: Spatio-Temporal Graph Mixformer for Traffic Forecasting

- Attention Is Not All You Need Anymore

- LEARNING IMAGE DERAINING TRANSFORMER NETWORK WITH DYNAMIC DUAL SELF-ATTENTION

- SST: A Simplified Swin Transformer-based Model for Taxi Destination Prediction based on Existing Trajectory

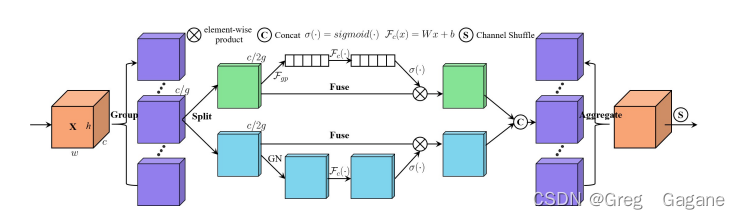

STGM: Spatio-Temporal Graph Mixformer for Traffic Forecasting

提出了一种时空图混合器(STGM)网络,这是一种具有低内存占用的高度优化模型。我们通过利用一种新颖的注意力机制来捕获时间和空间依赖性之间的相关性来解决上述限制。具体来说,我们使用每个头具有可变视场的卷积层来捕获长短期时间依赖性。此外,我们还训练了一个估计器模型,该模型表示节点对所需预测的贡献。估计值与距离矩阵一起反馈给注意力机制。同时,我们使用门控机制和混合器层来进一步选择和合并不同的视角。

代码地址

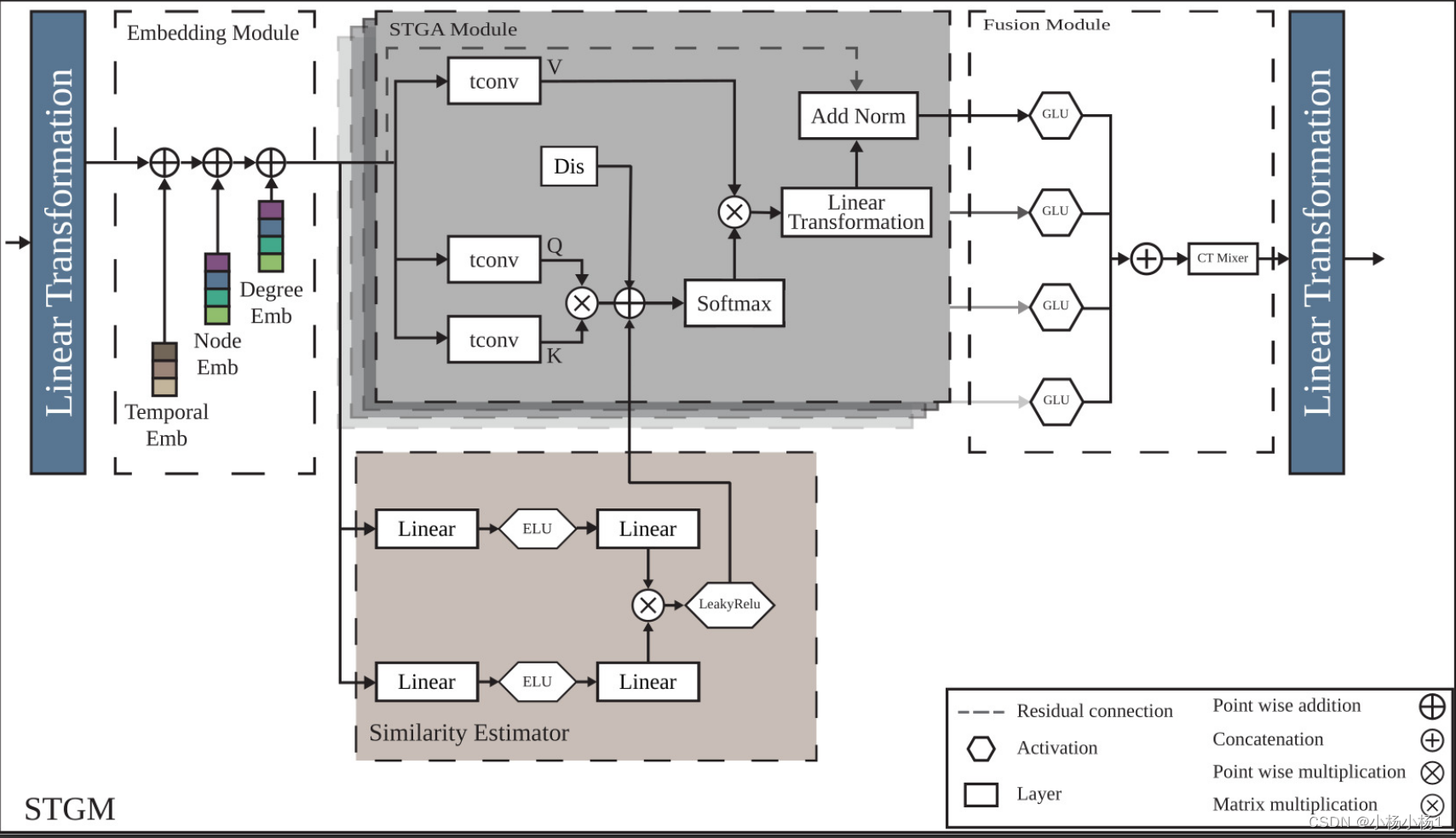

Attention Is Not All You Need Anymore

采用一个Extractor替换注意力

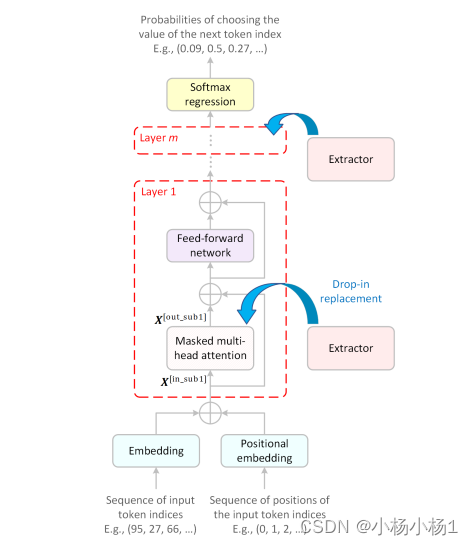

LEARNING IMAGE DERAINING TRANSFORMER NETWORK WITH DYNAMIC DUAL SELF-ATTENTION

第一个模块就是一个是完整的,一个是稀疏的,将两个融合在一起

第二个模块属于多规模的这种特征提取

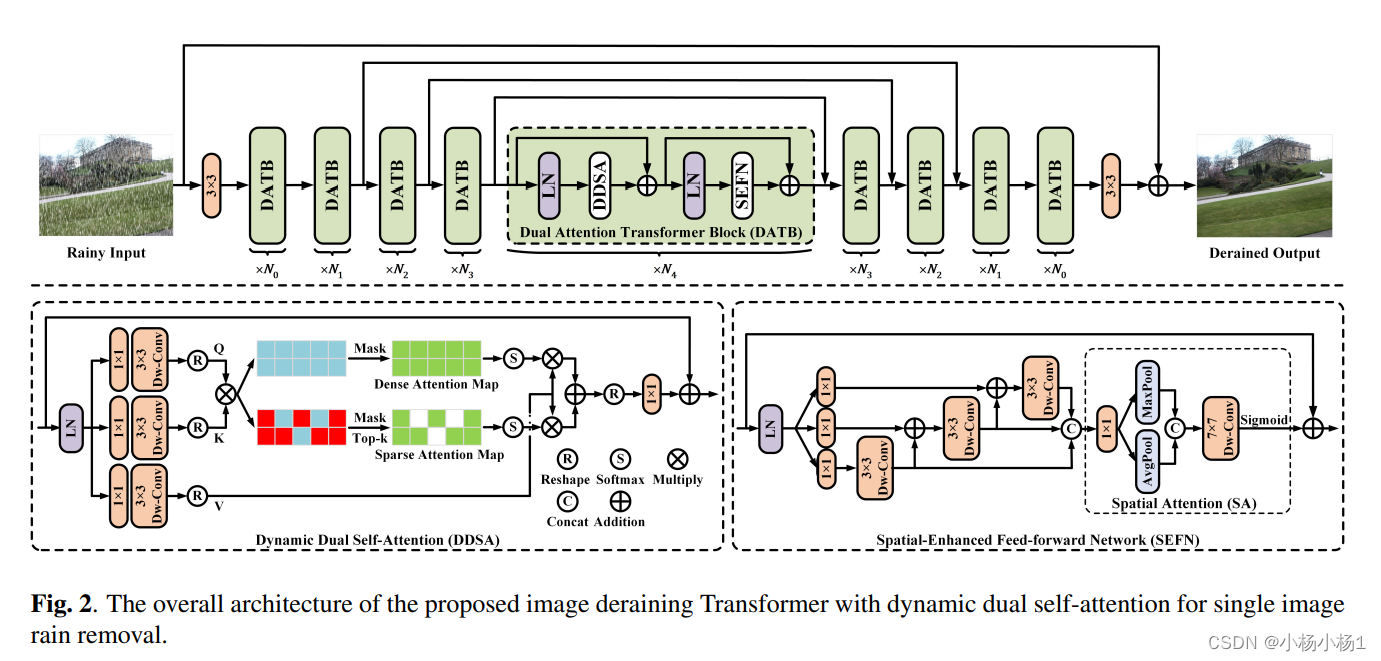

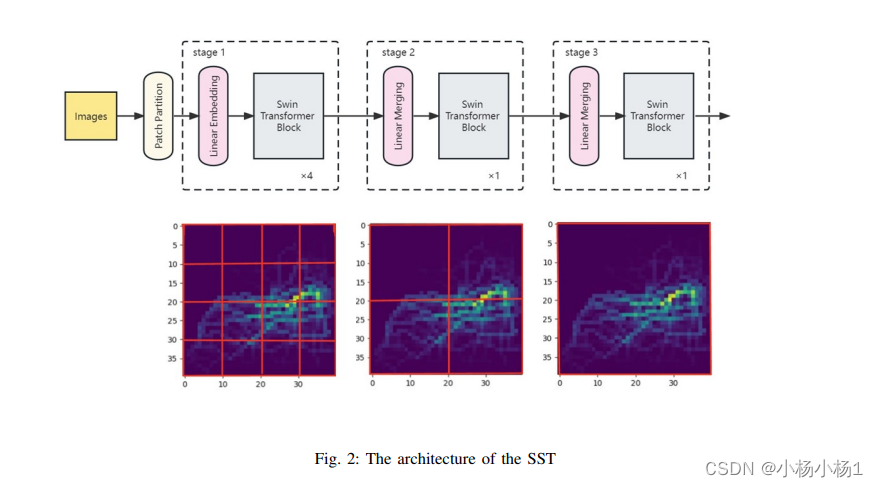

SST: A Simplified Swin Transformer-based Model for Taxi Destination Prediction based on Existing Trajectory

这篇文章没有用swin transformer的滑动窗口,而是用了从小到大的patch