MobileNet

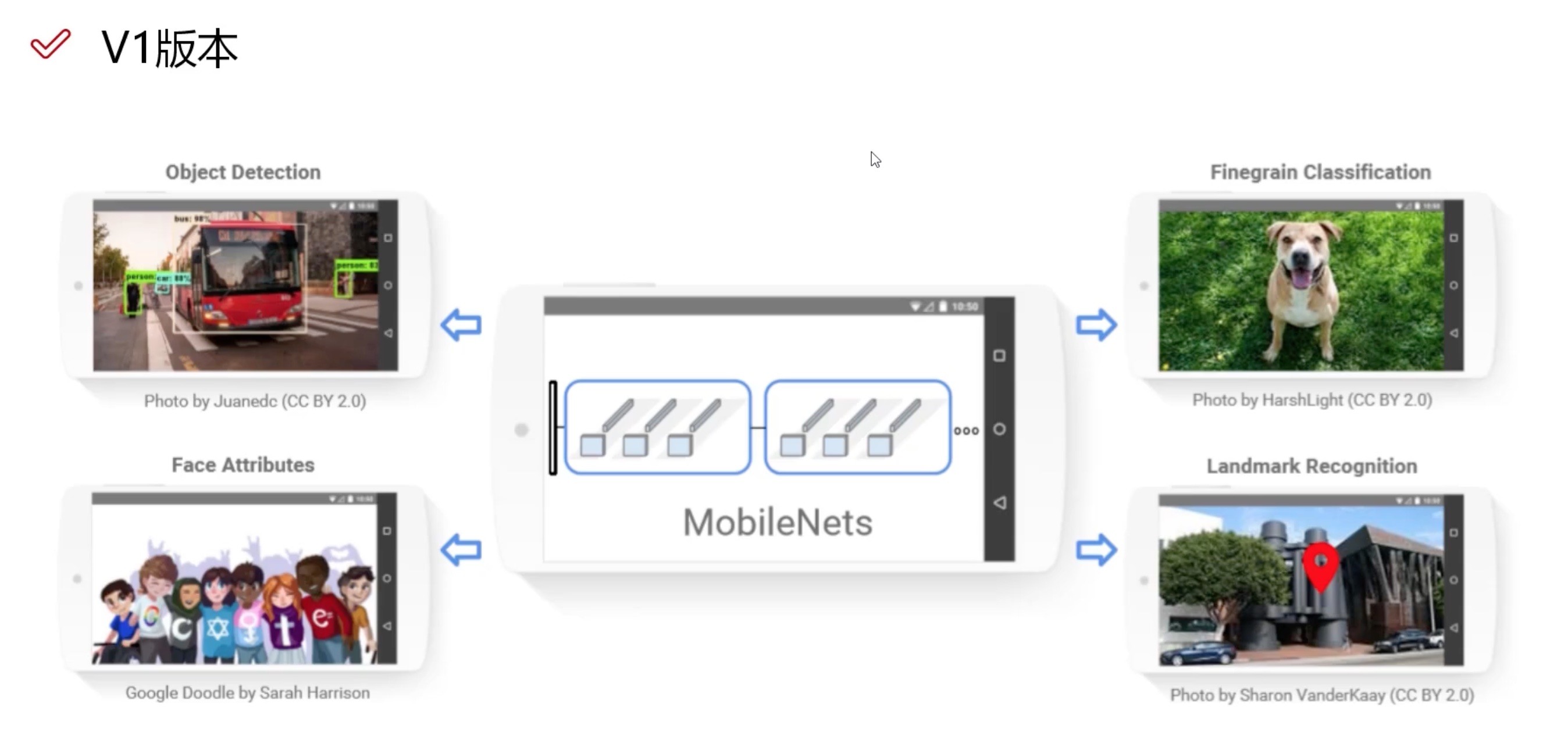

良好的移植性

可以很好的使用在移动设备上做分类、检测、分割等任务

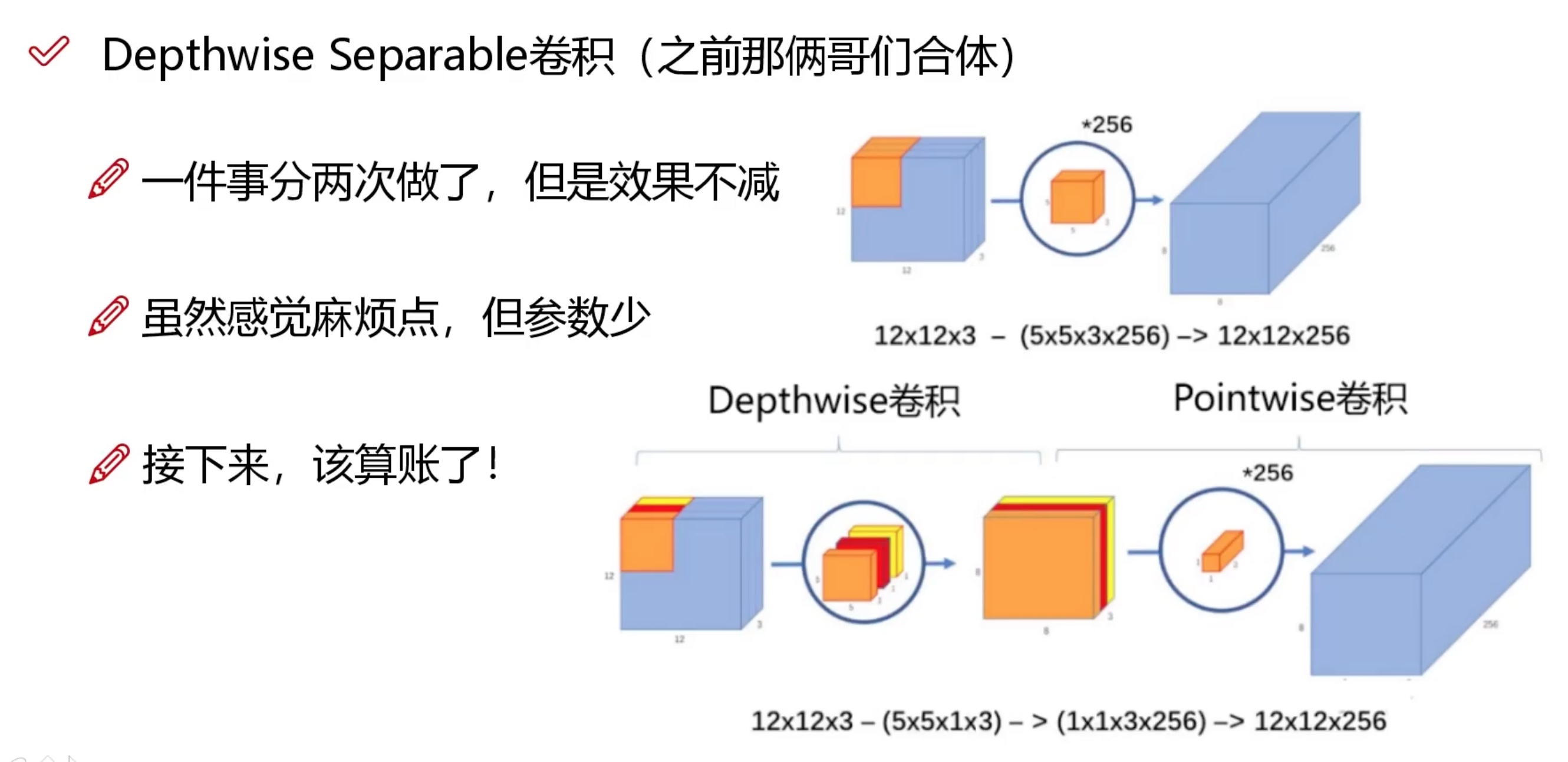

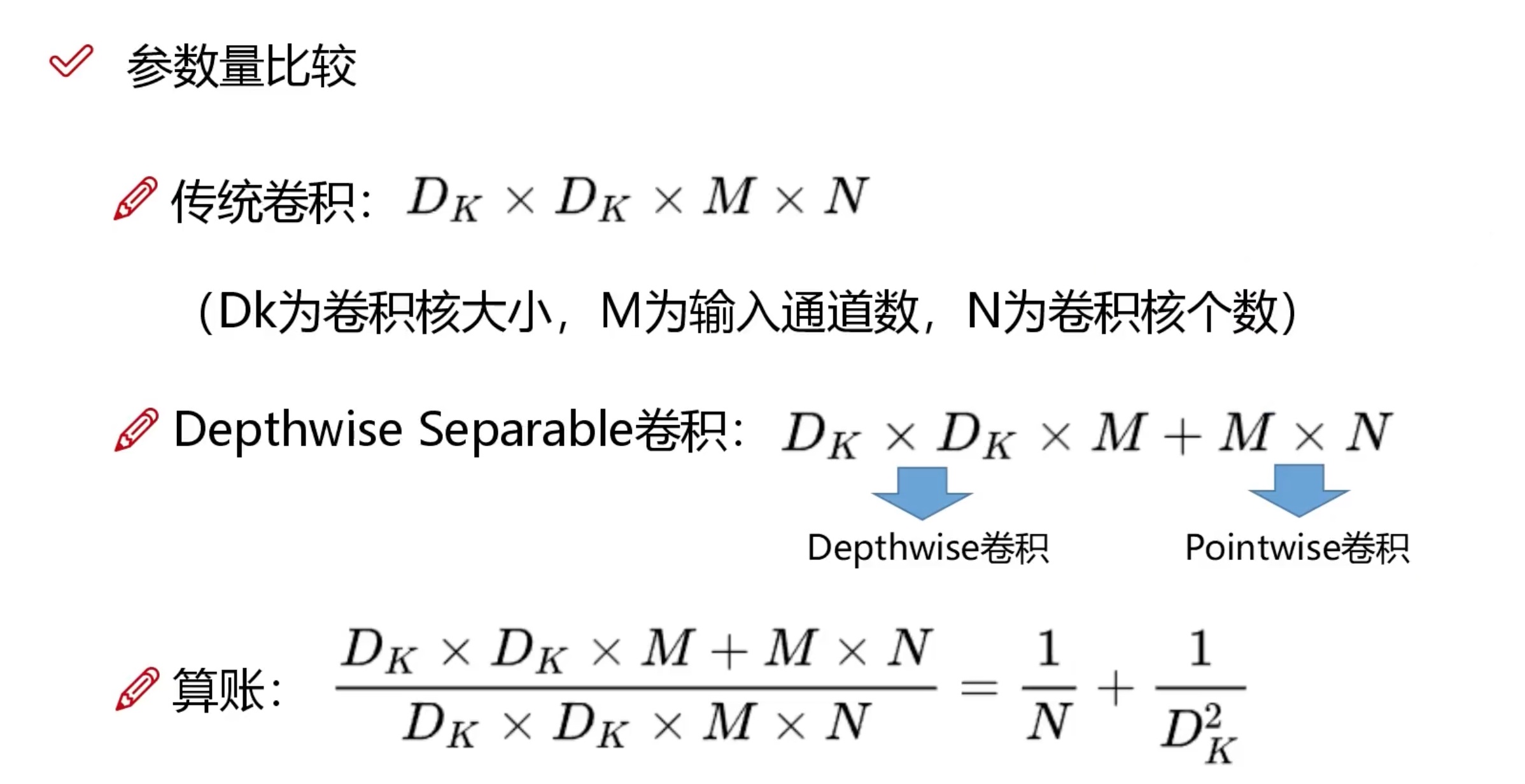

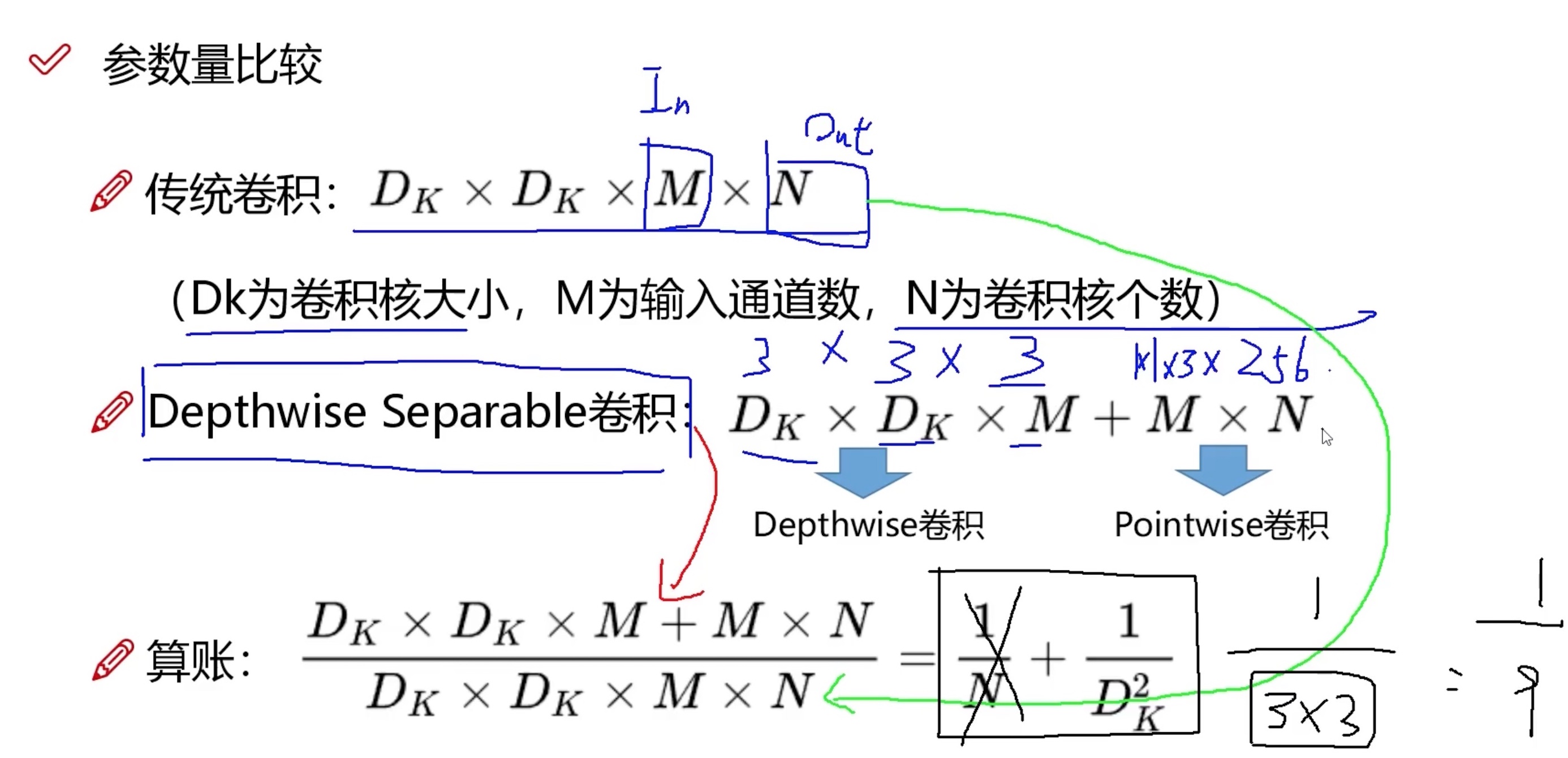

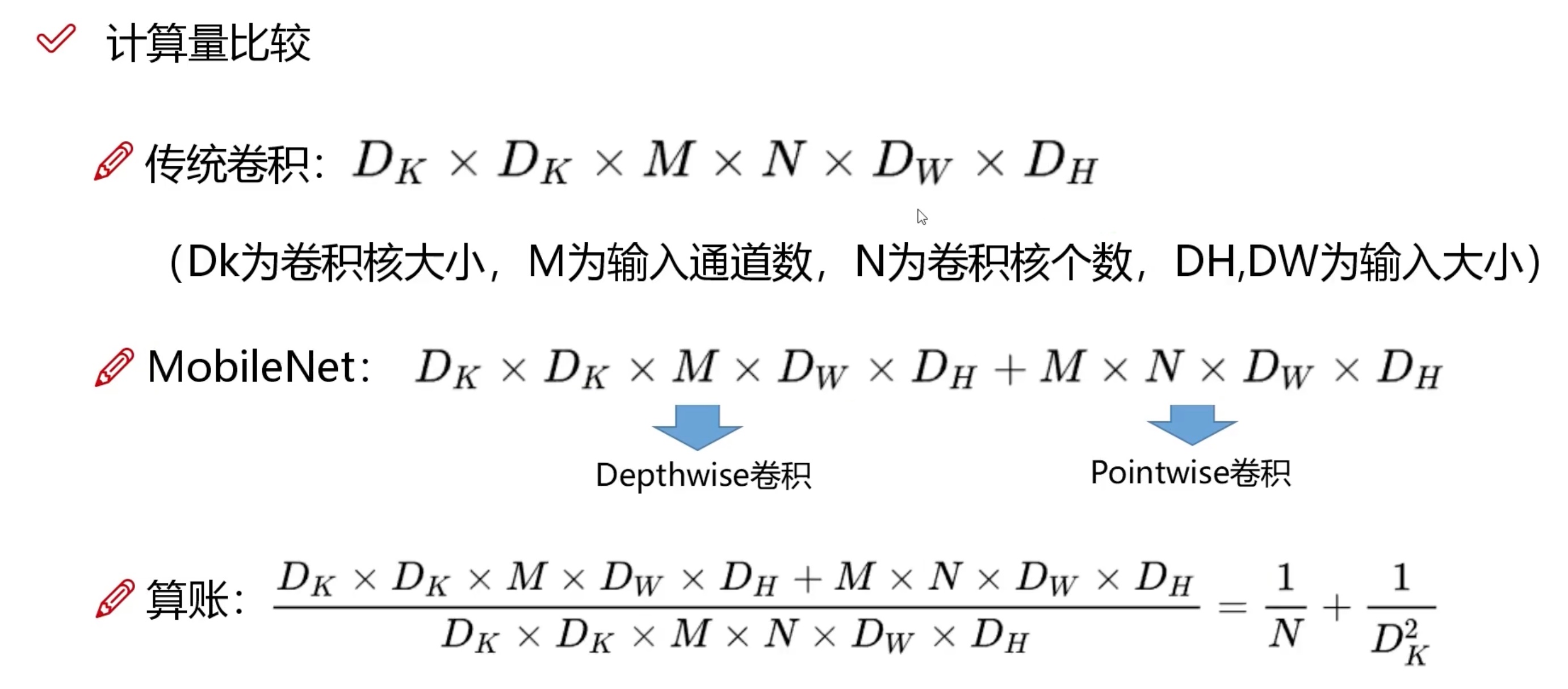

深度可分离卷积(v1核心)

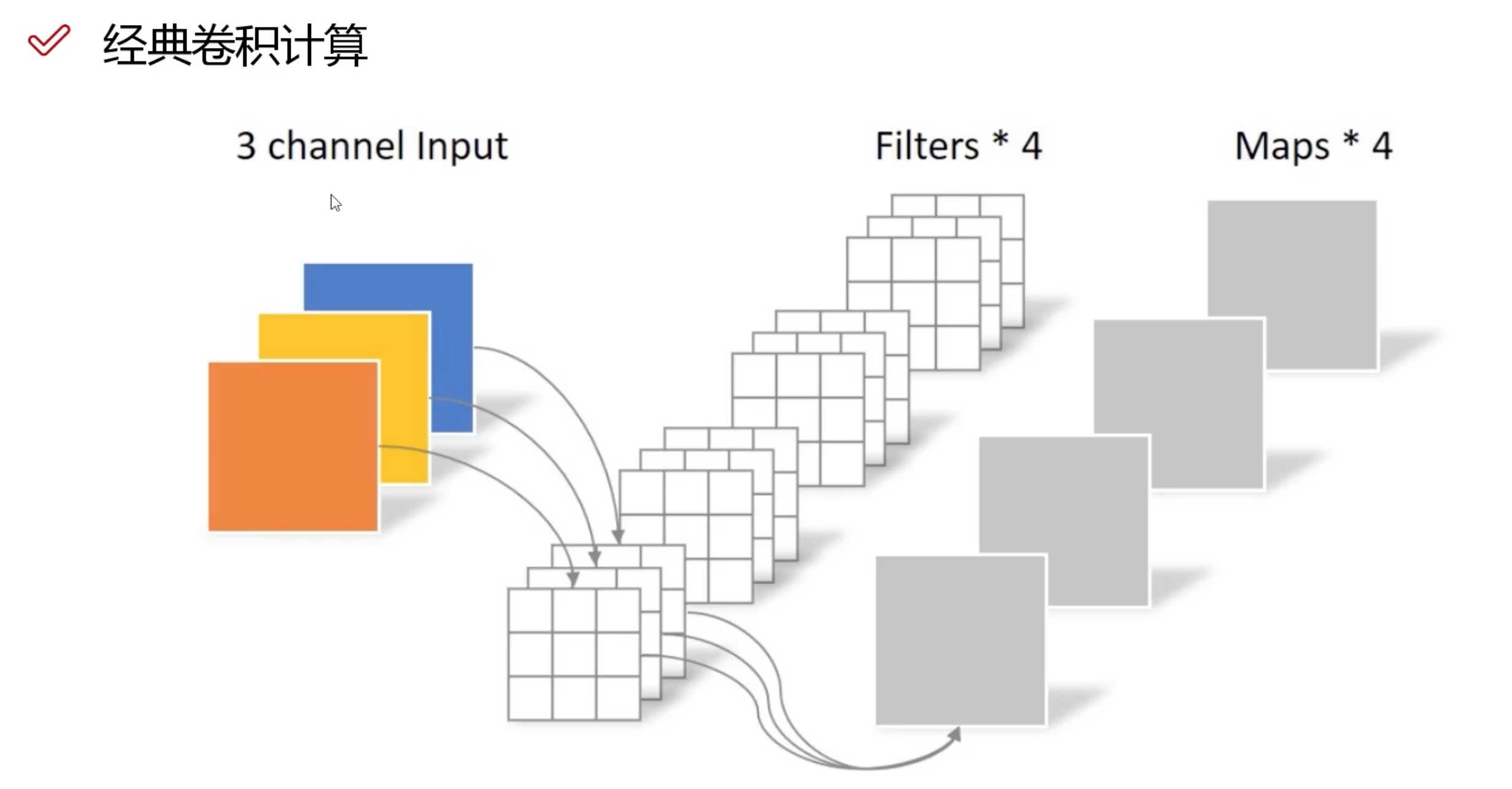

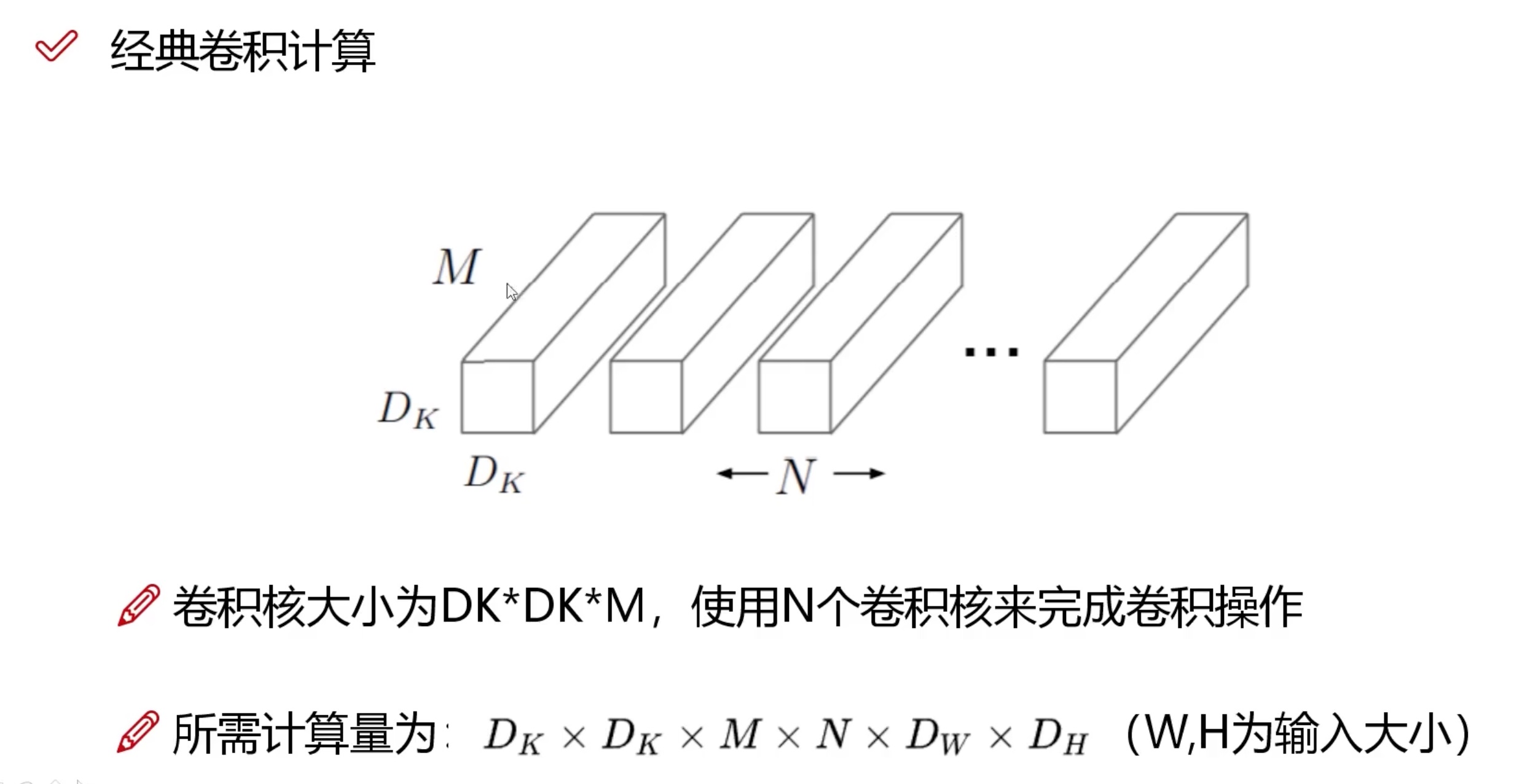

经典卷积算法中,输入的通道数要和过滤器的保持一致,这样很耗费参数

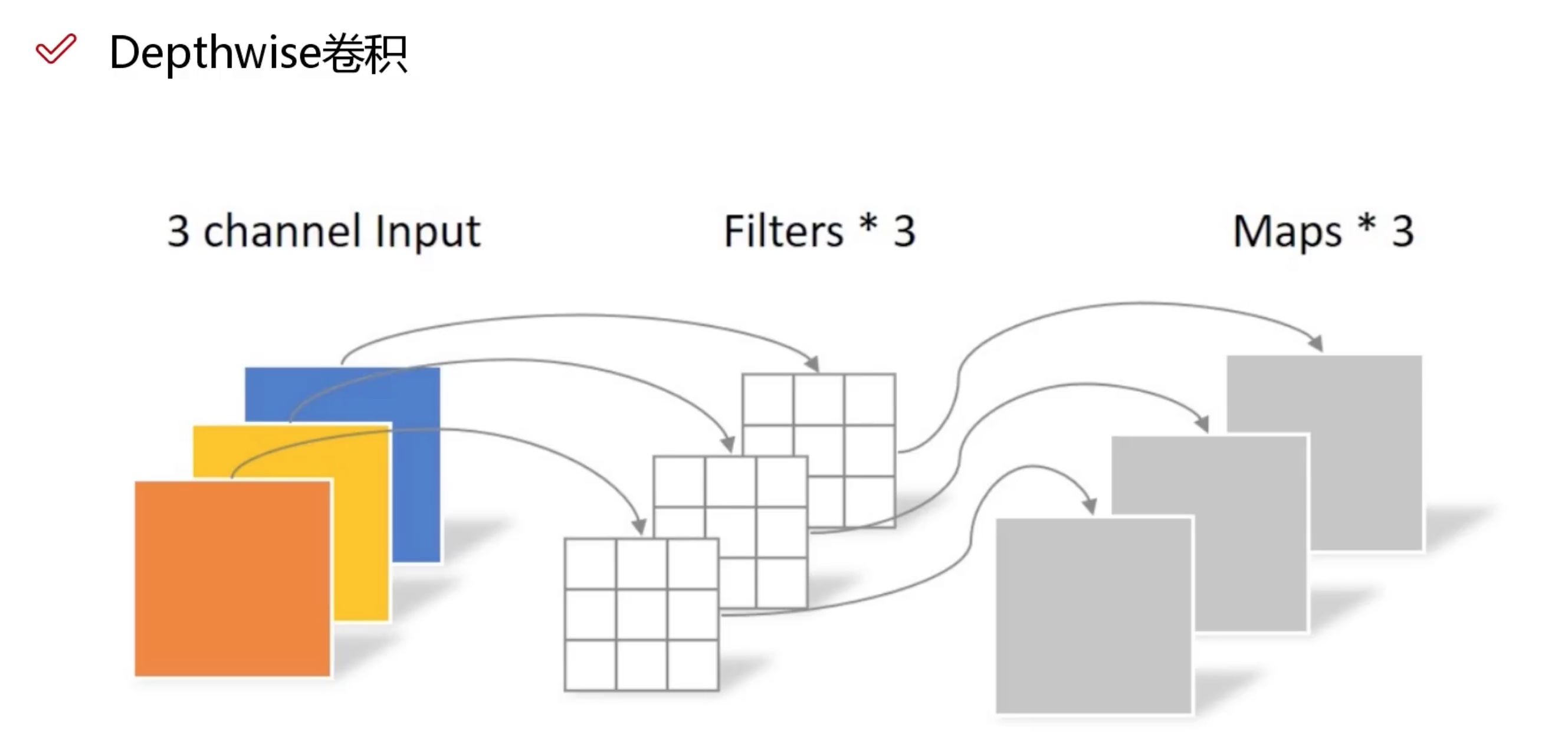

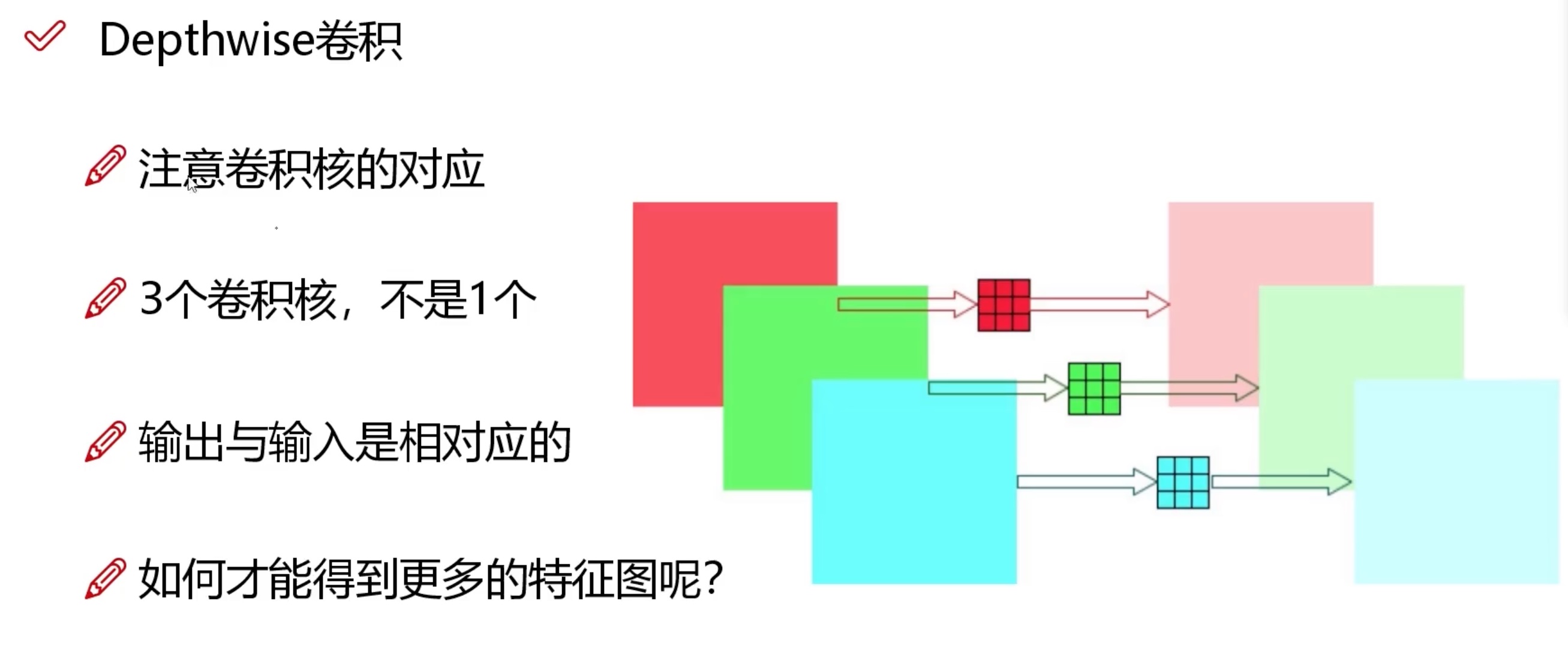

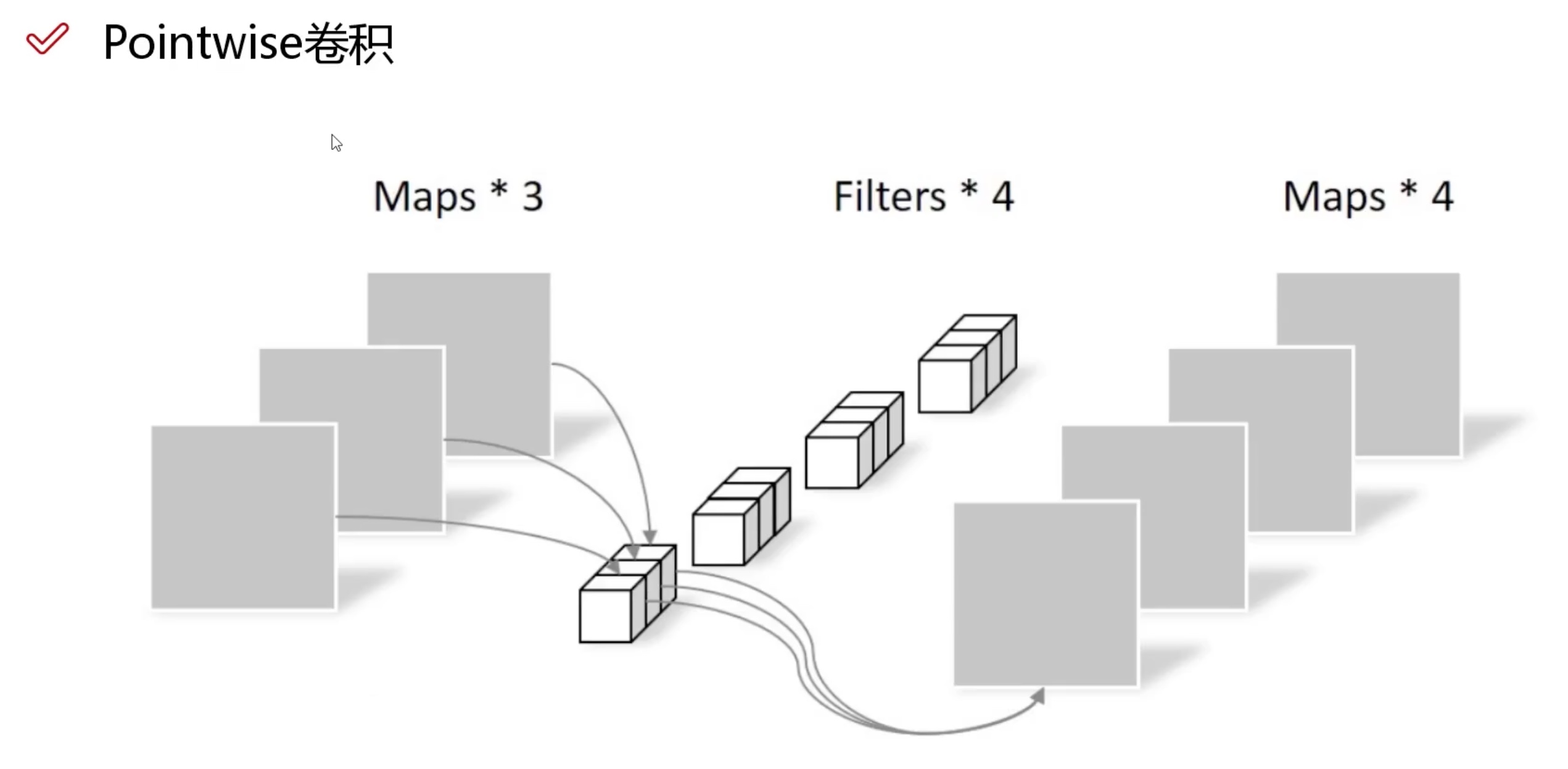

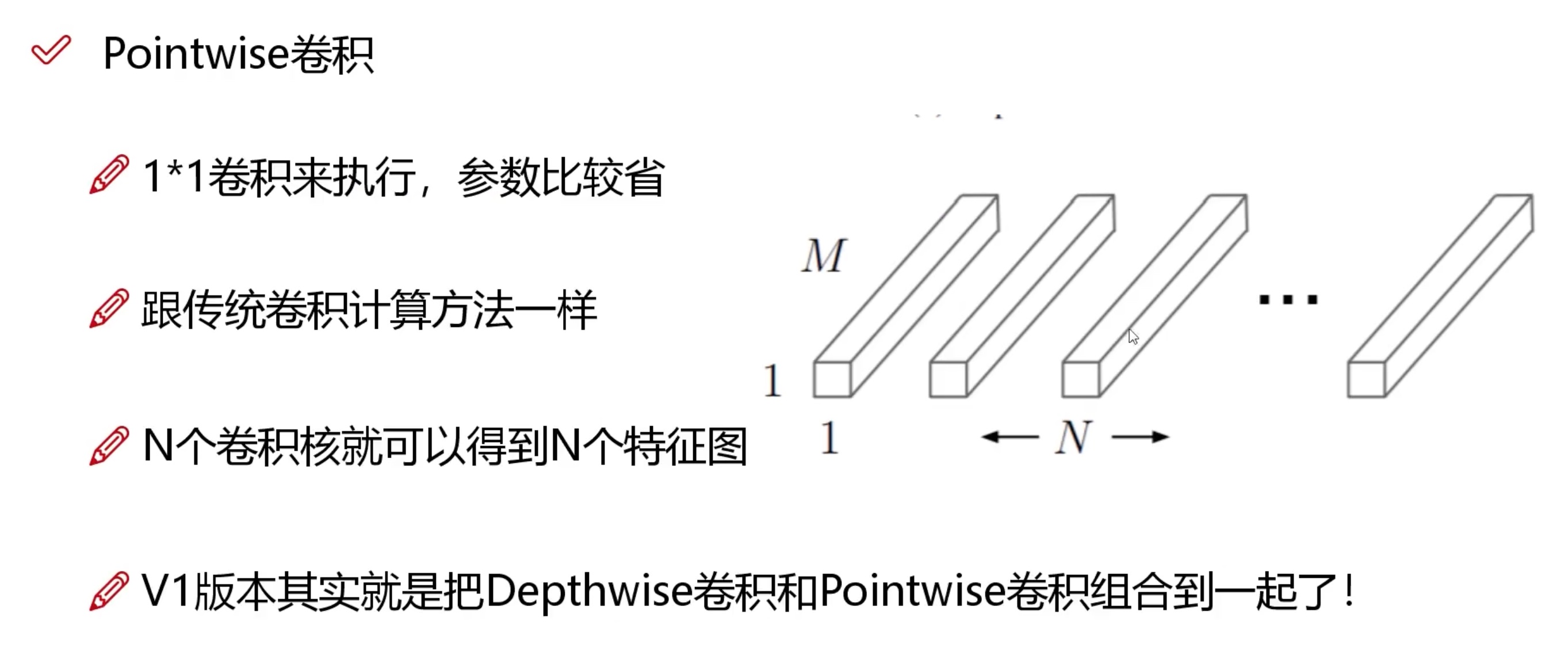

深度可分离卷积

第一步:有多少个输入,就有多少个输出,这一步用来提取特征,然后使用1x1的过滤器增加通道数

第二步:在这一步进行1x1卷积,相当于分成两步提取特征

总结

虽然麻烦了,但是可以减少参数量和计算量,均可以减少到卷积核平方分之一

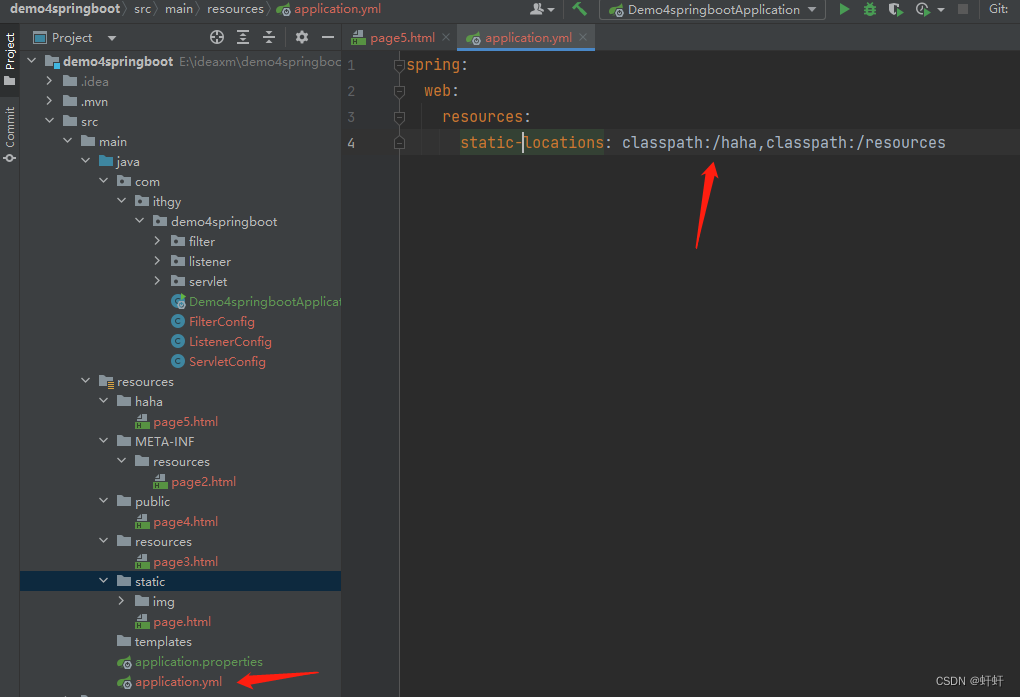

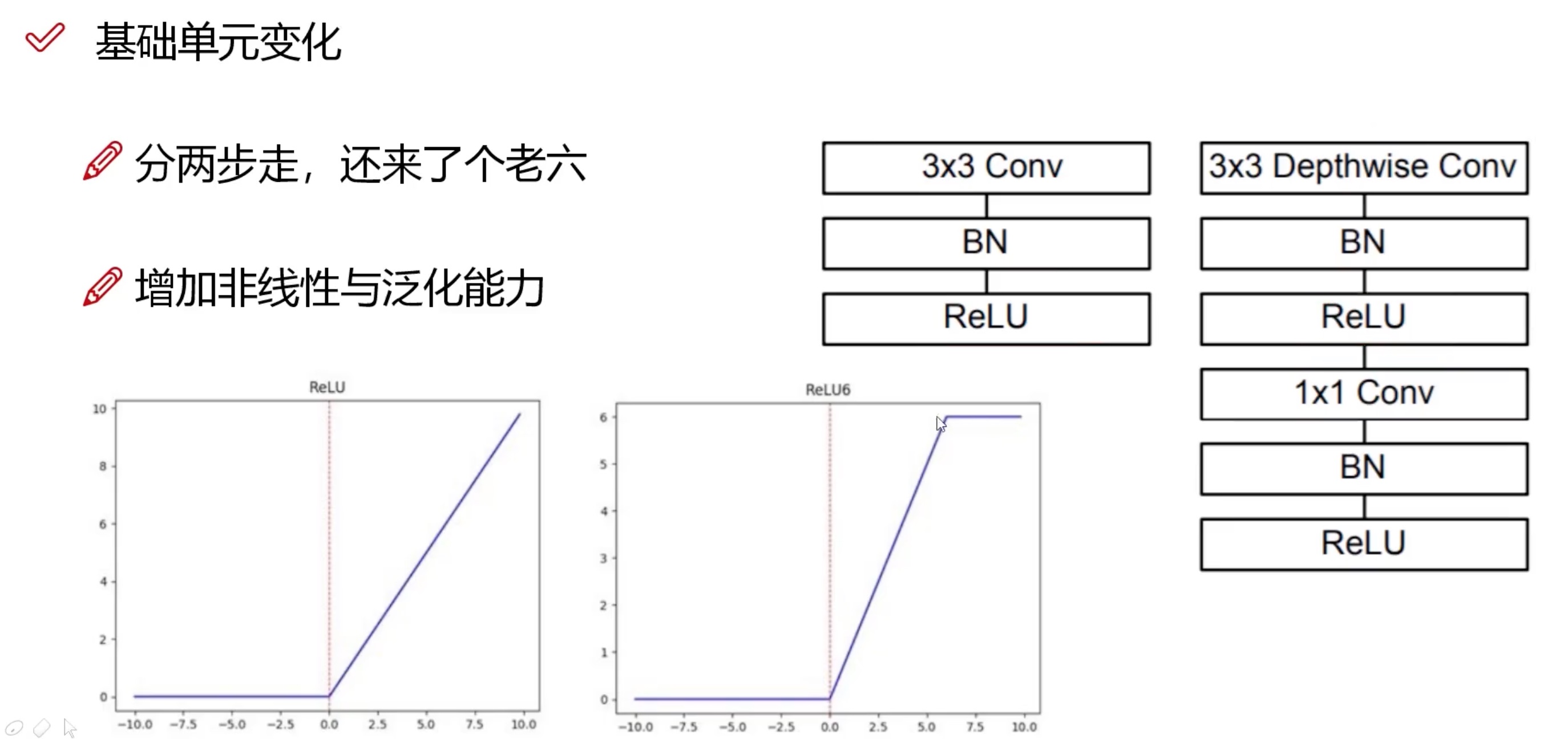

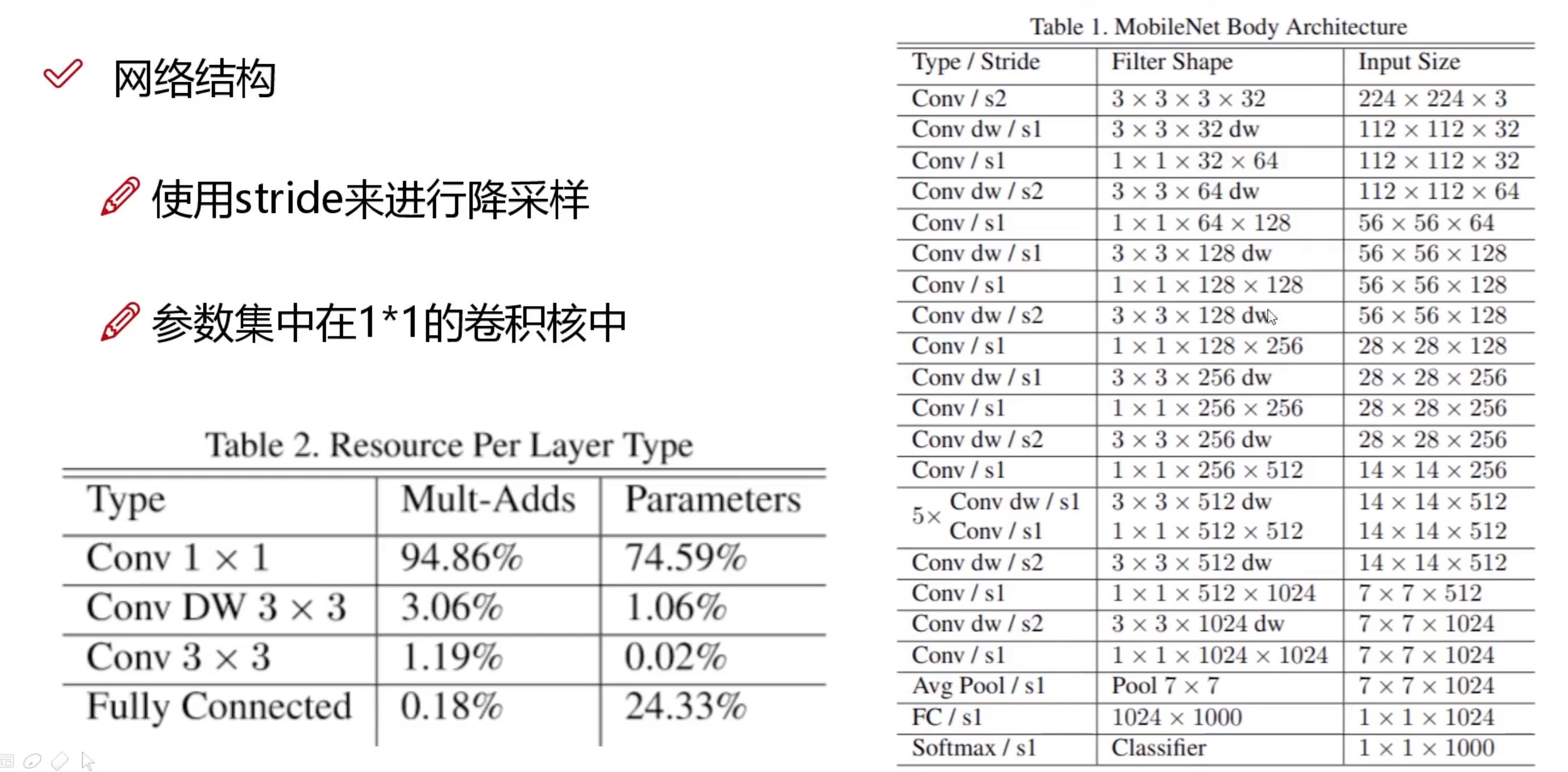

V1整体网络架构

因为考虑到应用在移动端,模型会量化到int8,所以relu6可以加快模型收敛,增加泛化能力

28层,也可以自己diy模型

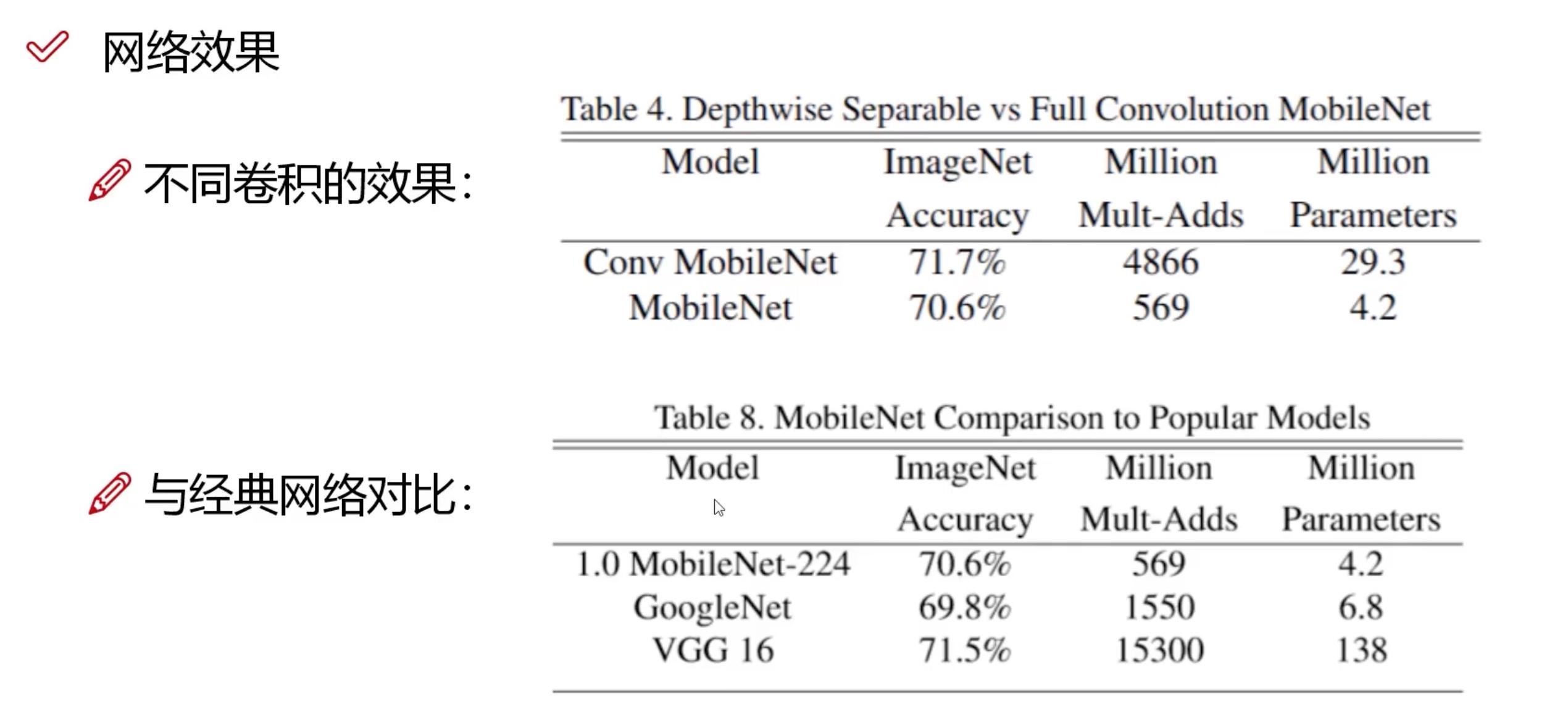

网络模型对比

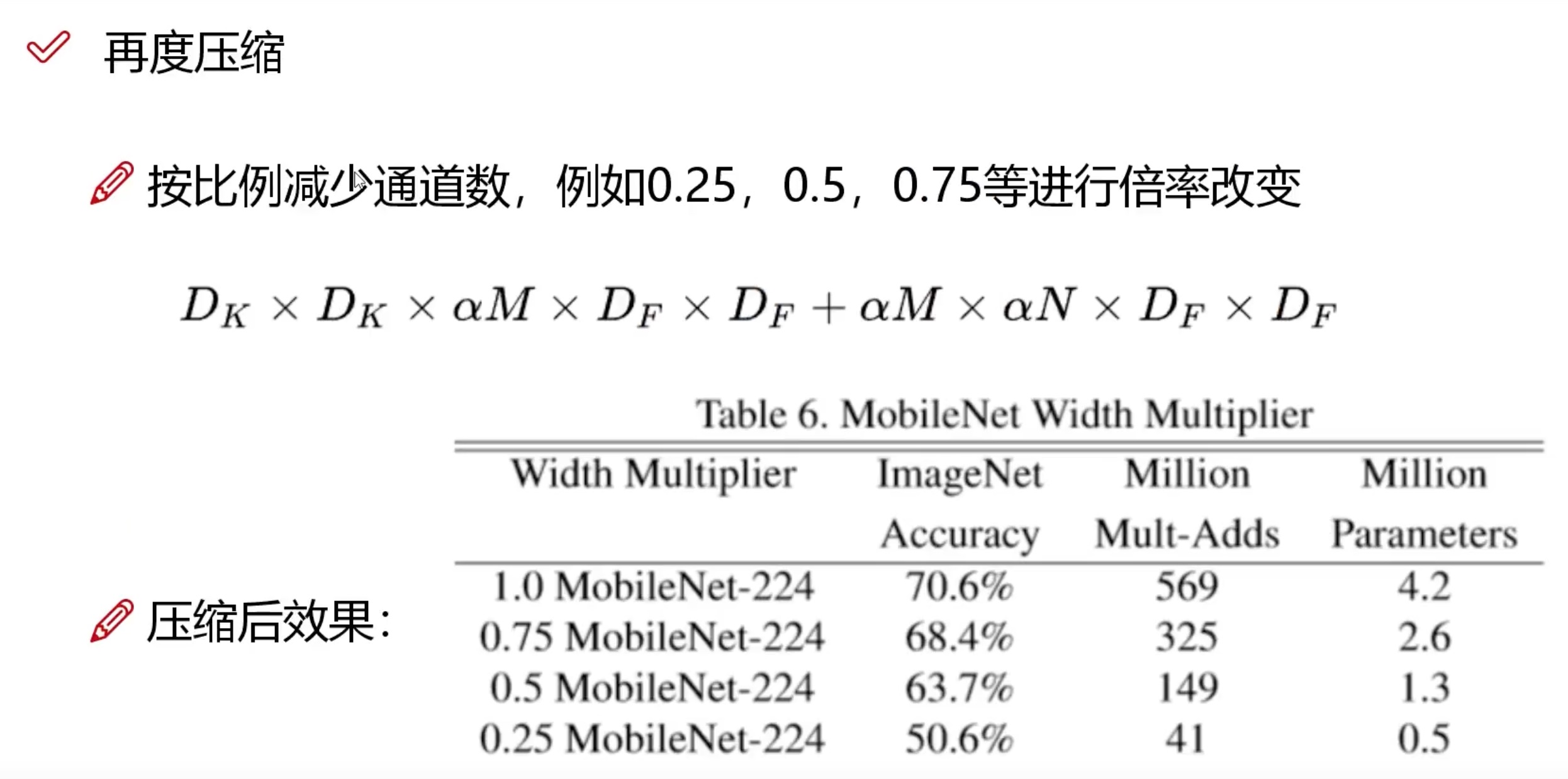

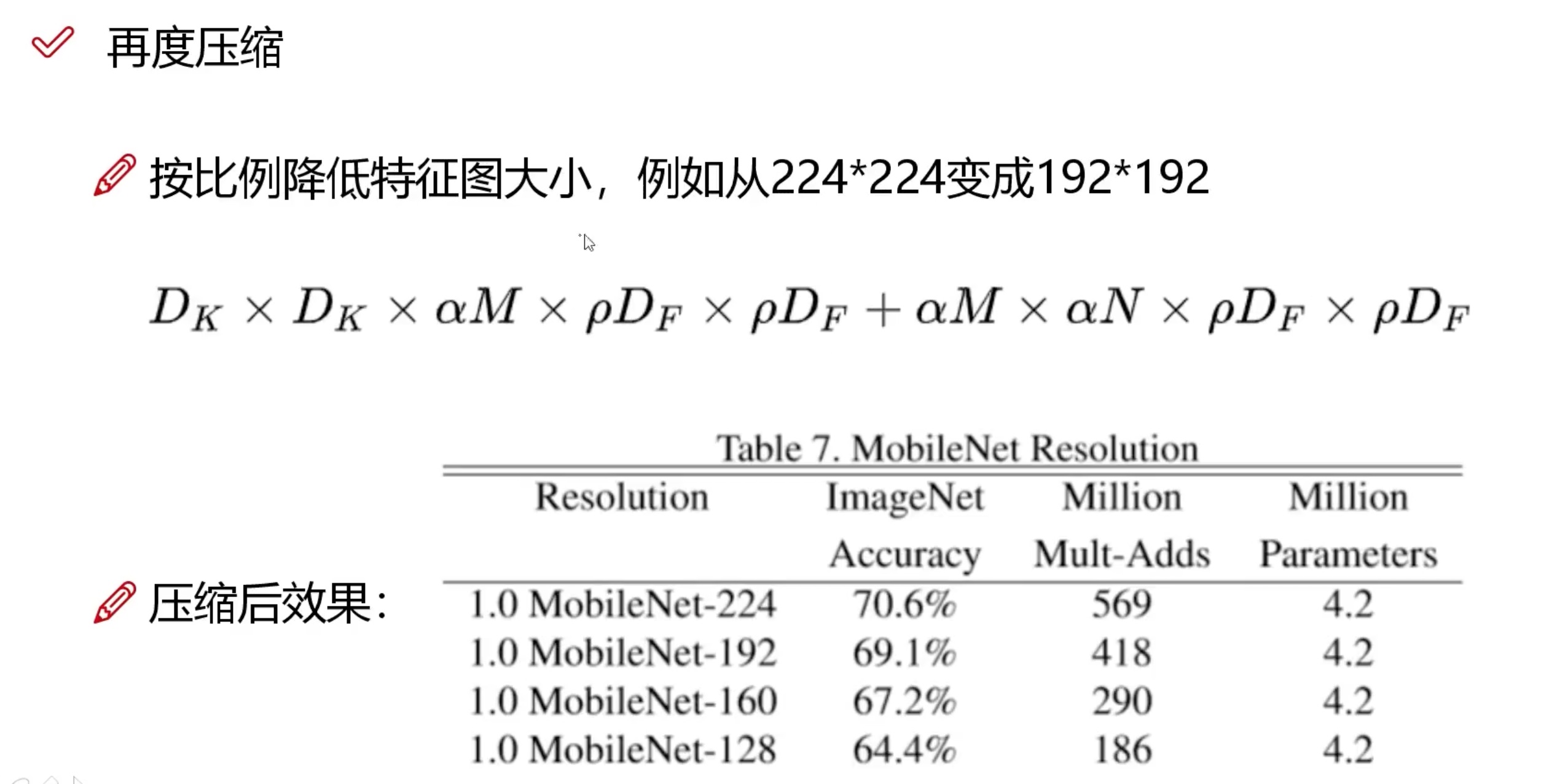

再度压缩模型,速度和大小不能兼得

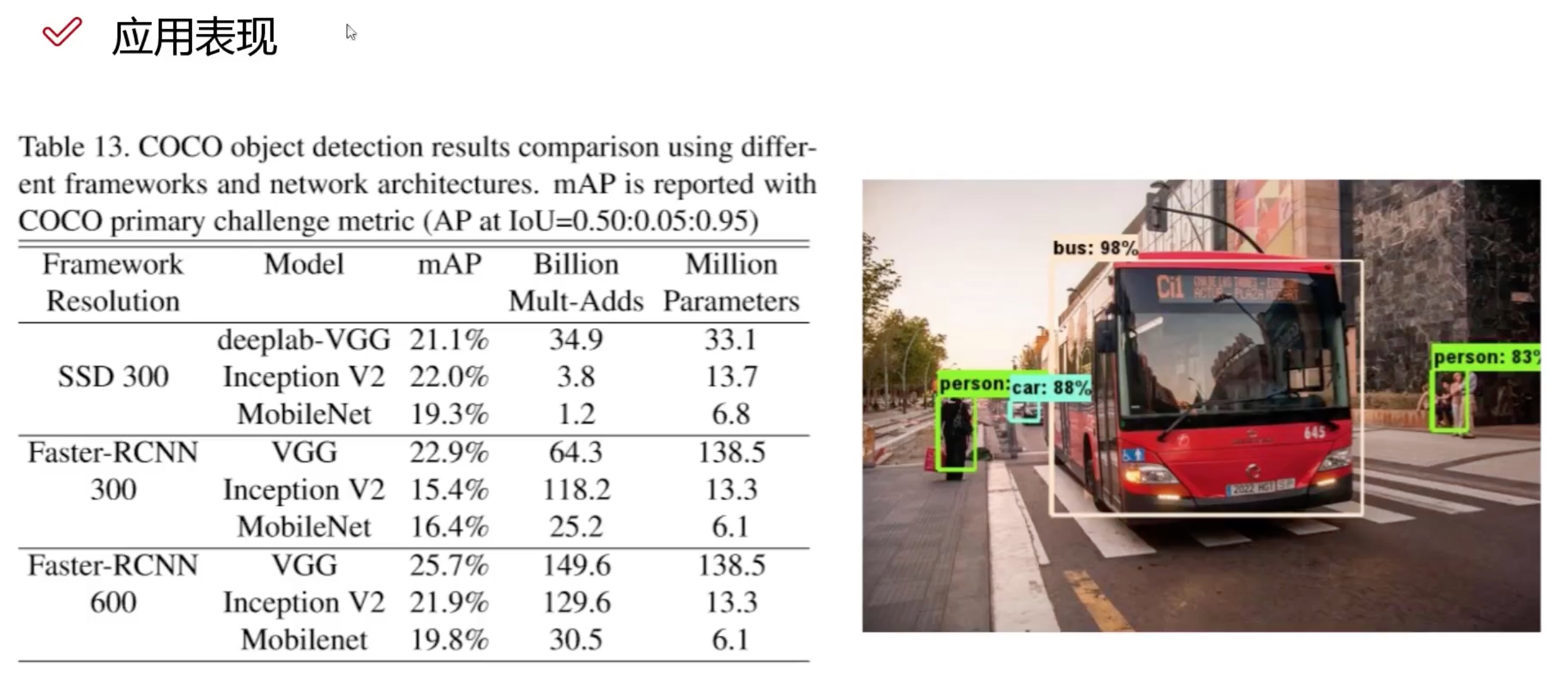

应用效果,主要应用到主干网络,作为替换,减少模型大小,一般不会单独使用

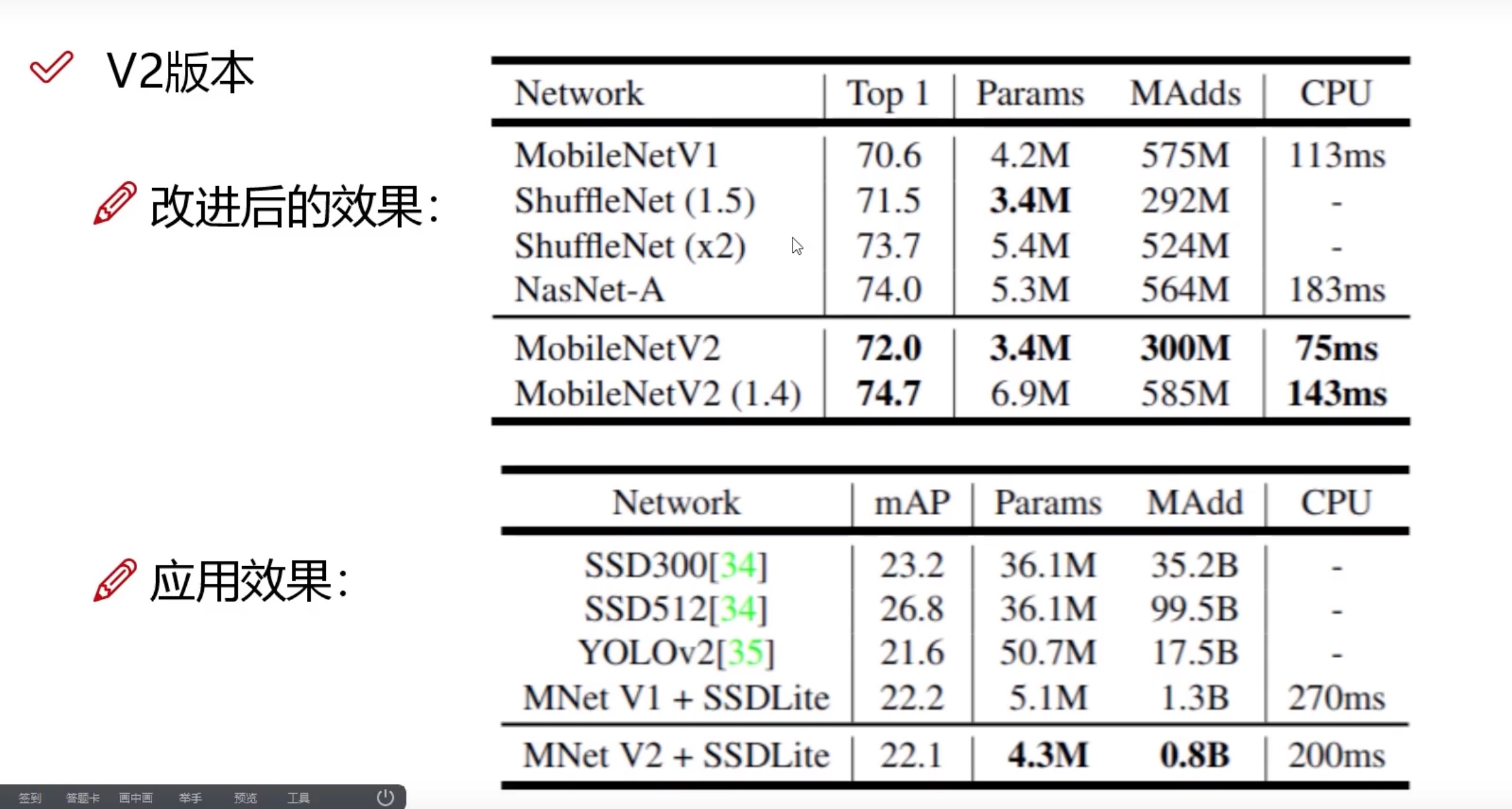

V2版本

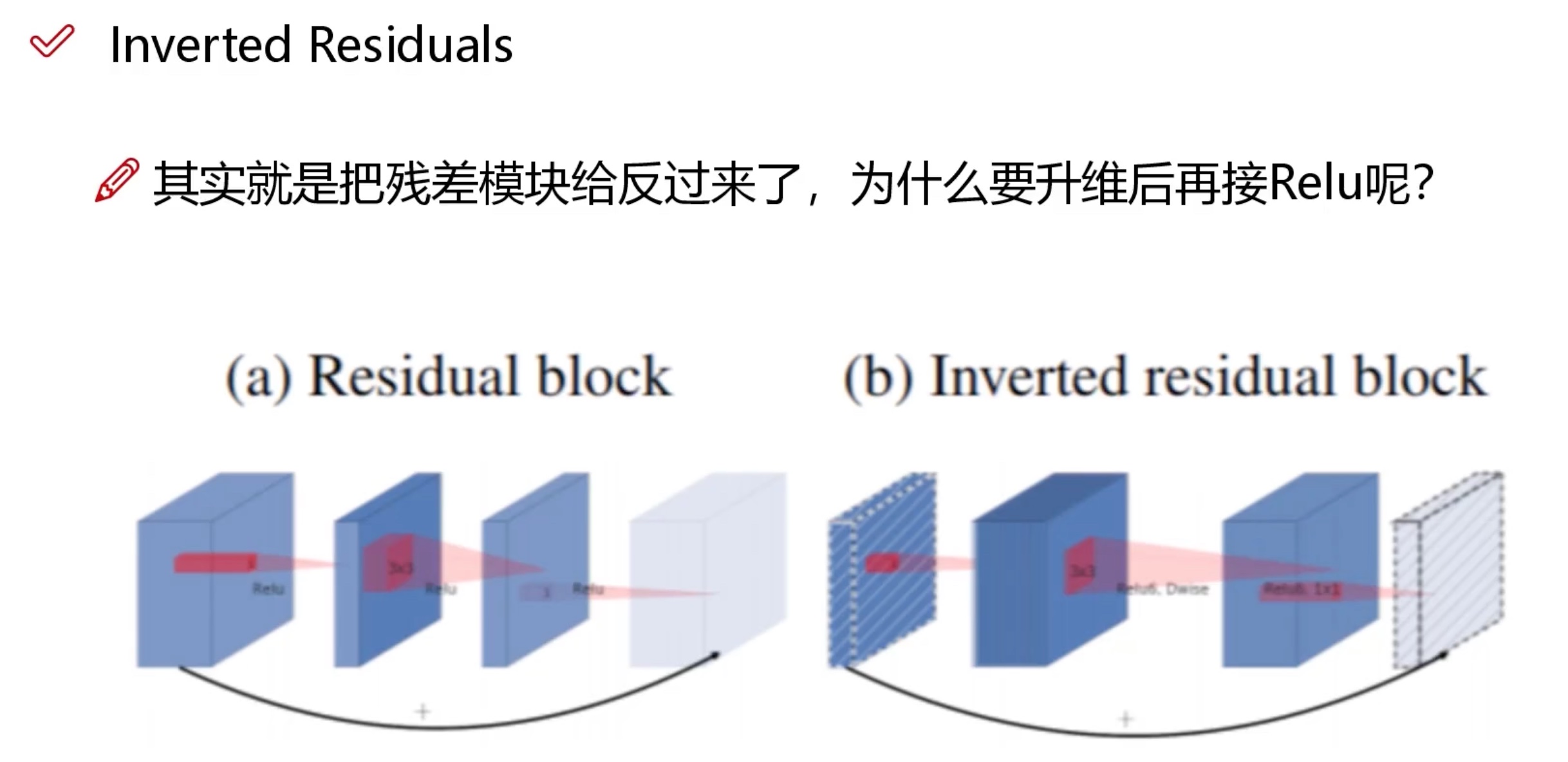

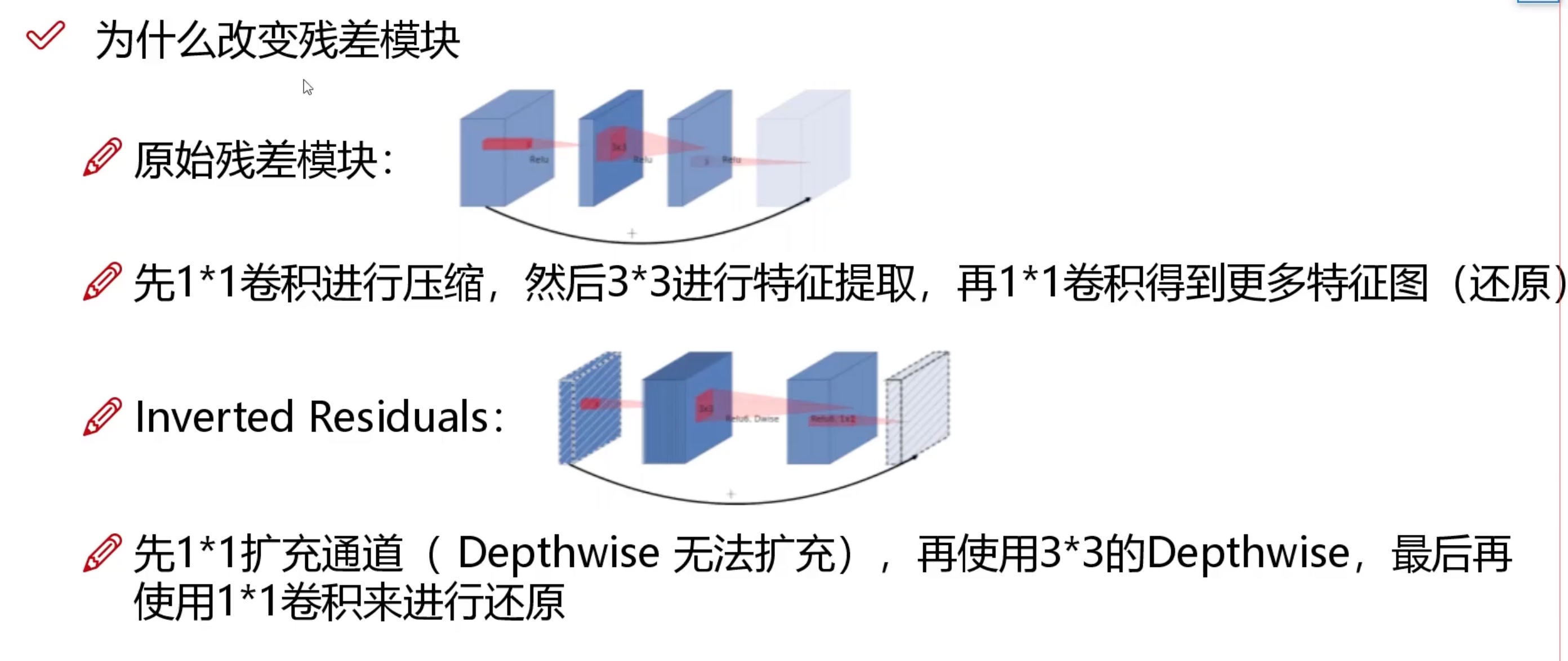

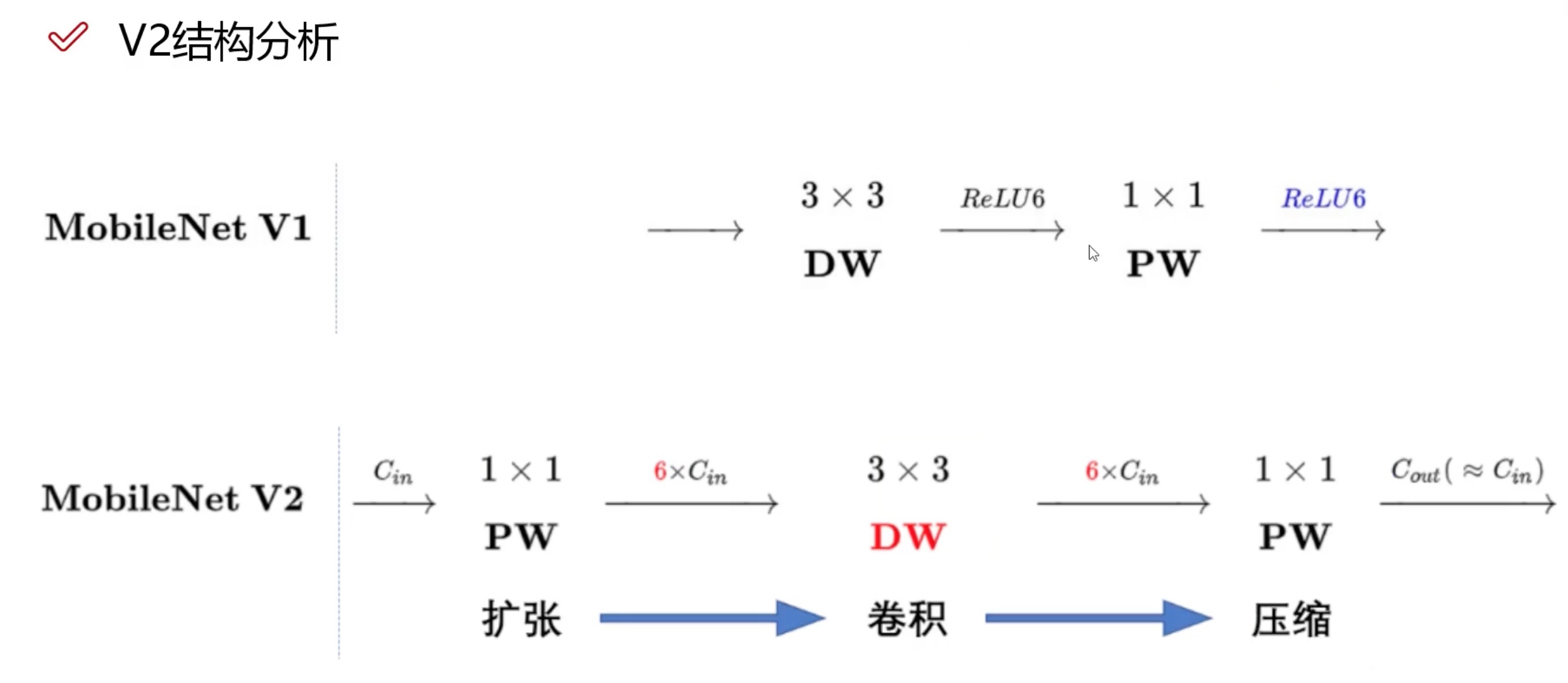

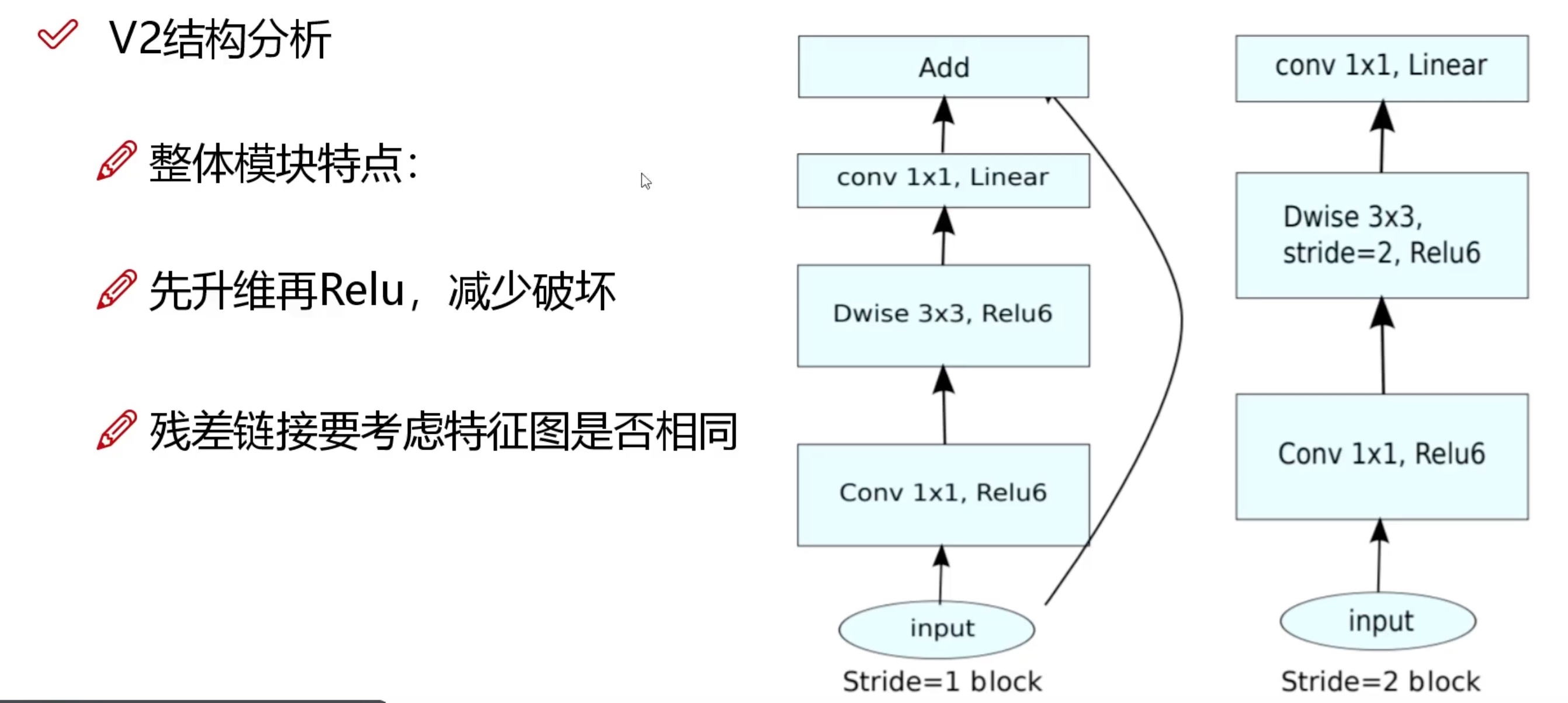

相较于v1,v2的改进

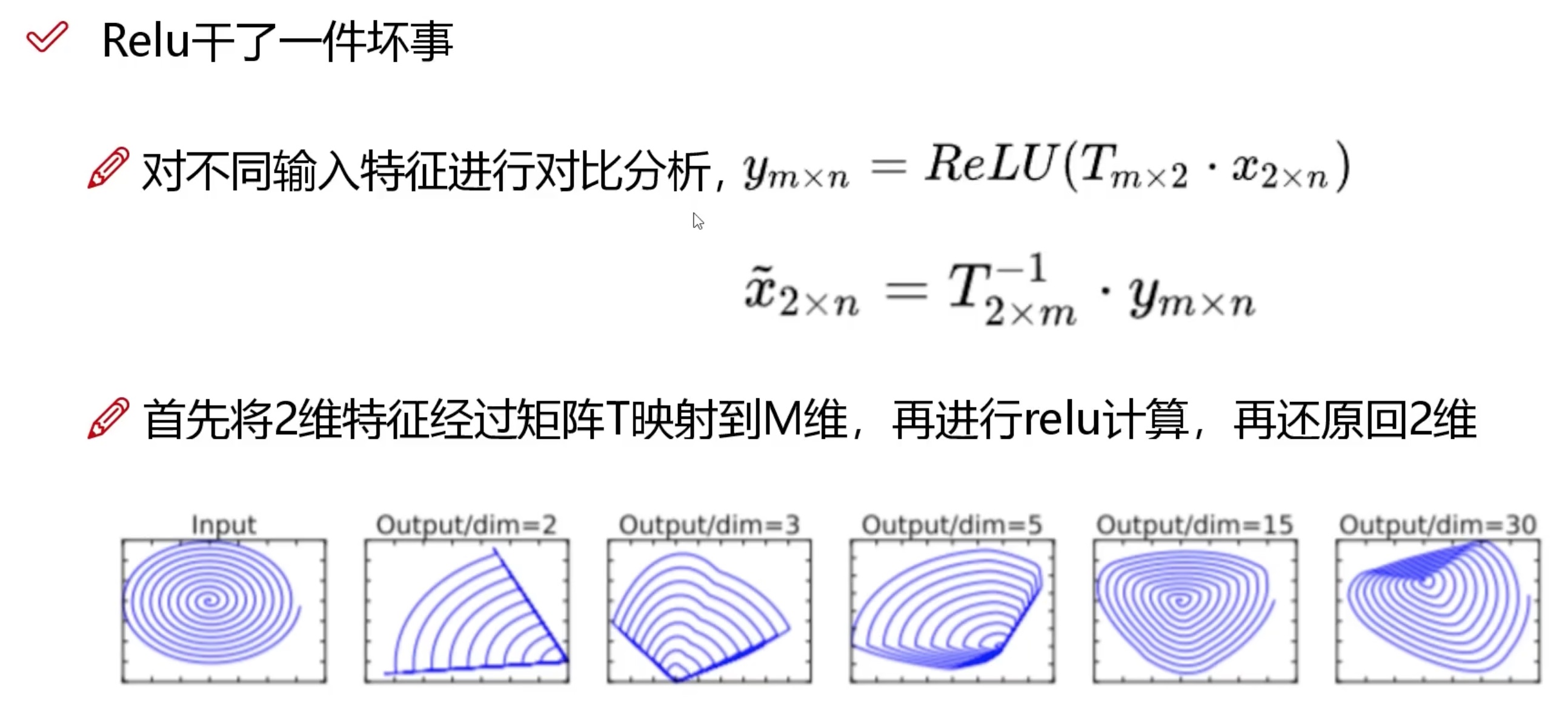

relu会丢失较多的低维数据

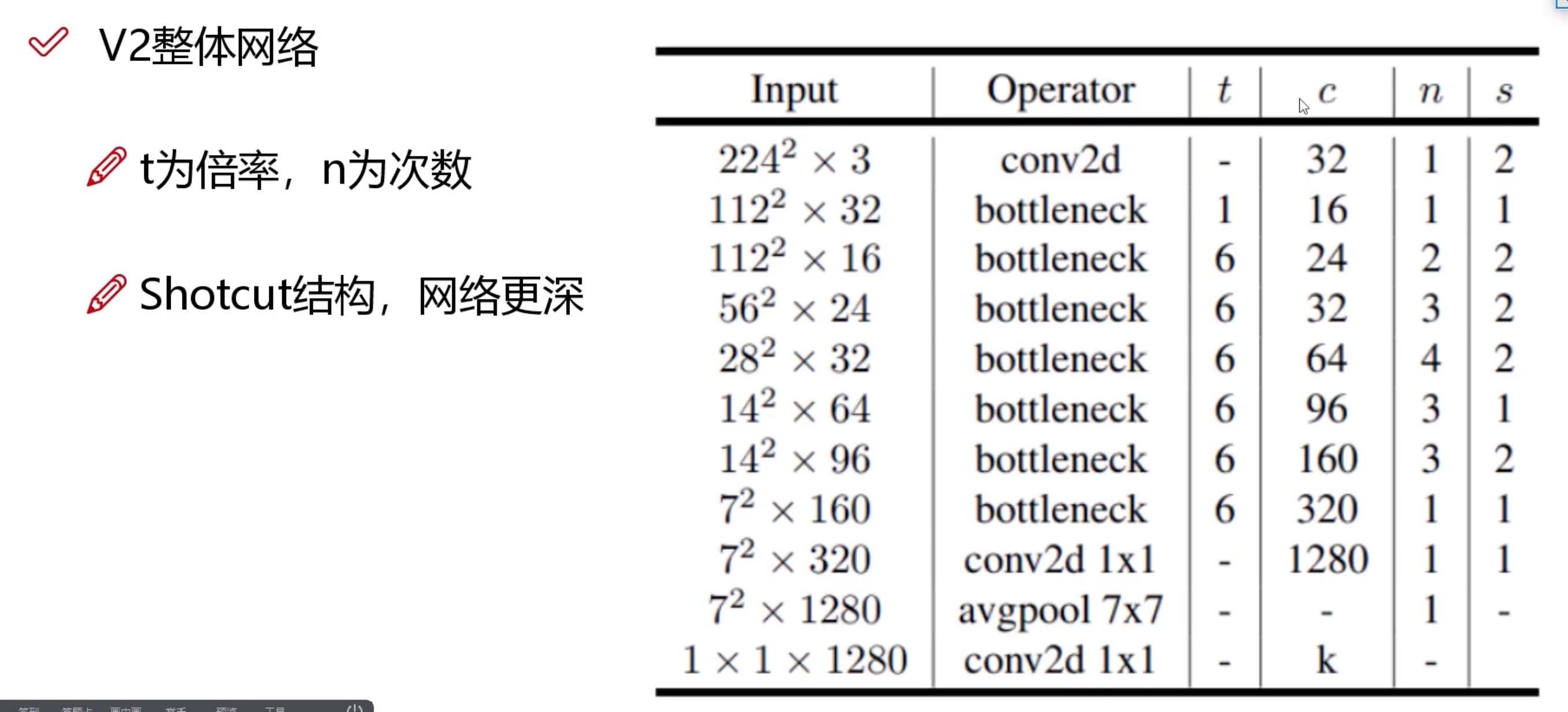

V2模型架构

v2和v1的比较

V3版本

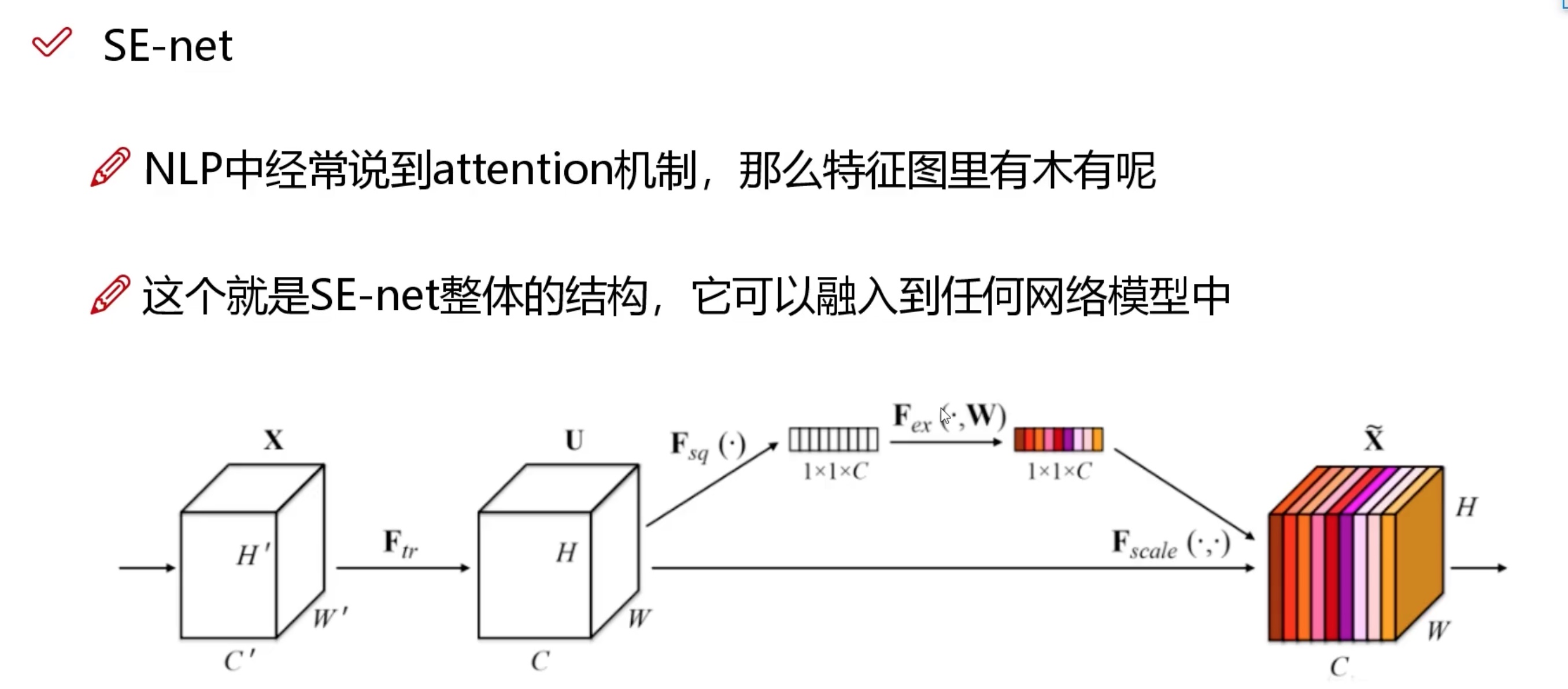

SE就是加上注意力机制,就是对于下一层来说,哪一个更重要,要做一个加权

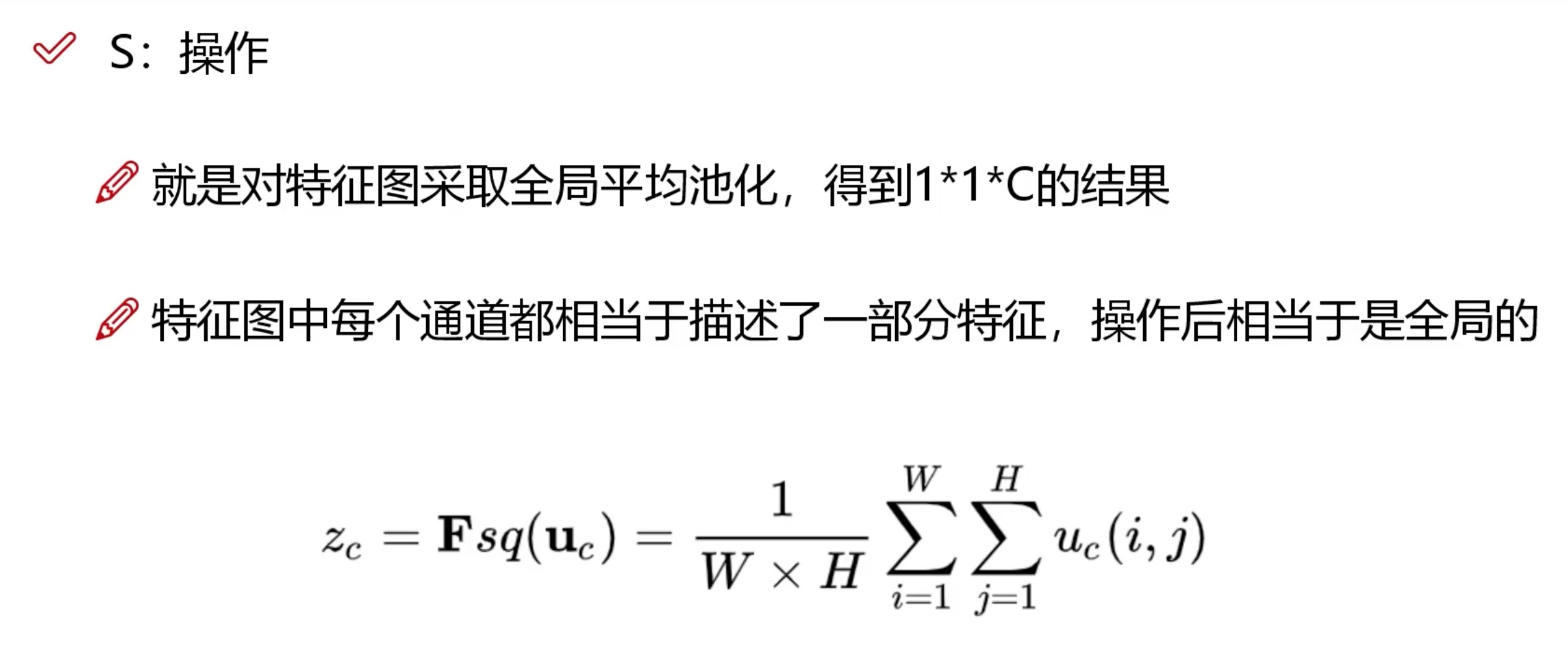

Squeeze

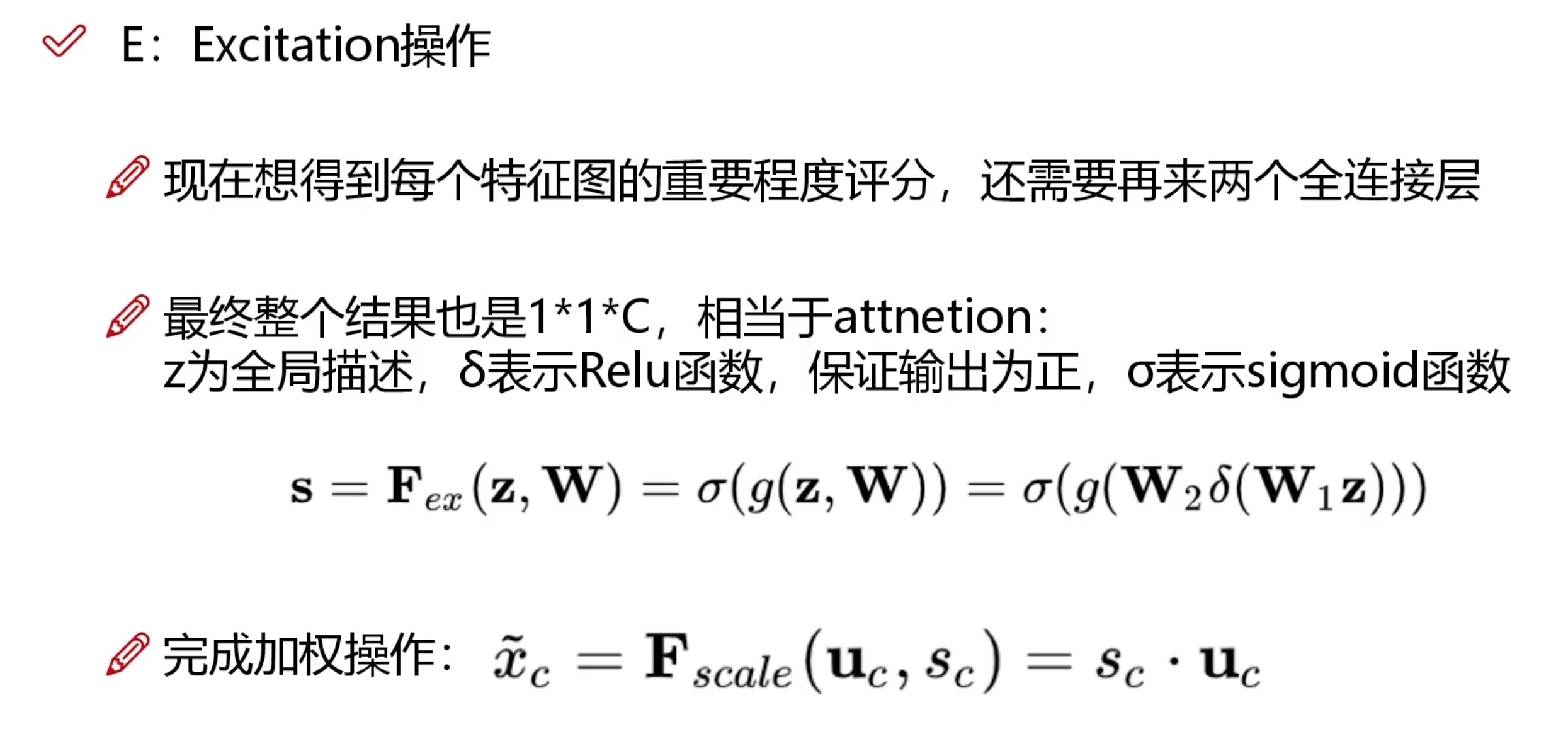

Excitation操作

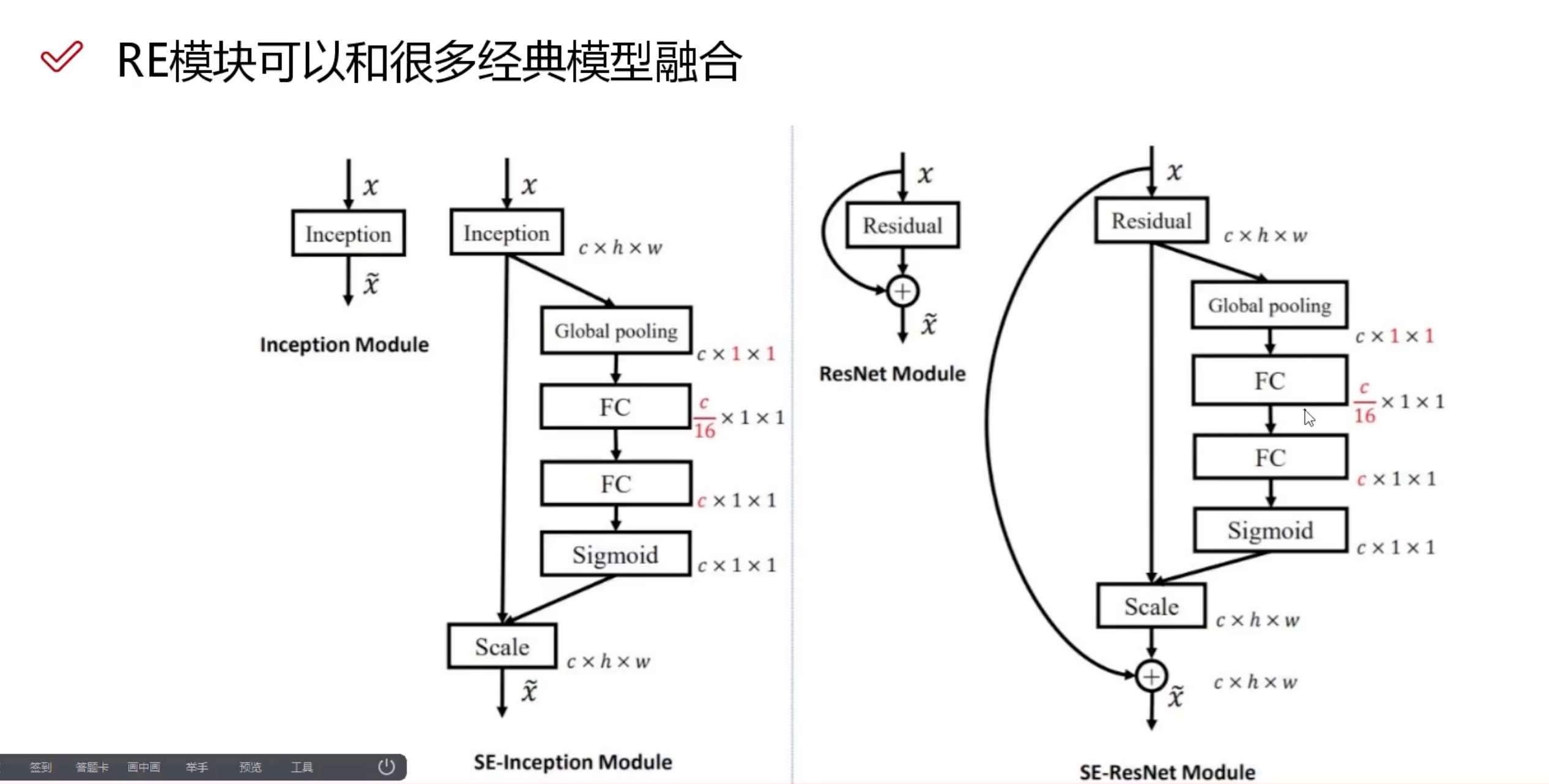

SE应用到其他模型

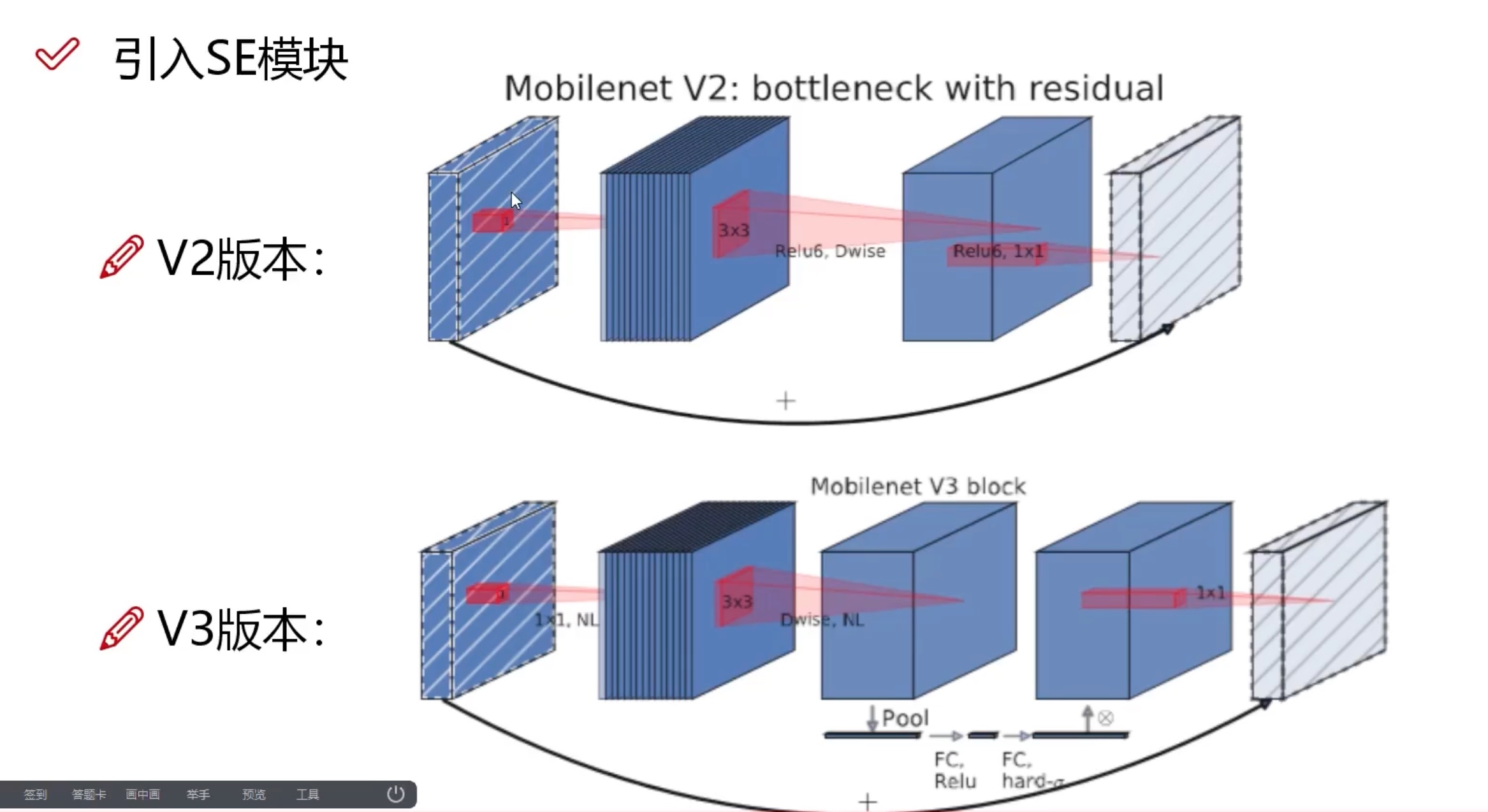

v2和v3的对比

多了一个注意力机制,加入se模块

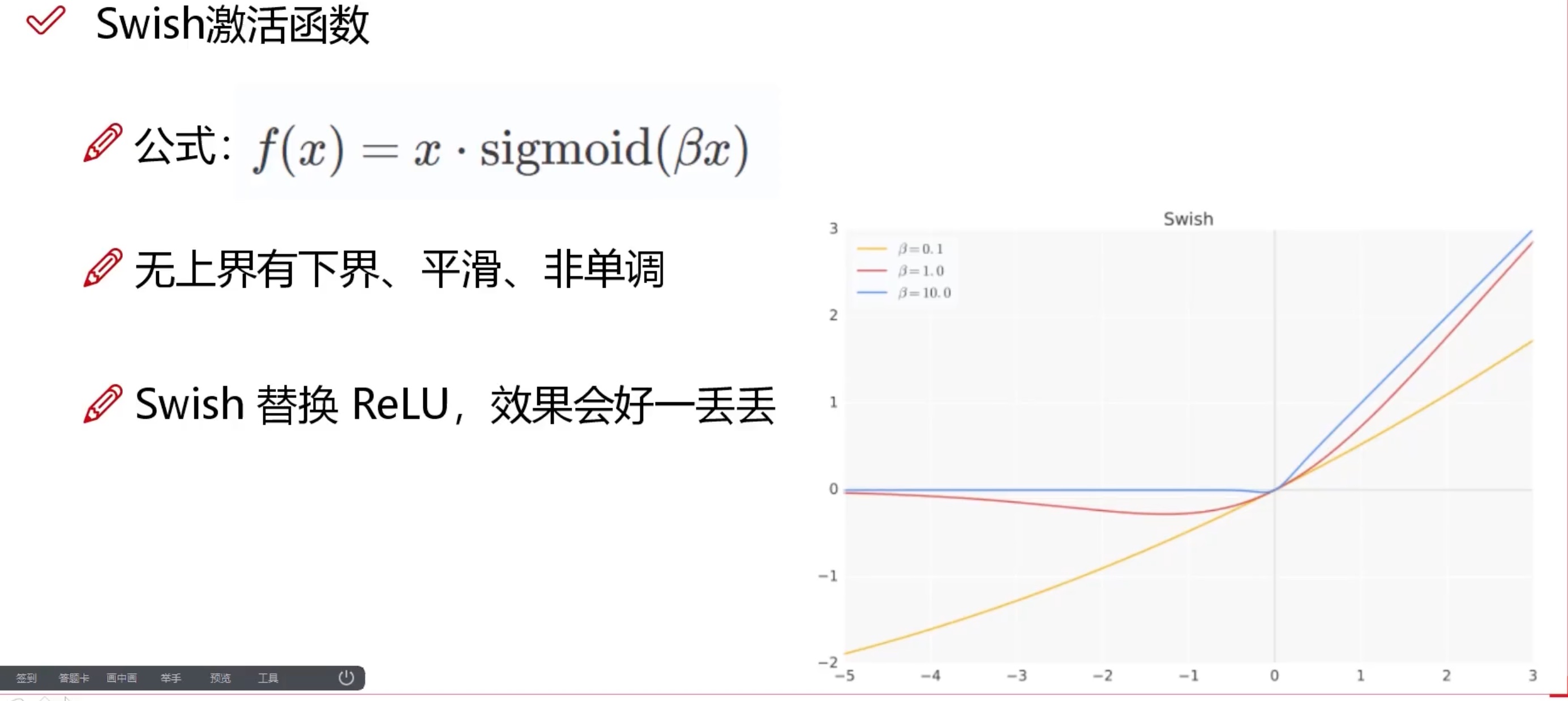

新的激活函数

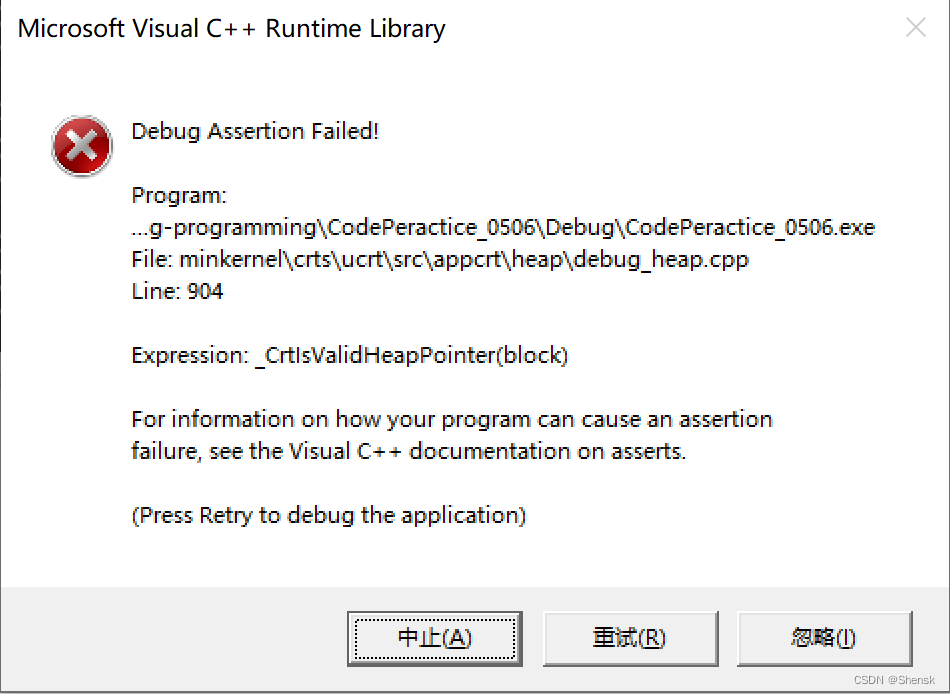

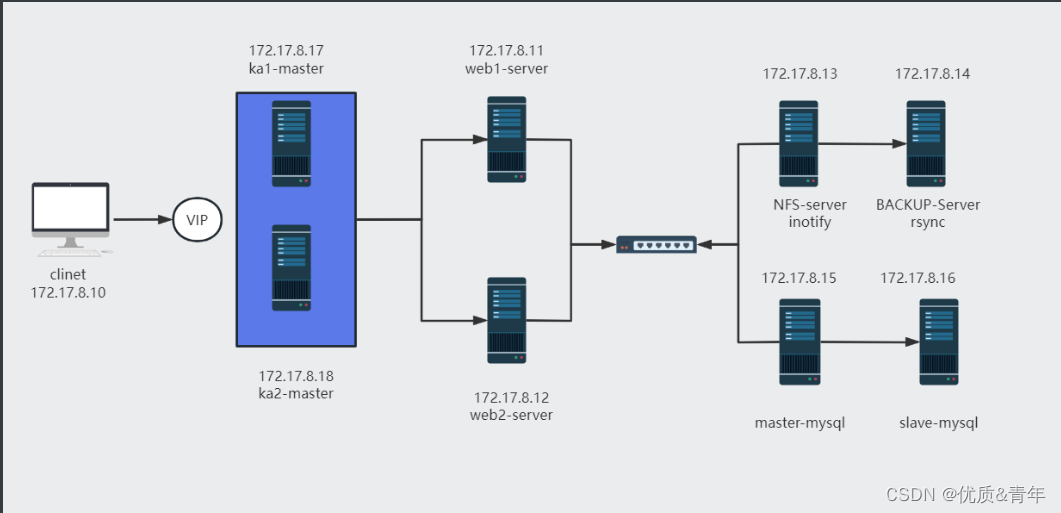

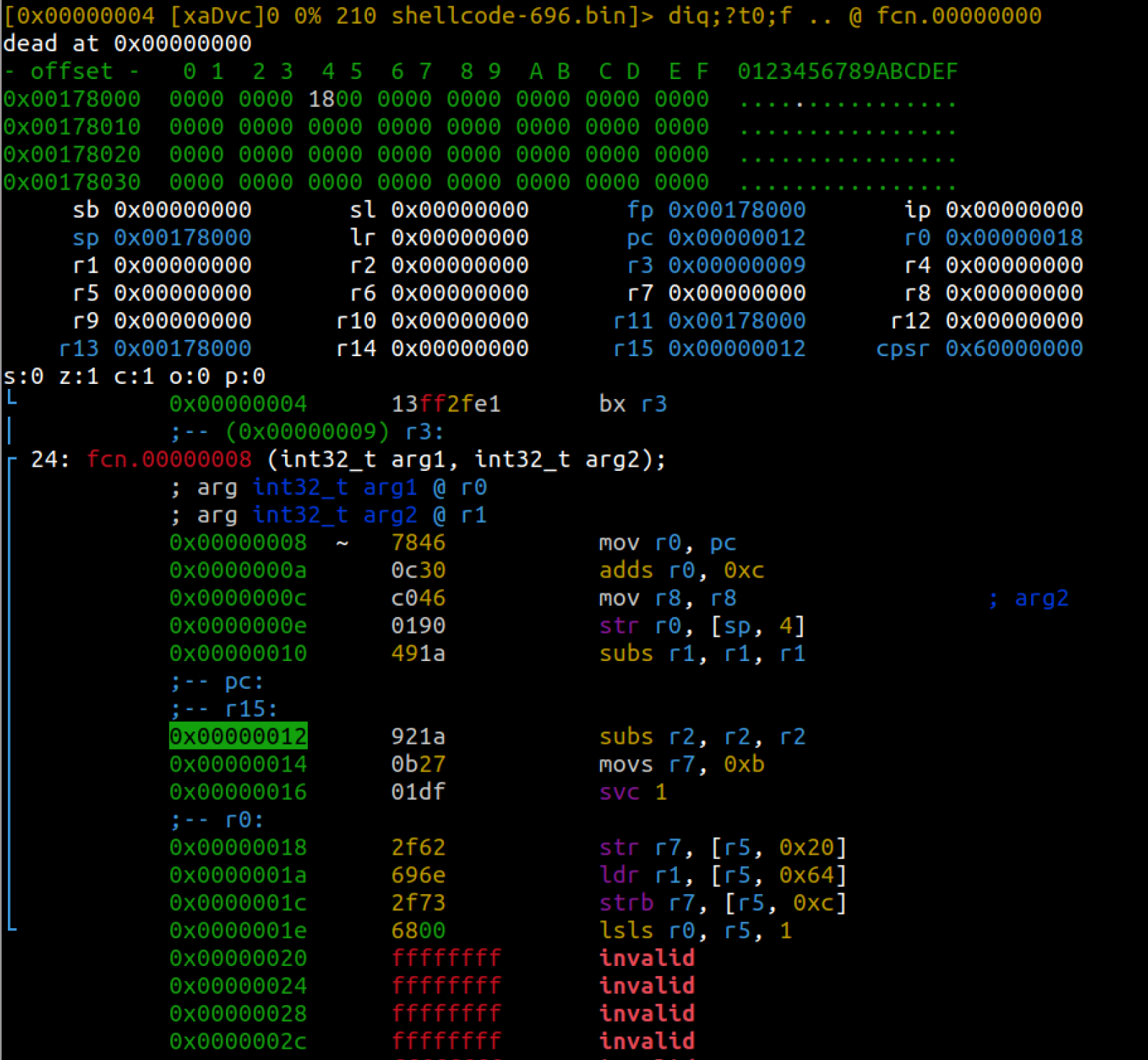

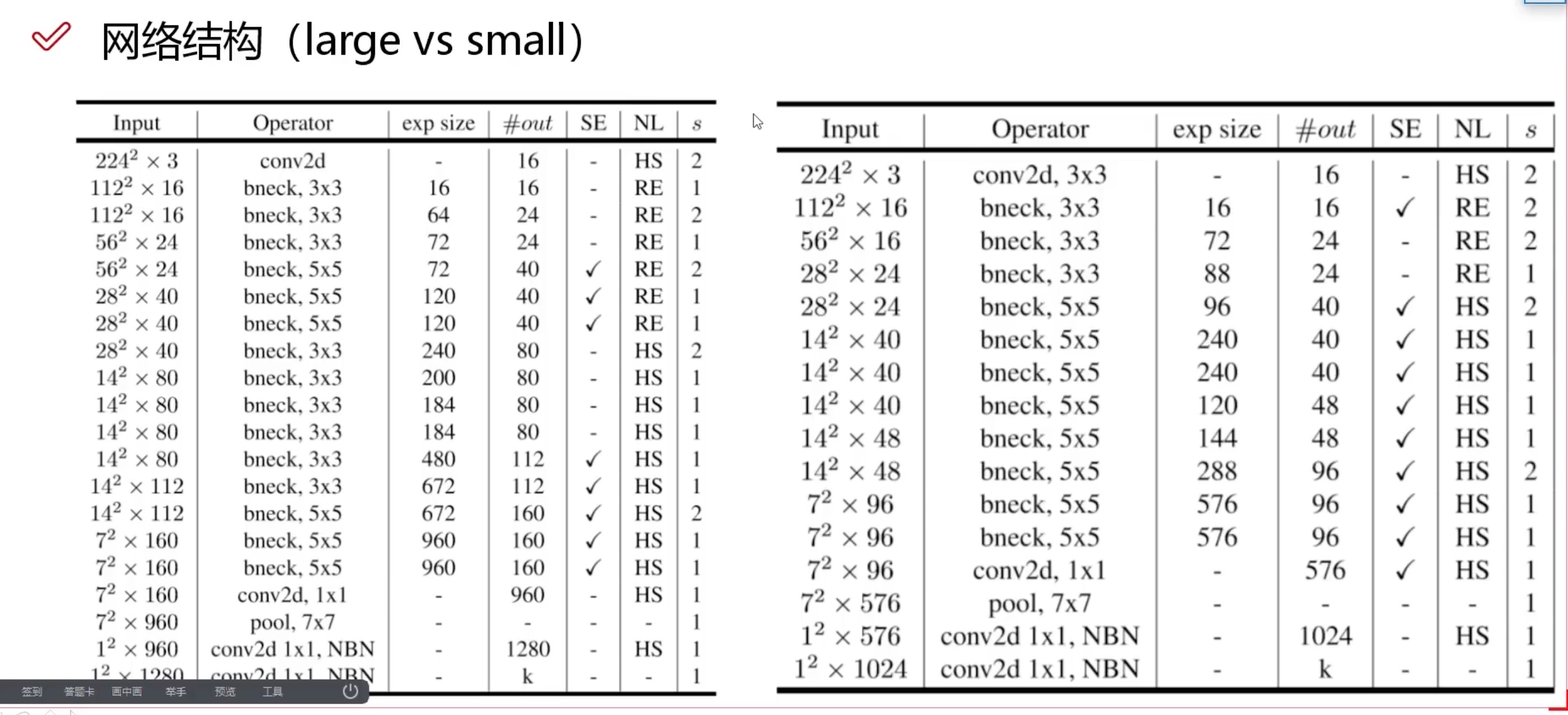

V3模型架构

这是google算出来最好的模型架构,不建议修改

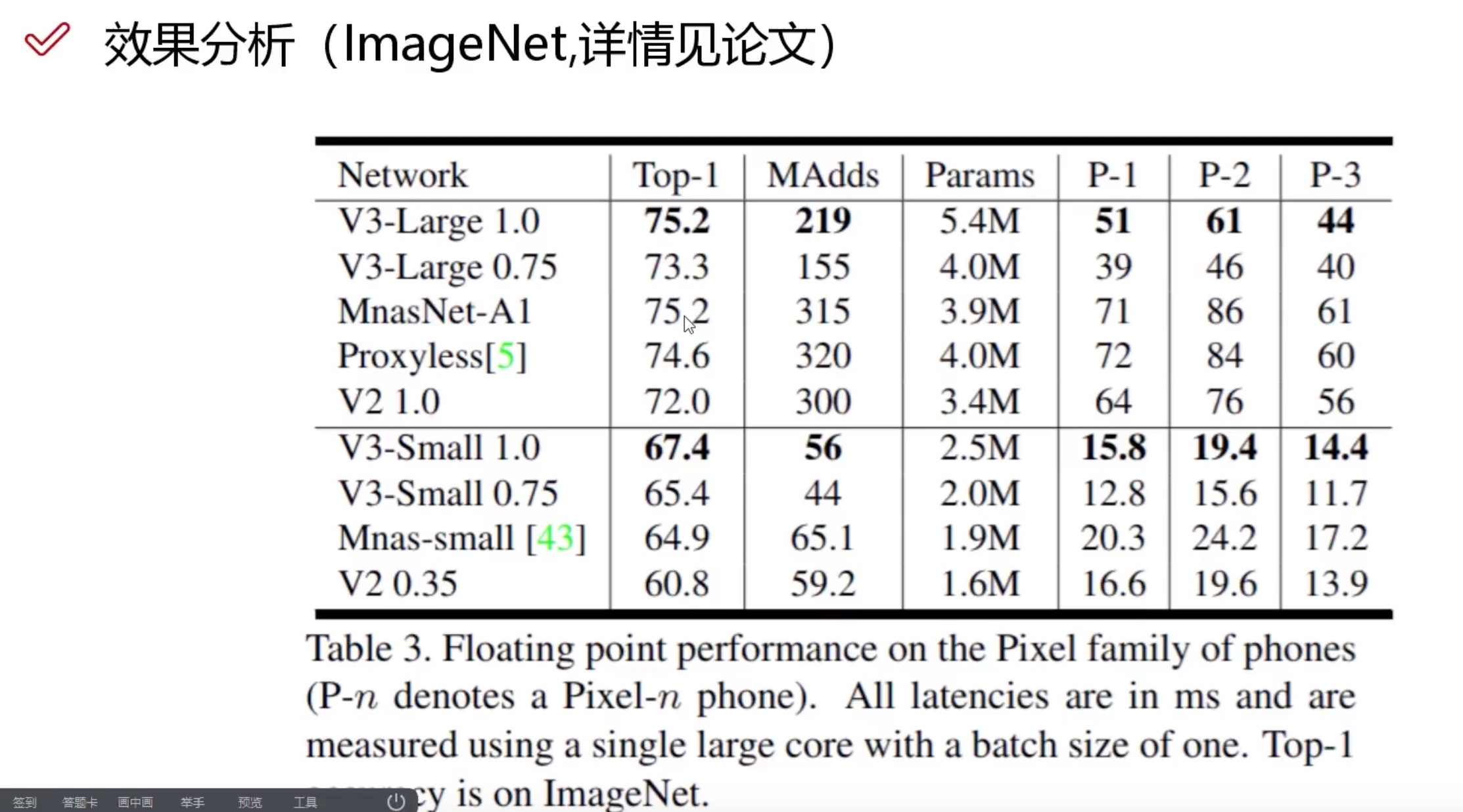

效果分析

- input :输入

- operator :当前层的操作

- exp size :升维

- out :输出

- SE :是否有se模块

- NL :非线性模块,激活函数选择哪个

- s :步长stride