基于蜣螂算法改进的LSTM预测算法

文章目录

- 基于蜣螂算法改进的LSTM预测算法

- 1.数据

- 2.LSTM模型

- 3.基于蜣螂算法优化的LSTM

- 4.测试结果

- 5.Matlab代码

摘要:为了提高LSTM数据的预测准确率,对LSTM中的参数利用蜣螂搜索算法进行优化。

1.数据

采用正弦信号仿真数据,数量为200。90%的数据用于训练,10%的数据用于测试。

2.LSTM模型

LSTM请自行参考相关机器学习书籍。

3.基于蜣螂算法优化的LSTM

蜣螂搜索算法的具体原理参考博客:https://blog.csdn.net/u011835903/article/details/128280084

蜣螂算法的优化参数为 LSTM网路包含的隐藏单元数目,最大训练周期,初始学习率,L2参数。适应度函数为LSTM对训练集和测试集的均方误差(MSE),均方误差MSE越低越好

f

i

n

t

e

n

e

s

s

=

M

S

E

[

p

r

e

d

i

c

t

(

t

r

a

i

n

)

]

+

M

S

E

[

p

r

e

d

i

c

t

(

t

e

s

t

)

]

finteness = MSE[predict(train)] + MSE[predict(test)]

finteness=MSE[predict(train)]+MSE[predict(test)]

4.测试结果

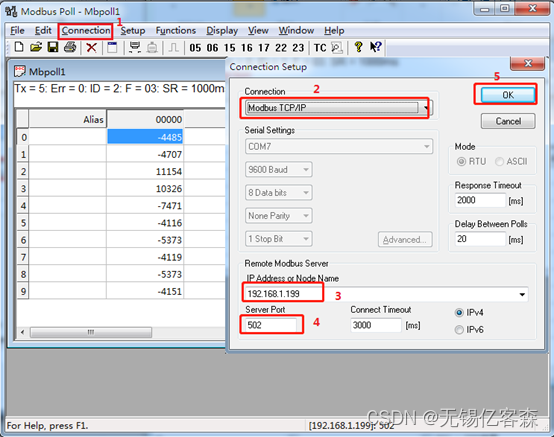

蜣螂参数设置如下:

%% 定义蜣螂优化参数

pop=10; %种群数量

Max_iteration=10; % 设定最大迭代次数

dim = 4;%维度,即LSTM网路包含的隐藏单元数目,最大训练周期,初始学习率,L2参数

lb = [2,2,10E-5,10E-6];%下边界

ub = [200,100,1,1];%上边界

fobj = @(x) fun(x,numFeatures,numResponses,XTrain,YTrain,XTest,YTest);

DBO-LSTM优化得到的最优参数为:

DBO-LSTM优化得到的隐藏单元数目为:166

DBO-LSTM优化得到的最大训练周期为:95

DBO-LSTM优化得到的InitialLearnRate为:0.21589

DBO-LSTM优化得到的L2Regularization为:0.21697

DBO-LSTM结果:

DBO-LSTM训练集MSE:0.021244

DBO-LSTM测试集MSE:0.061414

LSTM结果:

LSTM训练集MSE:0.00053664

LSTM测试集MSE:0.21191

从结果来看,经过改进后的优于未改进前的结果。

![[MySQL教程②] - MySQL介绍和发展史](https://img-blog.csdnimg.cn/img_convert/cfd671ea384c882876037805e9673e57.png)

![[全栈工程师]从0到封神](https://img-blog.csdnimg.cn/4430451040574a9f9a111904372be42b.png)