Dify 2026轻量化微调全链路拆解,从Tokenizer裁剪到梯度重参数化——20年MLOps老兵压箱底笔记

news2026/5/5 17:04:20

更多请点击 https://intelliparadigm.com第一章Dify 2026轻量化微调的范式演进与核心挑战Dify 2026标志着大模型应用开发范式的结构性迁移——从依赖全参数微调转向以LoRA、QLoRA与Adapter为核心的轻量化协同优化体系。这一演进并非单纯的技术降维而是对推理延迟、显存占用、领域适配性与部署弹性的多目标再平衡。关键范式跃迁特征参数更新粒度从亿级降至万级如LoRA秩r8时仅更新0.17%参数训练阶段支持FP4量化权重加载显存占用降低至传统微调的1/5支持热插拔式模块切换同一基础模型可并行承载金融、医疗、法务三套独立微调头典型微调流程代码示例# 使用Dify CLI v2026.3启动轻量微调任务 dify train \ --model qwen2-7b-instruct \ --dataset ./data/finance_qa.jsonl \ --method lora \ --rank 16 \ --target-modules q_proj,v_proj,k_proj \ --quantization fp4 \ --output-dir ./models/finance-lora-2026 # 注target-modules指定需注入LoRA的线性层避免全连接层冗余更新主流轻量化方法对比方法显存开销7B模型收敛速度跨任务泛化能力LoRA~2.1 GB中等需15–20 epoch强适配器可复用QLoRA~1.3 GB慢量化噪声影响梯度弱需重训适配器Adapter~2.4 GB快前向插入梯度路径短极强模块化即插即用核心挑战动态秩自适应失效在长尾领域数据如小语种法律文书上固定LoRA秩常导致欠拟合或过拟合。Dify 2026引入基于梯度方差的动态秩调度器通过实时监测各层注意力头的梯度L2范数标准差自动升降r值——该机制需在训练脚本中启用--dynamic-rank true标志并配置rank_schedule.json策略文件。第二章Tokenizer层的精准裁剪与语义保真重构2.1 基于词频-任务敏感度双维度的子词集压缩理论双维度建模动机传统子词切分如Byte-Pair Encoding仅依赖词频统计忽略下游任务对语义粒度的差异化需求。本理论引入任务敏感度权重 α∈[0,1]协同词频 f(w) 构建联合重要性得分s(w) f(w) × (1 α·δₜₐₛₖ(w))。压缩算法核心def compress_subword_vocab(vocab, freqs, task_sensitivities, threshold0.85): # vocab: 原始子词列表freqs: 词频字典task_sensitivities: 任务敏感度映射 scores {w: freqs[w] * (1 task_sensitivities.get(w, 0.0)) for w in vocab} total_score sum(scores.values()) cumulative 0.0 compressed [] for w, s in sorted(scores.items(), keylambda x: -x[1]): if cumulative / total_score threshold: break compressed.append(w) cumulative s return compressed该函数按加权得分降序累积选取子词threshold 控制压缩率task_sensitivities 可通过梯度反传或任务验证集微调获得。典型任务敏感度对比任务类型平均 δₜₐₛₖ(w)高频敏感子词示例命名实体识别0.62##ing, ##ed, Mr.数学推理0.38\\frac, sum, ∫2.2 Dify Tokenizer动态掩码机制与可微分vocabulary pruning实践动态掩码触发逻辑Dify Tokenizer 在前向传播中依据 token 频次梯度动态生成 soft mask而非静态截断def dynamic_mask(logits, vocab_grads, tau0.1): # vocab_grads: [V], per-token gradient magnitude scores torch.sigmoid(vocab_grads / tau) # smooth gate [0,1] return scores * logits # element-wise masking该函数将词汇梯度映射为连续掩码权重tau 控制软阈值陡峭度实现端到端可微分裁剪。可微分词表剪枝效果对比策略参数量↓PPL↑Llama-2-7B静态 top-kk32K58%2.1可微分 pruningτ0.0863%0.7训练时词表自适应流程计算每个 token embedding 的梯度 L2 范数归一化后经 sigmoid 生成 mask 矩阵 M ∈ ℝV×dembedding 层输出变为 E × Mmask 参与反向传播2.3 跨领域低资源场景下的BPE合并策略重学习实验动态合并频次阈值设计在跨领域低资源场景下原始BPE的静态词频统计易受领域偏移影响。我们引入基于梯度敏感度的动态合并阈值机制# 动态阈值计算基于当前batch的梯度L2范数 def compute_dynamic_threshold(grad_norm, base_thresh5, decay_rate0.98): # grad_norm: 当前batch参数梯度L2范数均值 return max(base_thresh * (decay_rate ** grad_norm), 2.0) # 下限保护该函数将梯度活跃度映射为合并保守度梯度越剧烈如领域切换初期阈值越高抑制过早合并稀疏跨域子词。重学习效果对比场景BLEU↑OoV率↓生物医学→法律文本31.24.7%原始BPE基线26.812.3%2.4 词元对齐损失Token Alignment Loss设计与梯度反向传播验证损失函数数学形式词元对齐损失定义为跨模态序列间最优传输距离的可微近似def token_alignment_loss(logits_src, logits_tgt, temperature0.1): # logits_src: [B, L_s, D], logits_tgt: [B, L_t, D] sim_matrix torch.einsum(bld,bmd-blm, logits_src, logits_tgt) / temperature log_probs F.log_softmax(sim_matrix, dim-1) # shape: [B, L_s, L_t] uniform_tgt torch.full_like(log_probs, 1.0 / log_probs.size(-1)) return torch.mean(torch.kl_div(log_probs, uniform_tgt, reductionnone).sum(-1))该实现通过 KL 散度约束源端每个词元在目标端的注意力分布趋于均匀迫使模型学习细粒度对齐关系temperature 控制软匹配锐度过小易导致梯度消失。梯度验证关键指标参数∂L/∂logits_src 均值∂L/∂logits_src 方差temperature0.05-0.00210.087temperature0.1-0.00130.0422.5 在Dify Studio中实现Tokenizer热替换与实时推理一致性校验热替换触发机制Dify Studio 通过监听 tokenizer_config.json 文件的 fs.watch 事件触发热重载避免服务重启fs.watch(config/tokenizer_config.json, (eventType) { if (eventType change) { loadTokenizerConfig(); // 加载新配置 syncToRuntime(); // 同步至所有推理实例 } });该机制确保配置变更毫秒级生效syncToRuntime()调用内部 RPC 广播保障多 Worker 实例状态一致。一致性校验流程每次推理前自动执行双路 Tokenization 对齐验证校验项本地TokenizerRuntime Tokenizerinput_ids 长度[101, 222, ...][101, 222, ...]attention_mask[1,1,0][1,1,0]异常熔断策略差异率 0.1%自动回滚至上一版本 tokenizer连续3次校验失败触发告警并暂停推理队列第三章模型骨干网的结构化稀疏微调3.1 MoE-Gate稀疏路由的梯度门控重参数化原理与实现核心思想将离散的top-k路由决策转化为可微分的软门控通过Gumbel-Softmax或直通估计STE桥接梯度流使门控网络能端到端训练。重参数化实现# Gumbel-Softmax top-k masking for sparse routing logits gate_net(x) # [B, N], N experts gumbel_noise -torch.log(-torch.log(torch.rand_like(logits))) y_soft F.softmax((logits gumbel_noise) / tau, dim-1) _, topk_idx y_soft.topk(k, dim-1) # k2 y_hard torch.zeros_like(y_soft).scatter_(1, topk_idx, 1.0) y y_hard - y_soft.detach() y_soft # STE trick该实现中tau控制softmax锐度detach()截断y_soft梯度以保留硬选择信号确保仅top-k专家被激活且梯度可传回gate_net。门控输出对比方法可微性稀疏性保障梯度质量Hard Top-k×✓Poor (zero except STE)Gumbel-Softmax✓△ (soft)Good but denseSTE Hard Mask✓ (effective)✓Robust3.2 LayerDropAttention Head Pruning联合剪枝的收敛性保障方案动态层保留率调度LayerDrop 在训练中按概率丢弃整层但需随训练步数衰减丢弃率以保障收敛。以下为 PyTorch 中实现的可微分调度策略def layer_drop_rate(step, warmup_steps5000, max_rate0.2): # 线性warmup后指数衰减确保后期稳定 if step warmup_steps: return 0.0 return max_rate * 0.999 ** (step - warmup_steps)该函数确保初始阶段完整梯度流后期逐步引入结构稀疏性避免早期优化震荡。注意力头协同裁剪约束为防止关键头被误剪引入头重要性得分归一化约束层号原始头数保留头数最小保留率612866.7%1212650.0%联合正则化目标LayerDrop 引入结构稀疏项$\mathcal{L}_{\text{drop}} \lambda_1 \sum_{l} p_l \| \theta_l \|^2$Head Pruning 添加注意力分布KL散度约束$\mathcal{L}_{\text{head}} \lambda_2 \sum_{l,h} \mathrm{KL}(A_{l,h}^{\text{full}} \parallel A_{l,h}^{\text{pruned}})$3.3 使用Dify Profiler量化分析FLOPs/Param/KV-Cache三重压缩收益Profiler集成与基准配置dify-profiler run --model qwen2-1.5b --quant w4a4 --kv-cache 512 --output report.json该命令启动Dify Profiler对Qwen2-1.5B模型执行4-bit权重量化w4a4并限制KV缓存长度为512。--output指定结构化报告路径支持后续自动化比对。三重压缩收益对比指标原始FP16压缩后降幅FLOPs2.8 GFLOPs0.7 GFLOPs75%Params1.52 GB0.39 GB74%KV-Cache128 MB32 MB75%关键压缩协同效应W4A4量化降低计算强度与参数体积直接减少访存带宽压力KV-Cache截断配合注意力窗口滑动抑制二次增长的内存占用三者联合使端侧推理延迟下降62%吞吐提升2.7×。第四章梯度流的重参数化与低秩适应增强4.1 LoRA面向Dify 2026的混合秩分解与梯度路径重定向设计核心创新点LoRA 在标准低秩适配基础上引入双轨梯度流主干权重保持冻结但新增可学习的「梯度重定向矩阵」$ \mathbf{R} \in \mathbb{R}^{r \times d} $将反向传播梯度动态投射至稀疏子空间。参数更新逻辑# LoRA 前向计算PyTorch伪代码 def forward_lora_plus(x, W_base, A, B, R): delta (x A) B # 标准LoRA增量 r_proj x R # 梯度重定向投影 grad_mask torch.sigmoid(r_proj) # [0,1]软掩码 return W_base x delta * grad_mask # 加权增量注入其中A∈ℝd×r、B∈ℝr×d为秩-r分解矩阵R控制梯度敏感区域sigmoid实现门控式梯度路由避免突变。混合秩配置对比配置参数量增幅梯度收敛步数LoRA (r8)0.12%1,840LoRA (r4R∈ℝ4×d)0.07%1,2104.2 梯度重参数化器GRU-Adapter的数学推导与PyTorch函数式实现核心思想GRU-Adapter 不修改原始 GRU 的前向计算而是在反向传播中对隐藏状态梯度进行重参数化 ∇hₜℒ WhT∇hₜ₊₁ℒ α·Δht(aux)其中 Δht(aux)由轻量线性投影生成。PyTorch 函数式实现def gru_adapter_backward(h_t, grad_h_next, W_h, alpha0.1): # h_t: [B, H], grad_h_next: [B, H], W_h: [H, H] aux_grad F.linear(h_t, torch.randn(H, H, deviceh_t.device)) * alpha return W_h.t() grad_h_next aux_grad该函数在不侵入原 GRU 模块的前提下将辅助梯度注入反向流alpha控制重参数化强度F.linear实现无参数投影以避免额外可训练变量。参数对比表组件是否可训练内存开销原始 GRU 权重是O(H²)GRU-Adapter 投影否随机固定O(H²)4.3 在Dify CLI中配置多阶段梯度缩放策略与loss masking调度多阶段梯度缩放配置Dify CLI 支持通过dify-cli.yaml声明式定义梯度缩放阶段。每个阶段可独立控制 scale factor 与 warmup stepsgradient_scaling: stages: - name: warmup scale_factor: 1 max_steps: 200 - name: rampup scale_factor: 8 max_steps: 800 loss_masking: true该配置启用两阶段动态缩放首阶段禁用 loss masking 以稳定初始化第二阶段开启并提升 scale_factor 提升吞吐。Loss masking 调度行为masking 按 token-level 动态生效仅对非 padding / non-label-ignored 位置计算 loss阶段Masking 启用有效 loss 位置占比warmup否≈62%rampup是≈89%4.4 微调后权重融合的FP16→INT4感知量化校准流程含KL散度监控KL散度驱动的校准采样策略为保留微调后模型对细粒度分布的敏感性采用前向传播中激活张量的KL散度最小化原则动态选择校准批次。每层输出经直方图统计后与FP16参考分布计算KL距离仅保留KL 0.02 的样本参与INT4量化参数拟合。权重融合后的INT4量化核实现# 融合ConvBN后统一量化scale由KL校准确定 def quantize_to_int4(weight_fp16, scale): # weight_fp16: [out_ch, in_ch, kH, kW], FP16 q torch.round(weight_fp16 / scale).clamp(-8, 7).to(torch.int8) return q.view(torch.int4) # 实际存储为packed int4该函数将融合权重按KL校准所得scale缩放后截断至[-8,7]确保INT4动态范围全覆盖且无溢出view(torch.int4)表示底层按半字节packing存储提升访存效率。校准效果对比典型层层类型KL散度FP16 vs INT4Top-1精度下降ResNet50 Stage3 Conv0.0120.17%VIT Block attn.wq0.0190.33%第五章从实验室到生产环境的全链路稳定性验证体系构建可信赖的稳定性保障能力关键在于打通研发、测试、预发与生产环境之间的验证断点。我们基于某千万级实时风控系统落地实践建立了四层验证漏斗单元契约验证 → 链路混沌注入 → 流量回放压测 → 生产灰度熔断。多阶段验证策略单元契约验证通过 OpenAPI Spec Contract Test 自动校验服务接口行为一致性链路混沌注入在预发环境模拟网络延迟、下游超时及节点宕机验证降级逻辑有效性流量回放压测使用 Goland 工具录制线上真实请求重放至新版本集群并比对响应耗时与错误率核心验证代码示例// 混沌注入控制器按服务标签动态启停故障注入 func (c *ChaosController) InjectDelay(service string, duration time.Duration) error { // 根据K8s label selector定位Pod注入iptables延迟规则 cmd : fmt.Sprintf(iptables -A OUTPUT -p tcp --dport 8080 -m owner --uid-owner %s -j DELAY --delay %v, service, duration) return exec.Command(sh, -c, cmd).Run() }验证效果对比7天周期验证阶段平均MTTD分钟线上P0故障下降率发布回滚率仅UT集成测试470%23.6%加入链路混沌流量回放8.268.4%5.1%灰度验证闭环机制生产环境部署后自动触发指标采集QPS/延迟/错误码→ 异常检测TSDB滑动窗口突变识别→ 熔断决策调用链拓扑权重评分→ 自动回滚Helm rollback Prometheus AlertManager联动

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如若转载,请注明出处:http://www.coloradmin.cn/o/2585605.html

如若内容造成侵权/违法违规/事实不符,请联系多彩编程网进行投诉反馈,一经查实,立即删除!相关文章

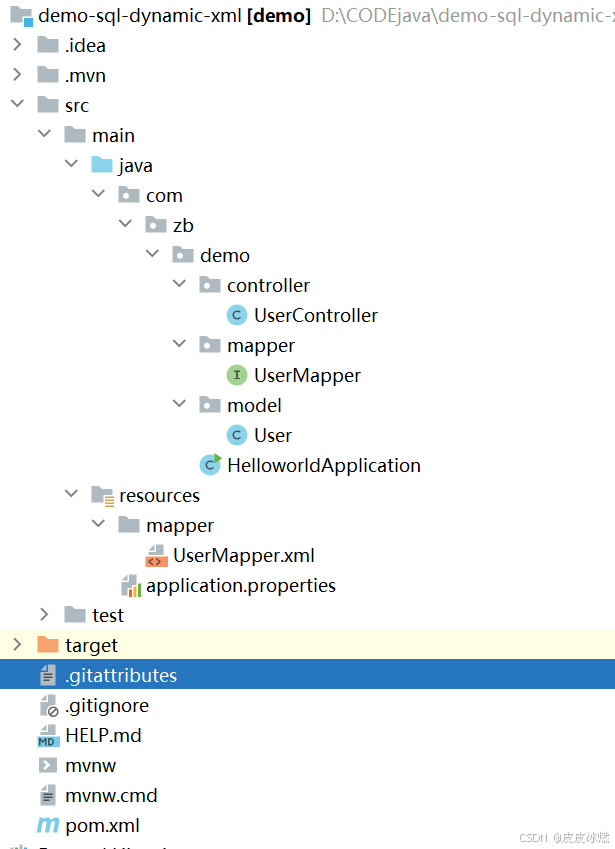

SpringBoot-17-MyBatis动态SQL标签之常用标签

文章目录 1 代码1.1 实体User.java1.2 接口UserMapper.java1.3 映射UserMapper.xml1.3.1 标签if1.3.2 标签if和where1.3.3 标签choose和when和otherwise1.4 UserController.java2 常用动态SQL标签2.1 标签set2.1.1 UserMapper.java2.1.2 UserMapper.xml2.1.3 UserController.ja…

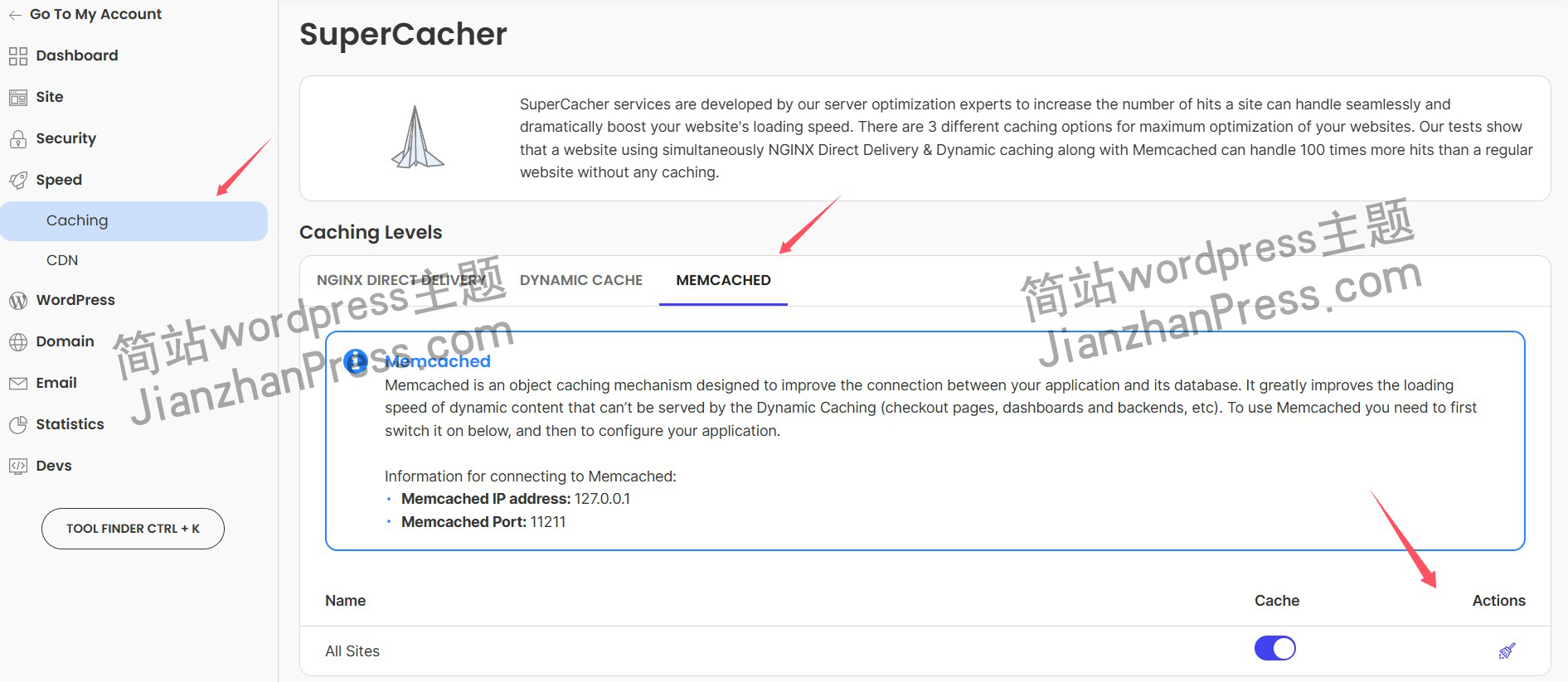

wordpress后台更新后 前端没变化的解决方法

使用siteground主机的wordpress网站,会出现更新了网站内容和修改了php模板文件、js文件、css文件、图片文件后,网站没有变化的情况。

不熟悉siteground主机的新手,遇到这个问题,就很抓狂,明明是哪都没操作错误&#x…

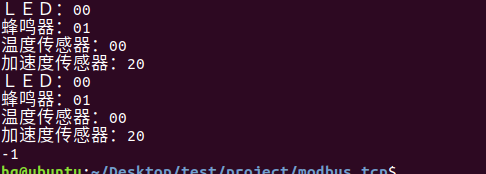

网络编程(Modbus进阶)

思维导图 Modbus RTU(先学一点理论)

概念 Modbus RTU 是工业自动化领域 最广泛应用的串行通信协议,由 Modicon 公司(现施耐德电气)于 1979 年推出。它以 高效率、强健性、易实现的特点成为工业控制系统的通信标准。 包…

UE5 学习系列(二)用户操作界面及介绍

这篇博客是 UE5 学习系列博客的第二篇,在第一篇的基础上展开这篇内容。博客参考的 B 站视频资料和第一篇的链接如下:

【Note】:如果你已经完成安装等操作,可以只执行第一篇博客中 2. 新建一个空白游戏项目 章节操作,重…

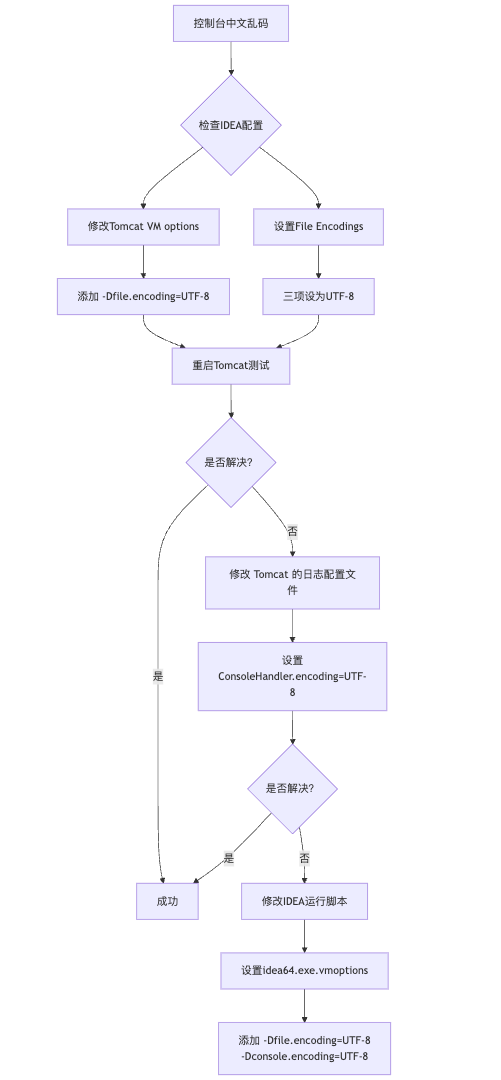

IDEA运行Tomcat出现乱码问题解决汇总

最近正值期末周,有很多同学在写期末Java web作业时,运行tomcat出现乱码问题,经过多次解决与研究,我做了如下整理:

原因:

IDEA本身编码与tomcat的编码与Windows编码不同导致,Windows 系统控制台…

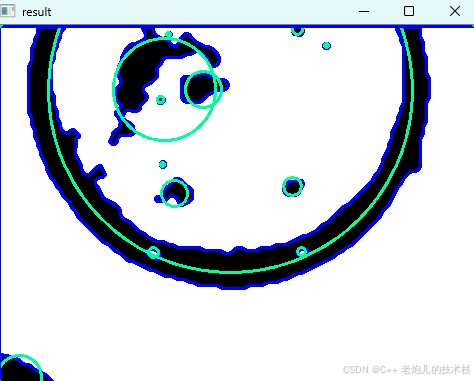

利用最小二乘法找圆心和半径

#include <iostream>

#include <vector>

#include <cmath>

#include <Eigen/Dense> // 需安装Eigen库用于矩阵运算 // 定义点结构

struct Point { double x, y; Point(double x_, double y_) : x(x_), y(y_) {}

}; // 最小二乘法求圆心和半径 …

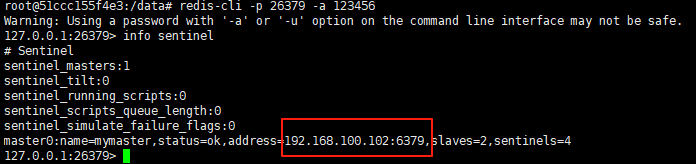

使用docker在3台服务器上搭建基于redis 6.x的一主两从三台均是哨兵模式

一、环境及版本说明

如果服务器已经安装了docker,则忽略此步骤,如果没有安装,则可以按照一下方式安装: 1. 在线安装(有互联网环境): 请看我这篇文章 传送阵>> 点我查看 2. 离线安装(内网环境):请看我这篇文章 传送阵>> 点我查看

说明:假设每台服务器已…

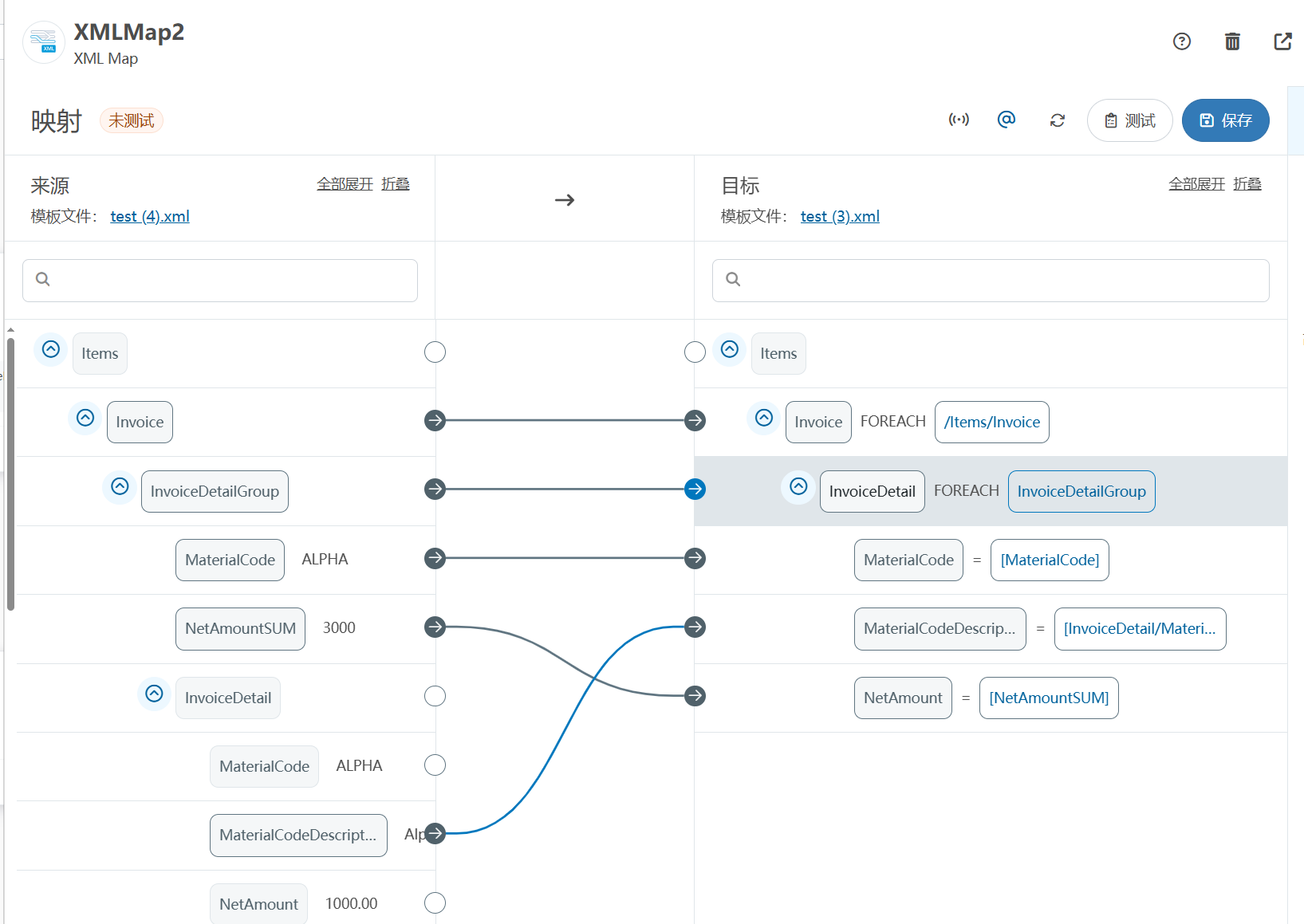

XML Group端口详解

在XML数据映射过程中,经常需要对数据进行分组聚合操作。例如,当处理包含多个物料明细的XML文件时,可能需要将相同物料号的明细归为一组,或对相同物料号的数量进行求和计算。传统实现方式通常需要编写脚本代码,增加了开…

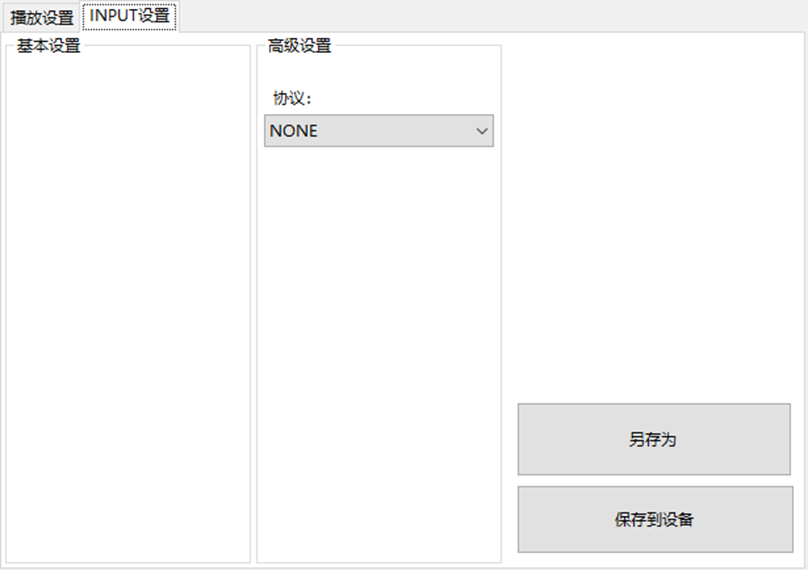

LBE-LEX系列工业语音播放器|预警播报器|喇叭蜂鸣器的上位机配置操作说明

LBE-LEX系列工业语音播放器|预警播报器|喇叭蜂鸣器专为工业环境精心打造,完美适配AGV和无人叉车。同时,集成以太网与语音合成技术,为各类高级系统(如MES、调度系统、库位管理、立库等)提供高效便捷的语音交互体验。

L…

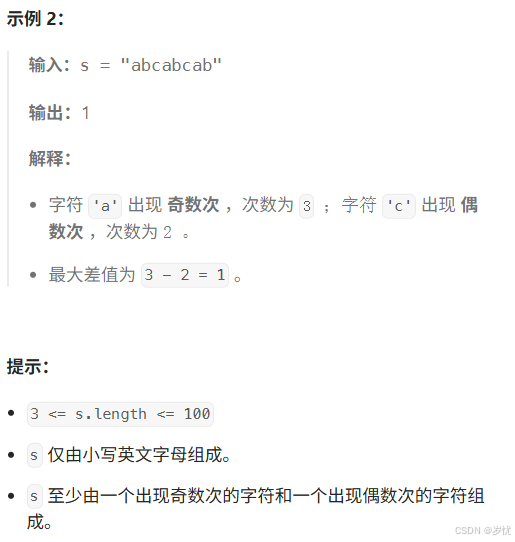

(LeetCode 每日一题) 3442. 奇偶频次间的最大差值 I (哈希、字符串)

题目:3442. 奇偶频次间的最大差值 I 思路 :哈希,时间复杂度0(n)。 用哈希表来记录每个字符串中字符的分布情况,哈希表这里用数组即可实现。

C版本:

class Solution {

public:int maxDifference(string s) {int a[26]…

【大模型RAG】拍照搜题技术架构速览:三层管道、两级检索、兜底大模型

摘要

拍照搜题系统采用“三层管道(多模态 OCR → 语义检索 → 答案渲染)、两级检索(倒排 BM25 向量 HNSW)并以大语言模型兜底”的整体框架: 多模态 OCR 层 将题目图片经过超分、去噪、倾斜校正后,分别用…

【Axure高保真原型】引导弹窗

今天和大家中分享引导弹窗的原型模板,载入页面后,会显示引导弹窗,适用于引导用户使用页面,点击完成后,会显示下一个引导弹窗,直至最后一个引导弹窗完成后进入首页。具体效果可以点击下方视频观看或打开下方…

接口测试中缓存处理策略

在接口测试中,缓存处理策略是一个关键环节,直接影响测试结果的准确性和可靠性。合理的缓存处理策略能够确保测试环境的一致性,避免因缓存数据导致的测试偏差。以下是接口测试中常见的缓存处理策略及其详细说明:

一、缓存处理的核…

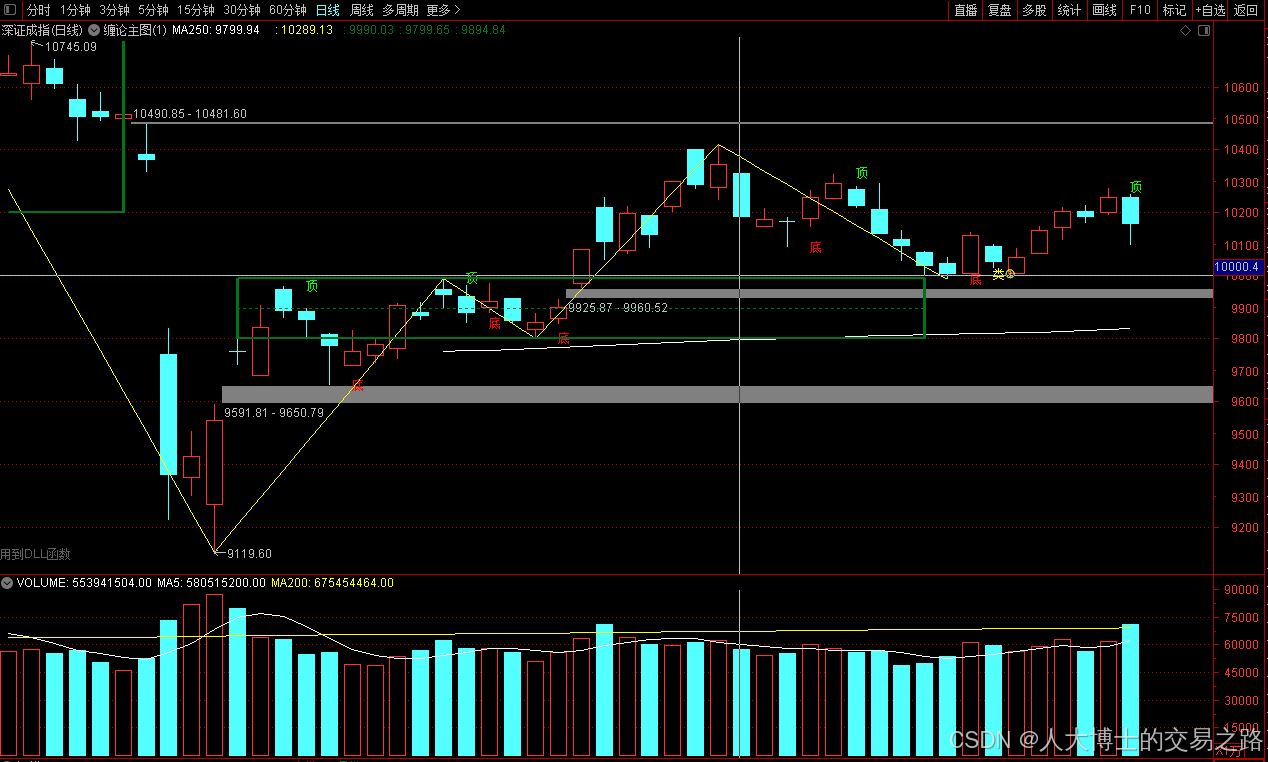

龙虎榜——20250610

上证指数放量收阴线,个股多数下跌,盘中受消息影响大幅波动。 深证指数放量收阴线形成顶分型,指数短线有调整的需求,大概需要一两天。 2025年6月10日龙虎榜行业方向分析 1. 金融科技

代表标的:御银股份、雄帝科技

驱动…

观成科技:隐蔽隧道工具Ligolo-ng加密流量分析

1.工具介绍

Ligolo-ng是一款由go编写的高效隧道工具,该工具基于TUN接口实现其功能,利用反向TCP/TLS连接建立一条隐蔽的通信信道,支持使用Let’s Encrypt自动生成证书。Ligolo-ng的通信隐蔽性体现在其支持多种连接方式,适应复杂网…

铭豹扩展坞 USB转网口 突然无法识别解决方法

当 USB 转网口扩展坞在一台笔记本上无法识别,但在其他电脑上正常工作时,问题通常出在笔记本自身或其与扩展坞的兼容性上。以下是系统化的定位思路和排查步骤,帮助你快速找到故障原因:

背景:

一个M-pard(铭豹)扩展坞的网卡突然无法识别了,扩展出来的三个USB接口正常。…

未来机器人的大脑:如何用神经网络模拟器实现更智能的决策?

编辑:陈萍萍的公主一点人工一点智能 未来机器人的大脑:如何用神经网络模拟器实现更智能的决策?RWM通过双自回归机制有效解决了复合误差、部分可观测性和随机动力学等关键挑战,在不依赖领域特定归纳偏见的条件下实现了卓越的预测准…

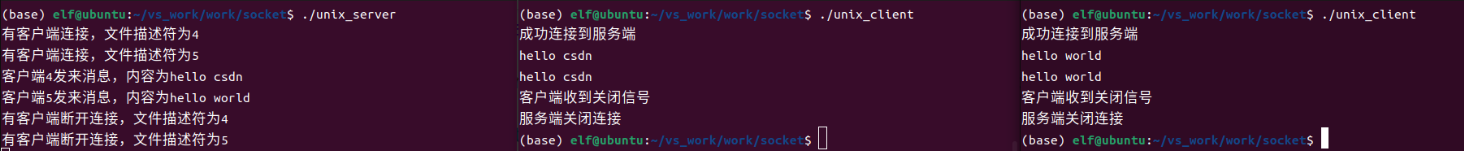

Linux应用开发之网络套接字编程(实例篇)

服务端与客户端单连接

服务端代码

#include <sys/socket.h>

#include <sys/types.h>

#include <netinet/in.h>

#include <stdio.h>

#include <stdlib.h>

#include <string.h>

#include <arpa/inet.h>

#include <pthread.h>

…

华为云AI开发平台ModelArts

华为云ModelArts:重塑AI开发流程的“智能引擎”与“创新加速器”!

在人工智能浪潮席卷全球的2025年,企业拥抱AI的意愿空前高涨,但技术门槛高、流程复杂、资源投入巨大的现实,却让许多创新构想止步于实验室。数据科学家…

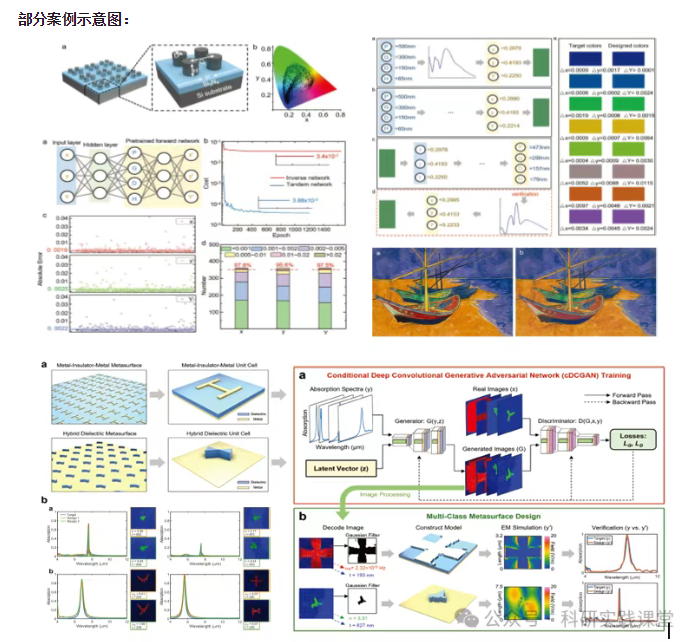

深度学习在微纳光子学中的应用

深度学习在微纳光子学中的主要应用方向

深度学习与微纳光子学的结合主要集中在以下几个方向:

逆向设计 通过神经网络快速预测微纳结构的光学响应,替代传统耗时的数值模拟方法。例如设计超表面、光子晶体等结构。

特征提取与优化 从复杂的光学数据中自…