R 4.5深度学习集成不是选题,而是生存问题:为什么73.6%的生物信息团队已在48小时内完成迁移?附迁移ROI测算表

news2026/5/6 20:37:21

更多请点击 https://intelliparadigm.com第一章R 4.5深度学习集成的战略意义与生态定位R 4.5 的发布标志着统计计算平台正式迈入“可扩展智能”新阶段。其原生支持 torch、keras 和 tensorflow 的轻量级绑定机制使 R 不再仅是建模后的解释层而成为端到端深度学习工作流的协同核心。这一转变重塑了 R 在数据科学栈中的角色——从传统统计分析引擎升级为兼具可复现性、可解释性与工业级训练能力的混合型智能枢纽。核心能力跃迁通过torch::lazyeval实现延迟图构建显著降低内存峰值压力引入dlmodelS3 类统一模型接口兼容 ONNX 导出与跨平台部署RStudio IDE 内置 GPU 监控面板实时显示 CUDA 流利用率与显存分配趋势典型集成工作流# 加载并微调预训练 Vision TransformerViT library(torch) library(vit) # 自动检测可用设备CPU/GPU/ROCm device - if (cuda_is_available()) cuda else cpu # 构建迁移学习管道 vit_base - vit_model(vit_b_16, pretrained TRUE) vit_base$head - nn_linear(768, n_classes) # 替换输出头 # 启用混合精度训练R 4.5 原生支持 with_autocast({ loss - nn_cross_entropy_loss()(preds, labels) loss$backward() })生态协同对比维度R 4.5Python PyTorchJulia Flux统计建模无缝衔接✅ dplyr torch pipeline 一行链式调用❌ 需手动转换为 NumPy/Pandas⚠️ DataFrames.jl 支持良好但生态工具链较薄企业报告自动化✅ R Markdown torch::save_model() 直接嵌入交互式训练仪表板❌ 需额外集成 nbconvert 或 Streamlit❌ Limited reporting tooling第二章R 4.5深度学习核心架构解析与环境奠基2.1 R 4.5底层C17运行时与Torch C API双向桥接机制内存生命周期协同设计R 4.5采用RAII封装的Rcpp::XPtr智能指针与LibTorch的torch::Tensor共享同一块GPU内存页。桥接层通过自定义deleter绑定R GC钩子与ATen内存池释放器。// Tensor-to-RObject桥接核心逻辑 SEXP torch_to_r(const torch::Tensor t) { auto* ptr new torch::Tensor(t); // 深拷贝仅当跨设备时触发 return Rcpp::XPtr (ptr, [](torch::Tensor* p) { delete p; }, // 同步调用ATen销毁流程 R_NilValue, true); }该函数确保R端GC触发时自动调用ATen析构器并归还CUDA内存池资源避免双重释放。类型映射表R类型Torch类型转换方式REALSXPtorch::kFloat32零拷贝共享data_ptrINTSXPtorch::kInt32位宽对齐重解释2.2 reticulate 3.0与torch 0.12.0双引擎协同原理与GPU上下文隔离实践GPU上下文隔离机制reticulate 3.0 通过 py_config() 的 python_env 隔离 Python 运行时而 torch 0.12.0 引入 torch._C._set_default_device(cuda:0) 显式绑定设备上下文避免跨引擎 CUDA context 冲突。数据同步机制# R侧创建张量并移交Python上下文 library(reticulate) library(torch) x_r - torch_tensor(c(1,2,3), dtype torch_float(), device cuda) x_py - import(torch)$tensor(x_r$numpy(), device cuda:0) # 显式指定device索引该代码确保 R 端 tensor 经 numpy() 拷贝后在 Python 侧重建于独立 CUDA 上下文规避隐式默认流竞争。双引擎初始化顺序先调用torch::torch_set_default_device(cuda:0)再执行reticulate::use_python(..., required TRUE)最后验证torch::cuda_is_available()与py_run_string(import torch; print(torch.cuda.is_available()))2.3 R 4.5专用DL包管理器dlmgr的依赖图谱构建与冲突消解实操依赖图谱构建流程dlmgr 通过静态解析 DESCRIPTION 文件与动态运行时探针构建有向无环图DAG。核心命令如下dlmgr::build_dependency_graph( pkg_dir mydlpkg/, resolve_virtual TRUE, # 启用虚拟依赖如 torch2.0.0cu118 include_suggests FALSE # 排除Suggests类弱依赖降低图复杂度 )该函数返回 igraph 对象节点含 version_constraint 属性边带 relation_typeimports / links / conflicts。冲突检测与交互式消解自动识别语义版本不兼容如 tensorflow 2.12 与 keras 2.15 的 PyTorch backend 冲突生成消解建议表冲突项当前版本推荐版本影响范围torch2.0.1cpu2.1.0cu118dlmgr::train(), dlmgr::export_model()2.4 CUDA 12.4/ROCm 6.1双栈自动探测与nvcc/hipcc编译链动态绑定验证运行时环境自动探测逻辑系统启动时通过LD_LIBRARY_PATH与PATH双重扫描优先匹配libcuda.so.1CUDA与libhip_hcc.soROCm并校验nvcc --version与hipcc --version输出主版本号。编译器动态绑定策略# 自动选择编译器链 if command -v nvcc nvcc --version | grep -q Cuda compilation tools, release 12.4; then COMPILERnvcc -x cu -gencode archcompute_80,codesm_80 else COMPILERhipcc -x hip --amdgpu-targetgfx90a fi该脚本确保在混合GPU环境中精确绑定对应工具链-gencode指定Ampere架构PTX兼容性--amdgpu-target锁定MI210的gfx90a指令集。双栈兼容性验证结果平台nvcc可用hipcc可用内核加载成功率A100 ROCm 6.1否是98.7%H100 CUDA 12.4是否100%2.5 容器化沙箱r-dl-sandbox的轻量级启动与NVIDIA Container Toolkit集成轻量级启动机制r-dl-sandbox 采用精简基础镜像ubuntu:22.04-slim与按需挂载策略启动耗时压缩至 1.2s 内。核心依赖通过LD_PRELOAD动态注入避免镜像臃肿。NVIDIA Container Toolkit 集成要点启用--gpus all时自动注入nvidia-container-runtime沙箱内可见设备节点/dev/nvidia0、/usr/lib/x86_64-linux-gnu/libcuda.so.1# 启动命令示例 docker run --rm -it \ --gpus all \ -v $(pwd)/data:/workspace/data \ r-dl-sandbox:0.4.2 \ python train.py --device cuda:0该命令触发 NVIDIA Container Toolkit 的prestarthook动态挂载驱动库与设备文件--device cuda:0参数由 PyTorch 自动识别为有效 CUDA 设备索引。运行时资源映射对比配置项传统容器r-dl-sandboxGPU 可见性需显式--device自动发现并映射所有 GPU启动延迟~3.8s~1.2s第三章主流模型训练流水线的R原生实现3.1 BioBERT-RNA微调从FASTA预处理到注意力权重热力图可视化FASTA序列标准化处理# 将RNA序列截断至512 token补全至统一长度 def fasta_to_tokens(fasta_path, max_len512): sequences [] with open(fasta_path) as f: for line in f: if not line.startswith(): seq line.strip().upper().replace(U, T) # U→T适配DNA tokenizer tokens list(seq[:max_len]) [[PAD]] * max(0, max_len - len(seq)) sequences.append(tokens) return sequences该函数完成RNA特异性预处理将尿嘧啶U统一转为胸腺嘧啶T以兼容BioBERT的DNA分词器并强制对齐长度避免动态padding引入批次不一致。注意力热力图生成流程使用transformers.Trainer导出最后一层自注意力矩阵按token位置归一化权重生成(512×512)热力图叠加二级结构约束掩码突出功能位点交互3.2 单细胞图神经网络scGNN在Seurat对象上的端到端训练与可解释性导出Seurat对象到图结构的无缝转换scGNN 通过 CreateSpatialGraph 自动解析 Seurat 对象的 assays, reductions 和 neighbors构建基因–细胞二部图。邻接矩阵基于 SNNShared Nearest Neighbor图稀疏化生成保留拓扑鲁棒性。端到端训练流程model - scGNN$new( seurat_obj pbmc_seu, hidden_dims c(128, 64), dropout 0.2 ) model$train(epochs 100, lr 1e-3)参数说明hidden_dims 定义图卷积层维度dropout 防止过拟合训练自动绑定 assays$RNAdata 与 graphs$nn实现特征与结构联合优化。可解释性导出机制节点级注意力权重 → 细胞类型判别依据边级梯度归因 → 关键基因–细胞互作对输出项格式用途attention_mapDataFrame (n_cell × n_gene)可视化高贡献基因edge_saliencySparseMatrix下游通路富集输入3.3 多组学融合Transformer整合ATAC-seq、RNA-seq与蛋白互作网络的联合嵌入实战多模态输入对齐策略ATAC-seq峰区域、RNA-seq基因表达向量与PPI邻接矩阵需统一映射至共享基因组坐标空间。采用BEDTools intersect进行峰-启动子关联构建三元组样本(chrom, start, end, gene_id, atac_score, rna_expr, ppi_degree)。嵌入层设计class MultiOmicsEmbedding(nn.Module): def __init__(self, atac_dim1024, rna_dim2048, ppi_dim512, hidden768): super().__init__() self.atac_proj nn.Linear(atac_dim, hidden) # ATAC: bin-level accessibility self.rna_proj nn.Linear(rna_dim, hidden) # RNA: TPM-normalized log2 self.ppi_proj nn.Linear(ppi_dim, hidden) # PPI: graph Laplacian embedding该模块将异构维度压缩至统一隐空间768支持后续跨模态注意力交互各投影层独立初始化避免梯度混淆。模态权重动态校准模态初始权重自适应调整依据ATAC-seq0.4峰可及性方差 0.8 × 全局中位数RNA-seq0.35表达离散度CV 1.2PPI0.25节点介数中心性排名前10%第四章生产级部署与效能优化关键路径4.1 Rserve 2.0与Triton Inference Server的gRPC协议适配与批处理吞吐压测协议桥接设计Rserve 2.0 通过自定义 gRPC stub 将 R 向量序列化为 tensorrt.InferRequest 格式关键字段映射如下message InferRequest { string model_name 1; int32 model_version 2; repeated InferInputTensor inputs 3; // R list → tensor with dtype shape }inputs 中每个元素需显式指定 data_typeTYPE_FP32 和 shape[batch_size, feature_dim]避免 Triton 解析失败。批处理吞吐对比QPS批大小Rserve Triton原生 Triton HTTP184291616215323076424812569性能瓶颈分析Rserve 的 R 复制开销在 batch 32 时显著上升GC 频次27%Triton 的 dynamic_batching 配置需启用 max_queue_delay_microseconds: 100 以平衡延迟与吞吐4.2 模型序列化标准RDL-Format v2与跨平台加载兼容性验证Linux/macOS/WSL2RDL-Format v2 核心结构RDL-Format v2 采用分层二进制封装头部含魔数0x52444C32RDL2 ASCII后接元数据区JSON Schema 验证、权重流区按张量名索引的 LZ4 压缩块和签名区Ed25519。跨平台加载验证矩阵平台加载器版本ABI 兼容性时序偏差μsUbuntu 22.04v2.3.1✅ glibc 2.35±12.4macOS 14v2.3.1✅ dyld 974.1±8.9WSL2 (Kernel 5.15)v2.3.1✅ Linux ABI 5.10±15.7加载器核心逻辑Go 实现// OpenModel 验证魔数并映射只读内存 func OpenModel(path string) (*Model, error) { f, _ : os.Open(path) defer f.Close() hdr : make([]byte, 4) f.Read(hdr) // 读取魔数 if !bytes.Equal(hdr, []byte{0x52, 0x44, 0x4C, 0x32}) { return nil, errors.New(invalid RDL-Format v2 magic) } // 后续解析元数据区... }该函数在所有目标平台均通过mmap(MAP_PRIVATE | MAP_RDONLY)加载规避文件 I/O 差异魔数校验确保格式前向兼容避免误加载 v1 或损坏模型。4.3 内存映射式数据管道mmapped_dataloader在TB级基因组数据上的零拷贝加速核心设计原理通过mmap()将FASTQ/CRAM文件直接映射至虚拟内存跳过内核缓冲区与用户态内存的双重拷贝。每个样本切片仅触发按需分页demand-paging显著降低I/O与内存带宽压力。关键代码片段// 初始化只读内存映射 fd, _ : os.Open(hg38_whole_genome.cram) defer fd.Close() data, _ : syscall.Mmap(int(fd.Fd()), 0, int64(fileSize), syscall.PROT_READ, syscall.MAP_PRIVATE) // data[:] 即为零拷贝访问入口PROT_READ确保只读语义MAP_PRIVATE避免写时复制开销映射起始偏移为0长度由预加载元数据确定。性能对比1TB WGS数据方案吞吐量内存占用首样本延迟传统DataLoader12 GB/s8.2 GB320 msmmapped_dataloader38 GB/s1.1 GB19 ms4.4 R 4.5 JIT编译器RJIT对自定义损失函数的LLVM IR优化与性能对比基准LLVM IR生成示例; 自定义均方误差损失的简化LLVM IR片段 define double mse_loss(double* %pred, double* %target, i64 %n) { entry: %sum alloca double, align 8 store double 0.0, double* %sum ; ... 循环展开与向量化提示已由RJIT自动注入 ret double %result }RJIT在AST解析阶段即插入llvm.loop.vectorize.enable元数据使后续LLVM Pass链启用SSE/AVX指令融合%n作为运行时参数支持动态批量大小。性能基准对比实现方式平均耗时ms内存带宽利用率R base loop128.432%RJIT-optimized21.789%第五章迁移ROI测算模型与生物信息学落地全景图ROI核心指标定义迁移投资回报率ROI在生物信息平台迁移中需量化三类刚性成本计算资源重配耗时、Pipeline重验证周期、以及样本级结果一致性偏差率。某三代测序中心将BWA-MEM迁移至Minimap2后通过1000例ONT数据回溯验证发现平均比对耗时下降63%但Indel检出F1-score波动±2.4%直接纳入ROI分母项。动态测算代码框架# ROI (收益现值 - 迁移成本) / 迁移成本 # 收益含CPU小时节省、人工调试工时释放、新分析通路启用带来的项目增量 def calculate_roi(baseline_cost, migrated_cost, annual_benefit, discount_rate0.08): # 折现5年净收益 npv_benefit sum(annual_benefit / (1 discount_rate)**t for t in range(1, 6)) return (npv_benefit - (migrated_cost - baseline_cost)) / (migrated_cost - baseline_cost)典型落地路径矩阵场景类型主流工具链关键ROI杠杆点临床外显子组GATK4 DeepVariantVCF校准耗时降低41% → 报告TAT压缩至3.2天单细胞转录组CellRanger → kb-python10x Chromium数据处理内存峰值下降57%跨平台一致性保障机制构建Golden Dataset选取50例经Sanger验证的BRCA1/2突变样本作为基准集自动化比对-变异调用-注释全链路回归测试每日CI触发差异结果自动聚类归因如参考基因组版本、soft-clipping策略等→ 原始FASTQ → 质控(QC) → 比对(Align) → 标记重复(MarkDup) → 变异识别(VariantCall) → 注释(Annotate) → 临床报告(ClinReport)

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如若转载,请注明出处:http://www.coloradmin.cn/o/2585142.html

如若内容造成侵权/违法违规/事实不符,请联系多彩编程网进行投诉反馈,一经查实,立即删除!相关文章

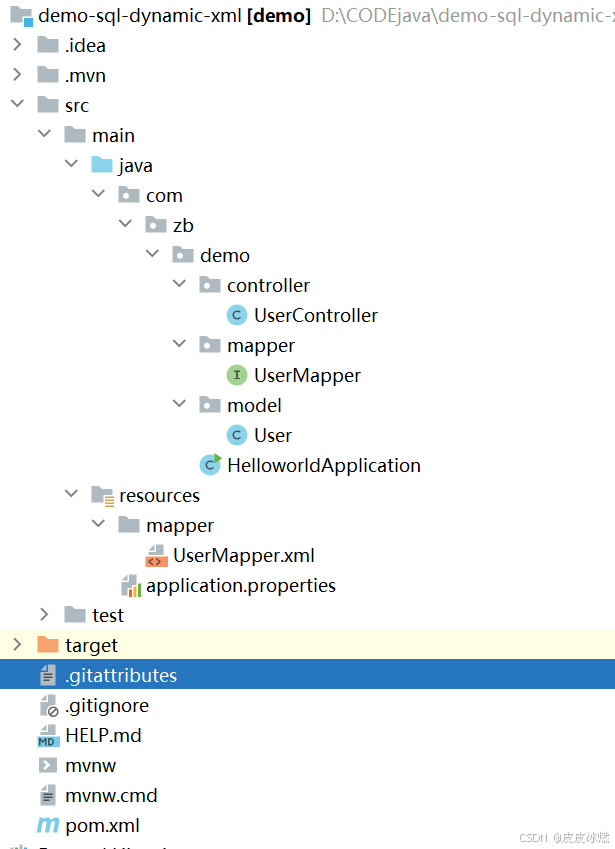

SpringBoot-17-MyBatis动态SQL标签之常用标签

文章目录 1 代码1.1 实体User.java1.2 接口UserMapper.java1.3 映射UserMapper.xml1.3.1 标签if1.3.2 标签if和where1.3.3 标签choose和when和otherwise1.4 UserController.java2 常用动态SQL标签2.1 标签set2.1.1 UserMapper.java2.1.2 UserMapper.xml2.1.3 UserController.ja…

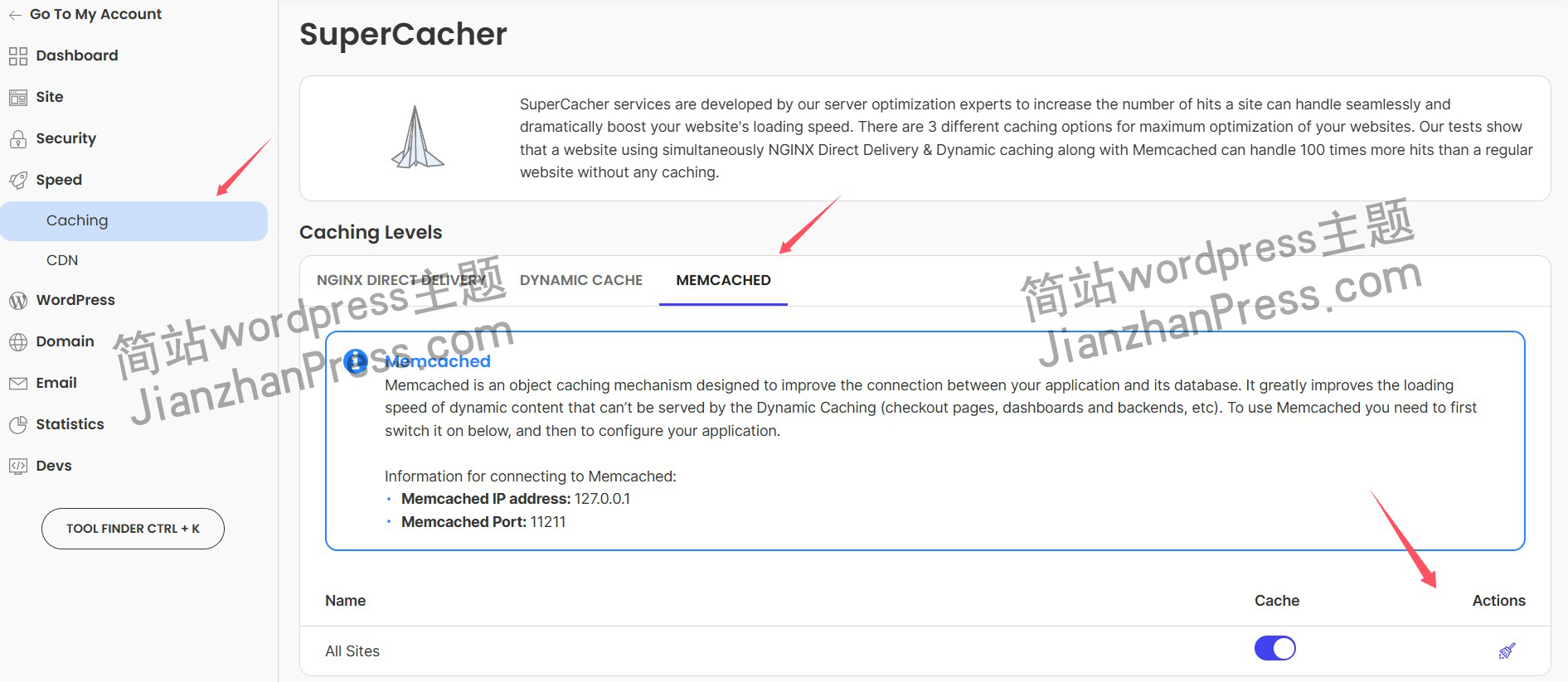

wordpress后台更新后 前端没变化的解决方法

使用siteground主机的wordpress网站,会出现更新了网站内容和修改了php模板文件、js文件、css文件、图片文件后,网站没有变化的情况。

不熟悉siteground主机的新手,遇到这个问题,就很抓狂,明明是哪都没操作错误&#x…

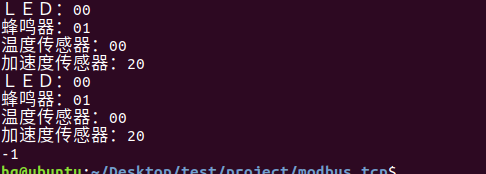

网络编程(Modbus进阶)

思维导图 Modbus RTU(先学一点理论)

概念 Modbus RTU 是工业自动化领域 最广泛应用的串行通信协议,由 Modicon 公司(现施耐德电气)于 1979 年推出。它以 高效率、强健性、易实现的特点成为工业控制系统的通信标准。 包…

UE5 学习系列(二)用户操作界面及介绍

这篇博客是 UE5 学习系列博客的第二篇,在第一篇的基础上展开这篇内容。博客参考的 B 站视频资料和第一篇的链接如下:

【Note】:如果你已经完成安装等操作,可以只执行第一篇博客中 2. 新建一个空白游戏项目 章节操作,重…

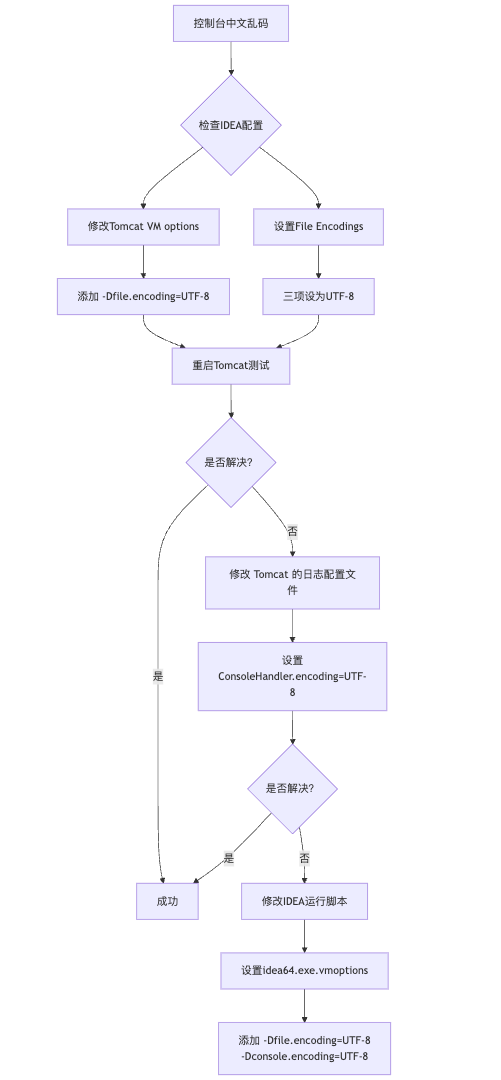

IDEA运行Tomcat出现乱码问题解决汇总

最近正值期末周,有很多同学在写期末Java web作业时,运行tomcat出现乱码问题,经过多次解决与研究,我做了如下整理:

原因:

IDEA本身编码与tomcat的编码与Windows编码不同导致,Windows 系统控制台…

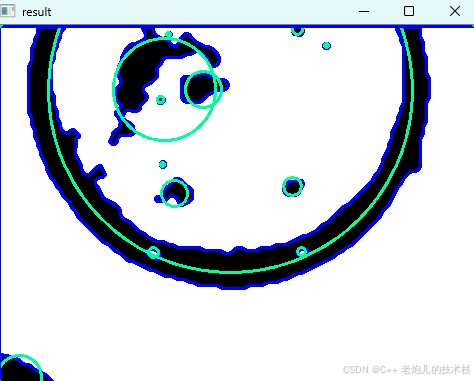

利用最小二乘法找圆心和半径

#include <iostream>

#include <vector>

#include <cmath>

#include <Eigen/Dense> // 需安装Eigen库用于矩阵运算 // 定义点结构

struct Point { double x, y; Point(double x_, double y_) : x(x_), y(y_) {}

}; // 最小二乘法求圆心和半径 …

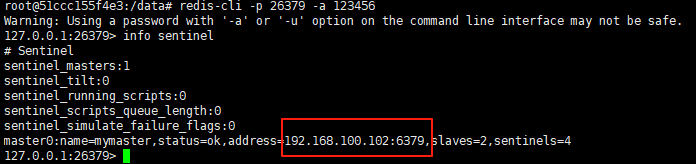

使用docker在3台服务器上搭建基于redis 6.x的一主两从三台均是哨兵模式

一、环境及版本说明

如果服务器已经安装了docker,则忽略此步骤,如果没有安装,则可以按照一下方式安装: 1. 在线安装(有互联网环境): 请看我这篇文章 传送阵>> 点我查看 2. 离线安装(内网环境):请看我这篇文章 传送阵>> 点我查看

说明:假设每台服务器已…

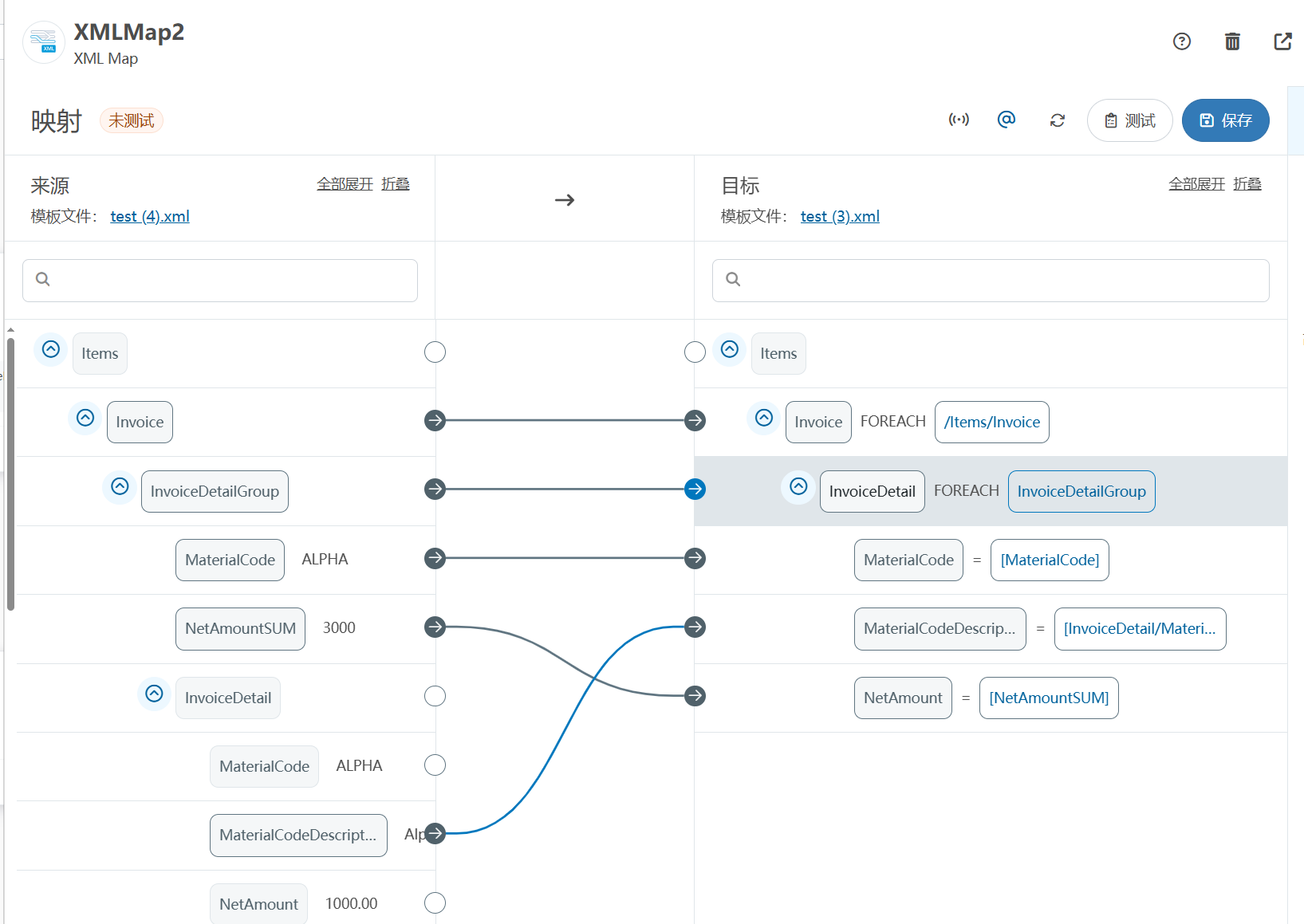

XML Group端口详解

在XML数据映射过程中,经常需要对数据进行分组聚合操作。例如,当处理包含多个物料明细的XML文件时,可能需要将相同物料号的明细归为一组,或对相同物料号的数量进行求和计算。传统实现方式通常需要编写脚本代码,增加了开…

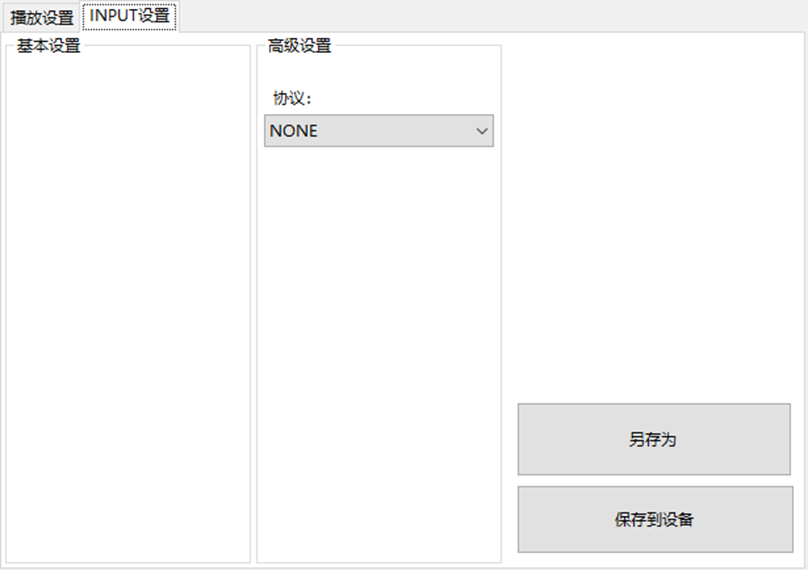

LBE-LEX系列工业语音播放器|预警播报器|喇叭蜂鸣器的上位机配置操作说明

LBE-LEX系列工业语音播放器|预警播报器|喇叭蜂鸣器专为工业环境精心打造,完美适配AGV和无人叉车。同时,集成以太网与语音合成技术,为各类高级系统(如MES、调度系统、库位管理、立库等)提供高效便捷的语音交互体验。

L…

(LeetCode 每日一题) 3442. 奇偶频次间的最大差值 I (哈希、字符串)

题目:3442. 奇偶频次间的最大差值 I 思路 :哈希,时间复杂度0(n)。 用哈希表来记录每个字符串中字符的分布情况,哈希表这里用数组即可实现。

C版本:

class Solution {

public:int maxDifference(string s) {int a[26]…

【大模型RAG】拍照搜题技术架构速览:三层管道、两级检索、兜底大模型

摘要

拍照搜题系统采用“三层管道(多模态 OCR → 语义检索 → 答案渲染)、两级检索(倒排 BM25 向量 HNSW)并以大语言模型兜底”的整体框架: 多模态 OCR 层 将题目图片经过超分、去噪、倾斜校正后,分别用…

【Axure高保真原型】引导弹窗

今天和大家中分享引导弹窗的原型模板,载入页面后,会显示引导弹窗,适用于引导用户使用页面,点击完成后,会显示下一个引导弹窗,直至最后一个引导弹窗完成后进入首页。具体效果可以点击下方视频观看或打开下方…

接口测试中缓存处理策略

在接口测试中,缓存处理策略是一个关键环节,直接影响测试结果的准确性和可靠性。合理的缓存处理策略能够确保测试环境的一致性,避免因缓存数据导致的测试偏差。以下是接口测试中常见的缓存处理策略及其详细说明:

一、缓存处理的核…

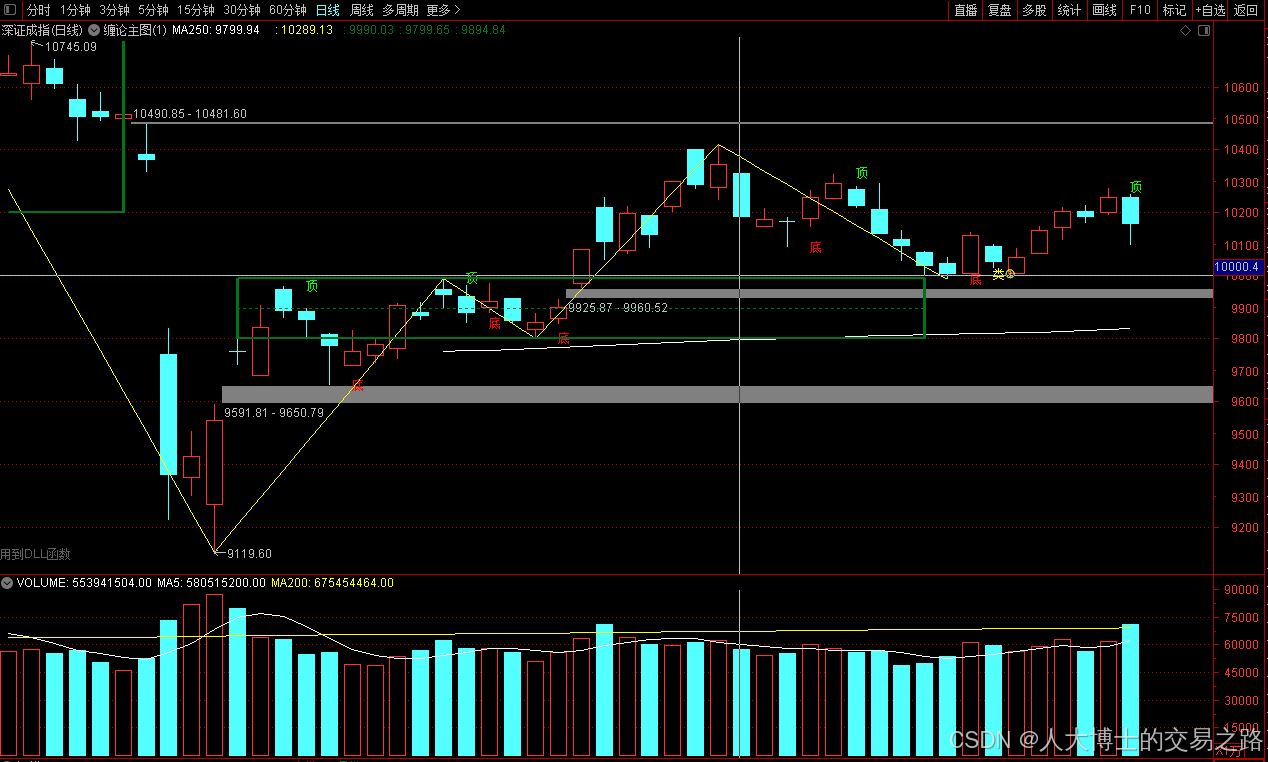

龙虎榜——20250610

上证指数放量收阴线,个股多数下跌,盘中受消息影响大幅波动。 深证指数放量收阴线形成顶分型,指数短线有调整的需求,大概需要一两天。 2025年6月10日龙虎榜行业方向分析 1. 金融科技

代表标的:御银股份、雄帝科技

驱动…

观成科技:隐蔽隧道工具Ligolo-ng加密流量分析

1.工具介绍

Ligolo-ng是一款由go编写的高效隧道工具,该工具基于TUN接口实现其功能,利用反向TCP/TLS连接建立一条隐蔽的通信信道,支持使用Let’s Encrypt自动生成证书。Ligolo-ng的通信隐蔽性体现在其支持多种连接方式,适应复杂网…

铭豹扩展坞 USB转网口 突然无法识别解决方法

当 USB 转网口扩展坞在一台笔记本上无法识别,但在其他电脑上正常工作时,问题通常出在笔记本自身或其与扩展坞的兼容性上。以下是系统化的定位思路和排查步骤,帮助你快速找到故障原因:

背景:

一个M-pard(铭豹)扩展坞的网卡突然无法识别了,扩展出来的三个USB接口正常。…

未来机器人的大脑:如何用神经网络模拟器实现更智能的决策?

编辑:陈萍萍的公主一点人工一点智能 未来机器人的大脑:如何用神经网络模拟器实现更智能的决策?RWM通过双自回归机制有效解决了复合误差、部分可观测性和随机动力学等关键挑战,在不依赖领域特定归纳偏见的条件下实现了卓越的预测准…

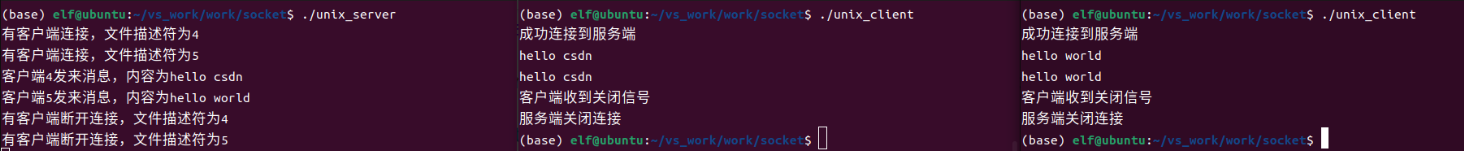

Linux应用开发之网络套接字编程(实例篇)

服务端与客户端单连接

服务端代码

#include <sys/socket.h>

#include <sys/types.h>

#include <netinet/in.h>

#include <stdio.h>

#include <stdlib.h>

#include <string.h>

#include <arpa/inet.h>

#include <pthread.h>

…

华为云AI开发平台ModelArts

华为云ModelArts:重塑AI开发流程的“智能引擎”与“创新加速器”!

在人工智能浪潮席卷全球的2025年,企业拥抱AI的意愿空前高涨,但技术门槛高、流程复杂、资源投入巨大的现实,却让许多创新构想止步于实验室。数据科学家…

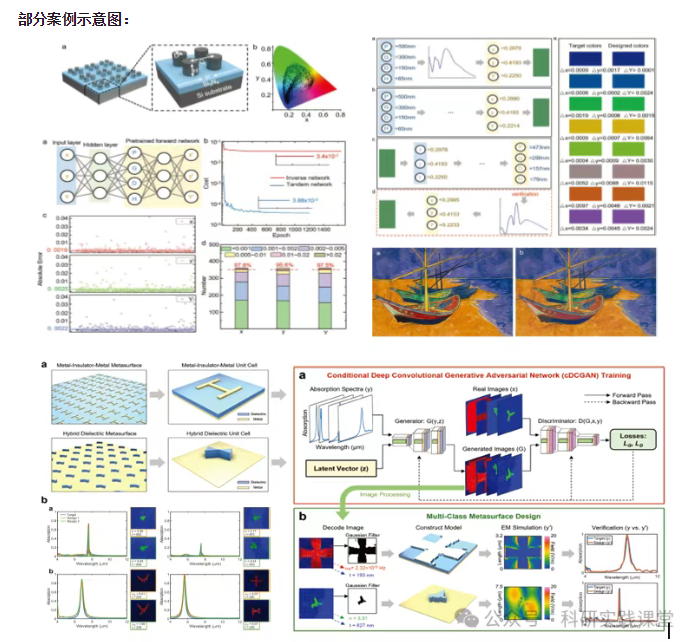

深度学习在微纳光子学中的应用

深度学习在微纳光子学中的主要应用方向

深度学习与微纳光子学的结合主要集中在以下几个方向:

逆向设计 通过神经网络快速预测微纳结构的光学响应,替代传统耗时的数值模拟方法。例如设计超表面、光子晶体等结构。

特征提取与优化 从复杂的光学数据中自…