自蒸馏策略优化(SDPO)原理与实践

news2026/5/5 2:52:49

1. 项目概述在强化学习领域策略优化一直是核心挑战之一。传统方法往往面临样本效率低、训练不稳定等问题。自蒸馏策略优化(Self-Distillation Policy Optimization, SDPO)技术通过让智能体自我学习的方式显著提升了策略优化的效率和稳定性。这项技术最早由DeepMind团队在2022年提出现已成为深度强化学习领域的重要研究方向。SDPO的核心思想借鉴了知识蒸馏的概念但创新性地将其应用于强化学习场景。不同于传统的师生模型SDPO让同一个智能体在不同训练阶段扮演教师和学生双重角色通过迭代式的自我知识提炼实现策略的持续优化。这种方法特别适合解决稀疏奖励、长期依赖等复杂强化学习问题。2. 技术原理深度解析2.1 自蒸馏的基本框架自蒸馏策略优化的核心在于构建一个闭环学习系统。系统包含三个关键组件策略网络(π): 负责在环境中采取行动价值网络(V): 评估状态或状态-动作对的价值蒸馏损失函数: 衡量新旧策略间的差异典型的SDPO迭代过程如下使用当前策略πₜ与环境交互收集经验数据基于收集的数据计算优势函数Aₜ通过优化蒸馏目标更新策略得到πₜ₊₁重复上述过程直至收敛2.2 关键数学公式SDPO的核心优化目标结合了传统的策略梯度与蒸馏损失L(θ) [log πθ(a|s) A(s,a)] λ DKL(πθ_old || πθ)其中第一项是标准的策略梯度目标第二项是KL散度蒸馏损失λ是平衡两项的超参数这个目标函数确保了新策略既能提升预期回报又不会偏离旧策略太远从而保证了训练的稳定性。2.3 与PPO的对比分析SDPO与PPO(Proximal Policy Optimization)有着相似的出发点但实现机制存在重要差异特性PPOSDPO约束方式剪切概率比KL散度蒸馏样本效率中等较高训练稳定性较好优秀实现复杂度较低中等适用场景通用复杂环境3. 实现细节与工程实践3.1 网络架构设计在实际实现中SDPO通常采用双网络架构class SDPOPolicy(nn.Module): def __init__(self, obs_dim, act_dim): super().__init__() # 共享的特征提取层 self.feature_extractor nn.Sequential( nn.Linear(obs_dim, 64), nn.ReLU(), nn.Linear(64, 64), nn.ReLU() ) # 策略头 self.policy_head nn.Sequential( nn.Linear(64, act_dim), nn.Softmax(dim-1) ) # 价值头 self.value_head nn.Linear(64, 1)这种设计允许特征共享同时保持策略和价值估计的独立性。3.2 训练流程实现完整的SDPO训练流程包含以下关键步骤数据收集阶段:def collect_rollouts(env, policy, n_steps): obs env.reset() experiences [] for _ in range(n_steps): action policy.sample_action(obs) next_obs, reward, done, _ env.step(action) experiences.append((obs, action, reward, done)) obs next_obs if not done else env.reset() return experiences优势估计:def compute_advantages(rewards, values, gamma0.99, lam0.95): advantages np.zeros_like(rewards) last_advantage 0 for t in reversed(range(len(rewards))): delta rewards[t] gamma * values[t1] * (1-dones[t]) - values[t] advantages[t] delta gamma * lam * (1-dones[t]) * last_advantage last_advantage advantages[t] return advantages策略更新:def update_policy(policy, optimizer, experiences, clip_param0.2): obs, actions, old_log_probs, advantages experiences # 计算新策略的概率 new_probs policy(obs) new_log_probs torch.log(new_probs.gather(1, actions)) # 计算概率比 ratios torch.exp(new_log_probs - old_log_probs) # 计算策略损失 policy_loss -torch.min(ratios * advantages, torch.clamp(ratios, 1-clip_param, 1clip_param) * advantages).mean() # 计算蒸馏损失 kl_loss F.kl_div(torch.log(new_probs), old_probs, reductionbatchmean) # 总损失 loss policy_loss 0.1 * kl_loss optimizer.zero_grad() loss.backward() optimizer.step()3.3 超参数调优经验根据实践经验以下超参数设置通常能取得较好效果学习率: 3e-4 (使用Adam优化器)KL散度权重(λ): 0.1-0.3折扣因子(γ): 0.99GAE参数(λ): 0.95批量大小: 64-256训练epoch数: 3-5重要提示KL散度权重的选择需要特别注意。过大会导致策略更新过于保守过小则可能失去蒸馏的正则化效果。建议从0.1开始根据验证集表现调整。4. 应用场景与性能表现4.1 典型应用场景SDPO特别适合以下类型的强化学习问题稀疏奖励环境如Montezumas Revenge等Atari游戏长期依赖任务需要多步规划的问题连续控制问题如机器人控制、自动驾驶多智能体系统需要稳定策略更新的场景4.2 基准测试结果在标准测试环境上的表现对比环境PPO得分SDPO得分提升幅度CartPole-v15005000%LunarLander25028012%Atari Breakout40052030%Mujoco Hopper3000350016.7%从结果可以看出在复杂环境中SDPO的优势更为明显。5. 常见问题与解决方案5.1 训练不稳定问题现象回报曲线出现剧烈波动可能原因KL散度权重设置不当学习率过高批量大小太小解决方案逐步降低KL散度权重观察训练曲线使用学习率warmup策略增加批量大小或减少并行环境数量5.2 策略收敛缓慢现象训练多轮后性能提升不明显可能原因蒸馏损失主导了优化过程优势估计不准确网络容量不足解决方案降低KL散度权重检查优势估计的计算过程增加网络层数或神经元数量5.3 过拟合问题现象训练性能很好但测试性能差可能原因策略更新过于激进缺乏足够的探索解决方案增加KL散度权重在策略中引入熵正则化项使用更保守的剪切参数6. 高级技巧与优化方向6.1 课程学习策略将SDPO与课程学习结合可以进一步提升性能从简单任务开始训练逐步增加环境难度在每阶段使用SDPO进行策略优化这种方法特别适合具有层次结构的复杂任务。6.2 混合探索策略结合多种探索方法可以改善SDPO的探索效率初始阶段使用高熵策略鼓励探索中期阶段逐步降低温度参数后期阶段主要依赖SDPO进行优化6.3 分布式实现大规模SDPO实现建议采用以下架构中央参数服务器存储全局策略多个worker并行收集经验定期同步策略参数异步更新蒸馏目标这种架构可以显著提升样本收集效率。

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如若转载,请注明出处:http://www.coloradmin.cn/o/2583641.html

如若内容造成侵权/违法违规/事实不符,请联系多彩编程网进行投诉反馈,一经查实,立即删除!相关文章

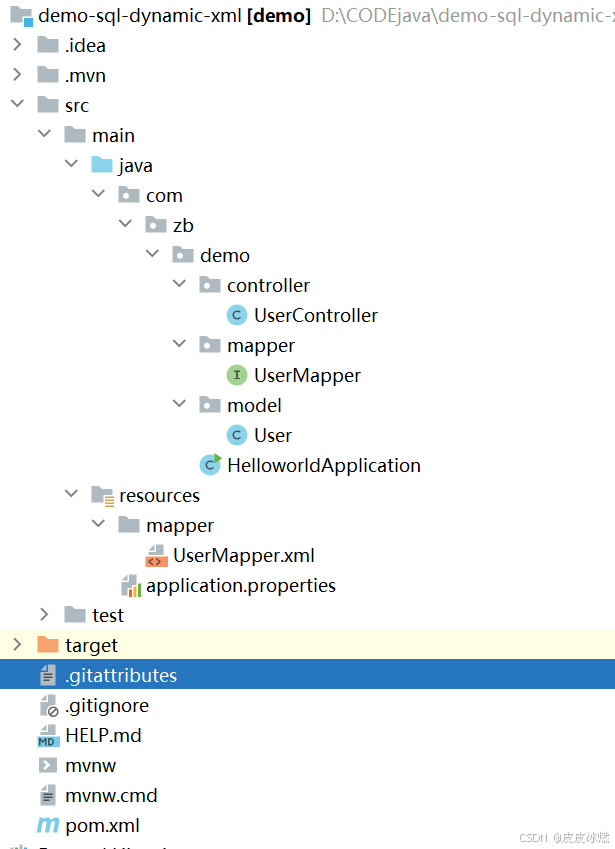

SpringBoot-17-MyBatis动态SQL标签之常用标签

文章目录 1 代码1.1 实体User.java1.2 接口UserMapper.java1.3 映射UserMapper.xml1.3.1 标签if1.3.2 标签if和where1.3.3 标签choose和when和otherwise1.4 UserController.java2 常用动态SQL标签2.1 标签set2.1.1 UserMapper.java2.1.2 UserMapper.xml2.1.3 UserController.ja…

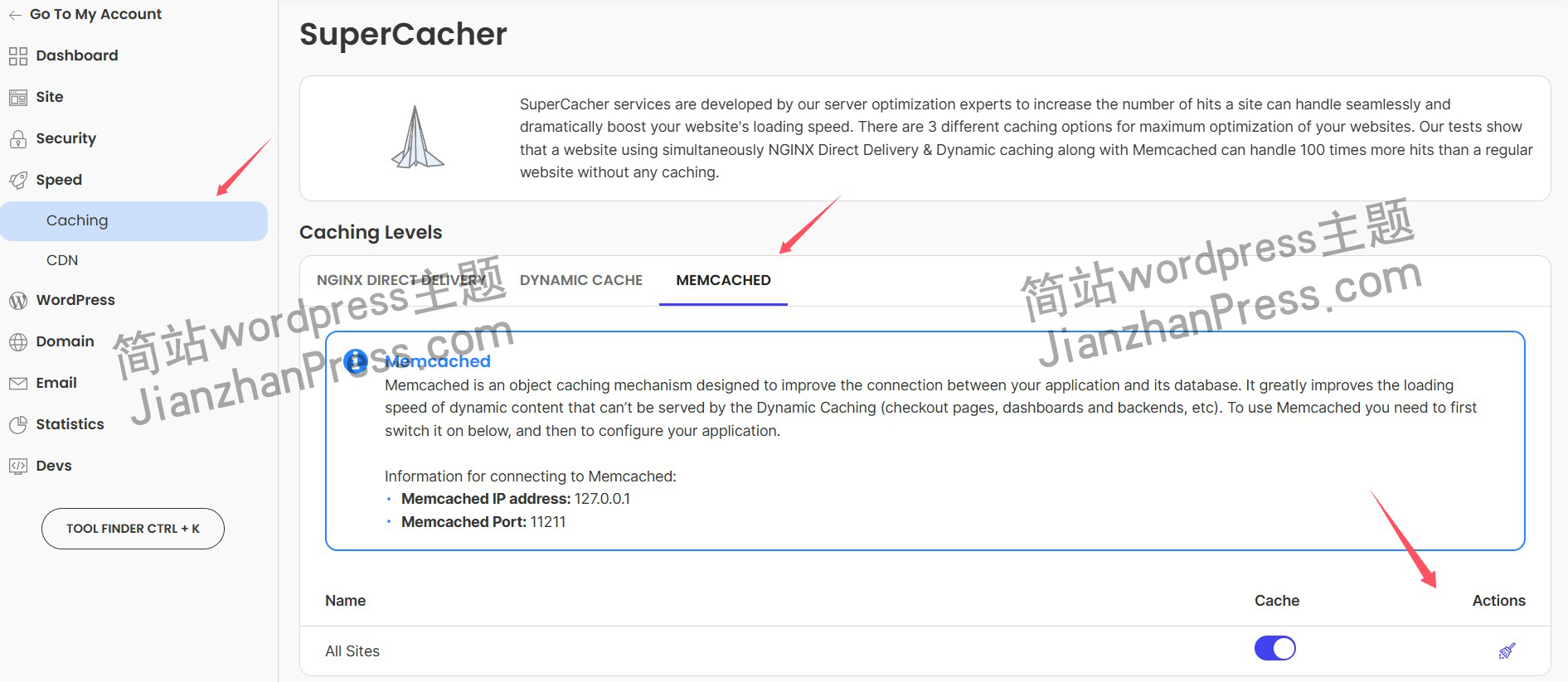

wordpress后台更新后 前端没变化的解决方法

使用siteground主机的wordpress网站,会出现更新了网站内容和修改了php模板文件、js文件、css文件、图片文件后,网站没有变化的情况。

不熟悉siteground主机的新手,遇到这个问题,就很抓狂,明明是哪都没操作错误&#x…

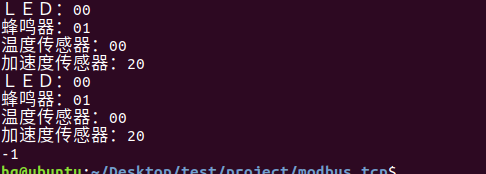

网络编程(Modbus进阶)

思维导图 Modbus RTU(先学一点理论)

概念 Modbus RTU 是工业自动化领域 最广泛应用的串行通信协议,由 Modicon 公司(现施耐德电气)于 1979 年推出。它以 高效率、强健性、易实现的特点成为工业控制系统的通信标准。 包…

UE5 学习系列(二)用户操作界面及介绍

这篇博客是 UE5 学习系列博客的第二篇,在第一篇的基础上展开这篇内容。博客参考的 B 站视频资料和第一篇的链接如下:

【Note】:如果你已经完成安装等操作,可以只执行第一篇博客中 2. 新建一个空白游戏项目 章节操作,重…

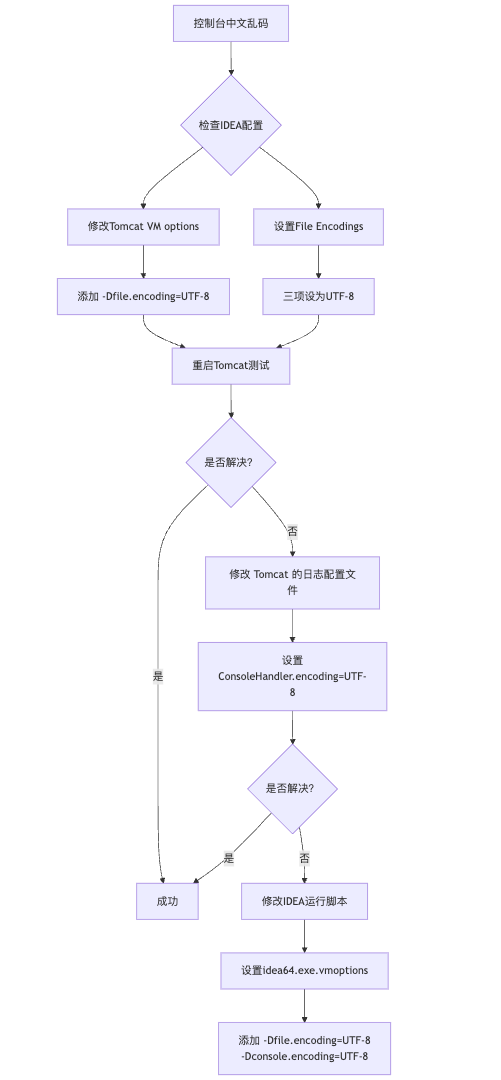

IDEA运行Tomcat出现乱码问题解决汇总

最近正值期末周,有很多同学在写期末Java web作业时,运行tomcat出现乱码问题,经过多次解决与研究,我做了如下整理:

原因:

IDEA本身编码与tomcat的编码与Windows编码不同导致,Windows 系统控制台…

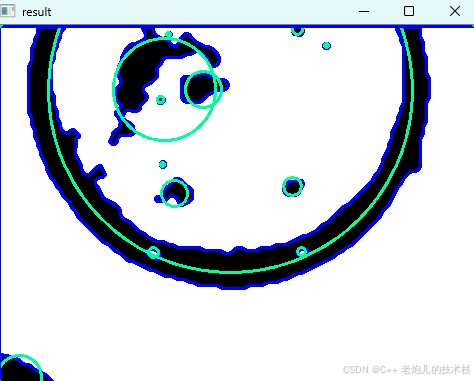

利用最小二乘法找圆心和半径

#include <iostream>

#include <vector>

#include <cmath>

#include <Eigen/Dense> // 需安装Eigen库用于矩阵运算 // 定义点结构

struct Point { double x, y; Point(double x_, double y_) : x(x_), y(y_) {}

}; // 最小二乘法求圆心和半径 …

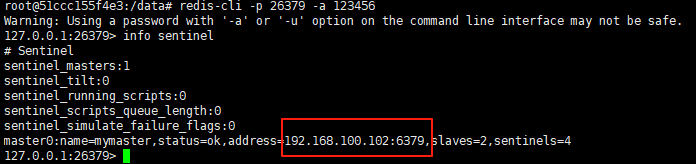

使用docker在3台服务器上搭建基于redis 6.x的一主两从三台均是哨兵模式

一、环境及版本说明

如果服务器已经安装了docker,则忽略此步骤,如果没有安装,则可以按照一下方式安装: 1. 在线安装(有互联网环境): 请看我这篇文章 传送阵>> 点我查看 2. 离线安装(内网环境):请看我这篇文章 传送阵>> 点我查看

说明:假设每台服务器已…

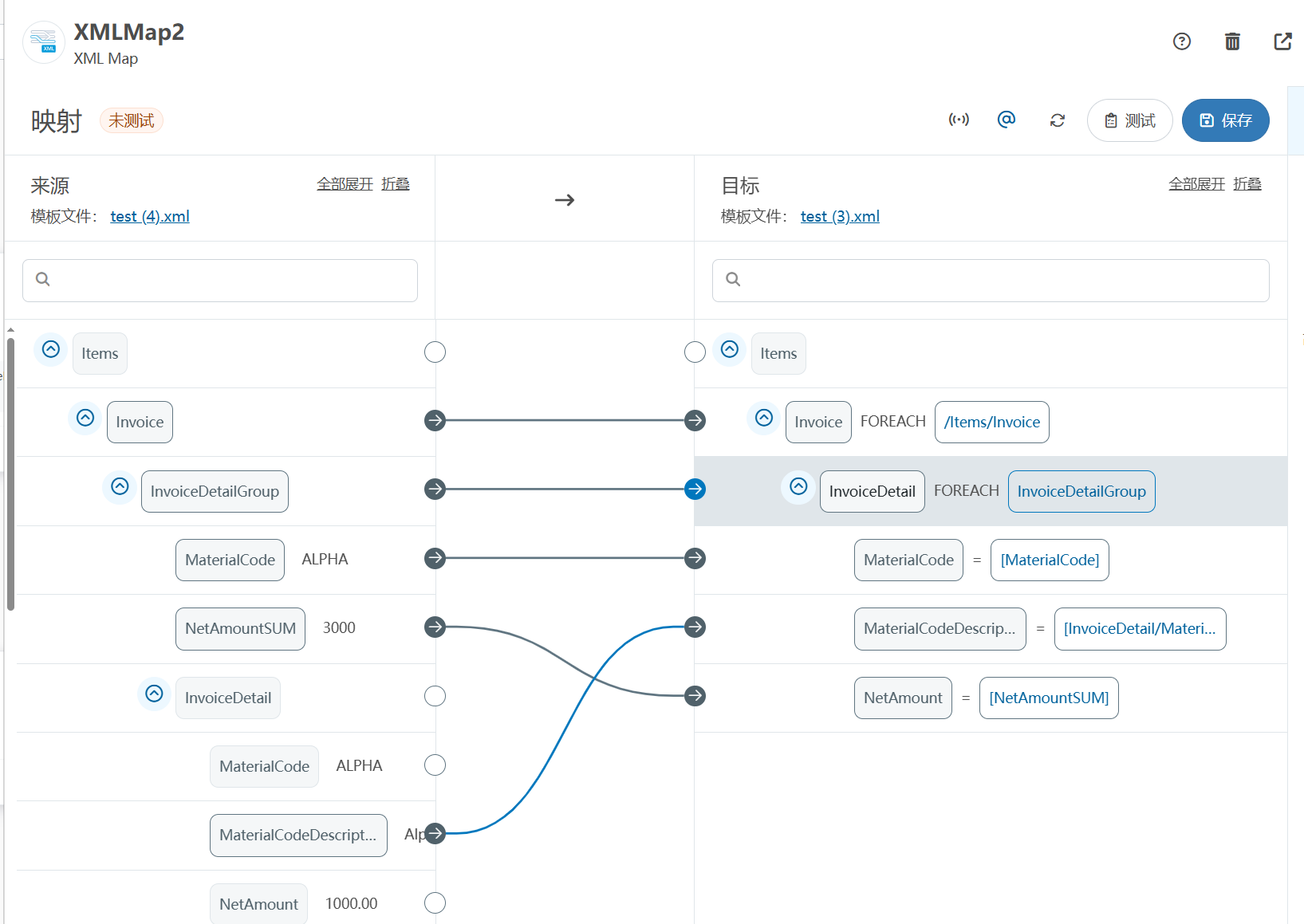

XML Group端口详解

在XML数据映射过程中,经常需要对数据进行分组聚合操作。例如,当处理包含多个物料明细的XML文件时,可能需要将相同物料号的明细归为一组,或对相同物料号的数量进行求和计算。传统实现方式通常需要编写脚本代码,增加了开…

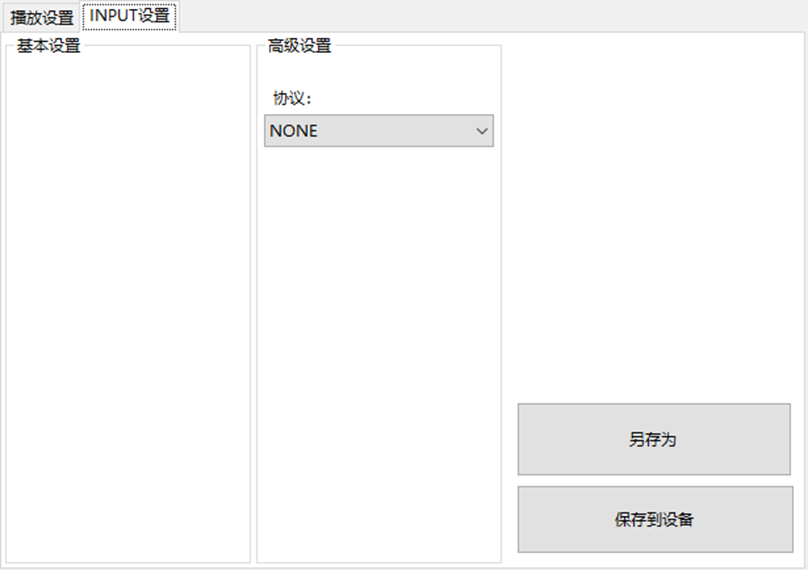

LBE-LEX系列工业语音播放器|预警播报器|喇叭蜂鸣器的上位机配置操作说明

LBE-LEX系列工业语音播放器|预警播报器|喇叭蜂鸣器专为工业环境精心打造,完美适配AGV和无人叉车。同时,集成以太网与语音合成技术,为各类高级系统(如MES、调度系统、库位管理、立库等)提供高效便捷的语音交互体验。

L…

(LeetCode 每日一题) 3442. 奇偶频次间的最大差值 I (哈希、字符串)

题目:3442. 奇偶频次间的最大差值 I 思路 :哈希,时间复杂度0(n)。 用哈希表来记录每个字符串中字符的分布情况,哈希表这里用数组即可实现。

C版本:

class Solution {

public:int maxDifference(string s) {int a[26]…

【大模型RAG】拍照搜题技术架构速览:三层管道、两级检索、兜底大模型

摘要

拍照搜题系统采用“三层管道(多模态 OCR → 语义检索 → 答案渲染)、两级检索(倒排 BM25 向量 HNSW)并以大语言模型兜底”的整体框架: 多模态 OCR 层 将题目图片经过超分、去噪、倾斜校正后,分别用…

【Axure高保真原型】引导弹窗

今天和大家中分享引导弹窗的原型模板,载入页面后,会显示引导弹窗,适用于引导用户使用页面,点击完成后,会显示下一个引导弹窗,直至最后一个引导弹窗完成后进入首页。具体效果可以点击下方视频观看或打开下方…

接口测试中缓存处理策略

在接口测试中,缓存处理策略是一个关键环节,直接影响测试结果的准确性和可靠性。合理的缓存处理策略能够确保测试环境的一致性,避免因缓存数据导致的测试偏差。以下是接口测试中常见的缓存处理策略及其详细说明:

一、缓存处理的核…

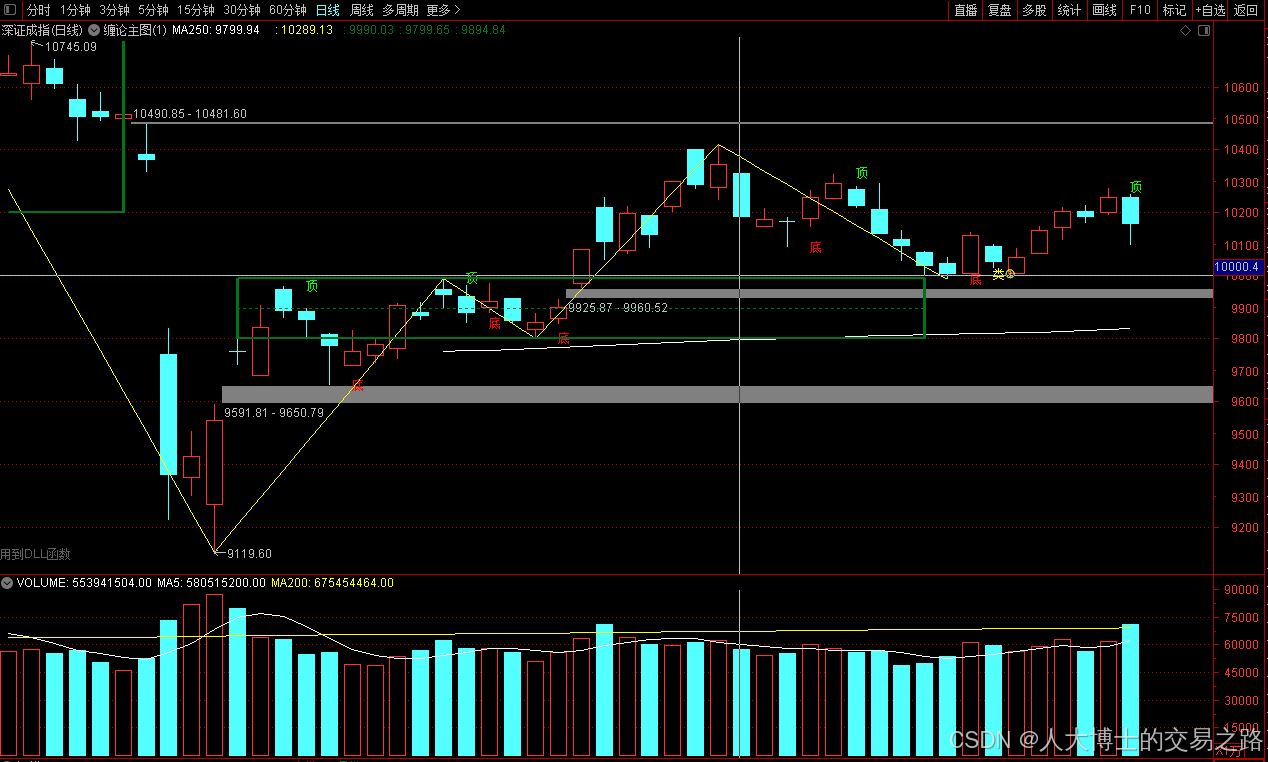

龙虎榜——20250610

上证指数放量收阴线,个股多数下跌,盘中受消息影响大幅波动。 深证指数放量收阴线形成顶分型,指数短线有调整的需求,大概需要一两天。 2025年6月10日龙虎榜行业方向分析 1. 金融科技

代表标的:御银股份、雄帝科技

驱动…

观成科技:隐蔽隧道工具Ligolo-ng加密流量分析

1.工具介绍

Ligolo-ng是一款由go编写的高效隧道工具,该工具基于TUN接口实现其功能,利用反向TCP/TLS连接建立一条隐蔽的通信信道,支持使用Let’s Encrypt自动生成证书。Ligolo-ng的通信隐蔽性体现在其支持多种连接方式,适应复杂网…

铭豹扩展坞 USB转网口 突然无法识别解决方法

当 USB 转网口扩展坞在一台笔记本上无法识别,但在其他电脑上正常工作时,问题通常出在笔记本自身或其与扩展坞的兼容性上。以下是系统化的定位思路和排查步骤,帮助你快速找到故障原因:

背景:

一个M-pard(铭豹)扩展坞的网卡突然无法识别了,扩展出来的三个USB接口正常。…

未来机器人的大脑:如何用神经网络模拟器实现更智能的决策?

编辑:陈萍萍的公主一点人工一点智能 未来机器人的大脑:如何用神经网络模拟器实现更智能的决策?RWM通过双自回归机制有效解决了复合误差、部分可观测性和随机动力学等关键挑战,在不依赖领域特定归纳偏见的条件下实现了卓越的预测准…

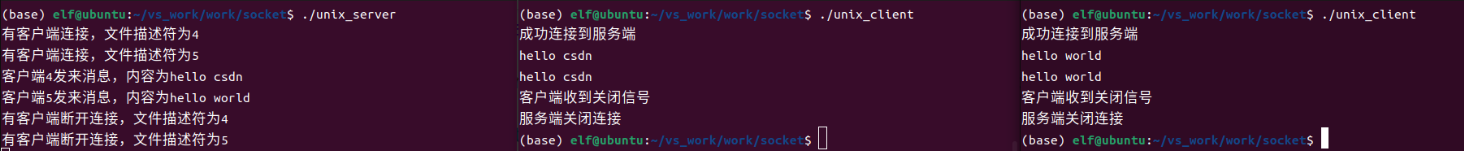

Linux应用开发之网络套接字编程(实例篇)

服务端与客户端单连接

服务端代码

#include <sys/socket.h>

#include <sys/types.h>

#include <netinet/in.h>

#include <stdio.h>

#include <stdlib.h>

#include <string.h>

#include <arpa/inet.h>

#include <pthread.h>

…

华为云AI开发平台ModelArts

华为云ModelArts:重塑AI开发流程的“智能引擎”与“创新加速器”!

在人工智能浪潮席卷全球的2025年,企业拥抱AI的意愿空前高涨,但技术门槛高、流程复杂、资源投入巨大的现实,却让许多创新构想止步于实验室。数据科学家…

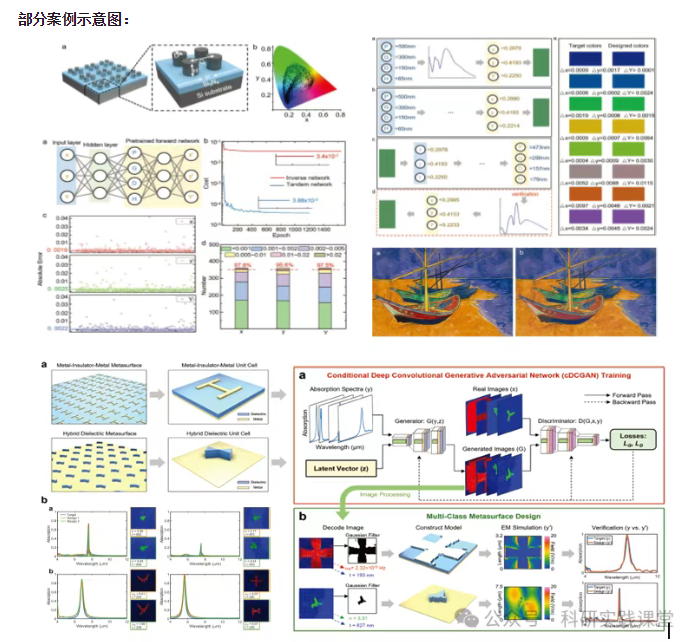

深度学习在微纳光子学中的应用

深度学习在微纳光子学中的主要应用方向

深度学习与微纳光子学的结合主要集中在以下几个方向:

逆向设计 通过神经网络快速预测微纳结构的光学响应,替代传统耗时的数值模拟方法。例如设计超表面、光子晶体等结构。

特征提取与优化 从复杂的光学数据中自…