Java开发者必看:Istio 1.22正式弃用Mixer后,Prometheus指标丢失、日志脱节、Tracing断链问题的90分钟极速修复方案

news2026/3/31 6:56:59

第一章Java开发者必看Istio 1.22正式弃用Mixer后Prometheus指标丢失、日志脱节、Tracing断链问题的90分钟极速修复方案Istio 1.22 彻底移除了 Mixer 组件导致依赖其适配器模型的遥测采集链路全面失效。Java 应用在启用 Istio Sidecar 后常出现 Prometheus 中无 istio_requests_total 指标、Envoy 访问日志未注入应用上下文、Jaeger 中 Span 缺失父子关系等典型症状。根本原因在于Telemetry v2 默认关闭了 envoy_access_log 和 otel tracing 扩展并且 Java 应用未主动对接新的 Wasm 或 OpenTelemetry SDK 上报路径。验证当前遥测状态执行以下命令快速确认问题范围# 检查 Envoy 是否启用 Access Log Service (ALS) kubectl exec -it deploy/productpage-v1 -c istio-proxy -- curl -s localhost:15000/config_dump | jq .configs[] | select(.[type] type.googleapis.com/envoy.admin.v3.ConfigDump) | .dynamic_listeners[0].active_state.listener.filter_chains[0].filters[] | select(.name envoy.filters.network.http_connection_manager) | .typed_config.http_filters[] | select(.name envoy.filters.http.wasm) # 查看是否已加载 OpenTelemetry HTTP filter kubectl exec -it deploy/productpage-v1 -c istio-proxy -- curl -s localhost:15000/config_dump | grep -A5 envoy.filters.http.open_telemetry三步启用全链路遥测启用 Istio Telemetry v2 的 OpenTelemetry 支持通过telemetry.istio.io/v1alpha1API 配置资源为 Java Pod 注入 OpenTelemetry AgentOTel Java Agent并配置 exporter 指向 Istio 的 otel-collector 服务重写 EnvoyFilter显式启用 ALS 并绑定到 OpenTelemetry collector关键配置片段# otel-telemetry.yaml —— 启用 OpenTelemetry 数据通道 apiVersion: telemetry.istio.io/v1alpha1 kind: Telemetry metadata: name: mesh-default namespace: istio-system spec: metrics: - providers: - name: otel # 替代默认的 prometheus 提供者 tracing: - providers: - name: otel修复效果对比表问题维度修复前修复后Prometheus 指标仅含基础 Envoy 指标如 upstream_cx_total完整 istio_* 指标 应用自定义指标通过 OTel SDK访问日志关联性Sidecar 日志与 Java 应用日志无 trace_id 关联Log4j2 MDC 自动注入 trace_id / span_idTracing 完整性Span 断裂于 ingress → productpage 跳转点端到端 6 跳 Span 全链路可追溯含 DB、Redis第二章Mixer弃用对Java微服务可观测性链路的深度冲击2.1 Mixer架构演进与Java Sidecar注入模型的耦合机制剖析Sidecar注入触发时机Java应用启动时通过JVM Agent动态织入Mixer客户端拦截器实现指标采集与策略校验的透明接入。数据同步机制// MixerClientInterceptor.java 中的关键注册逻辑 MixerClient.register( java-sidecar, new JavaPolicyAdapter(), // 策略适配器桥接Istio AuthZ 与 Spring Security Context new MetricReporter() // 指标上报器支持 Prometheus / OpenTelemetry 双后端 );该注册调用将Java运行时上下文如ThreadLocal中的Span、Principal映射为Mixer AttributeBag确保策略决策具备完整语义。耦合关键参数参数作用默认值mixer.sidecar.sync.interval策略缓存刷新周期30sjava.agent.enable.tracing是否启用OpenTracing透传true2.2 Prometheus指标丢失根因Envoy Stats Sink迁移缺失与Java应用metrics端点适配断层数据同步机制Envoy v1.24 默认禁用旧版statsdsink但未自动启用prometheus_stats插件导致指标采集链路中断。关键配置缺失static_resources: clusters: - name: prometheus_metrics type: STRICT_DNS load_assignment: cluster_name: prometheus_metrics endpoints: - lb_endpoints: - endpoint: address: socket_address: { address: localhost, port_value: 9090 }该配置缺失将使 Envoy 无法将统计指标推送到 Prometheus Serverport_value: 9090需与 Java 应用暴露的/actuator/prometheus端口对齐。Java端点兼容性断层组件默认路径适配要求Spring Boot 2.x/actuator/prometheus需启用management.endpoint.prometheus.exposeSpring Boot 3.x/actuator/prometheus需显式注册PrometheusScrapeEndpoint2.3 日志脱节现象溯源Java应用Logback/SLF4J MDC上下文在TelemetryV2下的透传失效验证MDC上下文在微服务链路中的预期行为在TelemetryV1中MDC通过ThreadLocal绑定请求ID如X-Request-ID由Filter注入并贯穿同步调用链。但TelemetryV2启用异步Span传播后MDC.copy()未被显式调用导致子线程丢失上下文。关键验证代码public class MdcPropagationTest { public void logInAsyncTask() { // 主线程已设 MDC.put(traceId, t-123); CompletableFuture.runAsync(() - { log.info(MDC traceId: {}, MDC.get(traceId)); // 输出 null }); } }该代码暴露了CompletableFuture默认使用ForkJoinPool.commonPool()其线程不继承父线程MDC副本需配合MDC.getCopyOfContextMap()手动透传。透传失效对比表机制TelemetryV1TelemetryV2MDC继承方式Filter ThreadLocal 拷贝依赖OpenTelemetry Context API忽略MDC异步支持需手动wrap Runnable自动Span传播但MDC未桥接2.4 Tracing断链技术实测OpenTracing→OpenTelemetry迁移中Spring Cloud Sleuth与Istio Wasm Filter兼容性陷阱断链现象复现在启用 Spring Cloud Sleuth 3.1.x基于 OpenTelemetry与 Istio 1.20 WebAssembly Filter 的混合部署中HTTP 调用链在服务网格入口处中断b3与traceparent头并存但未对齐。关键兼容性缺陷Istio Wasm Filter 默认仅解析traceparentW3C 格式忽略 Sleuth 注入的b3头Sleuth 启用spring.sleuth.propagation.typeW3C后仍因 SpanContext 序列化差异导致采样率丢失修复后的 Wasm Trace Injector 片段// wasm_filter.rs强制标准化 traceparent 并透传 baggage let trace_id extract_trace_id_from_sleuth_headers(headers); let span_id generate_8byte_span_id(); let traceparent format!(00-{}-{}-01, trace_id, span_id); headers.set(traceparent, traceparent.as_str());该逻辑绕过 Istio 原生解析器缺陷确保跨框架 trace ID 全局一致trace_id需为 32 位十六进制字符串span_id必须为 16 位以满足 W3C 规范。协议映射对照表字段OpenTracing (Sleuth 2.x)OpenTelemetry (Sleuth 3.x)Istio Wasm FilterTrace IDtrace-idtraceparent前32位仅接受traceparentSamplingsampled1tracestate中envoys:1需显式注入baggage2.5 Java Agent热替换验证基于ByteBuddy的Span生命周期钩子动态注入实战Span钩子注入原理ByteBuddy通过AgentBuilder在类加载阶段拦截目标类利用Advice机制织入OnMethodEnter与OnMethodExit实现Span创建、激活与结束的无侵入式埋点。核心注入代码new AgentBuilder.Default() .type(named(com.example.service.UserService)) .transform((builder, typeDescription, classLoader, module) - builder.method(named(getUserById)) .intercept(Advice.to(SpanAdvice.class)));该代码将SpanAdvice动态注入到UserService.getUserById方法。Advice.to()启用字节码级切面无需修改源码或重启JVMclassLoader参数确保跨类加载器兼容性。热替换验证结果场景是否生效Span状态首次启动✓CREATED → ACTIVE → CLOSED运行时重定义✓ACTIVE → REDEFINED → CLOSED第三章Java Istio TelemetryV2原生适配核心路径3.1 Envoy Access Log ServiceALS对接Java gRPC日志采集器的协议对齐实践协议核心字段对齐Envoy ALS 的AccessLogEntry与 Java 侧 gRPC 日志接收端需严格匹配字段语义。关键映射包括Envoy 字段Java Protobuf 字段说明upstream_hostupstreamIp需从 IPv6 地址中提取纯 IP去除端口与方括号response_flagsresponseFlagsCode字符串标识如 UC转为枚举常量gRPC 流式请求构造// Java 客户端构建流式日志请求 StreamObserverAccessLogEntry logObserver client.streamLogs( new StreamObserverLogResponse() { public void onNext(LogResponse value) { /* 心跳响应 */ } public void onError(Throwable t) { /* 重连逻辑 */ } public void onCompleted() {} } ); logObserver.onNext(entryBuilder.setStartTime(Timestamps.fromMillis(System.currentTimeMillis())).build());该代码建立双向流通道entryBuilder需预置commonProperties和httpProperties确保 Envoy 透传的metadata_context被正确反序列化为 Java Map 结构。时序一致性保障Envoy 启用use_remote_address: true确保真实客户端 IP 可达Java 服务端启用GrpcService(interceptors {TimestampInterceptor.class})统一注入纳秒级时间戳3.2 Prometheus指标重建通过Envoy’s Wasm Extension暴露JVM Micrometer指标至Istio Telemetry API架构对齐挑战Istio默认Telemetry v2仅采集网络层指标如envoy_cluster_upstream_rq_xx而JVM应用的Micrometer指标如jvm_memory_used_bytes运行在Pod内天然隔离于Envoy数据平面。Wasm Extension提供安全沙箱使Envoy可主动拉取并转译JVM暴露的/actuator/prometheus端点。Wasm指标注入逻辑fn fetch_and_translate_metrics() - ResultVecMetric, Error { let prom_resp http_get(http://localhost:8080/actuator/prometheus)?; let parsed parse_prometheus_text(prom_resp.body)?; parsed.into_iter() .filter(|m| m.name.starts_with(jvm_)) .map(|m| Metric::from_micrometer(m, app_pod)) .collect() }该Rust Wasm函数每15秒轮询Spring Boot Actuator端点过滤JVM前缀指标并添加sourceapp_pod标签对齐Istio遥测上下文。指标映射对照表Micrometer原始指标Istio Telemetry API字段转换规则jvm_memory_used_bytes{areaheap}istio_envoy_jvm_heap_bytes重命名单位标准化为bytesjvm_threads_liveistio_envoy_jvm_threads_count后缀统一为_count语义3.3 OpenTelemetry Java SDK与Istio 1.22 Wasm Trace Provider的零侵入集成方案核心集成原理Istio 1.22 内置 WASM trace provider 可在 Envoy 侧自动注入 OpenTelemetry 兼容的 trace context无需修改 Java 应用代码。Java SDK 通过 opentelemetry-java-instrumentation 的 otel.propagators 配置启用 tracecontext 和 b3 双 Propagator实现跨边车上下文透传。关键配置片段java -javaagent:/path/to/opentelemetry-javaagent.jar \ -Dotel.traces.exporternone \ -Dotel.propagatorstracecontext,b3 \ -jar myapp.jar该配置禁用本地 exporter交由 Istio Wasm 处理仅保留上下文传播能力确保 Span 生命周期完全由 Istio 控制。数据同步机制组件职责协议Istio Wasm Trace Provider提取/注入 trace headers生成 Span 并上报至 OTLP endpointHTTP/OTLP-gRPCJava SDK仅解析 context不创建 Span保持无痕运行Header-only propagation第四章90分钟极速修复工作流Java专项4.1 Step1Java应用侧OTel Auto-Instrumentation配置标准化与Istio Sidecar annotation校准自动注入配置标准化Java应用需统一启用OpenTelemetry自动插桩通过JVM参数标准化注入路径与SDK配置-javaagent:/otel/lib/opentelemetry-javaagent.jar \ -Dotel.traces.exporterotlp \ -Dotel.exporter.otlp.endpointhttp://otel-collector.observability:4318/v1/traces \ -Dotel.resource.attributesservice.name${POD_NAME},k8s.namespace.name${NAMESPACE}该配置确保所有Java服务使用一致的Trace导出协议、端点及资源语义避免因环境差异导致Span丢失或标签错乱。Istio Sidecar Annotation校准为保障OTel流量不被Sidecar拦截需显式豁免gRPC OTLP端口Annotation KeyValuePurposetraffic.sidecar.istio.io/includeInboundPorts8080,9090仅劫持业务端口traffic.sidecar.istio.io/excludeOutboundPorts4318直连Collector绕过mTLS4.2 Step2自定义Wasm Filter编译部署——嵌入Java ClassLoader级Span Context提取逻辑ClassLoader上下文穿透原理Java应用中跨类加载器的Span传递需捕获java.lang.ClassLoader实例作为唯一上下文锚点。Wasm Filter通过JNI桥接获取当前线程绑定的ClassLoader哈希值并映射至OpenTracing Span。// 获取当前线程ClassLoader的JVM句柄 jobject class_loader env-CallObjectMethod(thread, get_context_class_loader_method); jlong loader_id reinterpret_castjlong(class_loader); // 用指针地址作轻量ID该ID在Wasm内存中持久化为span_context_map[loader_id]键避免反射调用开销。构建Wasm部署流水线将Java Agent注入逻辑编译为JNI兼容的libjtracing.so使用wabt工具链将C Filter转为WASM字节码通过Envoy Admin API热加载触发ClassLoader感知的Span注册Context映射性能对比策略延迟(us)GC压力ThreadLocal缓存120低ClassLoader哈希映射89极低4.3 Step3Prometheus ServiceMonitor重构——针对Java Pod Label Selector与Metrics Path精细化匹配Label Selector精准对齐Java应用Pod常带app.kubernetes.io/component: backend与spring-boot: true双重标签需避免宽泛匹配导致抓取污染selector: matchLabels: app.kubernetes.io/component: backend spring-boot: true该配置确保仅匹配Spring Boot Java Pod排除Sidecar或InitContainer干扰。Metrics Path动态适配不同Java框架暴露路径差异显著需按management.endpoints.web.base-path定制框架默认PathServiceMonitor pathSpring Boot 2.x/actuator/prometheus/actuator/prometheusQuarkus/q/metrics/q/metrics关键校验清单确认Pod中/metrics端口已通过prometheus.io/scrape: true显式标注验证targetPort与容器内暴露端口如8080一致4.4 Step4Jaeger/Zipkin后端路由修复——基于Istio Gateway TLS SNI的Trace采样流量兜底策略TLS SNI 路由分流原理Istio Gateway 利用客户端 TLS 握手时携带的 Server Name IndicationSNI字段实现无需解密流量即可精准路由。当 Jaeger UIjaeger-ui.example.com与 Zipkin APIzipkin-api.example.com共用 443 端口时SNI 成为唯一可依赖的路由标识。Istio VirtualService 配置示例apiVersion: networking.istio.io/v1beta1 kind: VirtualService metadata: name: trace-backend-vs spec: hosts: - jaeger-ui.example.com # 匹配 SNI 域名 gateways: - istio-system/trace-gateway http: - route: - destination: host: jaeger-query.istio-system.svc.cluster.local port: number: 16686该配置仅对 SNI 为jaeger-ui.example.com的 TLS 流量生效避免与 Zipkin 的/api/v2/spans采样上报路径冲突。兜底策略关键参数对比参数Jaeger UI 路由Zipkin 采样上报SNI Hostjaeger-ui.example.comzipkin-api.example.com目标服务jaeger-queryzipkin端口166869411第五章总结与展望云原生可观测性的演进路径现代微服务架构下OpenTelemetry 已成为统一采集指标、日志与追踪的事实标准。某电商中台在迁移至 Kubernetes 后通过部署otel-collector并配置 Jaeger exporter将端到端延迟分析精度从分钟级提升至毫秒级故障定位耗时下降 68%。关键实践工具链使用 Prometheus Grafana 构建 SLO 可视化看板实时监控 API 错误率与 P99 延迟基于 eBPF 的 Cilium 实现零侵入网络层遥测捕获东西向流量异常模式利用 Loki 进行结构化日志聚合配合 LogQL 查询高频 503 错误关联的上游超时链路典型调试代码片段// 在 HTTP 中间件中注入 trace context 并记录关键业务标签 func TraceMiddleware(next http.Handler) http.Handler { return http.HandlerFunc(func(w http.ResponseWriter, r *http.Request) { ctx : r.Context() span : trace.SpanFromContext(ctx) span.SetAttributes( attribute.String(http.method, r.Method), attribute.String(business.flow, order_checkout_v2), attribute.Int64(user.tier, getUserTier(r)), // 实际从 JWT 解析 ) next.ServeHTTP(w, r) }) }多环境观测能力对比环境采样率数据保留周期告警响应 SLA生产100% metrics, 1% traces90 天冷热分层≤ 45 秒预发100% 全量7 天≤ 2 分钟下一代可观测性基础设施[OTel Collector] → [Vector Transform Pipeline] → [ClickHouse OLAP] → [Grafana ML Plugin]

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如若转载,请注明出处:http://www.coloradmin.cn/o/2467628.html

如若内容造成侵权/违法违规/事实不符,请联系多彩编程网进行投诉反馈,一经查实,立即删除!相关文章

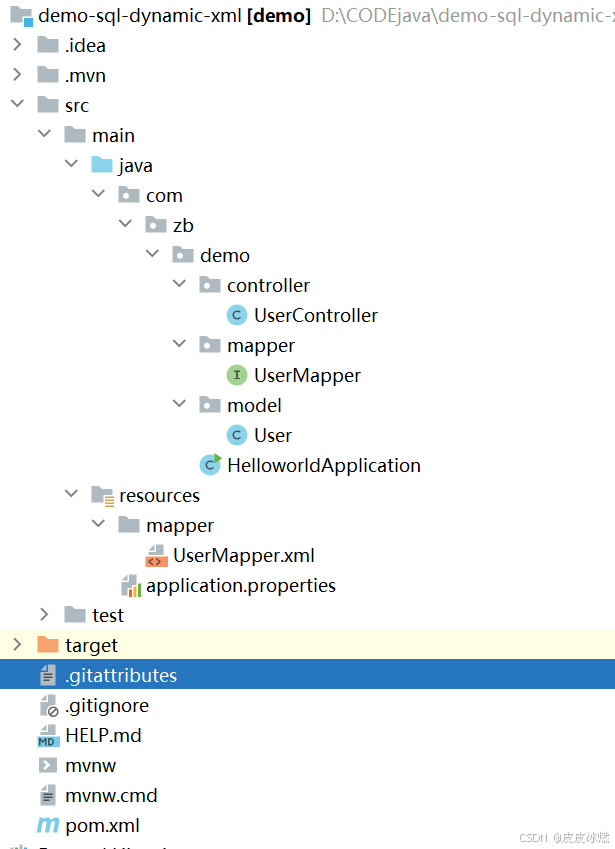

SpringBoot-17-MyBatis动态SQL标签之常用标签

文章目录 1 代码1.1 实体User.java1.2 接口UserMapper.java1.3 映射UserMapper.xml1.3.1 标签if1.3.2 标签if和where1.3.3 标签choose和when和otherwise1.4 UserController.java2 常用动态SQL标签2.1 标签set2.1.1 UserMapper.java2.1.2 UserMapper.xml2.1.3 UserController.ja…

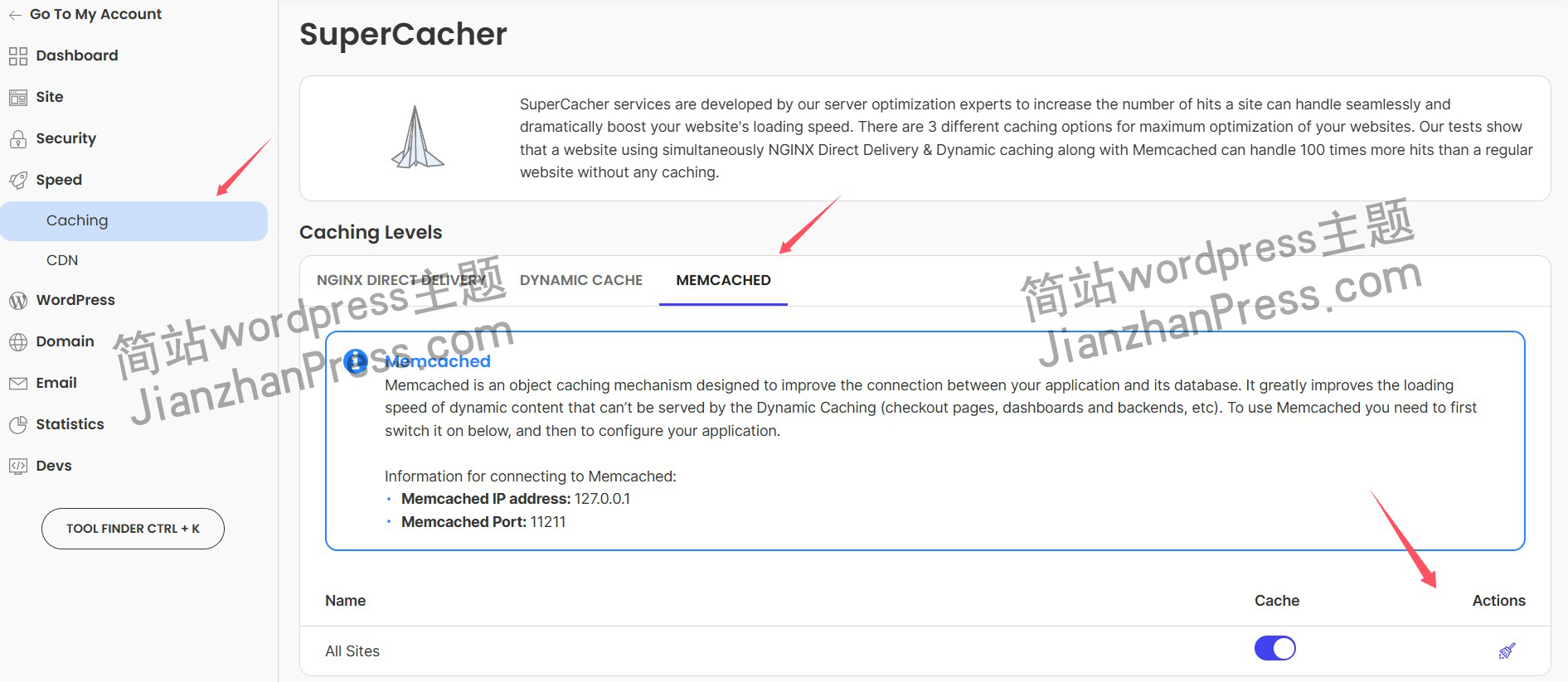

wordpress后台更新后 前端没变化的解决方法

使用siteground主机的wordpress网站,会出现更新了网站内容和修改了php模板文件、js文件、css文件、图片文件后,网站没有变化的情况。

不熟悉siteground主机的新手,遇到这个问题,就很抓狂,明明是哪都没操作错误&#x…

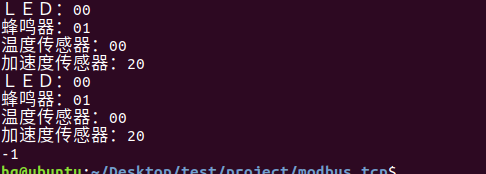

网络编程(Modbus进阶)

思维导图 Modbus RTU(先学一点理论)

概念 Modbus RTU 是工业自动化领域 最广泛应用的串行通信协议,由 Modicon 公司(现施耐德电气)于 1979 年推出。它以 高效率、强健性、易实现的特点成为工业控制系统的通信标准。 包…

UE5 学习系列(二)用户操作界面及介绍

这篇博客是 UE5 学习系列博客的第二篇,在第一篇的基础上展开这篇内容。博客参考的 B 站视频资料和第一篇的链接如下:

【Note】:如果你已经完成安装等操作,可以只执行第一篇博客中 2. 新建一个空白游戏项目 章节操作,重…

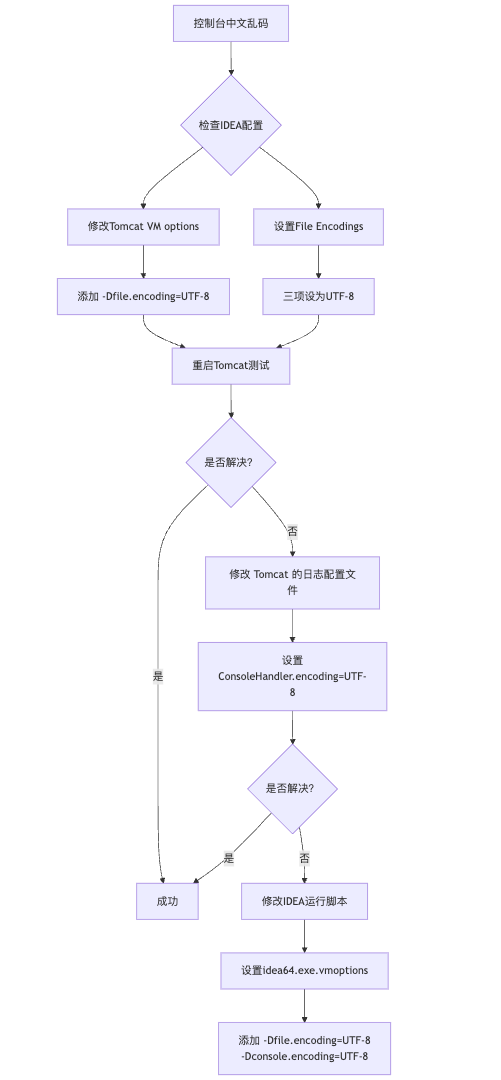

IDEA运行Tomcat出现乱码问题解决汇总

最近正值期末周,有很多同学在写期末Java web作业时,运行tomcat出现乱码问题,经过多次解决与研究,我做了如下整理:

原因:

IDEA本身编码与tomcat的编码与Windows编码不同导致,Windows 系统控制台…

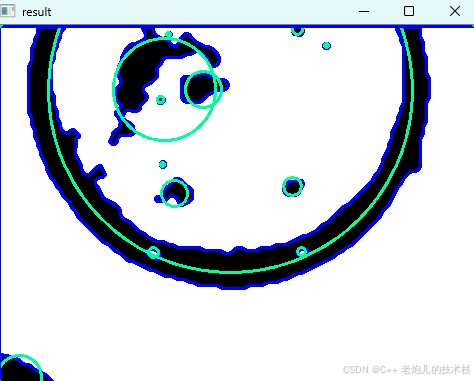

利用最小二乘法找圆心和半径

#include <iostream>

#include <vector>

#include <cmath>

#include <Eigen/Dense> // 需安装Eigen库用于矩阵运算 // 定义点结构

struct Point { double x, y; Point(double x_, double y_) : x(x_), y(y_) {}

}; // 最小二乘法求圆心和半径 …

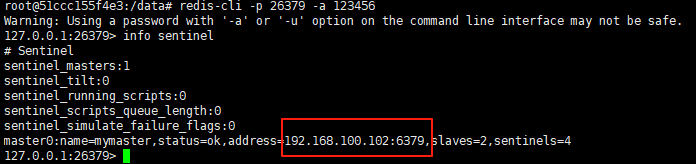

使用docker在3台服务器上搭建基于redis 6.x的一主两从三台均是哨兵模式

一、环境及版本说明

如果服务器已经安装了docker,则忽略此步骤,如果没有安装,则可以按照一下方式安装: 1. 在线安装(有互联网环境): 请看我这篇文章 传送阵>> 点我查看 2. 离线安装(内网环境):请看我这篇文章 传送阵>> 点我查看

说明:假设每台服务器已…

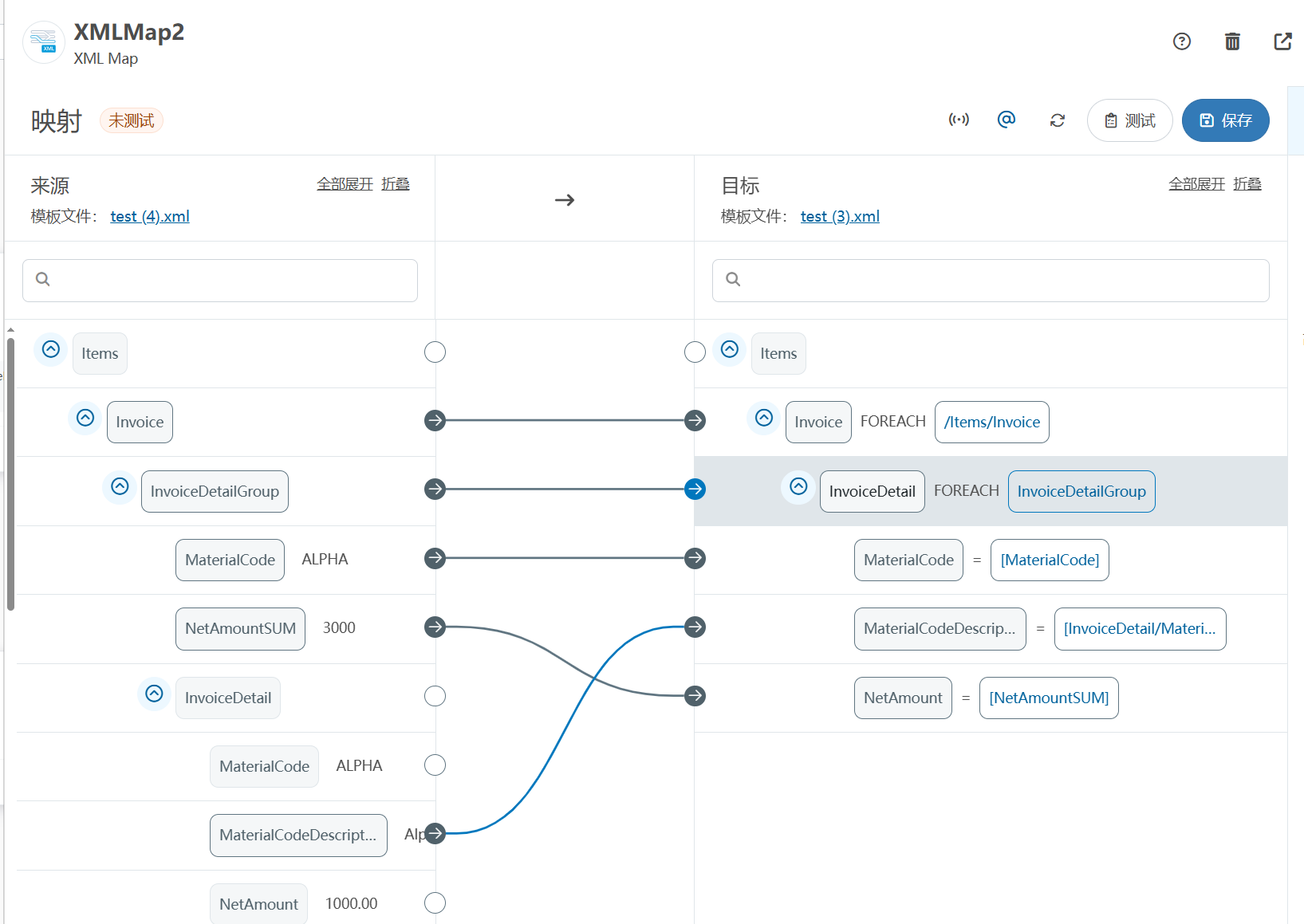

XML Group端口详解

在XML数据映射过程中,经常需要对数据进行分组聚合操作。例如,当处理包含多个物料明细的XML文件时,可能需要将相同物料号的明细归为一组,或对相同物料号的数量进行求和计算。传统实现方式通常需要编写脚本代码,增加了开…

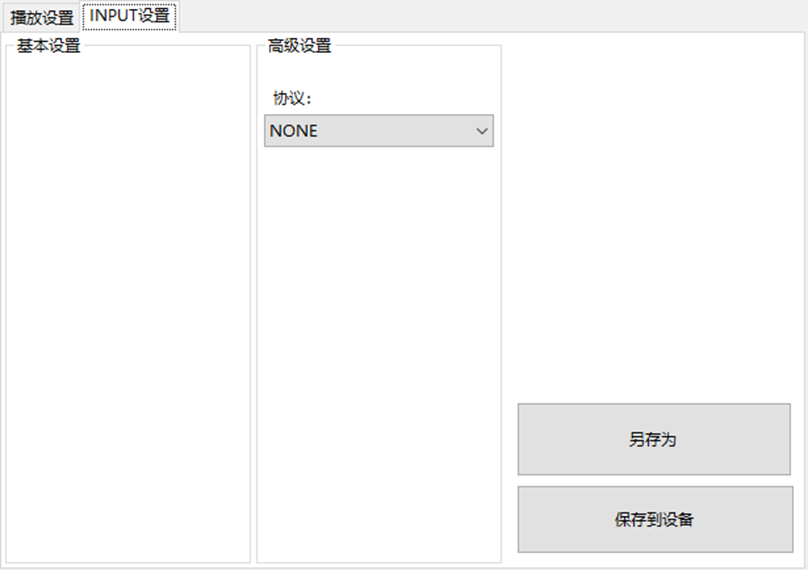

LBE-LEX系列工业语音播放器|预警播报器|喇叭蜂鸣器的上位机配置操作说明

LBE-LEX系列工业语音播放器|预警播报器|喇叭蜂鸣器专为工业环境精心打造,完美适配AGV和无人叉车。同时,集成以太网与语音合成技术,为各类高级系统(如MES、调度系统、库位管理、立库等)提供高效便捷的语音交互体验。

L…

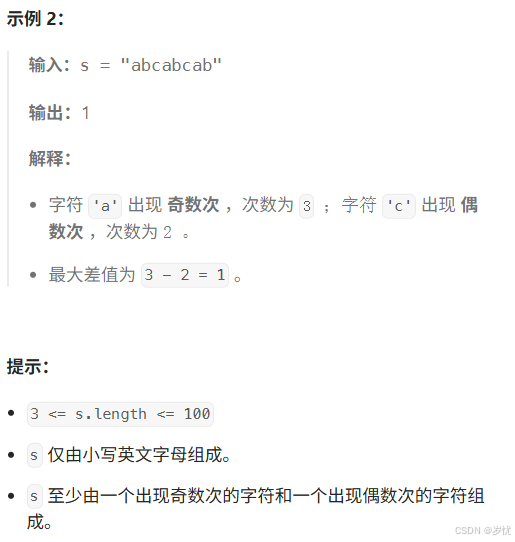

(LeetCode 每日一题) 3442. 奇偶频次间的最大差值 I (哈希、字符串)

题目:3442. 奇偶频次间的最大差值 I 思路 :哈希,时间复杂度0(n)。 用哈希表来记录每个字符串中字符的分布情况,哈希表这里用数组即可实现。

C版本:

class Solution {

public:int maxDifference(string s) {int a[26]…

【大模型RAG】拍照搜题技术架构速览:三层管道、两级检索、兜底大模型

摘要

拍照搜题系统采用“三层管道(多模态 OCR → 语义检索 → 答案渲染)、两级检索(倒排 BM25 向量 HNSW)并以大语言模型兜底”的整体框架: 多模态 OCR 层 将题目图片经过超分、去噪、倾斜校正后,分别用…

【Axure高保真原型】引导弹窗

今天和大家中分享引导弹窗的原型模板,载入页面后,会显示引导弹窗,适用于引导用户使用页面,点击完成后,会显示下一个引导弹窗,直至最后一个引导弹窗完成后进入首页。具体效果可以点击下方视频观看或打开下方…

接口测试中缓存处理策略

在接口测试中,缓存处理策略是一个关键环节,直接影响测试结果的准确性和可靠性。合理的缓存处理策略能够确保测试环境的一致性,避免因缓存数据导致的测试偏差。以下是接口测试中常见的缓存处理策略及其详细说明:

一、缓存处理的核…

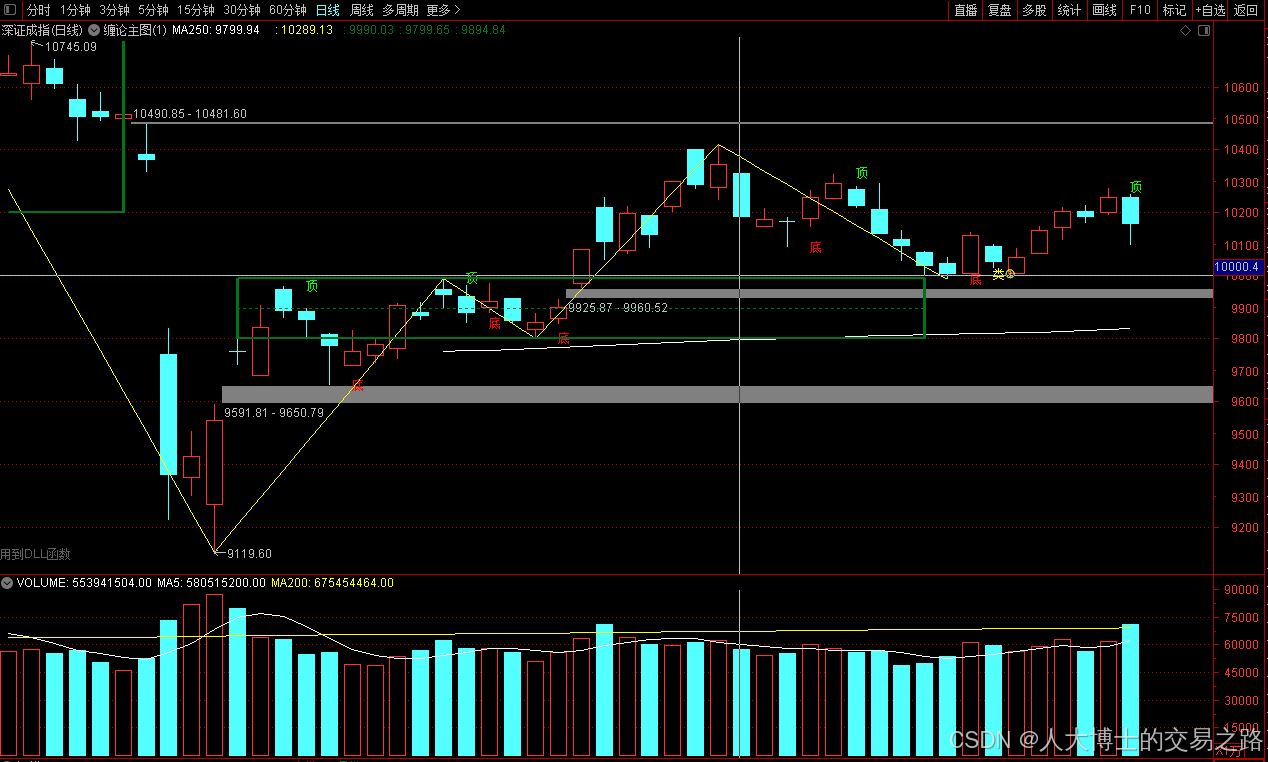

龙虎榜——20250610

上证指数放量收阴线,个股多数下跌,盘中受消息影响大幅波动。 深证指数放量收阴线形成顶分型,指数短线有调整的需求,大概需要一两天。 2025年6月10日龙虎榜行业方向分析 1. 金融科技

代表标的:御银股份、雄帝科技

驱动…

观成科技:隐蔽隧道工具Ligolo-ng加密流量分析

1.工具介绍

Ligolo-ng是一款由go编写的高效隧道工具,该工具基于TUN接口实现其功能,利用反向TCP/TLS连接建立一条隐蔽的通信信道,支持使用Let’s Encrypt自动生成证书。Ligolo-ng的通信隐蔽性体现在其支持多种连接方式,适应复杂网…

铭豹扩展坞 USB转网口 突然无法识别解决方法

当 USB 转网口扩展坞在一台笔记本上无法识别,但在其他电脑上正常工作时,问题通常出在笔记本自身或其与扩展坞的兼容性上。以下是系统化的定位思路和排查步骤,帮助你快速找到故障原因:

背景:

一个M-pard(铭豹)扩展坞的网卡突然无法识别了,扩展出来的三个USB接口正常。…

未来机器人的大脑:如何用神经网络模拟器实现更智能的决策?

编辑:陈萍萍的公主一点人工一点智能 未来机器人的大脑:如何用神经网络模拟器实现更智能的决策?RWM通过双自回归机制有效解决了复合误差、部分可观测性和随机动力学等关键挑战,在不依赖领域特定归纳偏见的条件下实现了卓越的预测准…

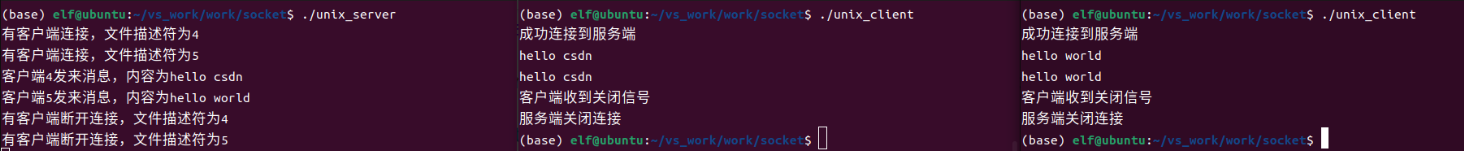

Linux应用开发之网络套接字编程(实例篇)

服务端与客户端单连接

服务端代码

#include <sys/socket.h>

#include <sys/types.h>

#include <netinet/in.h>

#include <stdio.h>

#include <stdlib.h>

#include <string.h>

#include <arpa/inet.h>

#include <pthread.h>

…

华为云AI开发平台ModelArts

华为云ModelArts:重塑AI开发流程的“智能引擎”与“创新加速器”!

在人工智能浪潮席卷全球的2025年,企业拥抱AI的意愿空前高涨,但技术门槛高、流程复杂、资源投入巨大的现实,却让许多创新构想止步于实验室。数据科学家…

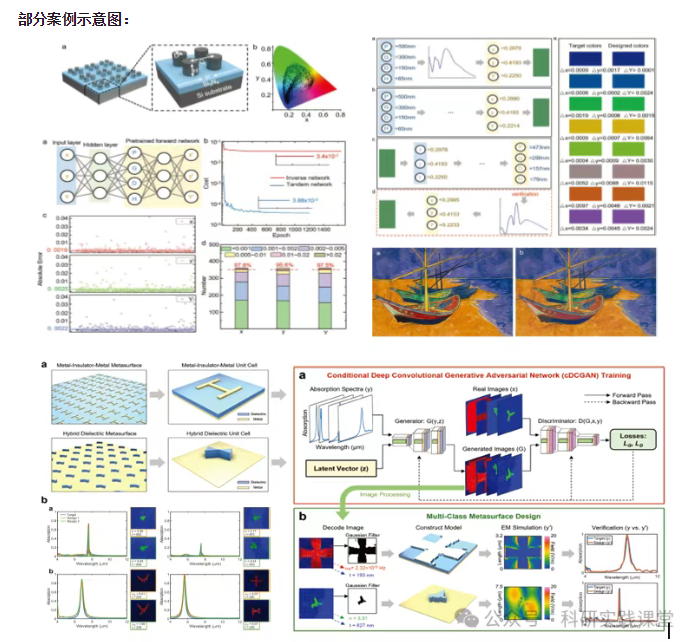

深度学习在微纳光子学中的应用

深度学习在微纳光子学中的主要应用方向

深度学习与微纳光子学的结合主要集中在以下几个方向:

逆向设计 通过神经网络快速预测微纳结构的光学响应,替代传统耗时的数值模拟方法。例如设计超表面、光子晶体等结构。

特征提取与优化 从复杂的光学数据中自…