网易云信Web语音通信实战:从零封装一个Vue3语音聊天组件

news2026/3/22 5:18:32

Vue3网易云信Web语音通信组件开发实战语音交互正在成为现代Web应用的重要功能模块。本文将带您从零开始基于Vue3组合式API和网易云信Web SDK构建一个企业级可复用的语音聊天组件。不同于简单的SDK集成教程我们将重点探讨工程化实践中的关键问题解决方案。1. 环境准备与SDK初始化在开始编码前我们需要完成基础环境配置。网易云信SDK提供了两种集成方式npm install yxim/nim-web-sdklatest对于TypeScript项目建议创建专门的类型定义文件types/nim.d.tsdeclare module yxim/nim-web-sdk { export interface NIMSendTextOptions { scene: p2p | team | superTeam to: string text: string done?: (error: NIMError) void } // 其他类型定义... }SDK初始化建议采用工厂模式封装// utils/nim.ts class NIMClient { private static instance: NIMClient private nim: any private constructor(config: NIMConfig) { this.nim NIM.getInstance({ appKey: import.meta.env.VITE_APP_KEY, account: config.account, token: config.token, debug: process.env.NODE_ENV development, onmsg: this.handleMessage.bind(this) }) } public static getInstance(config: NIMConfig): NIMClient { if (!NIMClient.instance) { NIMClient.instance new NIMClient(config) } return NIMClient.instance } private handleMessage(msg: NIMMessage) { // 消息处理逻辑 } }提示生产环境务必关闭debug模式避免敏感信息泄露2. 浏览器录音功能实现现代浏览器提供了MediaRecorder API进行音频采集但需要考虑兼容性问题浏览器支持格式最低版本Chromeaudio/ogg58Firefoxaudio/webm61Safariaudio/mp414.1实现录音功能的核心代码script setup const recorder ref(null) const audioChunks ref([]) const startRecording async () { try { const stream await navigator.mediaDevices.getUserMedia({ audio: true }) recorder.value new MediaRecorder(stream, { mimeType: audio/ogg; codecsopus }) recorder.value.ondataavailable (e) { audioChunks.value.push(e.data) } recorder.value.start(100) // 每100ms收集一次数据 } catch (err) { console.error(录音权限获取失败:, err) } } const stopRecording () { if (recorder.value?.state recording) { recorder.value.stop() // 释放麦克风资源 recorder.value.stream.getTracks().forEach(track track.stop()) } } /script注意iOS设备上需要用户主动交互如点击事件才能触发录音权限请求3. 语音消息组件化设计采用Composition API设计可复用的语音消息组件template div classvoice-message :classdirection div classwaveform :style{ width: ${duration * 10}px } span v-fori in 3 :keyi :class{ active: isPlaying }/span /div span classduration{{ duration }}/span button clicktogglePlay Icon :nameisPlaying ? pause : play / /button /div /template script setup const props defineProps({ audioUrl: String, duration: Number, direction: { type: String, default: incoming // or outgoing } }) const isPlaying ref(false) const audioElement new Audio() const togglePlay () { if (isPlaying.value) { audioElement.pause() } else { audioElement.src props.audioUrl audioElement.play() } isPlaying.value !isPlaying.value } audioElement.addEventListener(ended, () { isPlaying.value false }) /script样式设计建议采用CSS变量实现主题化.voice-message { --wave-color: #4CAF50; --bg-color: #F1F8E9; .outgoing { --wave-color: #2196F3; --bg-color: #E3F2FD; } .waveform span { background-color: var(--wave-color); .active { animation: pulse 0.8s infinite; } } }4. 性能优化与高级功能4.1 消息列表虚拟滚动对于大量语音消息建议使用虚拟滚动技术template VirtualList :itemsmessages :item-size72 template v-slot{ item } VoiceMessage :messageitem / /template /VirtualList /template script setup import { computed } from vue import VirtualList from vue-virtual-scroll-list const props defineProps([messages]) const visibleRange ref([0, 20]) const visibleMessages computed(() { return props.messages.slice(...visibleRange.value) }) /script4.2 语音消息压缩使用Web Audio API进行音频处理async function compressAudio(blob) { const audioContext new AudioContext() const buffer await audioContext.decodeAudioData(await blob.arrayBuffer()) // 降采样到16kHz const offlineCtx new OfflineAudioContext( 1, buffer.length * 16000 / buffer.sampleRate, 16000 ) const source offlineCtx.createBufferSource() source.buffer buffer source.connect(offlineCtx.destination) source.start() const renderedBuffer await offlineCtx.startRendering() return bufferToWav(renderedBuffer) }4.3 断点续传实现对于大语音文件实现分片上传async function uploadVoice(file) { const CHUNK_SIZE 1024 * 100 // 100KB const chunks Math.ceil(file.size / CHUNK_SIZE) const uploadId generateUUID() for (let i 0; i chunks; i) { const chunk file.slice(i * CHUNK_SIZE, (i 1) * CHUNK_SIZE) await nim.uploadChunk({ uploadId, chunkIndex: i, chunkData: chunk }) } return nim.completeUpload({ uploadId }) }5. 工程化实践建议错误监控实现SDK错误统一处理class ErrorTracker { static track(error) { console.error([NIM Error], error) // 上报到监控系统 if (error.code 302) { // 处理token过期 } } }单元测试重点describe(VoiceMessage, () { it(should play audio when clicked, async () { const wrapper mount(VoiceMessage, { props: { audioUrl: test.ogg, duration: 5 } }) await wrapper.find(button).trigger(click) expect(wrapper.vm.isPlaying).toBe(true) }) })性能指标监控const perfMetrics { sdkInitTime: 0, messageReceiveDelay: [], record(key, value) { if (key sdkInitTime) { this[key] value } else { this[key].push(value) } // 定期上报到监控系统 } }在实际项目中我们发现语音消息的波形可视化对用户体验提升显著。通过分析音频数据生成动态波形可以让用户直观感受到语音内容。以下是一个简单的Canvas波形绘制实现function drawWaveform(canvas, audioBuffer) { const ctx canvas.getContext(2d) const data audioBuffer.getChannelData(0) const step Math.ceil(data.length / canvas.width) ctx.clearRect(0, 0, canvas.width, canvas.height) ctx.beginPath() for (let i 0; i canvas.width; i) { const pos i * step const val data[pos] * canvas.height / 2 ctx.moveTo(i, canvas.height / 2 - val) ctx.lineTo(i, canvas.height / 2 val) } ctx.stroke() }

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如若转载,请注明出处:http://www.coloradmin.cn/o/2432034.html

如若内容造成侵权/违法违规/事实不符,请联系多彩编程网进行投诉反馈,一经查实,立即删除!相关文章

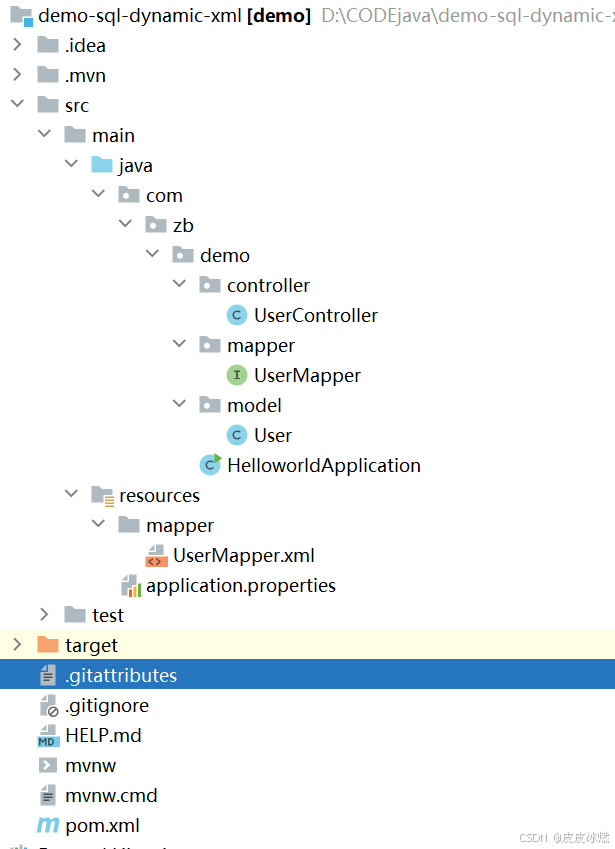

SpringBoot-17-MyBatis动态SQL标签之常用标签

文章目录 1 代码1.1 实体User.java1.2 接口UserMapper.java1.3 映射UserMapper.xml1.3.1 标签if1.3.2 标签if和where1.3.3 标签choose和when和otherwise1.4 UserController.java2 常用动态SQL标签2.1 标签set2.1.1 UserMapper.java2.1.2 UserMapper.xml2.1.3 UserController.ja…

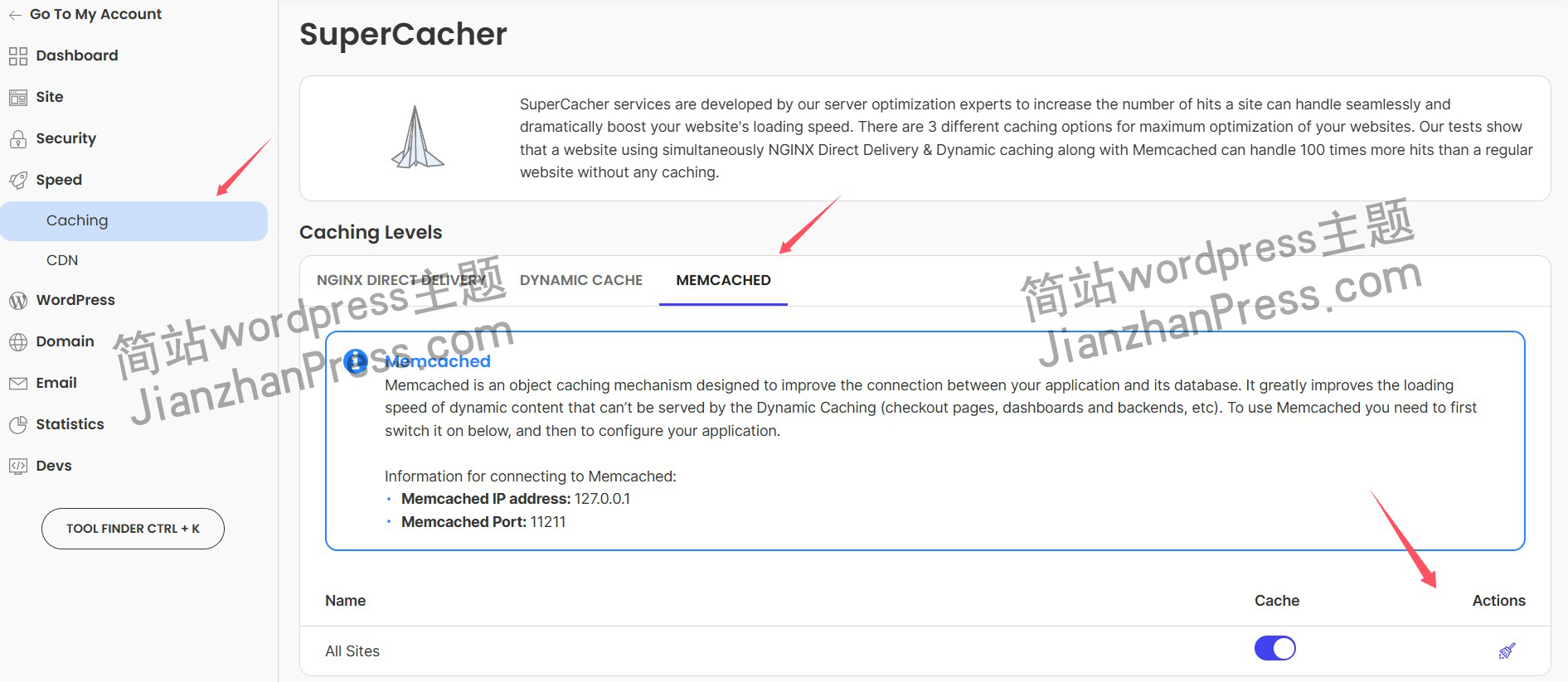

wordpress后台更新后 前端没变化的解决方法

使用siteground主机的wordpress网站,会出现更新了网站内容和修改了php模板文件、js文件、css文件、图片文件后,网站没有变化的情况。

不熟悉siteground主机的新手,遇到这个问题,就很抓狂,明明是哪都没操作错误&#x…

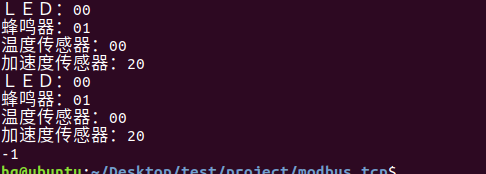

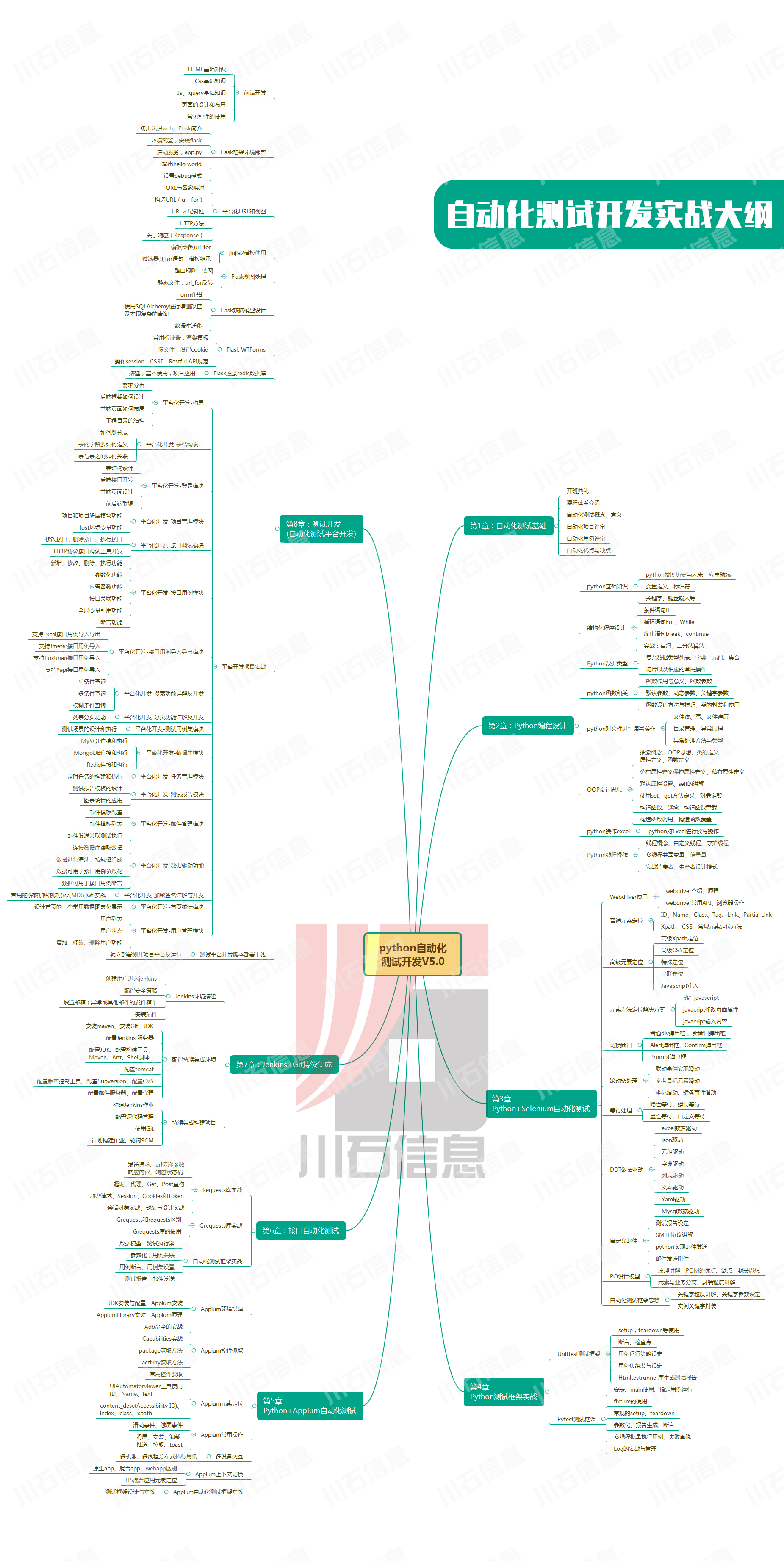

网络编程(Modbus进阶)

思维导图 Modbus RTU(先学一点理论)

概念 Modbus RTU 是工业自动化领域 最广泛应用的串行通信协议,由 Modicon 公司(现施耐德电气)于 1979 年推出。它以 高效率、强健性、易实现的特点成为工业控制系统的通信标准。 包…

UE5 学习系列(二)用户操作界面及介绍

这篇博客是 UE5 学习系列博客的第二篇,在第一篇的基础上展开这篇内容。博客参考的 B 站视频资料和第一篇的链接如下:

【Note】:如果你已经完成安装等操作,可以只执行第一篇博客中 2. 新建一个空白游戏项目 章节操作,重…

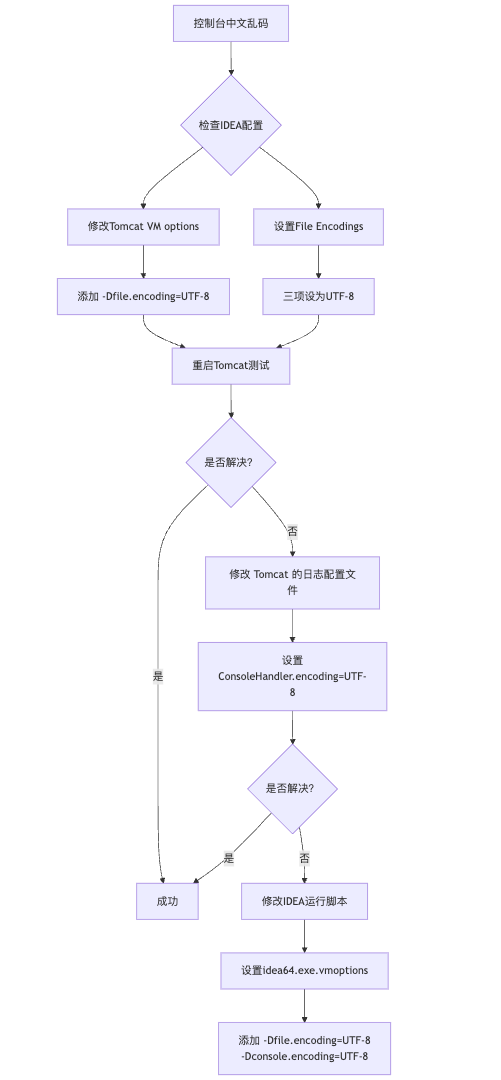

IDEA运行Tomcat出现乱码问题解决汇总

最近正值期末周,有很多同学在写期末Java web作业时,运行tomcat出现乱码问题,经过多次解决与研究,我做了如下整理:

原因:

IDEA本身编码与tomcat的编码与Windows编码不同导致,Windows 系统控制台…

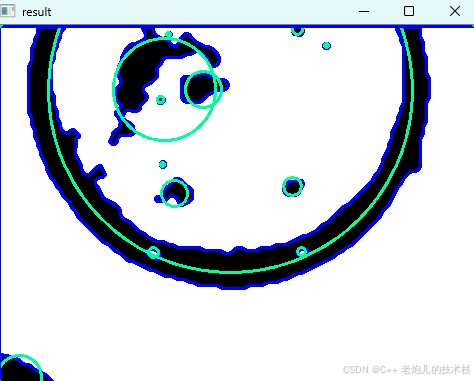

利用最小二乘法找圆心和半径

#include <iostream>

#include <vector>

#include <cmath>

#include <Eigen/Dense> // 需安装Eigen库用于矩阵运算 // 定义点结构

struct Point { double x, y; Point(double x_, double y_) : x(x_), y(y_) {}

}; // 最小二乘法求圆心和半径 …

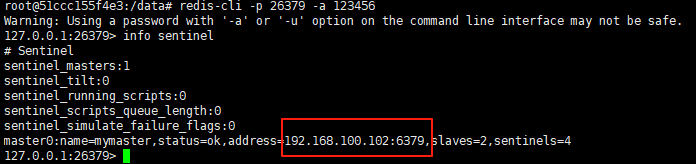

使用docker在3台服务器上搭建基于redis 6.x的一主两从三台均是哨兵模式

一、环境及版本说明

如果服务器已经安装了docker,则忽略此步骤,如果没有安装,则可以按照一下方式安装: 1. 在线安装(有互联网环境): 请看我这篇文章 传送阵>> 点我查看 2. 离线安装(内网环境):请看我这篇文章 传送阵>> 点我查看

说明:假设每台服务器已…

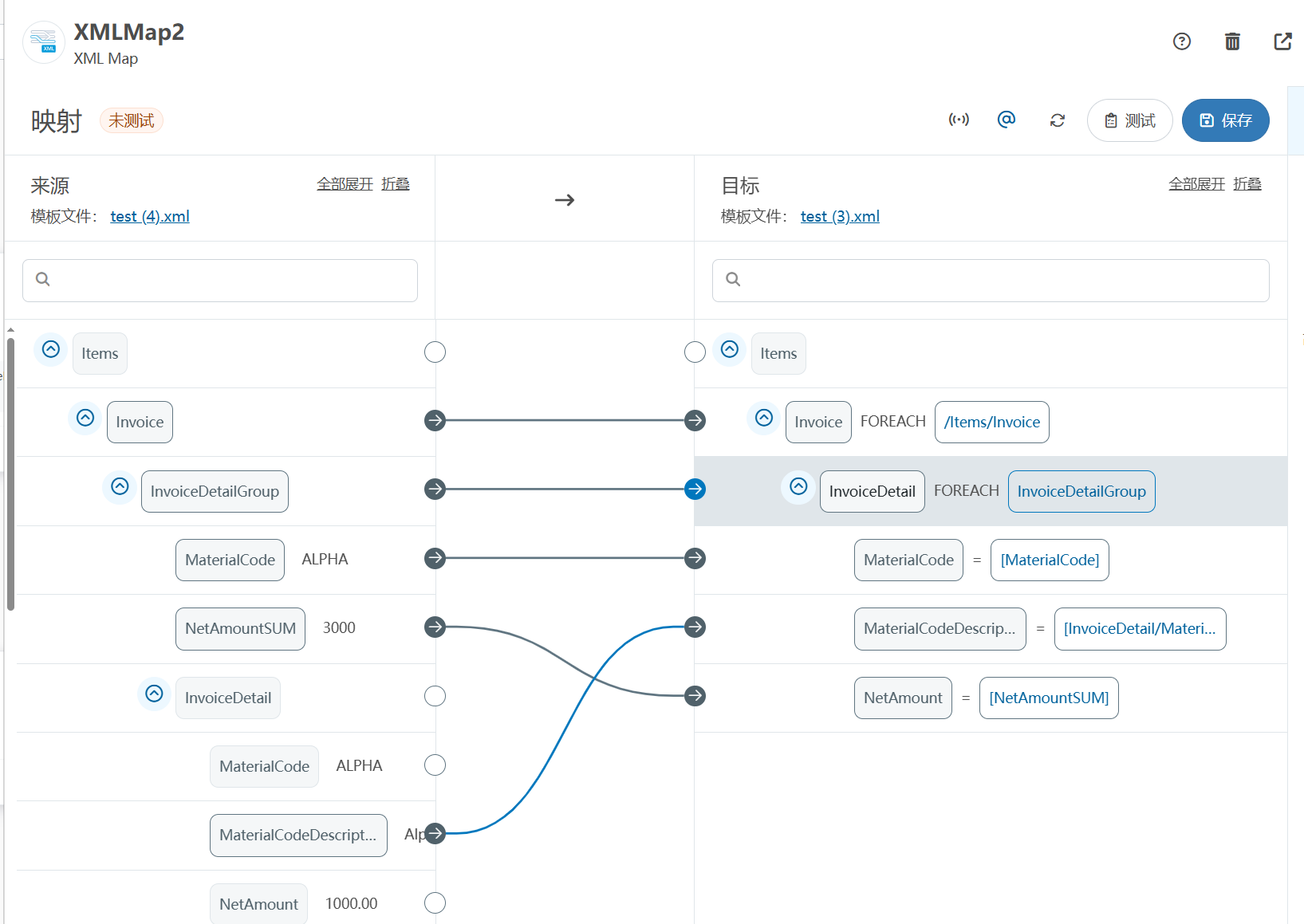

XML Group端口详解

在XML数据映射过程中,经常需要对数据进行分组聚合操作。例如,当处理包含多个物料明细的XML文件时,可能需要将相同物料号的明细归为一组,或对相同物料号的数量进行求和计算。传统实现方式通常需要编写脚本代码,增加了开…

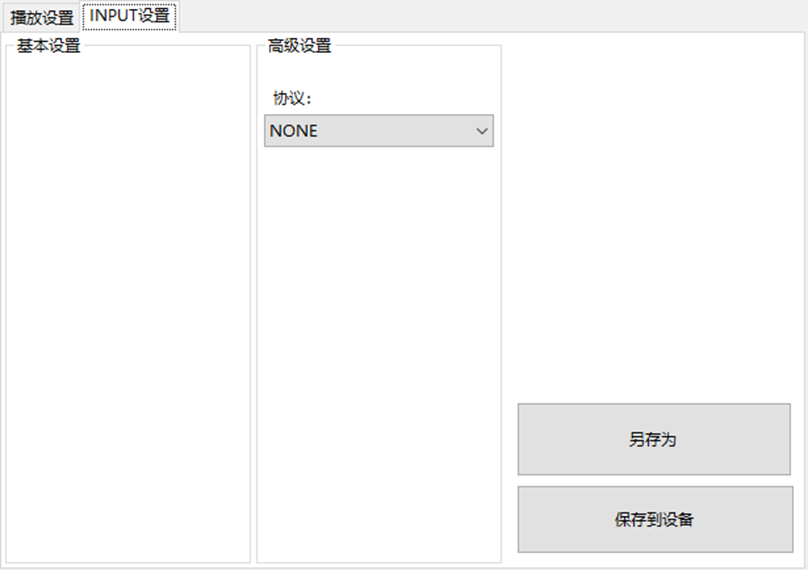

LBE-LEX系列工业语音播放器|预警播报器|喇叭蜂鸣器的上位机配置操作说明

LBE-LEX系列工业语音播放器|预警播报器|喇叭蜂鸣器专为工业环境精心打造,完美适配AGV和无人叉车。同时,集成以太网与语音合成技术,为各类高级系统(如MES、调度系统、库位管理、立库等)提供高效便捷的语音交互体验。

L…

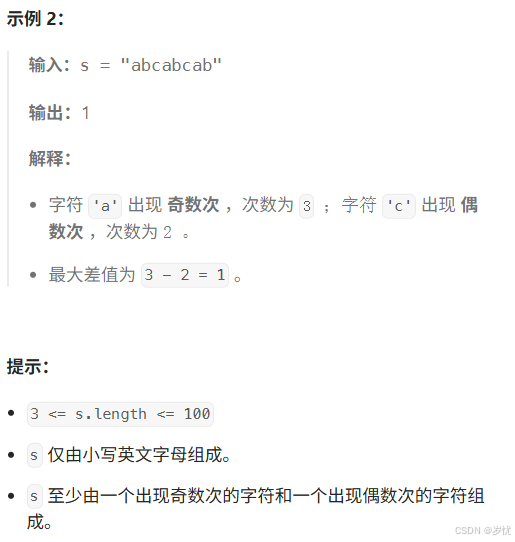

(LeetCode 每日一题) 3442. 奇偶频次间的最大差值 I (哈希、字符串)

题目:3442. 奇偶频次间的最大差值 I 思路 :哈希,时间复杂度0(n)。 用哈希表来记录每个字符串中字符的分布情况,哈希表这里用数组即可实现。

C版本:

class Solution {

public:int maxDifference(string s) {int a[26]…

【大模型RAG】拍照搜题技术架构速览:三层管道、两级检索、兜底大模型

摘要

拍照搜题系统采用“三层管道(多模态 OCR → 语义检索 → 答案渲染)、两级检索(倒排 BM25 向量 HNSW)并以大语言模型兜底”的整体框架: 多模态 OCR 层 将题目图片经过超分、去噪、倾斜校正后,分别用…

【Axure高保真原型】引导弹窗

今天和大家中分享引导弹窗的原型模板,载入页面后,会显示引导弹窗,适用于引导用户使用页面,点击完成后,会显示下一个引导弹窗,直至最后一个引导弹窗完成后进入首页。具体效果可以点击下方视频观看或打开下方…

接口测试中缓存处理策略

在接口测试中,缓存处理策略是一个关键环节,直接影响测试结果的准确性和可靠性。合理的缓存处理策略能够确保测试环境的一致性,避免因缓存数据导致的测试偏差。以下是接口测试中常见的缓存处理策略及其详细说明:

一、缓存处理的核…

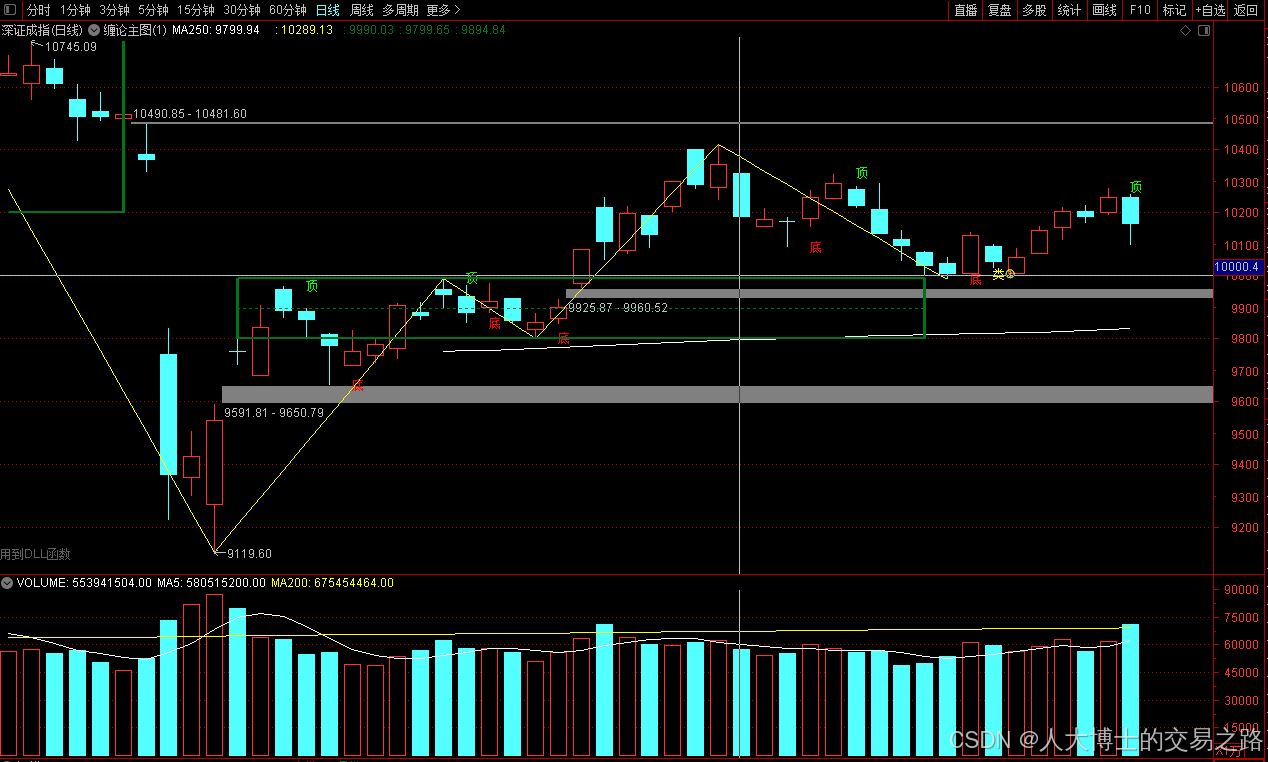

龙虎榜——20250610

上证指数放量收阴线,个股多数下跌,盘中受消息影响大幅波动。 深证指数放量收阴线形成顶分型,指数短线有调整的需求,大概需要一两天。 2025年6月10日龙虎榜行业方向分析 1. 金融科技

代表标的:御银股份、雄帝科技

驱动…

观成科技:隐蔽隧道工具Ligolo-ng加密流量分析

1.工具介绍

Ligolo-ng是一款由go编写的高效隧道工具,该工具基于TUN接口实现其功能,利用反向TCP/TLS连接建立一条隐蔽的通信信道,支持使用Let’s Encrypt自动生成证书。Ligolo-ng的通信隐蔽性体现在其支持多种连接方式,适应复杂网…

铭豹扩展坞 USB转网口 突然无法识别解决方法

当 USB 转网口扩展坞在一台笔记本上无法识别,但在其他电脑上正常工作时,问题通常出在笔记本自身或其与扩展坞的兼容性上。以下是系统化的定位思路和排查步骤,帮助你快速找到故障原因:

背景:

一个M-pard(铭豹)扩展坞的网卡突然无法识别了,扩展出来的三个USB接口正常。…

未来机器人的大脑:如何用神经网络模拟器实现更智能的决策?

编辑:陈萍萍的公主一点人工一点智能 未来机器人的大脑:如何用神经网络模拟器实现更智能的决策?RWM通过双自回归机制有效解决了复合误差、部分可观测性和随机动力学等关键挑战,在不依赖领域特定归纳偏见的条件下实现了卓越的预测准…

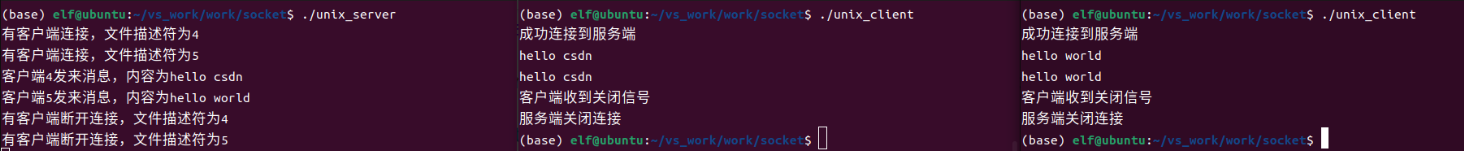

Linux应用开发之网络套接字编程(实例篇)

服务端与客户端单连接

服务端代码

#include <sys/socket.h>

#include <sys/types.h>

#include <netinet/in.h>

#include <stdio.h>

#include <stdlib.h>

#include <string.h>

#include <arpa/inet.h>

#include <pthread.h>

…

华为云AI开发平台ModelArts

华为云ModelArts:重塑AI开发流程的“智能引擎”与“创新加速器”!

在人工智能浪潮席卷全球的2025年,企业拥抱AI的意愿空前高涨,但技术门槛高、流程复杂、资源投入巨大的现实,却让许多创新构想止步于实验室。数据科学家…

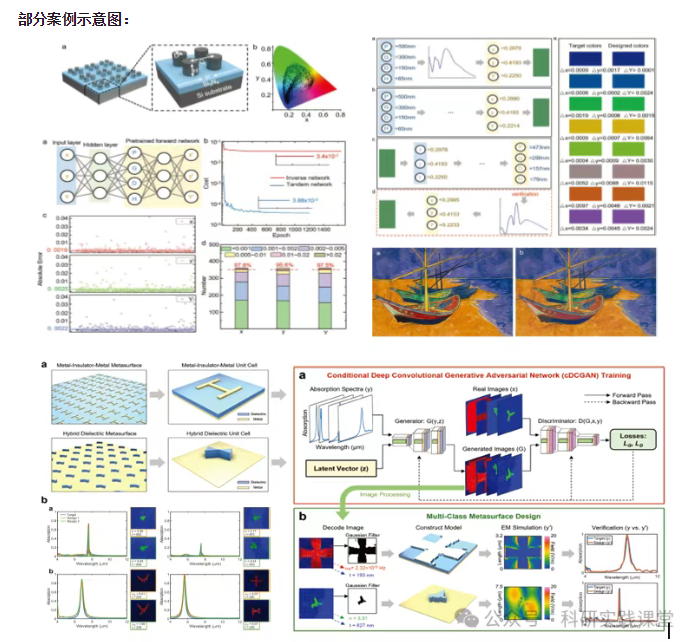

深度学习在微纳光子学中的应用

深度学习在微纳光子学中的主要应用方向

深度学习与微纳光子学的结合主要集中在以下几个方向:

逆向设计 通过神经网络快速预测微纳结构的光学响应,替代传统耗时的数值模拟方法。例如设计超表面、光子晶体等结构。

特征提取与优化 从复杂的光学数据中自…