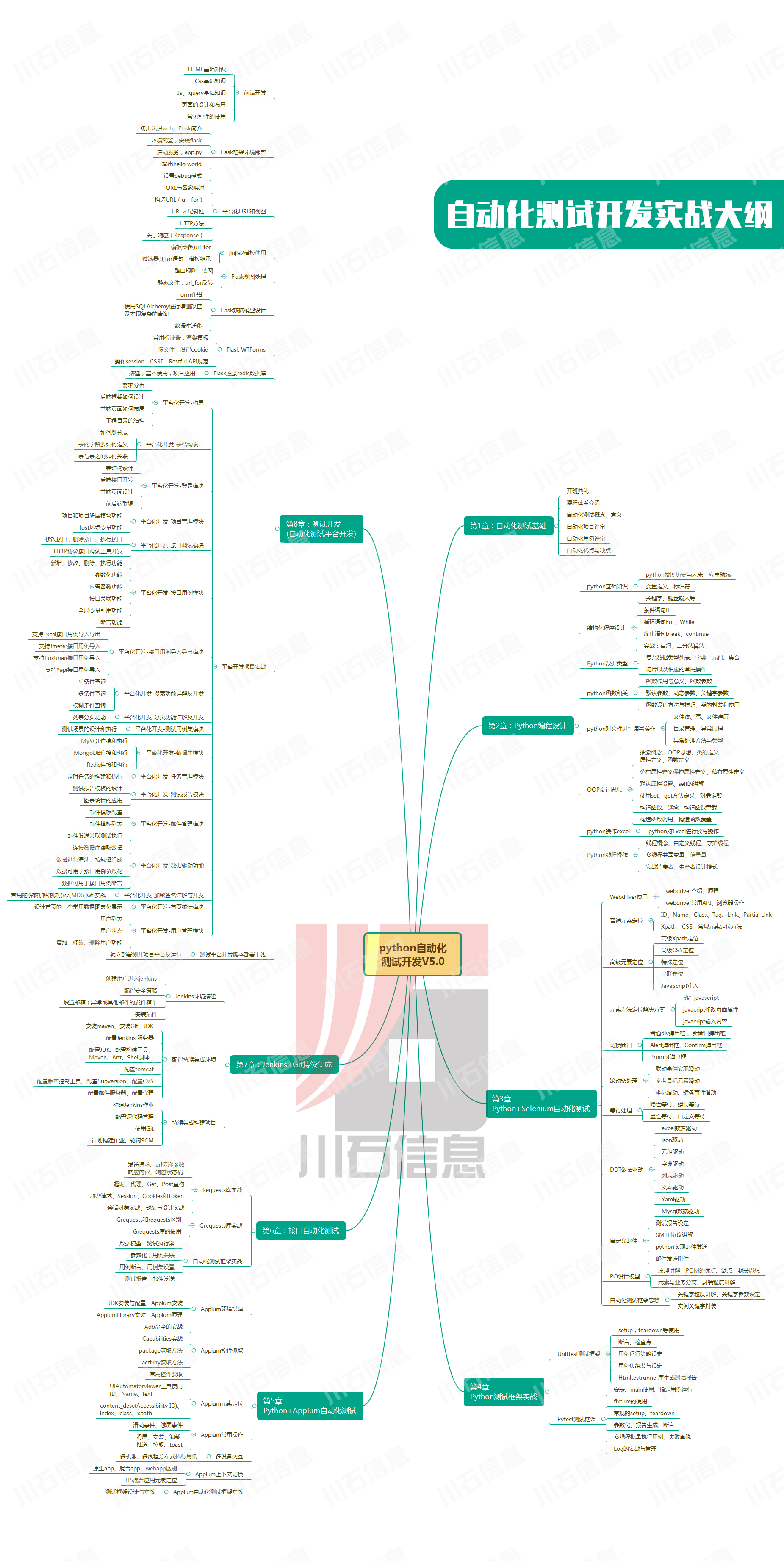

图神经网络实战(四)

news2026/3/17 5:02:10

原文zh.annas-archive.org/md5/aa0f9b9d5919ff9efe42c7ab05a87a0b译者飞龙协议CC BY-NC-SA 4.0附录 B 安装和配置 PyTorch GeometricB.1 安装 PyTorch GeometricPyTorch Geometric (PyG) 是一个基于 PyTorch 构建的库用于处理图神经网络GNNs。最新版本的 pytorch geometric 可以通过以下命令安装pip install torch_geometric。只需要 PyTorch 作为依赖项。要安装带有其扩展的 PyG您需要确保已安装并兼容的正确版本的 Compute Unified Device Architecture (CUDA)、PyTorch 和 PyG。B.1.1 在 Windows/Linux 上如果您使用的是 Windows 或 Linux 系统请按照以下步骤操作安装 PyTorch。首先为您的系统安装适当的 PyTorch 版本。您可以在官方 PyTorch 网站上找到说明pytorch.org/get-started/locally/)。如果您有 NVIDIA GPU请确保选择正确的 CUDA 版本。查找 PyTorch CUDA 版本。在安装 PyTorch 后通过在 Python 中运行以下命令来检查其版本和构建时使用的 CUDA 版本importtorchprint(torch.__version__)print(torch.version.cuda)这也可以通过以下命令行运行!python-cimport torch; print(torch.__version__)!python-cimport torch; print(torch.version.cuda)此代码的输出将在下一步中使用。安装 PyG 依赖项。从 PyG 仓库安装 PyG 依赖项torch-scatter、torch-sparse、torch-cluster、torch-spline-conv指定正确的 CUDA 版本pip install torch-scatter torch-sparse torch-cluster torch-spline-conv-f https://data.pyg.org/whl/torch-${PYTORCH}${CUDA}.xhtml在此代码中将${PYTORCH}替换为您的 PyTorch 版本例如1.13.1将${CUDA}替换为上一步中的 CUDA 版本例如cu117。安装 PyG。最后安装 PyG 库本身pip install torch-geometricB.1.2 在 MacOS 上由于 Mac 没有配备 Nvidia GPU您可以通过遵循上一节中的相同步骤安装 PyG 的cpu版本但在安装依赖项时使用cpu而不是CUDA版本。B.1.3 兼容性问题在安装扩展时确保 CUDA、PyTorch 和 PyG 的版本匹配以避免兼容性问题。使用不匹配的版本可能导致安装或运行时出错。始终参考官方文档以获取最新的安装说明和版本兼容性信息。在编写本书时我们遇到了一些令人沮丧的错误这些错误只有在安装正确的 CUDA、PyTorch 和 PyG 组合后才能解决。从处理与 PyG 兼容的工具如 Open Graph Benchmark (OGB)和 DistributedDataParallel (DDP)的经历中我们获得的一个特别见解是它们可能只与 PyTorch 的特定版本兼容。在第七章中分布式计算示例仅适用于 PyTorch v2.0.1 和 CUDA v11.8。第九章进一步阅读第一章Chen, F., Wang, Y-C., Wang, B., and Kuo, C-C. Jay. (2020). 图表示学习综述. 《APSIPA 信号与信息处理学报》9, e15.Elinas, P. (2019, June 5). 了解你的邻居图上的机器学习.mng.bz/1XBQHua, C., Rabusseau, G., and Tang, J. (2022). 高阶池化用于具有张量分解的图神经网络. 《神经信息处理系统进展》35, 6021-6033*.*Liu, Z., and Zhou, J. (2020). 《图神经网络导论》, Morgan Claypool.Sanchez-Gonzalez, A., Heess, N., Springenberg, J. T., et al. (2018). 作为推理和控制的可学习物理引擎的图网络. 在《国际机器学习会议》 (第 4470–4479 页). PMLR.第二章DIMACS. (2011). 第十届 DIMACS 实现挑战赛. 乔治亚理工学院.sites.cc.gatech.edu/dimacs10/archive/clustering.shtmlDuong, C. T., Hoang, T. D., Dang, H. T. H., Nguyen, Q. V. H., and Aberer, K. (2019). 关于图神经网络节点特征. arXiv 预印本 arXiv:1911.08795.Krebs, V. (2003, January). 分裂我们才能站立 Orgnet.com. www.orgnet.com/divided1.xhtml第七章Cai, T., Shengjie L., Keyulu X., et al. (2021). GraphNorm加速图神经网络训练的原理性方法. 在《第 38 届国际机器学习会议》 (第 1204–1215 页). PMLR.Iacurci, G. (2022, February 22). 去年消费者因欺诈损失了 58 亿美元——比 2020 年增长 70%。CNBC.com.mng.bz/2yG9Li, F., Huang, M., Yang, Y., and Zhu, X. (2011). 学习识别评论垃圾邮件. 在《第二十二届国际人工智能联合会议》 (第 2489–2493 页). IJCAI.Ma, Y., and Tang, J. (2021). 《图上的深度学习》. 剑桥大学出版社.Wang, Y., Zhao, Y., Shah, N., and Derr, T. (2022). 通过图-of-图神经网络进行不平衡图分类. 在《第 31 届 ACM 国际信息与知识管理会议》 (第 2067–2076 页). ACM.Yelp 多关系评论数据集. (n.d.). GitHub.mng.bz/RVaDZhang, L., and Sun, H. (2024). ESA-GCN使用 ENN-SMOTE 采样和注意力机制增强的图节点分类方法用于处理类别不平衡. 《应用科学》14, 111.第五章Kingma, D. P., and Welling, M. (2013). 自动编码变分贝叶斯. arXiv 预印本 arXiv:1312.6114.Langr, J., and Bok, V. (2019). 《GANs 实战》. Manning.RDKit. (n.d.). RDKit 文档. www.rdkit.org/docs/index.xhtmlTopping, J., Di Giovanni, F., Chamberlain, Dong, X., and Bronstein, M.M. (2021). 通过曲率理解图上的过度压缩和瓶颈. arXiv 预印本 arXiv:2111.14522.第七章AMD. (n.d.). Ryzen AI 软件.mng.bz/0QOlGoodrich, M. T., Tamassia, R., and Goldwasser, M. H. (2013). 《Python 中的数据结构与算法》. Wiley.Higham, N. J. (2023, September 5). 什么是 flop[博客文章].nhigham.com/2023/09/05/what-is-a-flop/Intel. (n.d.). Intel NPU 加速库.mng.bz/zZeXKingma, D. P., and Welling, M. (2013). 自动编码变分贝叶斯. arXiv 预印本 arXiv:1312.6114.PyTorch. (n.d.). 如何调整学习率.mng.bz/lY8BZeng, H., Zhou, H., Srivastava, A., Kannan, R., and Prasanna, V. (2019). GraphSAINT基于图采样的归纳学习方法. arXiv 重印 arXiv:1907.04931.第八章Bechberger, D., and Perryman, J. (2020). 《图数据库实战》. Manning.附录 ABesta, M., Peter, E., Gerstenberger, R., et al. (2019). 揭秘图数据库数据组织、系统设计和图查询的分析与分类. ArXiv 摘要/1910.09017.Duong, V. M., Nguyen, Q. V. H., Yin, H., Weidlich, M., and Aberer, K. (2019). 关于图神经网络节点的特征. arXiv 预印本 arXiv:1911.08795.Fensel, D., S¸ims¸ek, U., Angele, K., et al. (2020). 《知识图谱方法论、工具和选定的用例》. Springer.Goodrich, M. T., and Tamassia, R. (2015). 《算法设计与应用》. Wiley.Hamilton, W. L. (2020). 《图表示学习》. Springer.Nickel, M., Murphy, K., Tresp, V., and Gabrilovich, E. (2015). 关系机器学习综述. arXiv 预印本 arXiv:1503.00759v3.资源描述框架工作组. (2004, February 10). 资源描述框架RDF概念和抽象语法. W3C 推荐. www.w3.org/TR/rdf-concepts/第十章参考文献第一章1 布朗斯坦M. M.布卢纳J.莱克恩Y.斯兹拉姆A.范德盖恩施P. (2017)。几何深度学习超越欧几里得数据。IEEE 信号处理杂志34(4)18–42。2 吴Z.石瑞P.陈F.等 (2020)。图神经网络综合调查。IEEE 神经科学和机器学习杂志324–24。3 德奥N. (1974)。图论及其在工程和计算机科学中的应用印度普伦蒂斯-霍尔出版社。4 卢斯D.佩里A. D. (1949)。矩阵分析群体结构的方法。心理测量学1495–116。5 贾佳J.拜卡尔C.波特拉鲁V. K.本森A. R. (2021)。图信念传播网络。arXiv 预印本 arXiv:2106.03033。6 加特纳T.黎Q. V.斯莫拉A. (2005)。图核方法的简要游览。api.semanticscholar.org/CorpusID:48542027 库科夫L. (2015 年 5 月 19 日)。网络分析第 17 讲第一部分。图上的标签传播 [视频]。youtu.be/hmashUPJwSQ8 基恩B. A. (2017 年 5 月 9 日)。Python 中的 Isomap 降维 [博客文章]。mng.bz/ey8P。9 英R.何R.陈K.等 (2018)。图卷积神经网络在 Web 规模推荐系统中的应用。在第 24 届 ACM SIGKDD 国际知识发现与数据挖掘会议论文集。ACM。10 桑切斯-伦格林B.魏J. N.李B. K.等 (2019)。机器学习用于气味学习小分子的可泛化感知表示。arXiv 预印本 arXiv:1910.10685。11 里戈尼D.纳瓦林N.斯佩杜蒂A. (2020). 用于分子设计的条件约束图变分自编码器。2020 年 IEEE 计算智能系列研讨会SSCI。IEEE。12 江伟罗J.何M.等 (2023)。图神经网络在交通预测中的应用研究进展。ISPRS 国际地理信息期刊12(3)100。doi.org/10.3390/ijgi1203010013 桑切斯-冈萨雷斯A.赫斯N.斯普林伯格J. T.等 (2018)。图网络作为可学习的物理引擎用于推理和控制。在国际机器学习会议。PMLR。14 拉马斯佩克L.沃尔夫G. (2021)。分层图神经网络可以捕捉长距离相互作用。”在2021 年 IEEE 第 31 届国际信号处理机器学习研讨会第 1-6 页。IEEE。15 汉密尔顿W. (2020).图表示学习。摩根与克莱普顿出版社。第二章1 汉密尔顿W. L. (2020). 图表示学习。人工智能与机器学习综合讲座14(3), 1–159。2 格罗弗A.莱斯克维茨J. (2016)。Node2Vec网络的缩放特征学习。在第 22 届 ACM SIGKDD 国际知识发现与数据挖掘会议论文集第 855-864 页。ACM。3 Krebs, V. 未注明。Pol Books 数据集。www.orgnet.com4 Krebs, V. 未注明。关于美国政治的书籍。www.orgnet.com/divided.xhtml5 McInnes, L., Healy, J. 和 Melville, J. (2018)。UMAP统一流形逼近和投影用于降维。arXiv 预印本 arXiv:1802.03426。6 Rossi, A., Tiezzi, M., Dimitri, G. M., et al. (2018). 基于图神经网络的归纳-转导学习。在《模式识别中的人工神经网络》第 201-212 页。Springer-Verlag.7 Perozzi, B., Al-Rfou, R. 和 Skiena, S. (2014). DeepWalk社交表示的在线学习。在第 20 届 ACM SIGKDD 国际知识发现与数据挖掘会议论文集第 701-710 页。ACM。第三章1 Kipf, T. N. 和 Welling, M. (2016). 基于图卷积网络的半监督分类。arXiv 预印本 arXiv:1609.02907。2 Hamilton, W. L., Ying, R. 和 Leskovec, J. (2017)。在大图上的归纳表示学习。在第 31 届国际神经信息处理系统会议论文集第 1025-1035 页。Springer。3 Li, G. (2022 年 11 月)。聚合的原理方法。PyTorch Geometric。mng.bz/ga8x4 Xu, K., Li, C., Tian, Y. 等. (2018)。跳跃知识网络上的图表示学习。在国际机器学习会议第 5453-5462 页。PMLR。5 Niepert, M., Ahmed, M. 和 Kutzkov, K. (2016)。为图学习卷积神经网络。在国际机器学习会议第 2014-2023 页。PMLR。6 Shuman, D. I., Narang, S. K., Frossard, P., et al. (2012). 图信号处理领域的兴起将高维数据分析扩展到网络和其他不规则领域。IEEE 信号处理杂志第 30 卷第 3 期第 83-98 页。7 Hamilton, W. L. (2020). 图表示学习。人工智能与机器学习综合讲座第 14 卷第 3 期第 51-89 页。8 Gao, H. 和 Ji, S. (2019)。图 U-nets。在国际机器学习会议第 2083-2092 页。PMLR。9 McAuley, J., Pandey, R. 和 Leskovec, J. (2015). 推断可替代和互补产品的网络。在第 21 届 ACM SIGKDD 国际知识发现与数据挖掘会议论文集第 785-794 页。AMC。第四章1 Veličković, P., Cucurull, G., Casanova, A. 等. (2017). 图注意力网络。arXiv 预印本 arXiv:1710.10903。2 Brody, S., Alon, U. 和 Yahav, E. (2021)。图注意力网络有多关注arXiv 预印本 arXiv:2105.14491。3 网络犯罪对策联盟。 (2020)。虚假评论欺诈。www.counteringcrime.org/review-fraud。4 Howarth, Josh. 2023。 “81 Online Review Statistics。” ExplodingTopics。explodingtopics.com/blog/online-review-stats5 假评论统计数据。2024 年 9 月 26 日。CapitalOne 购物。mng.bz/ga0x6 YelpChi 数据集。GitHub。mng.bz/aveo7 拉扬纳S.和阿科古卢L.2015 年。集体意见垃圾邮件检测连接评论网络和元数据。在第 21 届 ACM SIGKDD 国际知识发现和数据挖掘会议论文集第 985-994 页。ACM。8 杜Y.刘Z.孙L.等。2020 年。增强基于图神经网络的欺诈检测器以对抗伪装的欺诈者。”在第 29 届 ACM 国际信息与知识管理会议论文集第 315-324 页。ACM。9 GATConv 消耗大量 GPU 内存问题编号#527。2019 年。GitHub。mng.bz/Zl0510 汉密尔顿W. L.英格R.和莱斯克维茨J.2017 年。在大图上进行归纳表示学习。在神经信息处理系统进展第 1025-1035 页。ACM。11 马宇田宇莫尼兹N.和查瓦拉N. V.2023 年。图上的类不平衡学习综述。arXiv 预印本 arXiv:2304.04300。12 赵天张翔王帅2021 年。GraphSMOTE使用图神经网络在图上进行不平衡节点分类。在第 14 届 ACM 国际网络搜索和数据挖掘会议论文集第 833-841 页。ACM。13 克里斯蒂娜S.和赛义德M.2022 年。使用注意力构建 Transformer 模型。机器学习精通。14 阿拉马尔J. 图像化的 Transformer。jalammar.github.io/illustrated-transformer/15 茹施T. K.布罗尼斯坦M. M.和米什拉S.2023 年。关于图神经网络中过度平滑的综述。arXiv 预印本 arXiv:2303.10993。第五章1 卡拉斯T.莱奈S.和艾拉T.2019 年。用于生成对抗网络的基于风格的生成器架构。”在第 IEEE/CVF 计算机视觉和模式识别会议论文集第 4217-4228 页。IEEE。2 麦考利J.潘德R.和莱斯克维茨J.2015 年。推断可替代和互补产品的网络。在第 21 届 ACM SIGKDD 国际知识发现和数据挖掘会议论文集第 785-794 页。ACM。3 吉普夫T. N.和韦林M.2016 年。变分图自动编码器。arXiv 预印本 arXiv:1611.07308。4 德·高N.和吉普夫T.2018 年。MolGAN用于小分子图的隐式生成模型。arXiv 预印本 arXiv:1805.11973。5 戈麦斯-博姆巴拉里R.魏J. N.杜文纳德D.等2018 年。使用分子数据驱动的连续表示自动进行化学设计。ACS 中央科学4268-276。6 Basu, V. (2024 年 12 月 17 日). 使用 VAE 生成药物分子。Keras。mng.bz/rKve7 阿隆U.和亚哈夫E.2020 年。关于图神经网络瓶颈及其实际影响。arXiv 预印本 arXiv:2006.05205。第六章1 Carnegie Mellon University. (n.d.). CMU Graphics Lab Motion Capture Database.mocap.cs.cmu.edu/2 Kipf, T., Fetaya, E., Wang, K-C., Welling, M., and Zemel, R. (2018). Neural relational inference for interacting systems. InInternational Conference on Machine Learning(pp. 2688–2697). PMLR.3 Raff, E. (2022).Inside Deep Learning. Manning.4 Xu, D., Ruan, C., Korpeoglu, E., Kumar, S., and Achan, K. (2020). Inductive representation learning on temporal graphs. arXiv preprint arXiv:2002.07962.5 Rossi, E., Chamberlain, B., Frasca, F., et al. (2020). Temporal graph networks for deep learning on dynamic graphs. arXiv preprint arXiv:2006.10637.6 Zheng, Y., Yi, L., and Wei, Z. (2024). A survey of dynamic graph neural networks. arXiv preprint arXiv:2404.18211.7 Veličković, P., Cucurull, G., Casanova, A., et al. (2017). Graph attention networks. arXiv preprint arXiv:1710.10903.Chapter 71 Khatua, A., Mailthody, V. S., Taleka, B., et al. (2023). IGB: Addressing the gaps in labeling, features, heterogeneity, and size of public graph datasets for deep learning research. arXiv preprint arXiv:2302.13522.2 McAuley, J., Pandey, R., and Leskovec, J. (2015). Inferring networks of substitutable and complementary products. InProceedings of the 21st ACM SIGKDD International Conference on Knowledge Discovery and Data Mining(pp. 785–794). ACM.3 Bronstein, M., Frasca, F., and Rossi, E. (2020, August 8). Simple scalable graph neural networks. Towards Data Science.mng.bz/N1Q74 Chiang, W-L., Liu, X., Xiaoqing, S., et al. (2019). Cluster-GCN: An efficient algorithm for training deep and large graph convolutional networks. InProceedings of the 25th ACM SIGKDD International Conference on Knowledge Discovery and Data Mining(pp. 257–266). ACM.5 PyTorch. (n.d.). PyTorch Profiler with TensorBoard.mng.bz/EaAj6 PyTorch. (n.d.). PyTorch Profiler.mng.bz/8OBB7 Heim, L. (2023, September 11). FLOP for quantity, FLOP/s for performance [blogpost].mng.bz/KGnZ8 Wu, Z., Pan, S., Chen, F., et al. (2020). A comprehensive survey on graph neural networks.IEEE Transactions on Neural Networks and Learning Systems,32,4–24.9 PyTorch Geometric. (n.d.). Torch_Geometric.Loader.mng.bz/BXBr10 PyTorch Geometric. (n.d.). Torch_Geometric.Sampler.mng.bz/dX8v11 Kipf, T. N., and Welling, M. (2016). Variational graph auto-encoders. arXiv preprint arXiv:1611.07308.12 PyTorch Geometric. (n.d.). Memory-efficient aggregations.mng.bz/9Ymo13 namespace-PT. (2021, August 15). A comprehensive tutorial to PyTorch DistributedDataParallel.mng.bz/YDzK14 PyTorch Geometric. (n.d.). Distributed batching. GitHub.mng.bz/GeBR15 林H.颜M.杨X.等. (2022). 分布式 GNN 在 GPU 上的特性和理解.”IEEE 计算机架构信函,21,21–24.16 德费拉德M.布雷斯松X.和范德盖恩施P. (2016). 基于快速局部频谱滤波的图上的卷积神经网络. 在神经信息处理系统进展(第 3844–3852 页). ACM.17 PyTorch Geometric. (n.d.) 通过远程后端扩展 GNN.mng.bz/jpdp18 PyTorch Geometric. (n.d.) Graph_store.py. GitHub.mng.bz/W2Yw19 KuzuDB. (n.d.). KuzuDB 图存储实现. GitHub.mng.bz/OBXo20 ArangoDB. (n.d.). ArangoDB 远程后端模块FastGraphML. GitHub.github.com/arangoml/fastgraphml#fastgraphml21 黄Z.张S.西C.刘T.和周M. (2021). 通过图粗化扩展图神经网络. 在第 27 届 ACM SIGKDD 知识发现与数据挖掘会议(第 675–684 页). ACM.第八章1 亚历克索普洛斯P. (2020).数据语义建模. O’Reilly 媒体.2 巴克R. (1990).CaseMethod: 实体关系建模. 埃迪生·韦斯利出版社.3 波科尼J. (2016). 图数据库的概念和数据库建模. 在第 20 届国际数据库工程与应用研讨会(IDEAS 16)(第 370–377 页). ACM.4 戈斯尼尔D.和布罗切勒M. (2020).图数据实践指南. O’Reilly 媒体.5 波科尼J.和科瓦奇奇J. (2017). 图数据库中的完整性约束.计算机科学进展, 109,975–981.6 内戈A. (2021).图增强机器学习. 曼宁出版社.7 Neo4j GraphAcademy. (n.d.). 图数据建模基础.mng.bz/pKo2附录 A1 迪奥N. (2017).图论及其在工程和计算机科学中的应用. 多佛出版社.2 科尔曼T. H.利瑟森C. E.里维斯R. L.和斯坦C. (2009).算法导论. 第 3 版. MIT 出版社.3 斯基纳S. (1997).算法设计手册. Springer-Verlag.4 德雷夫斯S. E. (1969). 一些最短路径算法的评价.运筹学, 17,395–412.索引Aaggr 参数激活函数邻接表, 第 2 版Avro准确度指标属性Amazon 产品数据集, 第 2 版, 第 3 版聚合运算符平均路径长度邻接矩阵, 第 2 版, 第 3 版aggr 参数, 第二章, 第三章Adam 优化器APIs应用程序编程接口图对象的属性聚合操作相邻节点Add_self_loops聚合方法, 第二章高级聚合工具应用中的实际考虑因素ASIN亚马逊标准识别号Add_Node 方法注意力系数计算B使用采样方法进行批处理选择合适的采样器BalancedNodeSampler 类BFS广度优先搜索books_graph 数据集, 第二章BPTT时间反向传播大数据中介中心性基线二部图, 第二章, 第三章, 第四章BCE二元交叉熵双向性books_graph 变量books_gml 数据集C循环图CNNs卷积神经网络卷积 GNNs卷积图神经网络connected_components 方法Cypher 语言calculate_loss 方法连通图连通性常数时间复杂度收敛速度卷积方法, 第二章聚类CSV逗号分隔值, 第二章团方法连续性conv2 层Connected_Graph 方法cat 参数CPUs中央处理单元, 第二章CUDA统一计算设备架构概念模式, 第二章D将数据对象转换为迭代器Delete_Node 方法DFS深度优先搜索, 第 2 次, 第 3 次数据集对象方向性解码多样化操作DAG有向无环图DataParallel有向边data.x 节点特征矩阵DataBatch数据隐私Dataloader 类dataloader 模块深度学习方法DDP分布式数据并行主函数多进程 spawn准备模型和数据运行训练, 第 2 次为分布式训练设置训练函数动态图, 第 2 次将自动编码器与 RNN 结合针对的图注意力网络, 第 2 次姿态估计循环神经网络数据集对象dataloader, 第 2 次DGL深度图库, 第 2 次数据集表示直径判别模型度降维调试度分布数据准备和项目规划项目定义项目目标和范围数据大小和速度数据结构数据类Directed_Graph 方法data.x 节点特征对象数据模型数据数据模块torch_geometric.data度矩阵, 第 2 次数据集类, 第 2 次数据集模块torch_geometric_datasets有向图E边属性编码ER实体-关系图边索引张量边预测, 第二部分边到节点矩阵边列表, 第二部分边到节点函数, 第二部分, 第三部分ETL提取、转换、加载步骤创建邻接列表创建边列表ELU指数线性单元边索引EDA探索性数据分析嵌入可解释性边权重周期F滤波器核操作拟合方法from_networkx 方法FLOP, 第二部分F1 分数特征存储GGraphSAGE图采样和聚合, 第二部分, 第三部分聚合函数图自动编码器GAEs, 第二部分使用 GNN 生成图生成模型概述GATConv 层GATs图注意力网络, 第二部分, 第三部分, 第四部分概述, 第二部分训练模型Gremlin 语言GeoGrid, 第二部分Graph_State 方法图粗化GNN 架构Gumbel 温度图对象GRUs门控循环单元, 第二部分, 第三部分graclus(edge_index) 函数GlooGPU图形处理单元, 第二章, 第三章GCNs图卷积网络, 第二章聚合函数, 第二章基于图的学习定义Get_Node 方法GDPR通用数据保护条例GraphStore, 第二章G2GNN图图神经网络图, 第二章算法, 第二章类别聚类系数定义, 第二章维度暴露基础属性, 第二章表示系统类型gcn_norm 函数, 第二章GNNs图神经网络, 第二章, 第三章, 第四章, 第五章应用项目考虑因素使用创建嵌入, 第二章数据管道示例定义设计图模型训练的心理模型概述, 第二章独特机制何时使用, 第二章图大小图数据查找位置图数据集GATv2Conv 层图预测任务GCNConv 类, 第二章获取方法图嵌入使用 Node2Vec 创建, 第二章理论基础Gumbel-Softmax图创建方法H硬件需求超图, 第 2 次同质图heads 参数硬件配置异质/同质图硬件速度和容量局部化模式层次异质图, 第 2 次I归纳偏差推理速度集成测试输入, 第 2 次关联矩阵, 第 2 次标识符归纳学习index_to_key 属性InMemoryDataset 类实现细节I/O 延迟实例模型, 第 2 次隐含关系和相互依赖关键指标IPUs智能处理单元内积解码器, 第 2 次正则化潜在空间索引数组入度J联合概率JumpingKnowledge 层JSONjson 模块JumpingKnowledge 聚合方法JK跳跃知识网络, 第 2 次KKL 散度Kullback-Liebler 散度知识图谱k-分割图关键词Kamada-Kawai 算法Llstm 参数logits线性时间复杂度潜在空间语言和系统无关的编码格式层输出标签, 第 2 次LSTM长短期记忆大规模学习和推理使用采样方法进行批处理GNN 算法的选择数据表示的选择, 第 2 次硬件配置的选择规模问题的框架解决规模问题的技术, 第 2 次标记的掩码布尔掩码长短期记忆 (LSTM) 网络拉普拉斯矩阵, 第 2 次损失函数 (loss_fn) 函数链接预测任务库图神经网络 (GNN)LSTM 聚合对数时间复杂度loadmat 函数日志记录标签 NumPy 数组链接预测用于图自动编码器的亚马逊产品数据集, 第 2 次定义, 第 2 次训练, 第 2 次特定语言M均方误差 (MSE), 第 2 次model.eval() 方法多头注意力机械推理分子图, 第 2 次多层感知器 (MLP), 第 2 次, 第 3 次内存到数据比率多重图矩阵乘法max_pool() 函数手动转换分子科学模型前向传递基于矩阵的内存大小掩码模式参数最大参数最大聚合Matplotlib 库平均聚合, 第 2 次单部分图消息传递, 第 2 次N神经处理单元 (NPUs)NeighborSampler 函数邻域聚合节点分类node2vec 方法邻域加载器, 第 2 次Node_List 方法Node_Neighbors 方法节点特性num_nodes节点嵌入数据预处理端到端模型中随机森林分类名称负样本非结构化属性NLP (自然语言处理), 第 2 次节点N2V (node2vec), 第 2 次应用和考虑因素嵌入加载数据设置参数创建嵌入转换和可视化嵌入, 第 2 次N2V (node2vec) 嵌入对新图的可适应性增强特征集成特定任务优化Number_of_Nodes 构造函数邻域NRI (神经关系推理) 模型, 第 2 次训练num_vars 变量NetworkX 库, 第 2 次, 第 3 次node2edge 函数, 第 2 次节点表示更新node_embeddings 对象NCCL (NVIDIA 集体通信库)NeighborLoader 数据加载器Node2Vec Python 库非局部交互关键指标O优化器初始化本体ogbn-products 数据集, 第 2 次OGB (开放图基准), 第 2 次OLAP (在线应用处理)过度压缩OOD (分布外) 泛化过度平滑, 第 2 次输出OLTP (在线事务处理)PPinterest参数类产品类别预测创建模型类加载数据和处理数据模型性能分析第 2 次模型训练第 2 次产品捆绑演示第 2 次并行性项目目标预测Pickle 数据编码属性PyGPyTorch Geometric第 2 次GCN 在GraphSAGE 在在中实现的批处理使用原始文件创建数据对象在数据加载器中使用数据对象创建不使用数据集对象使用自定义类和输入文件创建数据集对象GATs 的实现导入和准备图数据安装和配置第 2 次邻域聚合在处理边和节点特征采样器第 2 次项目需求和范围第 2 次排列不变性路径psutil 库prediction_steps 变量pred_adj 邻接矩阵并行和分布式处理DDP 的代码示例使用分布式数据并行DDP并行边第 2 次池化图粗化属性图PinSage问题半径姿态估计使用内存构建模型设置问题Q二次时间复杂度QED药物相似性定量估计R排名远程存储使用进行训练第 2 次示例return_edge_mask 选项RNNs (循环神经网络), 第 2 版, 第 3 版, 第 4 版, 第 5 版, 第 6 版推荐引擎随机森林分类接收系统表示, 第 2 版节点相似性和上下文随机游走原始数据, 第 2 版到邻接表和边列表RDF (资源描述框架) 图RandomForestClassifier细化, 第 2 版基线模型性能, 第 2 版dropout模型深度ReLU (修正线性单元), 第 2 版read_edgelist 方法评论垃圾邮件数据集探索性数据分析图结构, 第 2 版节点特征, 第 2 版阅读 GNN 文献常见的图表示法远程后端, 第 2 版ROC (接收者操作特征), 第 2 版RefMLPEncoder关系数据库, 第 2 版, 第 3 版RDF 图数据模型知识图谱简约图数据模型节点和边类型非图数据模型属性图数据模型远程数据源S子图方法子图, 第 2 版结构属性系统驱动编码选择模式, 第 2 版, 第 3 版SMOTE (合成少数类过采样技术)垃圾邮件和欺诈评论检测稀疏性关键指标系统架构序列化2 次缩放 GNNs图粗化2 次自环2 次3 次对称归一化谱方法稀疏矩阵空间时序 GNNs使用 GRU 解码姿态数据编码姿态数据自注意力最短路径采样2 次SAGEConv 类SMILES简化分子输入行系统求和聚合空间方法浅层方法空间复杂度合成数据大小属性采样器简单图最短路径长度SPARQL 语言SAS合成可访问性分数空间卷积Ttorch_geometric.profile 模块时序邻接矩阵to_edge_index 实用函数时序模型测试和故障排除训练GCN 基线MLP2 次基线模型非 GNN 基线为…准备数据训练掩码团队分析test_train_split 函数平移不变性测试2 次torch.no_grad()方法TGAT时序 GAT树TPUs张量处理单元torch_geometric.transforms.ToSparseTensor 函数2 次归纳方法遍历故障排除技术债务表格数据, 第 2 次图数据以及增加深度和意义将泰坦尼克数据集重铸为图时间和空间复杂度, 第 2 次torch_geometric.data.GraphStore 对象transformers归纳学习torch-scatter 依赖torch.no_grad()函数thop 库, 第 2 次torch_geometric.data.FeatureStore 对象tpr真正例率遍历算法U无权图单元测试util 模块唯一方法无向边用例无向图Utils 模块torch_geometric.utilsUpdate_Node 方法V可视化可视化库VGAEs变分图自动编码器, 第 2 次构建, 第 2 次用于生成图, 第 2 次何时使用顶点VariationalGCNEncoder 层W在 Windows 上安装 PyTorch Geometric权重wv 方法加权图XX_train_gnn 嵌入Xavier 初始化X_n2v NumPy 数组XGBoost极端梯度提升XMLZ梯度归零

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如若转载,请注明出处:http://www.coloradmin.cn/o/2418314.html

如若内容造成侵权/违法违规/事实不符,请联系多彩编程网进行投诉反馈,一经查实,立即删除!相关文章

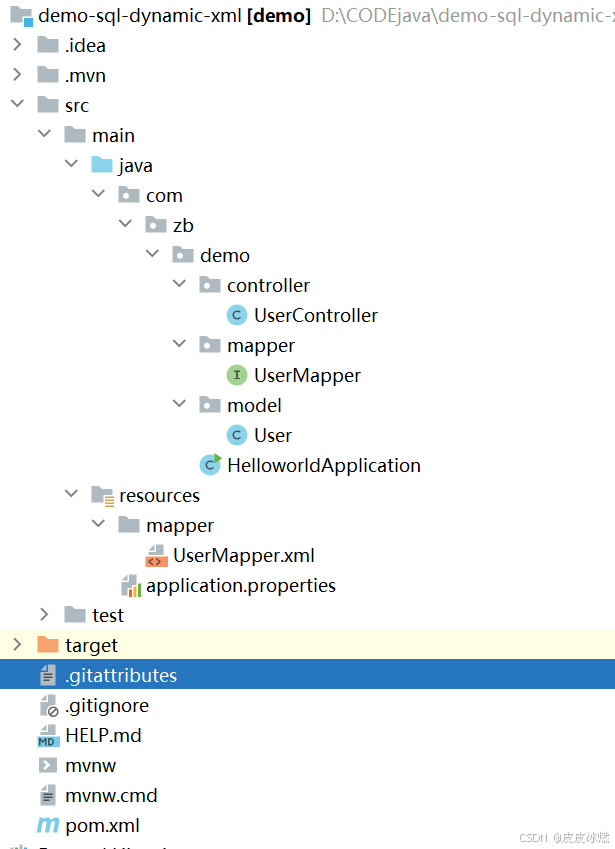

SpringBoot-17-MyBatis动态SQL标签之常用标签

文章目录 1 代码1.1 实体User.java1.2 接口UserMapper.java1.3 映射UserMapper.xml1.3.1 标签if1.3.2 标签if和where1.3.3 标签choose和when和otherwise1.4 UserController.java2 常用动态SQL标签2.1 标签set2.1.1 UserMapper.java2.1.2 UserMapper.xml2.1.3 UserController.ja…

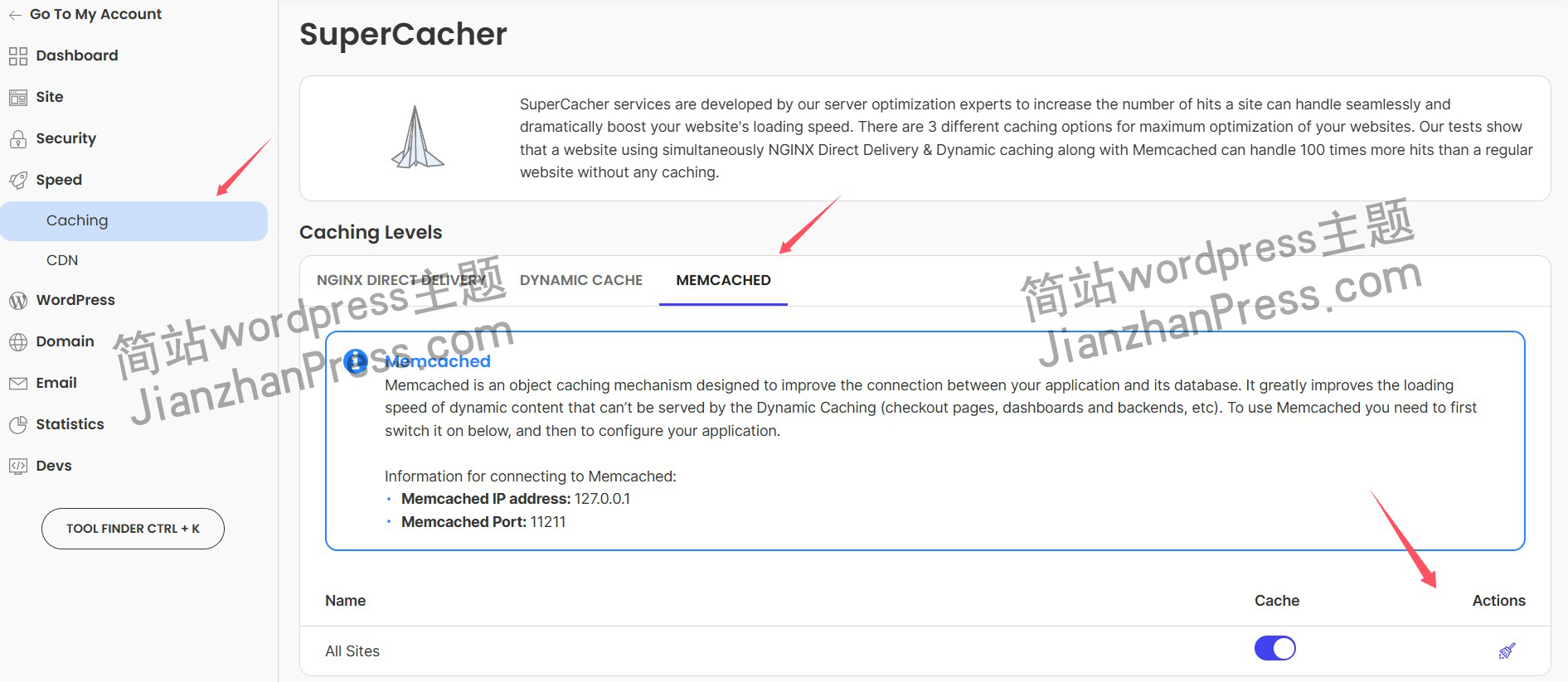

wordpress后台更新后 前端没变化的解决方法

使用siteground主机的wordpress网站,会出现更新了网站内容和修改了php模板文件、js文件、css文件、图片文件后,网站没有变化的情况。

不熟悉siteground主机的新手,遇到这个问题,就很抓狂,明明是哪都没操作错误&#x…

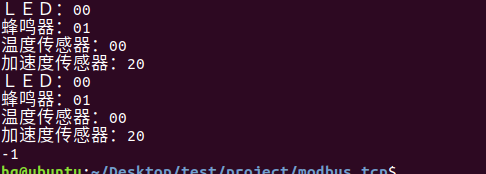

网络编程(Modbus进阶)

思维导图 Modbus RTU(先学一点理论)

概念 Modbus RTU 是工业自动化领域 最广泛应用的串行通信协议,由 Modicon 公司(现施耐德电气)于 1979 年推出。它以 高效率、强健性、易实现的特点成为工业控制系统的通信标准。 包…

UE5 学习系列(二)用户操作界面及介绍

这篇博客是 UE5 学习系列博客的第二篇,在第一篇的基础上展开这篇内容。博客参考的 B 站视频资料和第一篇的链接如下:

【Note】:如果你已经完成安装等操作,可以只执行第一篇博客中 2. 新建一个空白游戏项目 章节操作,重…

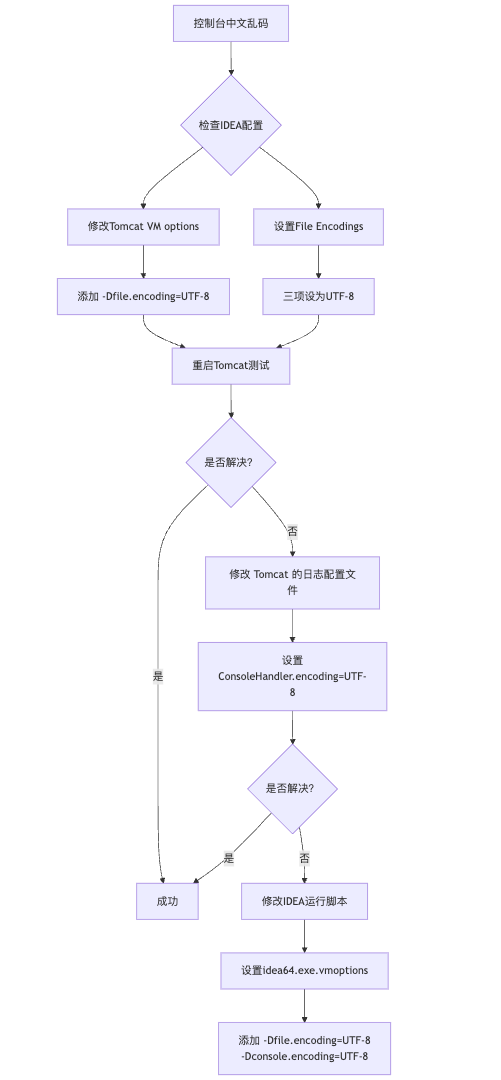

IDEA运行Tomcat出现乱码问题解决汇总

最近正值期末周,有很多同学在写期末Java web作业时,运行tomcat出现乱码问题,经过多次解决与研究,我做了如下整理:

原因:

IDEA本身编码与tomcat的编码与Windows编码不同导致,Windows 系统控制台…

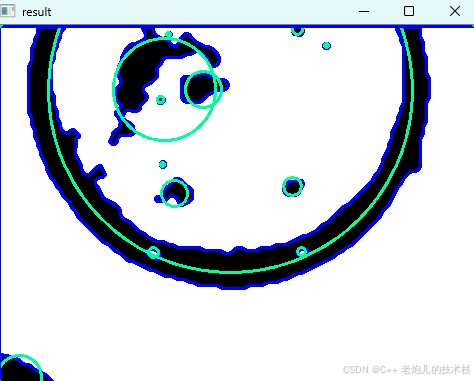

利用最小二乘法找圆心和半径

#include <iostream>

#include <vector>

#include <cmath>

#include <Eigen/Dense> // 需安装Eigen库用于矩阵运算 // 定义点结构

struct Point { double x, y; Point(double x_, double y_) : x(x_), y(y_) {}

}; // 最小二乘法求圆心和半径 …

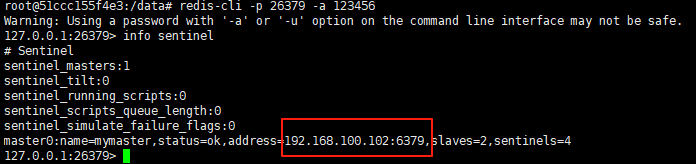

使用docker在3台服务器上搭建基于redis 6.x的一主两从三台均是哨兵模式

一、环境及版本说明

如果服务器已经安装了docker,则忽略此步骤,如果没有安装,则可以按照一下方式安装: 1. 在线安装(有互联网环境): 请看我这篇文章 传送阵>> 点我查看 2. 离线安装(内网环境):请看我这篇文章 传送阵>> 点我查看

说明:假设每台服务器已…

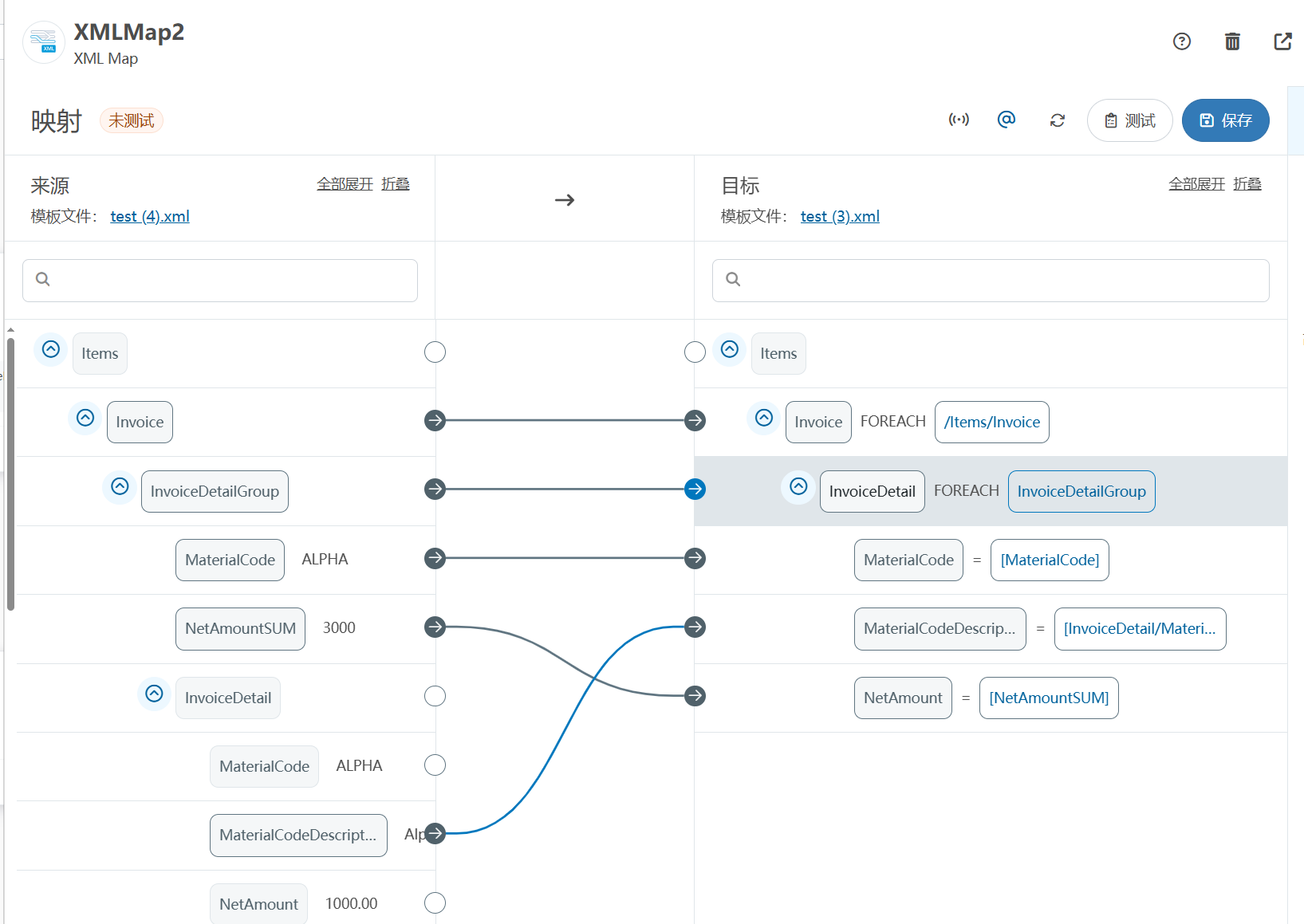

XML Group端口详解

在XML数据映射过程中,经常需要对数据进行分组聚合操作。例如,当处理包含多个物料明细的XML文件时,可能需要将相同物料号的明细归为一组,或对相同物料号的数量进行求和计算。传统实现方式通常需要编写脚本代码,增加了开…

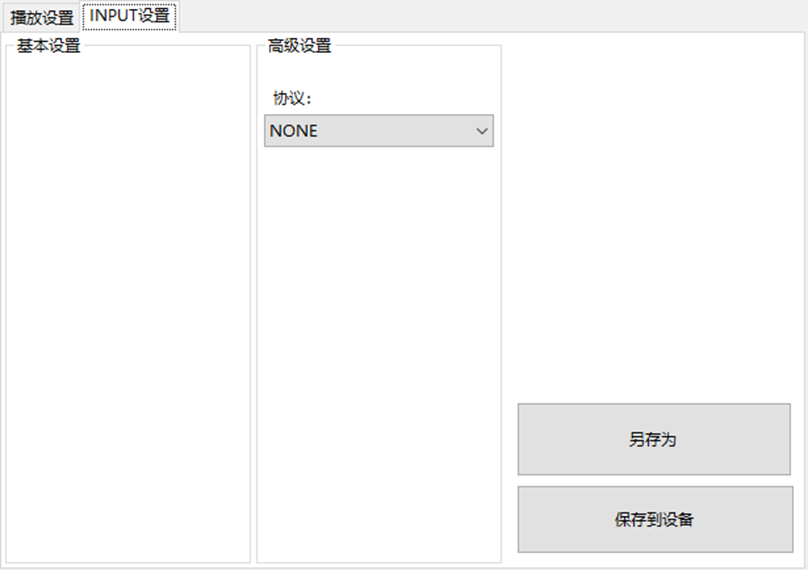

LBE-LEX系列工业语音播放器|预警播报器|喇叭蜂鸣器的上位机配置操作说明

LBE-LEX系列工业语音播放器|预警播报器|喇叭蜂鸣器专为工业环境精心打造,完美适配AGV和无人叉车。同时,集成以太网与语音合成技术,为各类高级系统(如MES、调度系统、库位管理、立库等)提供高效便捷的语音交互体验。

L…

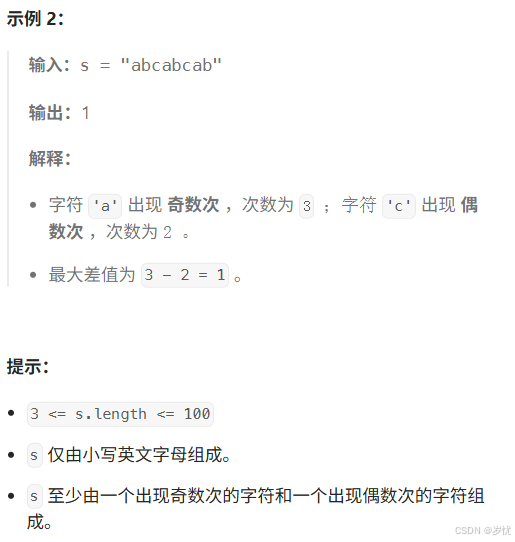

(LeetCode 每日一题) 3442. 奇偶频次间的最大差值 I (哈希、字符串)

题目:3442. 奇偶频次间的最大差值 I 思路 :哈希,时间复杂度0(n)。 用哈希表来记录每个字符串中字符的分布情况,哈希表这里用数组即可实现。

C版本:

class Solution {

public:int maxDifference(string s) {int a[26]…

【大模型RAG】拍照搜题技术架构速览:三层管道、两级检索、兜底大模型

摘要

拍照搜题系统采用“三层管道(多模态 OCR → 语义检索 → 答案渲染)、两级检索(倒排 BM25 向量 HNSW)并以大语言模型兜底”的整体框架: 多模态 OCR 层 将题目图片经过超分、去噪、倾斜校正后,分别用…

【Axure高保真原型】引导弹窗

今天和大家中分享引导弹窗的原型模板,载入页面后,会显示引导弹窗,适用于引导用户使用页面,点击完成后,会显示下一个引导弹窗,直至最后一个引导弹窗完成后进入首页。具体效果可以点击下方视频观看或打开下方…

接口测试中缓存处理策略

在接口测试中,缓存处理策略是一个关键环节,直接影响测试结果的准确性和可靠性。合理的缓存处理策略能够确保测试环境的一致性,避免因缓存数据导致的测试偏差。以下是接口测试中常见的缓存处理策略及其详细说明:

一、缓存处理的核…

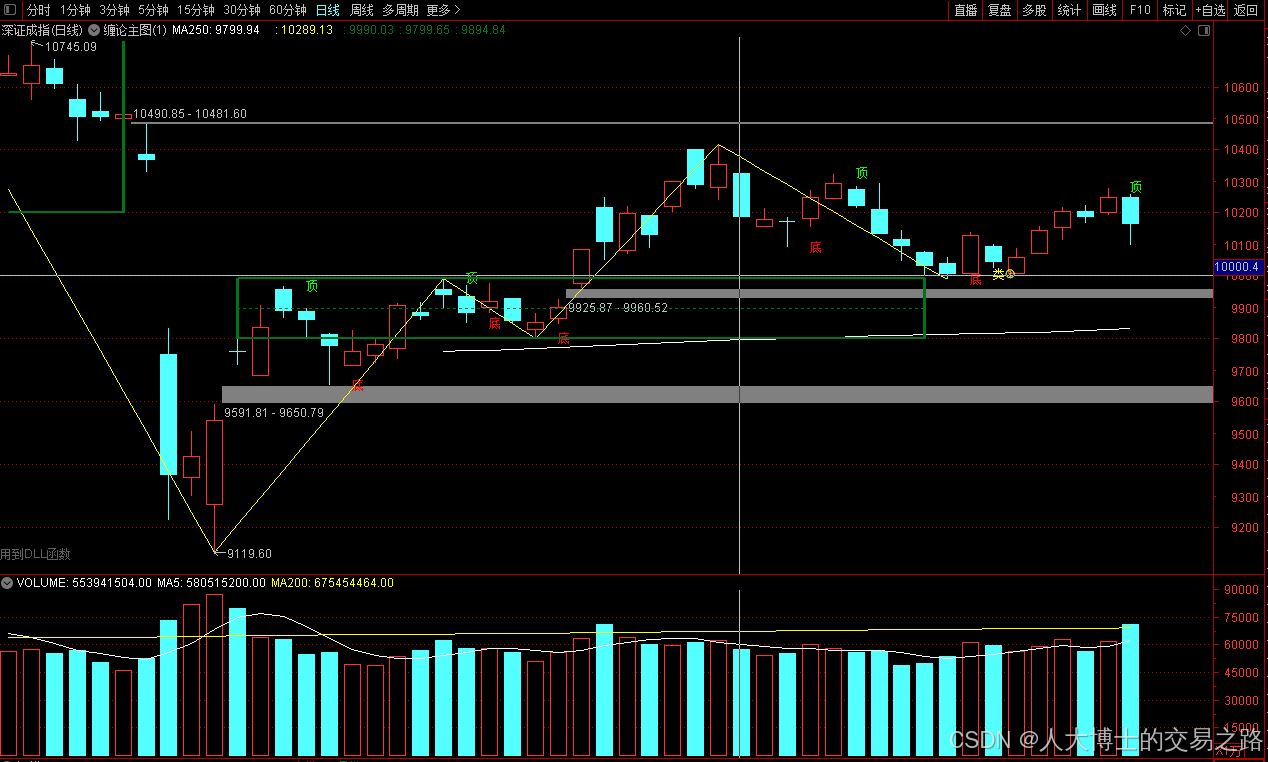

龙虎榜——20250610

上证指数放量收阴线,个股多数下跌,盘中受消息影响大幅波动。 深证指数放量收阴线形成顶分型,指数短线有调整的需求,大概需要一两天。 2025年6月10日龙虎榜行业方向分析 1. 金融科技

代表标的:御银股份、雄帝科技

驱动…

观成科技:隐蔽隧道工具Ligolo-ng加密流量分析

1.工具介绍

Ligolo-ng是一款由go编写的高效隧道工具,该工具基于TUN接口实现其功能,利用反向TCP/TLS连接建立一条隐蔽的通信信道,支持使用Let’s Encrypt自动生成证书。Ligolo-ng的通信隐蔽性体现在其支持多种连接方式,适应复杂网…

铭豹扩展坞 USB转网口 突然无法识别解决方法

当 USB 转网口扩展坞在一台笔记本上无法识别,但在其他电脑上正常工作时,问题通常出在笔记本自身或其与扩展坞的兼容性上。以下是系统化的定位思路和排查步骤,帮助你快速找到故障原因:

背景:

一个M-pard(铭豹)扩展坞的网卡突然无法识别了,扩展出来的三个USB接口正常。…

未来机器人的大脑:如何用神经网络模拟器实现更智能的决策?

编辑:陈萍萍的公主一点人工一点智能 未来机器人的大脑:如何用神经网络模拟器实现更智能的决策?RWM通过双自回归机制有效解决了复合误差、部分可观测性和随机动力学等关键挑战,在不依赖领域特定归纳偏见的条件下实现了卓越的预测准…

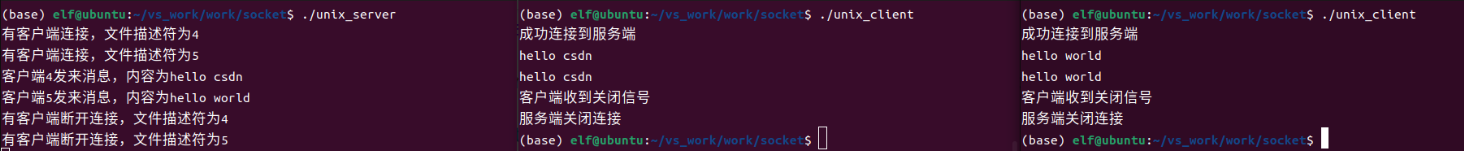

Linux应用开发之网络套接字编程(实例篇)

服务端与客户端单连接

服务端代码

#include <sys/socket.h>

#include <sys/types.h>

#include <netinet/in.h>

#include <stdio.h>

#include <stdlib.h>

#include <string.h>

#include <arpa/inet.h>

#include <pthread.h>

…

华为云AI开发平台ModelArts

华为云ModelArts:重塑AI开发流程的“智能引擎”与“创新加速器”!

在人工智能浪潮席卷全球的2025年,企业拥抱AI的意愿空前高涨,但技术门槛高、流程复杂、资源投入巨大的现实,却让许多创新构想止步于实验室。数据科学家…

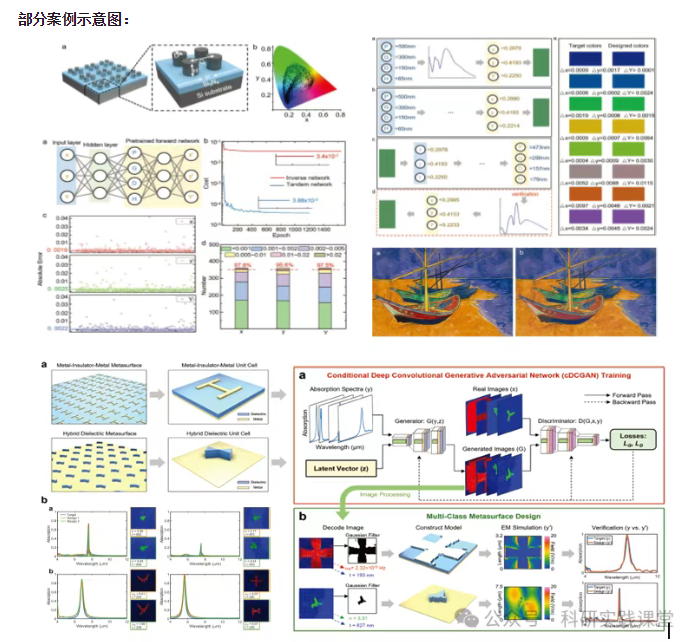

深度学习在微纳光子学中的应用

深度学习在微纳光子学中的主要应用方向

深度学习与微纳光子学的结合主要集中在以下几个方向:

逆向设计 通过神经网络快速预测微纳结构的光学响应,替代传统耗时的数值模拟方法。例如设计超表面、光子晶体等结构。

特征提取与优化 从复杂的光学数据中自…