在人工智能(AI)算法中,向量(Vector)是一种将现实世界中的数据(如图像、文本、音频等)转化为计算机可处理的数值型特征表示的工具。它是连接人类认知(如语义、视觉特征)与机器数学运算(如矩阵乘法、距离计算)的桥梁,广泛应用于机器学习、深度学习、自然语言处理(NLP)、计算机视觉(CV)等领域。

一、AI中向量的核心作用:数据的数学化表征

AI算法(尤其是深度学习)无法直接处理文本、图像等非结构化数据,必须先将其转换为数值向量,使数据具备以下特性:

- 可计算性:向量支持数学运算(如点积、余弦相似度),便于算法提取特征、衡量数据关联度。

- 语义表达:向量的每个维度可隐含数据的潜在特征(如文本的情感倾向、图像的颜色纹理),相近语义的数据在向量空间中距离更近。

- 泛化能力:通过模型训练(如神经网络),向量能捕捉数据的高层抽象特征(如“猫”的图像向量可编码“有毛、四条腿”等共性)。

二、AI中向量的常见类型与生成方式

1. 文本向量(Text Vectors)

- 作用:将词语、句子或文档转换为数值向量,用于语义理解、文本分类、信息检索等。

- 生成方法:

- 传统方法:

- 独热编码(One-Hot Encoding):用稀疏向量表示词语(如“苹果”→[1,0,0,…],“香蕉”→[0,1,0,…]),优点是简单直接,缺点是无法体现词语相关性(所有向量正交,余弦相似度为0)。

- TF-IDF向量:结合词频(TF)和逆文档频率(IDF),衡量词语在文档中的重要性,向量维度为词典大小,缺点是高维稀疏、缺乏语义关联。

- 深度学习方法:

- 词嵌入(Word Embedding):通过神经网络训练生成稠密向量(如Word2Vec、GloVe),例如“国王”−“男人”+“女人”≈“女王”,体现语义类比关系。

- 句/文档嵌入:如BERT的

CLS向量、Sentence-BERT生成的句向量,通过预训练模型捕捉上下文语义。

- 传统方法:

2. 图像向量(Image Vectors)

- 作用:将图像像素转换为特征向量,用于图像分类、目标检测、图像检索等。

- 生成方法:

- 传统特征工程:手工设计特征(如HOG特征、SIFT特征),向量维度固定(如HOG特征常为36维)。

- 深度学习方法:通过卷积神经网络(CNN)提取高层特征,例如:

- 在ResNet中,输入图像经多层卷积后,最终全连接层的输出即为图像向量(如1000维,对应分类类别);

- 图像检索场景中,可通过对比学习训练模型,生成更具区分度的向量(如FaceNet生成的人脸特征向量)。

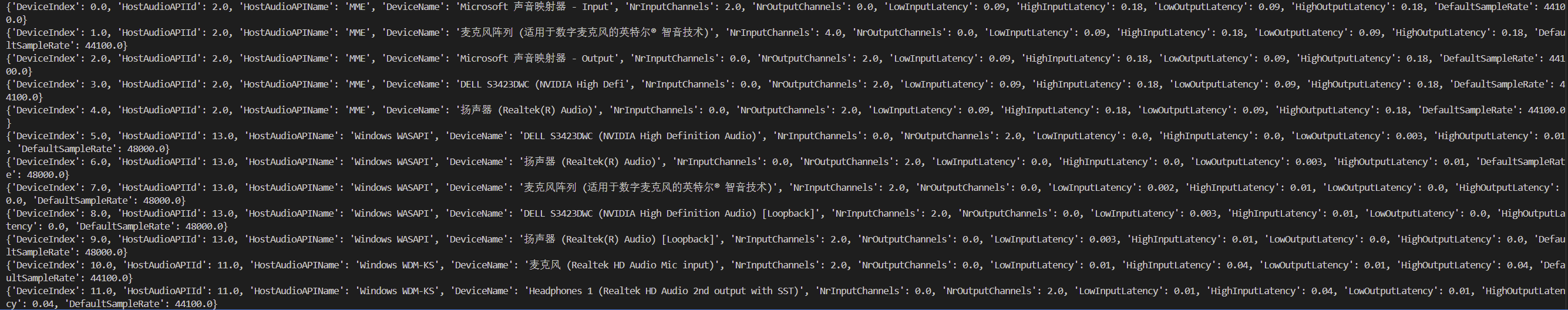

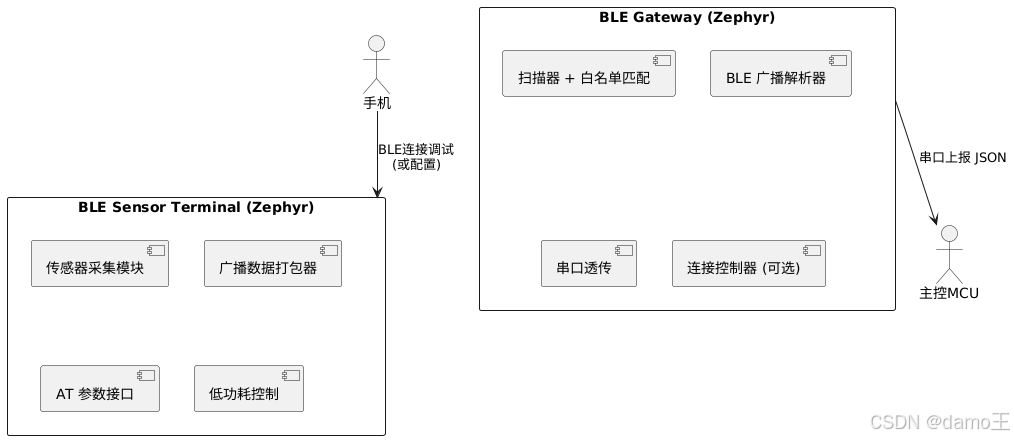

3. 音频向量(Audio Vectors)

- 作用:将音频信号转换为向量,用于语音识别、音乐分类等。

- 生成方法:

- 传统方法:提取声学特征(如MFCC、梅尔频谱),向量维度通常为几十维。

- 深度学习方法:通过循环神经网络(RNN)或Transformer处理音频序列,生成上下文相关的向量(如语音识别模型Wav2Vec的输出)。

4. 结构化数据向量(Tabular Vectors)

- 作用:将表格数据(如用户信息、传感器数据)中的数值型/分类型特征转换为向量,用于传统机器学习模型(如随机森林、XGBoost)或深度学习模型(如Wide & Deep)。

- 处理方式:

- 数值型特征:直接作为向量分量(如年龄、收入);

- 分类型特征:通过独热编码、标签编码等转换为数值向量。

三、向量在AI算法中的关键应用

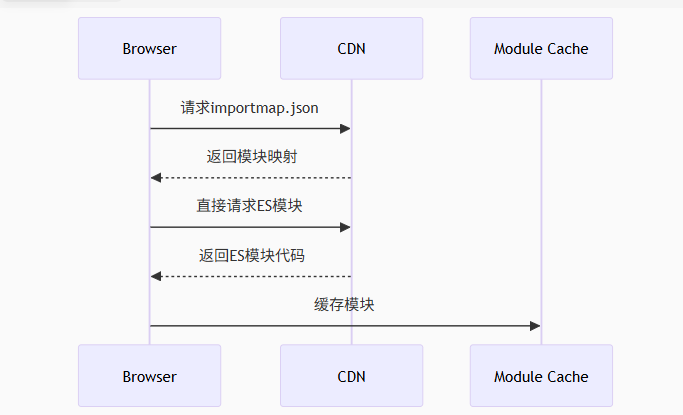

1. 相似度计算与检索

- 核心逻辑:将查询数据(如文本、图像)转换为向量,在向量数据库中检索与查询向量最相似的样本。

- 相似度度量方法:

- 余弦相似度:适用于高维稀疏向量(如文本),衡量向量方向的相似性,公式:

[

\text{cosine相似度} = \frac{\mathbf{a} \cdot \mathbf{b}}{|\mathbf{a}| |\mathbf{b}|}

] - 欧氏距离:适用于稠密向量(如图像特征),衡量向量空间中的绝对距离,公式:

[

d(\mathbf{a}, \mathbf{b}) = \sqrt{\sum_{i=1}^n (a_i - b_i)^2}

]

- 余弦相似度:适用于高维稀疏向量(如文本),衡量向量方向的相似性,公式:

- 应用场景:

- 推荐系统:计算用户向量与物品向量的相似度,推荐相似物品;

- 图像检索:输入一张图片,检索数据库中相似的图片(如Google图片搜索);

- 语义搜索:将用户查询转换为向量,匹配文档向量(如BERT + 向量数据库的组合)。

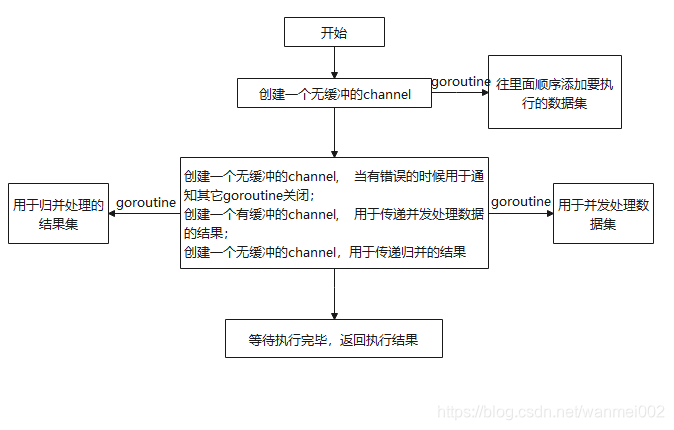

2. 模型输入与特征学习

- 作用:向量是深度学习模型的输入基础,模型通过多层神经网络对向量进行特征变换,提取更抽象的表示。

- 示例:

- 在NLP中,词向量作为Transformer的输入,经自注意力机制生成上下文相关的句向量;

- 在CV中,图像向量(像素值)经CNN卷积层后,逐步提取边缘、纹理、物体部件等特征。

3. 生成模型与向量操作

- 在生成对抗网络(GAN)中,随机噪声向量(如服从正态分布的低维向量)经生成器转换为高维数据(如图像、文本);

- 在文本生成中,通过向量插值(如“男人”向量 + “皇室”向量 ≈ “国王”向量)实现语义编辑。

四、向量的关键技术挑战

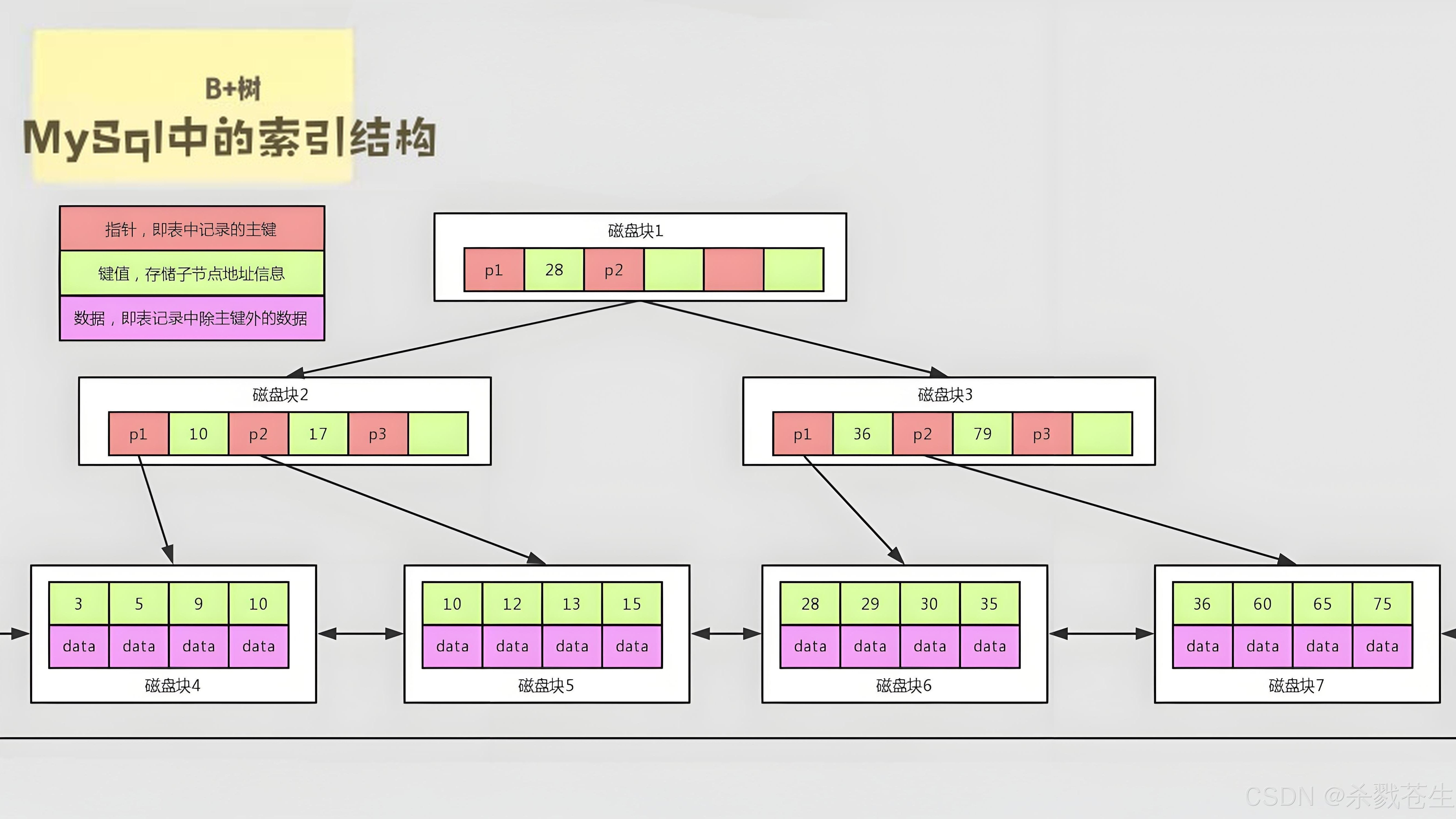

1. 维度灾难(Curse of Dimensionality)

- 问题:当向量维度极高时(如百万维),传统距离度量方法效率低下,且数据在高维空间中变得稀疏,相似度计算失去意义。

- 解决方案:

- 降维:通过PCA、t-SNE、UMAP等技术降低向量维度;

- 近似最近邻搜索(ANN):使用向量数据库(如Milvus、Faiss)实现高效检索,通过哈希算法(如LSH)或树结构(如KD树)近似查找相似向量。

2. 向量的语义鸿沟

- 问题:不同模型生成的向量可能存在“语义空间不兼容”问题(如Word2Vec的词向量与BERT的词向量分布不同)。

- 解决方案:

- 迁移学习:在预训练向量基础上,针对特定任务微调模型;

- 跨模态对齐:通过对比学习训练模型,使不同模态数据(如文本和图像)的向量映射到同一语义空间(如CLIP模型)。

3. 向量的可解释性

- 问题:深度学习生成的向量通常是黑箱输出,难以解释每个维度的具体含义。

- 解决方案:

- 可视化技术:通过降维(如t-SNE)将高维向量映射到二维空间,观察数据分布;

- 注意力机制分析:利用模型的注意力权重,分析向量中哪些维度对决策起关键作用(如NLP中的注意力热力图)。

五、总结:向量为何是AI的基石?

在AI领域,向量是数据的“数字指纹”:

- 它将复杂的现实世界数据转化为计算机可处理的数学对象;

- 它通过数值运算实现数据的语义关联度量;

- 它是连接传统算法(如KNN、SVM)与深度学习模型(如Transformer、CNN)的通用语言。

理解向量的本质(结构化的数值表征)和技术细节(生成方法、相似度计算、维度处理),是掌握AI算法(尤其是表征学习、检索系统、生成模型)的核心前提。