通义实验室的自然语言智能团队,凭借深厚的技术积累与创新精神,成功研发并开源了视觉感知多模态 RAG 推理框架 VRAG-RL,为 AI 在复杂视觉信息处理领域带来了重大突破。

传统 RAG 方法的局限

传统的检索增强型生成(RAG)方法,在文本处理领域取得了一定成果,但在面对富含视觉信息的内容时,却显得捉襟见肘。当遇到图像、图表等复杂视觉元素,这些方法往往难以精准提取关键信息,无法深入挖掘其中的核心知识。其固定的检索 - 生成流程,限制了对视觉信息的深度理解,难以满足真实业务场景中对多样化视觉语言处理的需求。

VRAG-RL 的创新维度

强化学习驱动的多模态智能体

VRAG-RL 通过强化学习训练多模态智能体,引入区域选择、裁剪和缩放等多种视觉感知动作。这一创新使模型能够像人类视觉系统一样,从宏观到微观逐步聚焦信息密集区域,精准捕捉关键视觉信息。在处理一张复杂的工业流程图时,智能体可先通过宏观视角确定关键区域,再通过裁剪、缩放等操作,深入分析区域内的细节,极大提高了对视觉信息的理解与检索效率。

多专家采样训练策略

在训练策略上,VRAG-RL 采用多专家采样方法。它巧妙结合大规模模型强大的推理能力和专家模型精确的标注,为模型学习高效的视觉感知策略提供了有力支持。大规模模型能从海量数据中捕捉通用模式,专家模型则针对特定领域或复杂任务提供精准指导,二者相辅相成,让 VRAG-RL 的智能体在处理视觉信息时更加游刃有余。

细粒度奖励机制与闭环优化

该框架引入细粒度的奖励机制,综合考量检索效率、模式一致性和生成质量等多方面因素。在与搜索引擎交互过程中,模型依据奖励反馈不断优化检索与推理路径,实现检索与推理的双向驱动和闭环优化。若模型在检索过程中快速且准确地定位到关键信息,就能获得较高奖励,激励其不断改进检索策略,形成自我提升的良性循环。

GRPO 算法与零成本搜索引擎调用

VRAG-RL 引入业界前沿的 GRPO 算法,并通过本地部署搜索引擎模拟真实应用场景,实现搜索引擎调用的零成本。这一创举大幅提高了模型训练的效率和泛化能力,使 VRAG-RL 在不同领域、不同类型的视觉任务中都能表现出色,为其广泛应用奠定了坚实基础。

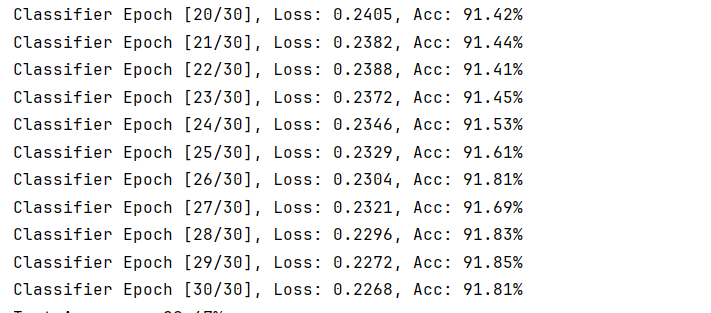

实验数据彰显卓越性能

大量实验数据表明,VRAG-RL 在多个视觉语言基准数据集上的性能表现远超现有方法。从单跳到多跳推理,从纯文本理解到图表识别、复杂布局解析等丰富视觉场景,无论是传统基于提示(prompt-based)的方法,还是基于强化学习的方法,VRAG-RL 都展现出更为卓越的综合性能。在某金融领域的财报图表分析任务中,VRAG-RL 对关键数据的提取准确率比传统方法提升了 20%,充分证明其在复杂视觉任务中的强大实力。

多轮交互实现精准信息获取

VRAG-RL 支持多轮交互,在推理阶段能够逐步聚焦信息密集区域,实现从宏观到微观的信息获取。在与用户交互过程中,模型可根据用户反馈和自身推理结果,动态调整聚焦区域和推理策略,优化检索效率和推理路径。在处理一份复杂的建筑设计图纸时,用户询问特定功能区域的设计细节,模型可通过多轮交互,逐步放大、分析相关区域,最终给出准确详细的回答,在保持高效率的同时,显著提升了模型在视觉任务上的性能表现。

VRAG-RL 的开源,为 AI 领域注入了新活力,为开发者们提供了全新的多模态推理解决方案。它不仅为视觉感知和推理提供了创新思路,还为 AI 技术在实际应用中的深入发展奠定了基础,有望在智能文档处理、智能客服、医疗影像分析、工业视觉检测等众多领域发挥重要作用,推动多模态推理技术迈向新高度。