Wan2.1:下一代开源大规模视频生成模型

- 引言

- Wan2.1 项目概述

- 核心技术

- 1. 3D 变分自编码器(Wan-VAE)

- 2. 视频扩散 Transformer(Video Diffusion DiT)

- 3. 数据处理与清洗

- 项目运行方式与执行步骤

- 1. 环境准备

- 2. 安装依赖

- 3. 模型下载

- 4. 文本到视频生成

- 单 GPU 推理

- 多 GPU 推理

- 5. 图像到视频生成

- 6. 首尾帧到视频生成

- 执行报错与问题解决

- 1. 显存不足

- 2. 环境依赖问题

- 3. 模型下载问题

- 相关论文与研究

- 总结

引言

在人工智能的浪潮中,视频生成技术正逐渐成为研究和应用的前沿领域。随着深度学习技术的不断进步,生成高质量、多样化视频的能力对于娱乐、教育、广告等多个行业都具有巨大的价值。Wan2.1 项目正是在这个背景下应运而生,它不仅代表了当前视频生成技术的先进水平,还为研究人员和开发者提供了一个强大的开源工具。

本文深入探讨 Wan2.1 项目的核心技术、实现细节、运行方式以及可能遇到的问题和解决方法。通过对这些方面的详细解读,读者可以全面了解 Wan2.1 的技术架构,并掌握如何在实际项目中应用这一模型。

Wan2.1 项目概述

Wan2.1 是一个开源的、大规模的视频生成模型套件,旨在推动视频生成技术的边界。该项目由一群顶尖的研究人员和工程师开发,其核心目标是提供一个高性能、多功能且易于使用的视频生成解决方案。Wan2.1 的主要特点包括:

- SOTA 性能:Wan2.1 在多个基准测试中均优于现有的开源模型和商业解决方案。

- 支持消费级 GPU:例如,T2V-1.3B 模型仅需 8.19 GB 的显存,几乎兼容所有消费级 GPU。

- 多种任务支持:Wan2.1 在文本到视频(Text-to-Video)、图像到视频(Image-to-Video)、视频编辑、文本到图像(Text-to-Image)和视频到音频(Video-to-Audio)等多种任务上表现出色。

- 强大的视频 VAE:Wan-VAE 提供了卓越的效率和性能,能够编码和解码任意长度的 1080P 视频,同时保留时间信息。

核心技术

1. 3D 变分自编码器(Wan-VAE)

Wan-VAE 是 Wan2.1 中用于视频生成的核心组件之一。它是一种新颖的 3D 因果变分自编码器架构,专门针对视频生成任务设计。与传统的 VAE 相比,Wan-VAE 在时空压缩、内存使用和时间因果性方面进行了多项改进。其主要特点包括:

- 时空压缩:通过结合多种策略,Wan-VAE 能够高效地压缩视频数据,同时保留关键的时间信息。

- 内存优化:在处理高分辨率视频时,Wan-VAE 显著降低了内存使用量,使其能够在消费级 GPU 上运行。

- 时间因果性:Wan-VAE 通过因果结构确保视频帧之间的连贯性,避免了时间上的不连续性。

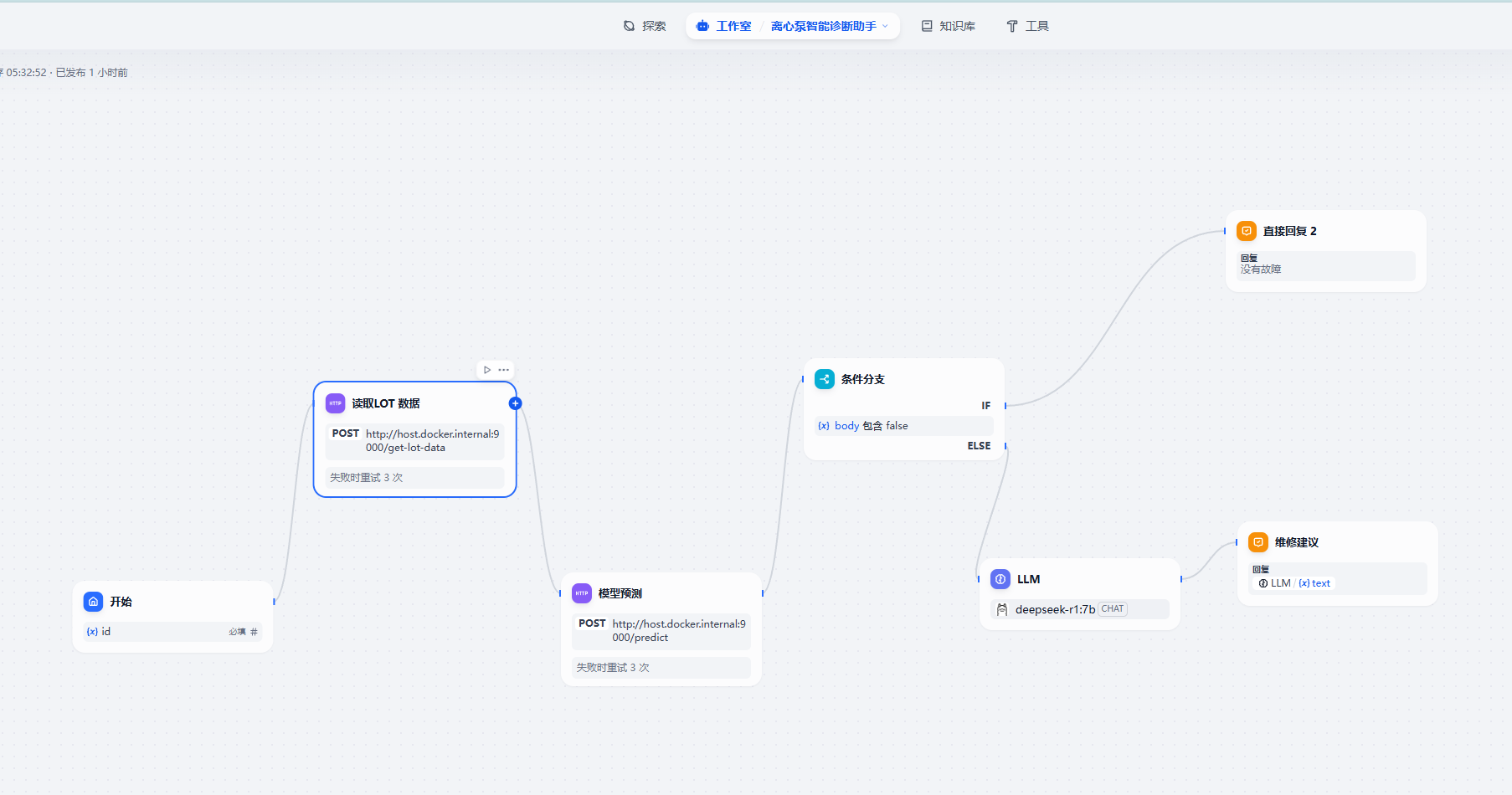

2. 视频扩散 Transformer(Video Diffusion DiT)

Wan2.1 基于主流的扩散 Transformer 架构设计,采用了 Flow Matching 框架。其模型架构包括以下几个关键部分:

- T5 编码器:用于编码多语言文本输入,通过每个 Transformer 块中的交叉注意力机制将文本嵌入到模型结构中。

- 时间嵌入处理:使用 MLP 处理输入的时间嵌入,并预测六个调制参数。这些参数在所有 Transformer 块中共享,每个块学习一组不同的偏置。

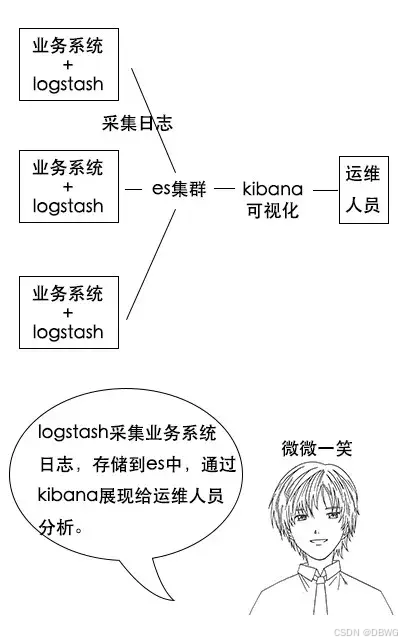

3. 数据处理与清洗

Wan2.1 的数据集经过精心策划和去重,包含大量的图像和视频数据。在数据清洗过程中,开发团队设计了一个四步数据清理流程,重点关注基础维度、视觉质量和运动质量。通过这一强大的数据处理流程,可以轻松获得高质量、多样化且大规模的图像和视频训练集。

项目运行方式与执行步骤

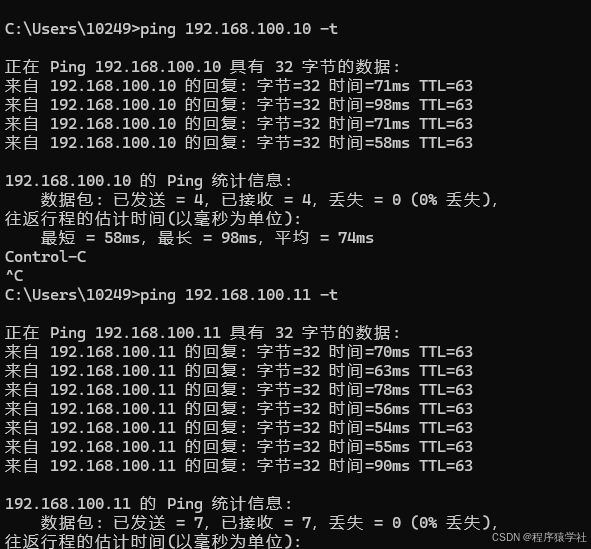

1. 环境准备

在开始运行 Wan2.1 之前,需要确保你的开发环境已经准备好。以下是推荐的环境配置:

- 操作系统:推荐使用 Linux 或 macOS,Windows 用户可能需要额外配置 WSL 或虚拟机。

- Python 版本:建议使用 Python 3.8 或更高版本。

- CUDA 和 GPU:确保你的系统安装了 CUDA,并且 GPU 驱动程序是最新的。

2. 安装依赖

首先,需要克隆项目仓库并安装依赖项:

git clone https://github.com/Wan-Video/Wan2.1.git

cd Wan2.1

pip install -r requirements.txt

3. 模型下载

Wan2.1 提供了多种模型版本,可以通过 Hugging Face 或 ModelScope 下载。例如,下载 T2V-1.3B 模型:

pip install "huggingface_hub[cli]"

huggingface-cli download Wan-AI/Wan2.1-T2V-1.3B --local-dir ./Wan2.1-T2V-1.3B

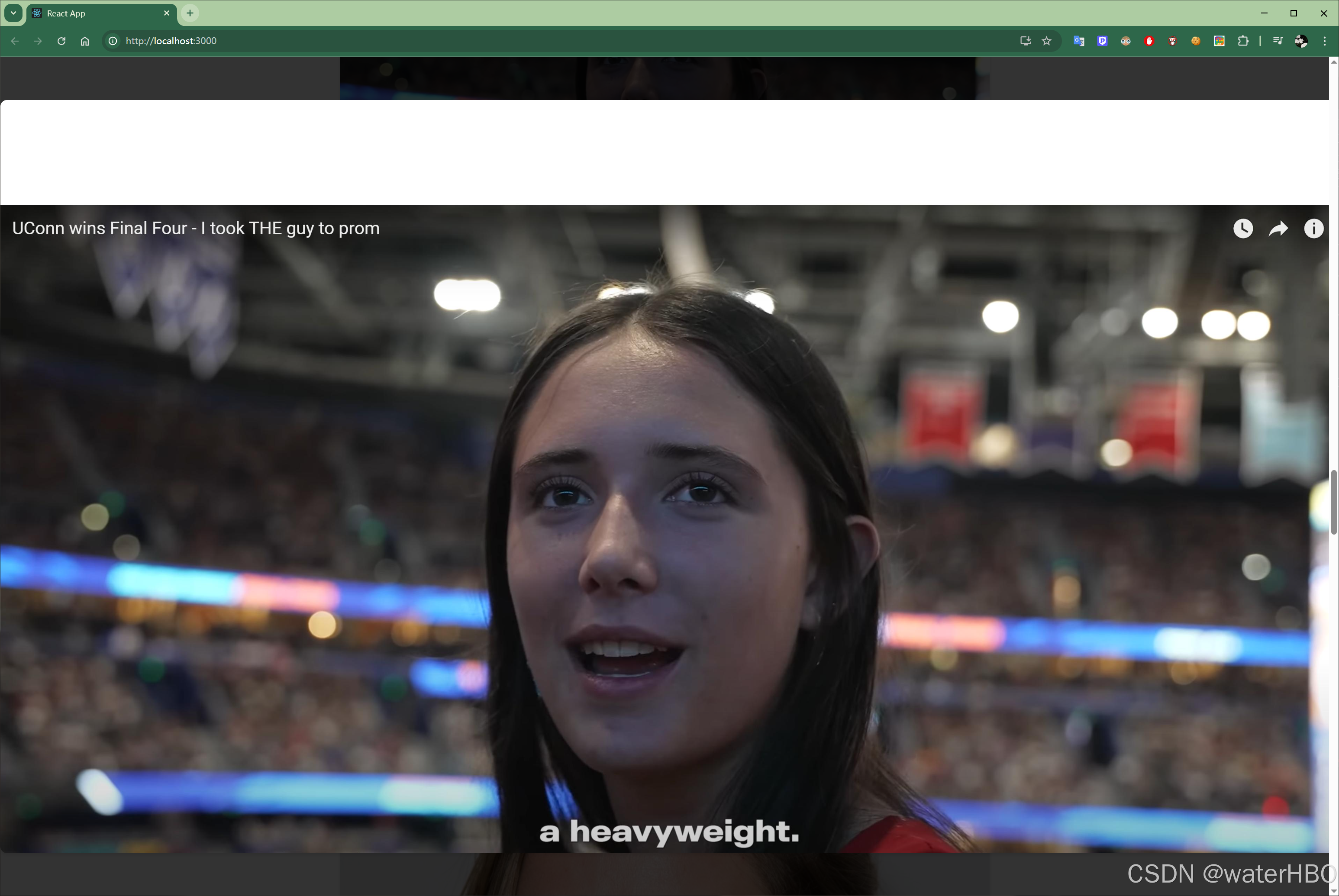

4. 文本到视频生成

单 GPU 推理

以下是一个简单的命令,用于在单 GPU 上运行文本到视频生成任务:

python generate.py --task t2v-1.3B --size 832*480 --ckpt_dir ./Wan2.1-T2V-1.3B --prompt "Two anthropomorphic cats in comfy boxing gear and bright gloves fight intensely on a spotlighted stage."

如果遇到显存不足的问题,可以使用以下参数减少 GPU 内存使用:

python generate.py --task t2v-1.3B --size 832*480 --ckpt_dir ./Wan2.1-T2V-1.3B --offload_model True --t5_cpu --sample_shift 8 --sample_guide_scale 6 --prompt "Two anthropomorphic cats in comfy boxing gear and bright gloves fight intensely on a spotlighted stage."

多 GPU 推理

对于多 GPU 推理,Wan2.1 使用 FSDP 和 xDiT USP 加速推理过程。以下是一个使用 8 个 GPU 的命令示例:

pip install "xfuser>=0.4.1"

torchrun --nproc_per_node=8 generate.py --task t2v-14B --size 1280*720 --ckpt_dir ./Wan2.1-T2V-14B --dit_fsdp --t5_fsdp --ulysses_size 8 --prompt "Two anthropomorphic cats in comfy boxing gear and bright gloves fight intensely on a spotlighted stage."

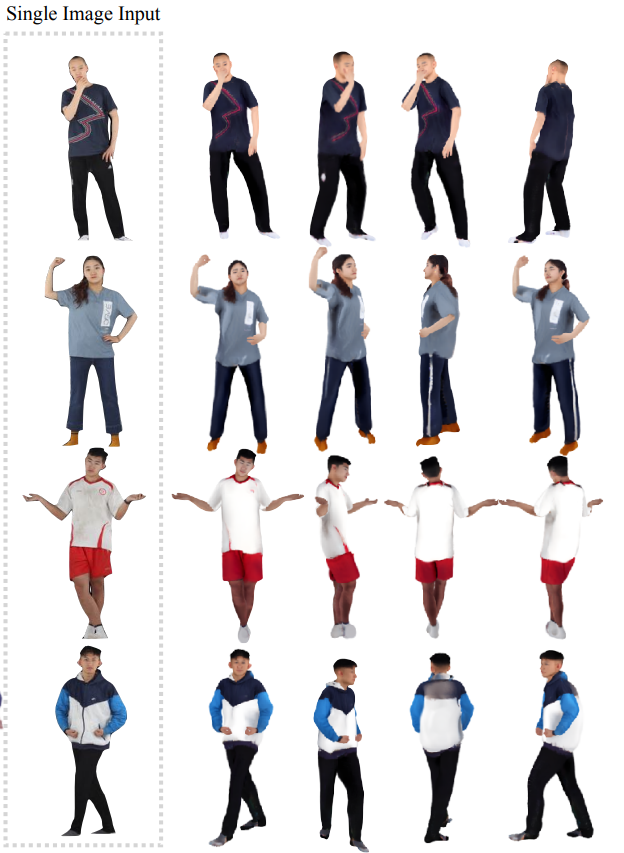

5. 图像到视频生成

图像到视频生成与文本到视频生成类似,但需要提供一个输入图像。以下是一个单 GPU 推理的命令示例:

python generate.py --task i2v-14B --size 1280*720 --ckpt_dir ./Wan2.1-I2V-14B-720P --image examples/i2v_input.JPG --prompt "Summer beach vacation style, a white cat wearing sunglasses sits on a surfboard. The fluffy-furred feline gazes directly at the camera with a relaxed expression. Blurred beach scenery forms the background featuring crystal-clear waters, distant green hills, and a blue sky dotted with white clouds. The cat assumes a naturally relaxed posture, as if savoring the sea breeze and warm sunlight. A close-up shot highlights the feline's intricate details and the refreshing atmosphere of the seaside."

6. 首尾帧到视频生成

首尾帧到视频生成任务需要提供首帧和尾帧图像。以下是一个单 GPU 推理的命令示例:

python generate.py --task flf2v-14B --size 1280*720 --ckpt_dir ./Wan2.1-FLF2V-14B-720P --first_frame examples/flf2v_input_first_frame.png --last_frame examples/flf2v_input_last_frame.png --prompt "CG animation style, a small blue bird takes off from the ground, flapping its wings. The bird’s feathers are delicate, with a unique pattern on its chest. The background shows a blue sky with white clouds under bright sunshine. The camera follows the bird upward, capturing its flight and the vastness of the sky from a close-up, low-angle perspective."

执行报错与问题解决

在运行 Wan2.1 项目时,可能会遇到一些常见的问题。以下是一些常见问题及其解决方法:

1. 显存不足

如果在运行时遇到显存不足的错误,可以尝试以下方法:

- 使用

--offload_model True:将部分模型参数卸载到 CPU,减少 GPU 内存使用。 - 调整分辨率:降低生成视频的分辨率,例如从 720P 降低到 480P。

- 减少采样步数:通过调整

--sample_shift和--sample_guide_scale参数来减少采样步数。

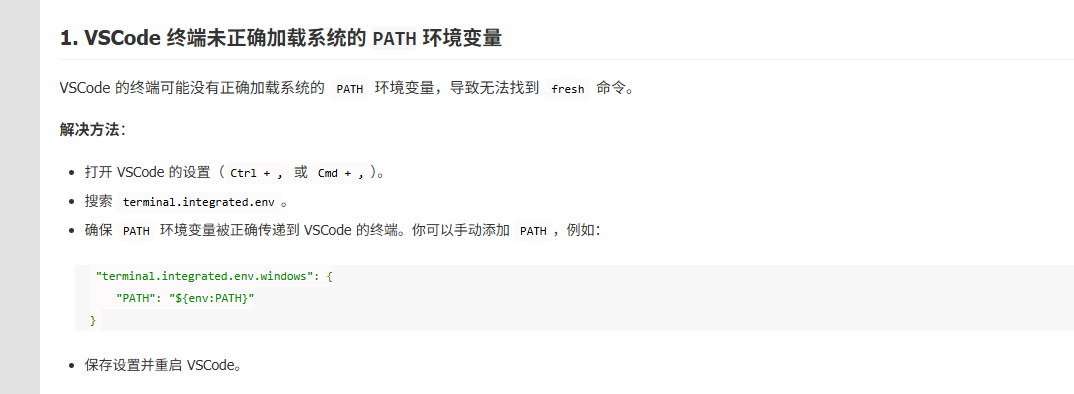

2. 环境依赖问题

如果在安装依赖时遇到问题,可以尝试以下方法:

- 更新 pip 和 setuptools:确保 pip 和 setuptools 是最新版本。

- 手动安装依赖:对于某些依赖项,可以尝试手动安装,例如

torch和transformers。

3. 模型下载问题

如果在下载模型时遇到问题,可以尝试以下方法:

- 检查网络连接:确保你的网络连接正常,能够访问 Hugging Face 或 ModelScope。

- 手动下载模型:如果自动下载失败,可以手动下载模型文件并放置到指定目录。

相关论文与研究

Wan2.1 的开发基于多项前沿研究,其中一些关键的论文和技术包括:

- Diffusion Models:Wan2.1 使用了扩散模型的框架,这是一种基于噪声扩散和去噪过程的生成模型。其核心思想是通过逐步添加噪声将数据分布转换为先验分布,然后通过去噪过程恢复原始数据分布。

- Transformer 架构:Wan2.1 的模型架构基于 Transformer,这种架构在自然语言处理和计算机视觉领域都取得了巨大成功。Transformer 的自注意力机制能够有效地捕捉长距离依赖关系,使其在视频生成任务中表现出色。

- 3D VAE:Wan-VAE 是一种新颖的 3D 变分自编码器,专门用于视频生成。它通过结合多种策略,显著提高了时空压缩效率,并保留了时间信息。

总结

Wan2.1 项目以其卓越的性能、多功能性和开源性,为视频生成领域提供了一个强大的工具。通过本文的详细介绍,读者可以全面了解 Wan2.1 的技术架构,并掌握如何在实际项目中应用这一模型。无论是研究人员还是开发者,都可以从 Wan2.1 中受益,推动视频生成技术的发展和应用。

未来,随着技术的不断进步,Wan2.1 有望在更多领域发挥更大的作用,为人类创造更加丰富多彩的视觉内容。