目录

- 1.loss的种类

- 1.1 MSE

- 1.2 MSE推导

- 1.3 autograd.grad

- 1.4 loss.backward

- 2. Softmax

- 2.1 softmax推导

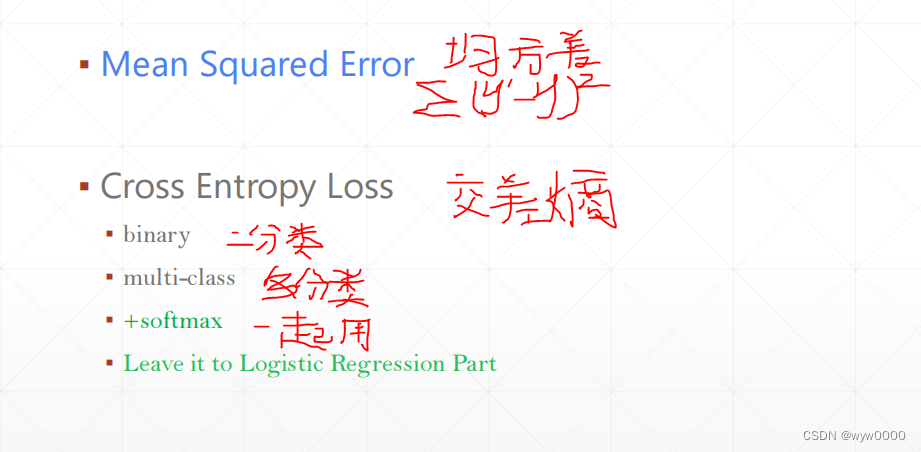

1.loss的种类

常见两种一种是均方差,一种是交叉熵

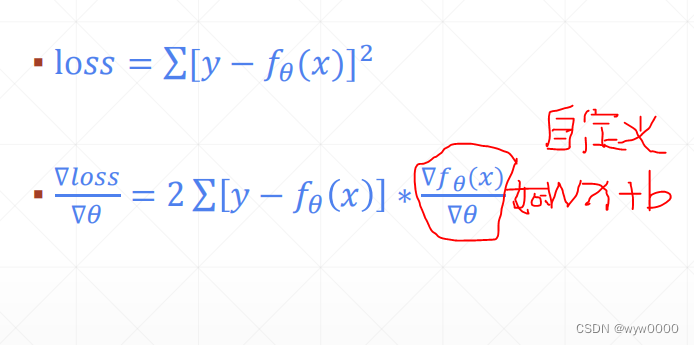

1.1 MSE

1.2 MSE推导

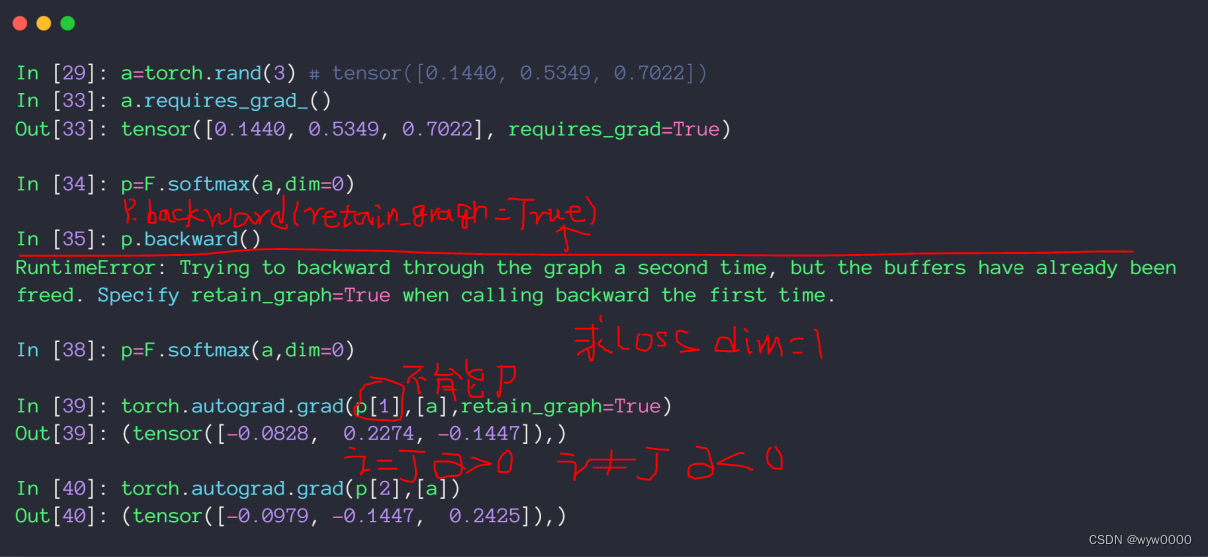

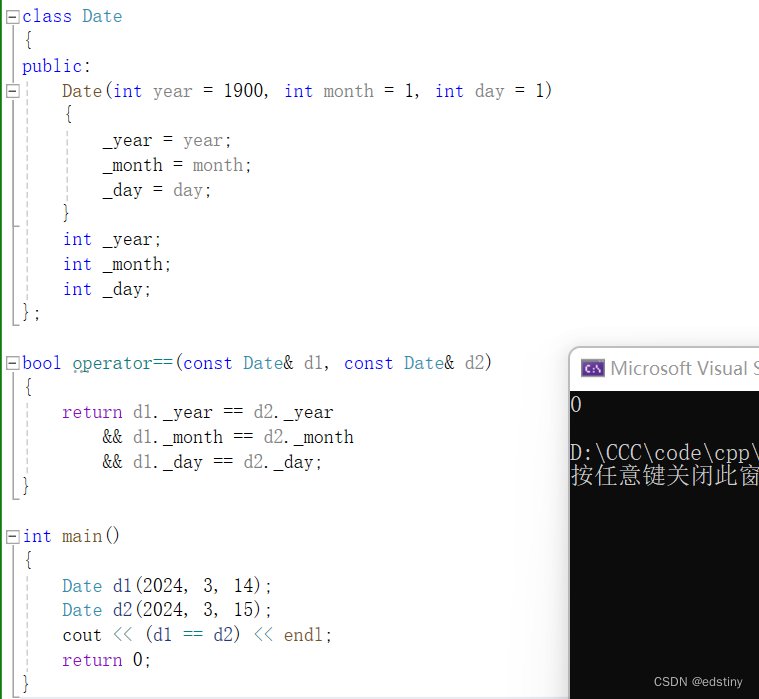

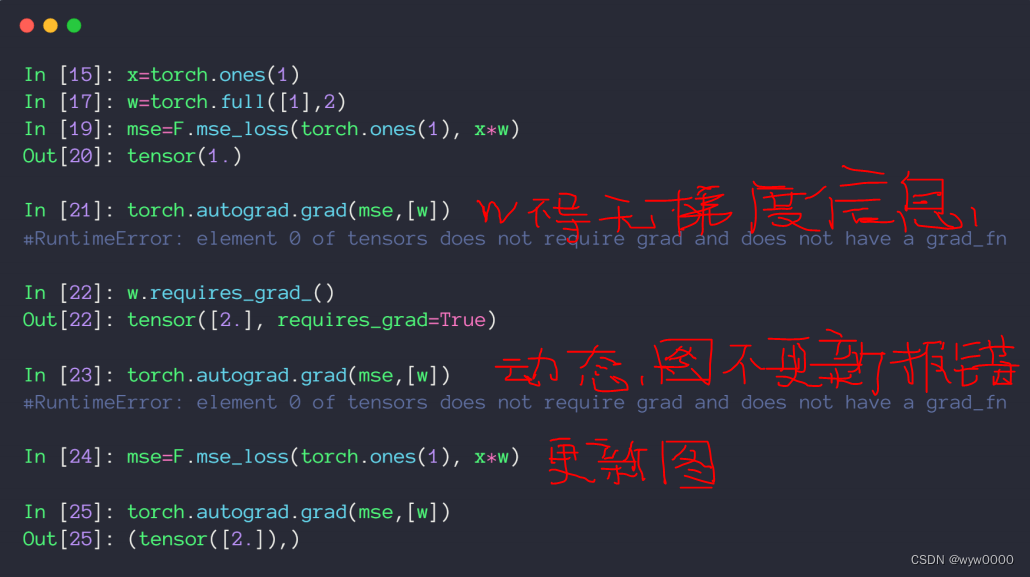

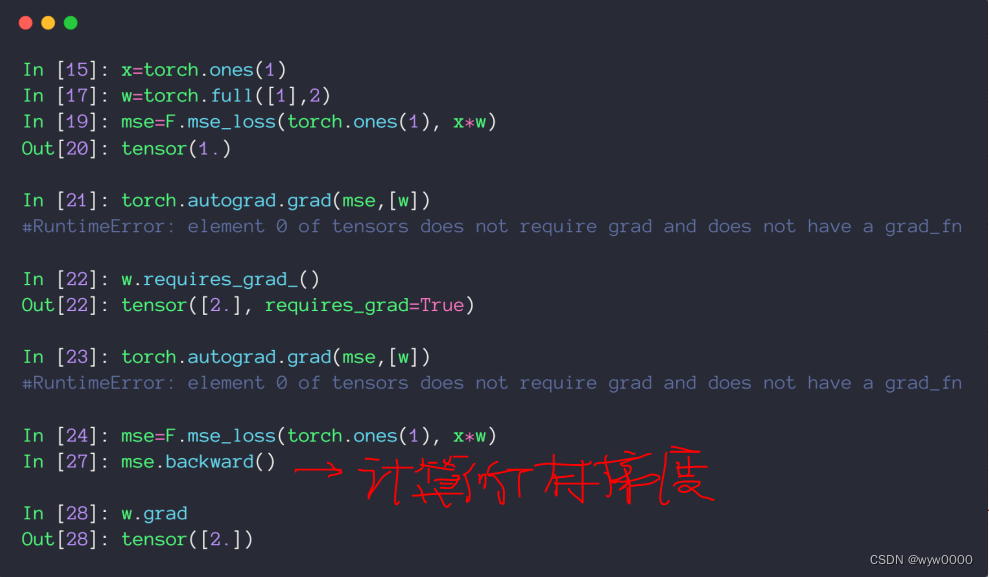

1.3 autograd.grad

1.4 loss.backward

注意:autograd.grad直接返回梯度,而backward梯度保存再w.grad中

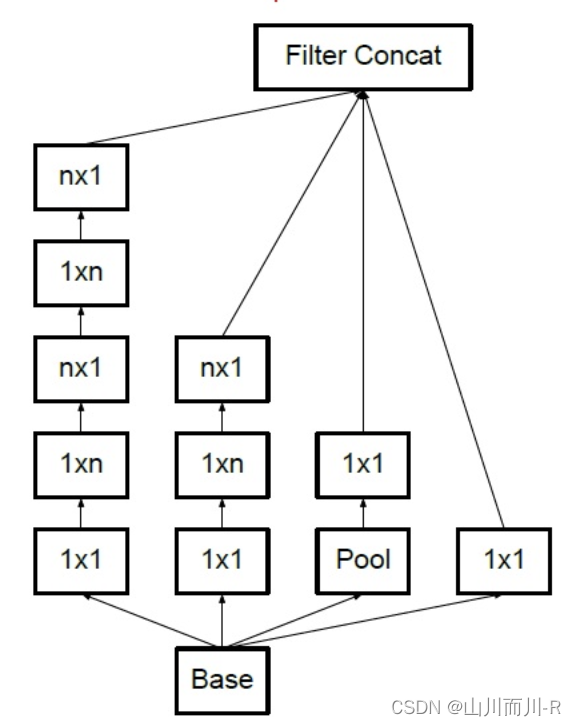

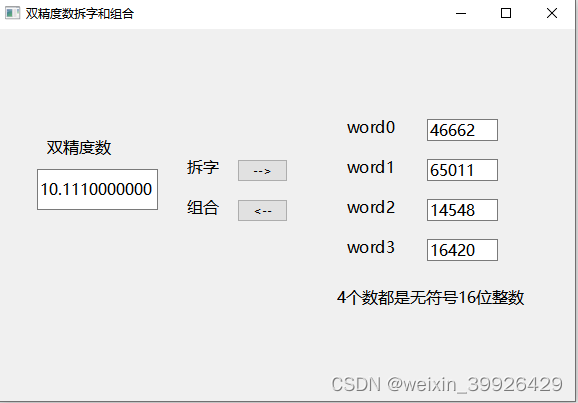

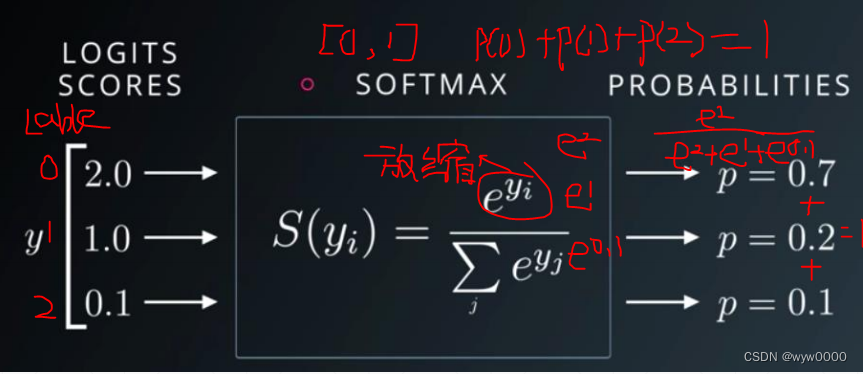

2. Softmax

softmax函数范围是[0,1]所有分类概率和等于1,softmax的特性是使概率大的更大,概率小的更小。

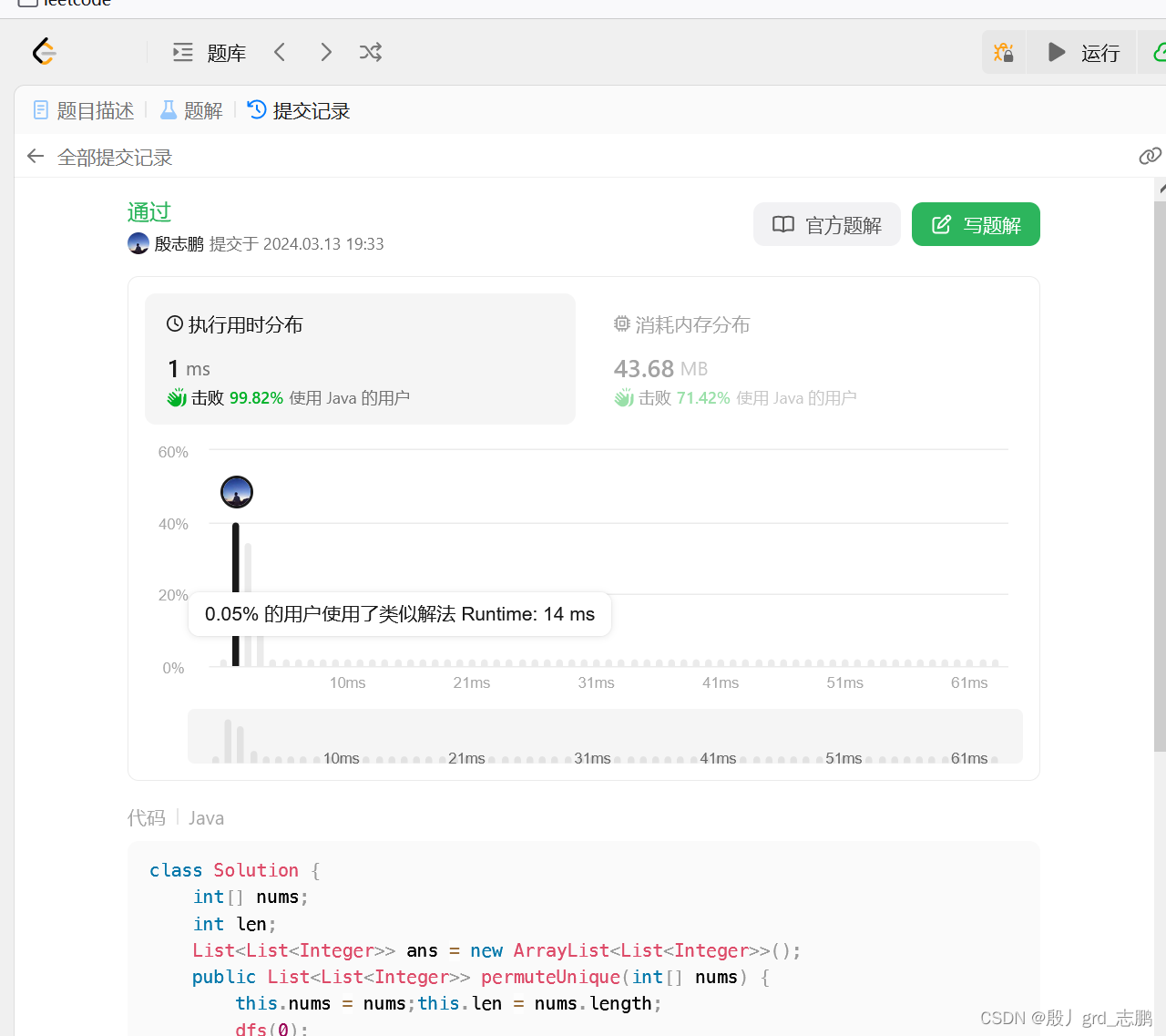

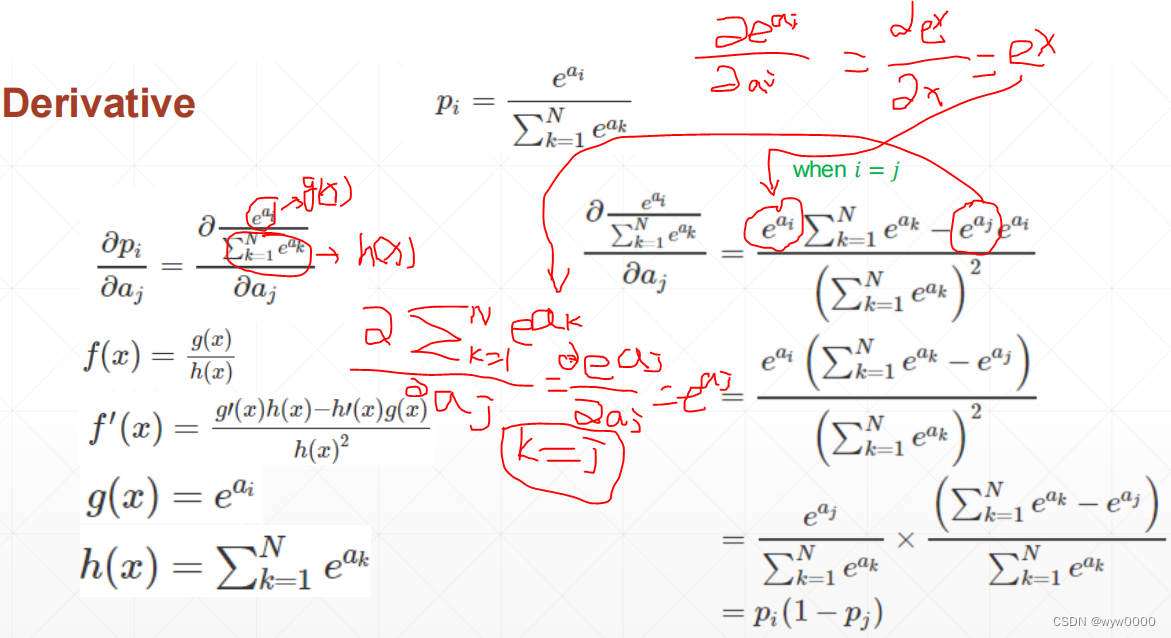

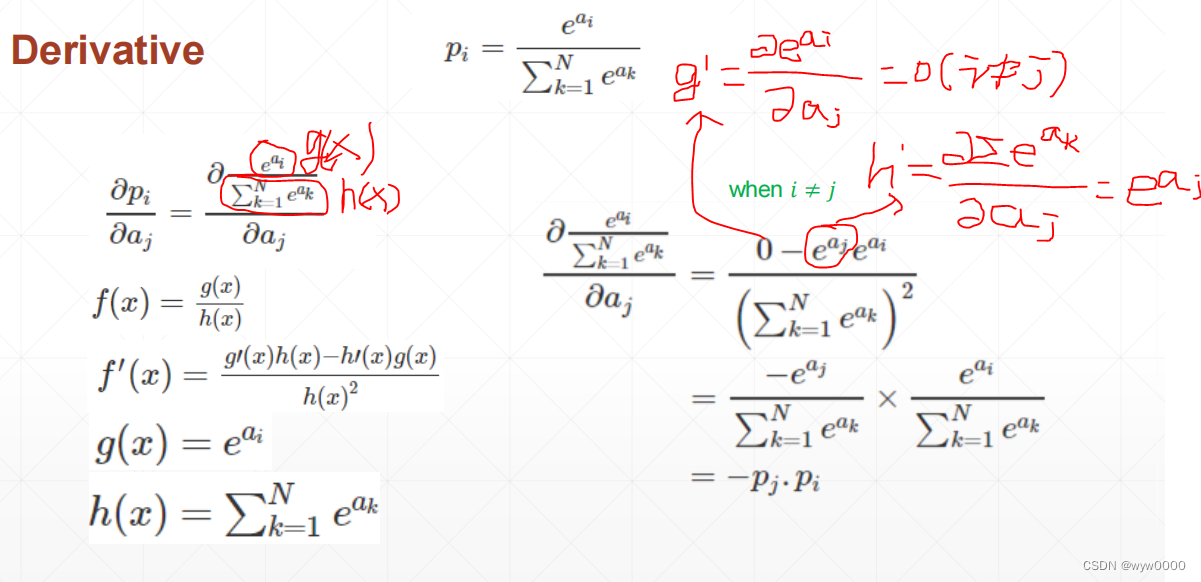

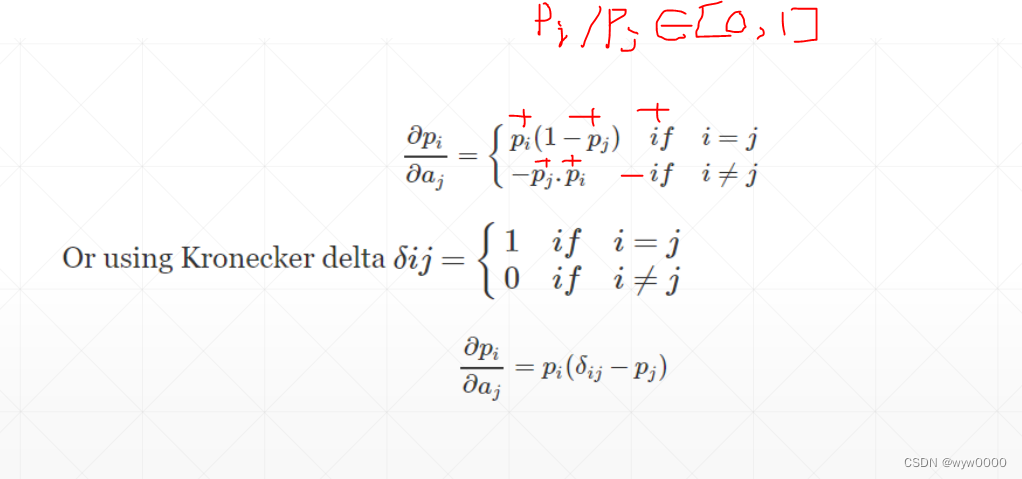

2.1 softmax推导

- i=j

- i/=j

- 。总结

- 应用