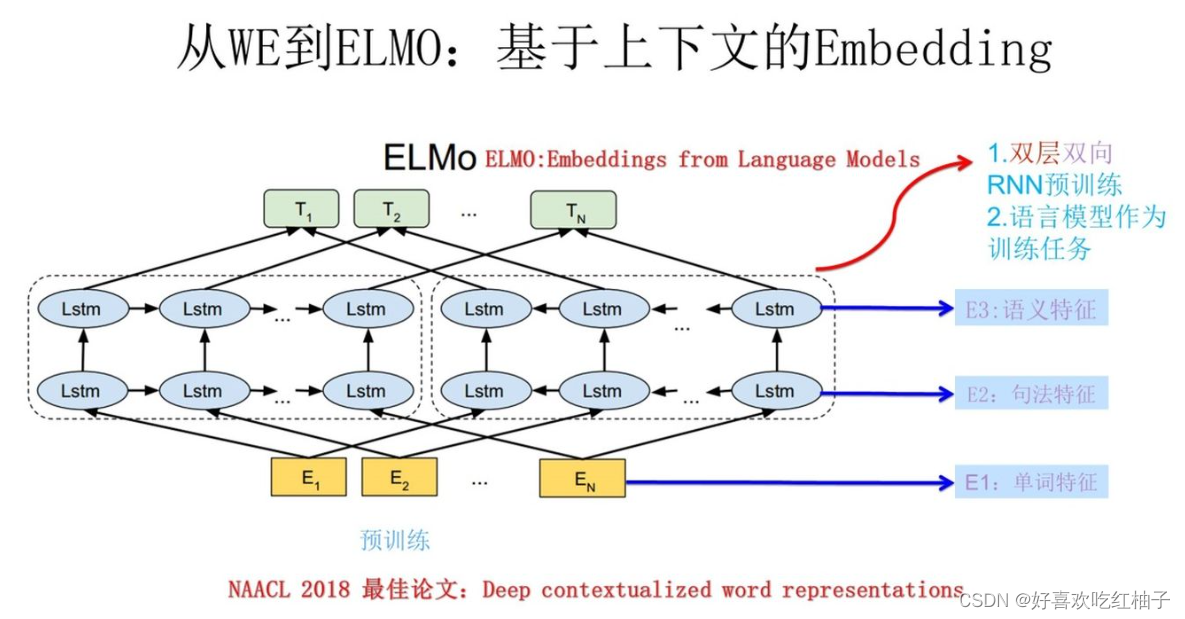

💡💡💡本文独家改进: 提出了一种新颖的动态稀疏注意力(BiLevelRoutingAttention),以实现更灵活的计算分配和内容感知,使其具备动态的查询感知稀疏性

1)代替RepC3进行使用; 2)BiLevelRoutingAttention直接作为注意力进行使用;

推荐指数:五星

RT-DETR魔术师专栏介绍:

https://blog.csdn.net/m0_63774211/category_12497375.html

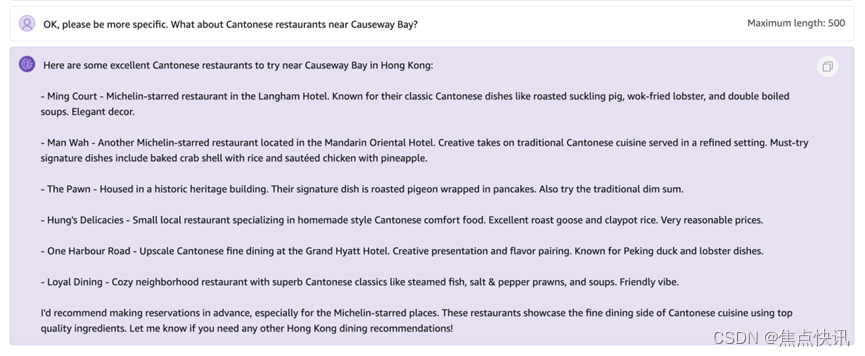

✨✨✨魔改创新RT-DETR

🚀🚀🚀引入前沿顶会创新,助力RT-DETR

🍉🍉🍉基于ultralytics优化,与YOLO完美结合

1.BiFormer介绍

论文: