主流大语言模型的技术原理细节从预训练到微调![]() https://mp.weixin.qq.com/s/P1enjLqH-UWNy7uaIviWRA

https://mp.weixin.qq.com/s/P1enjLqH-UWNy7uaIviWRA

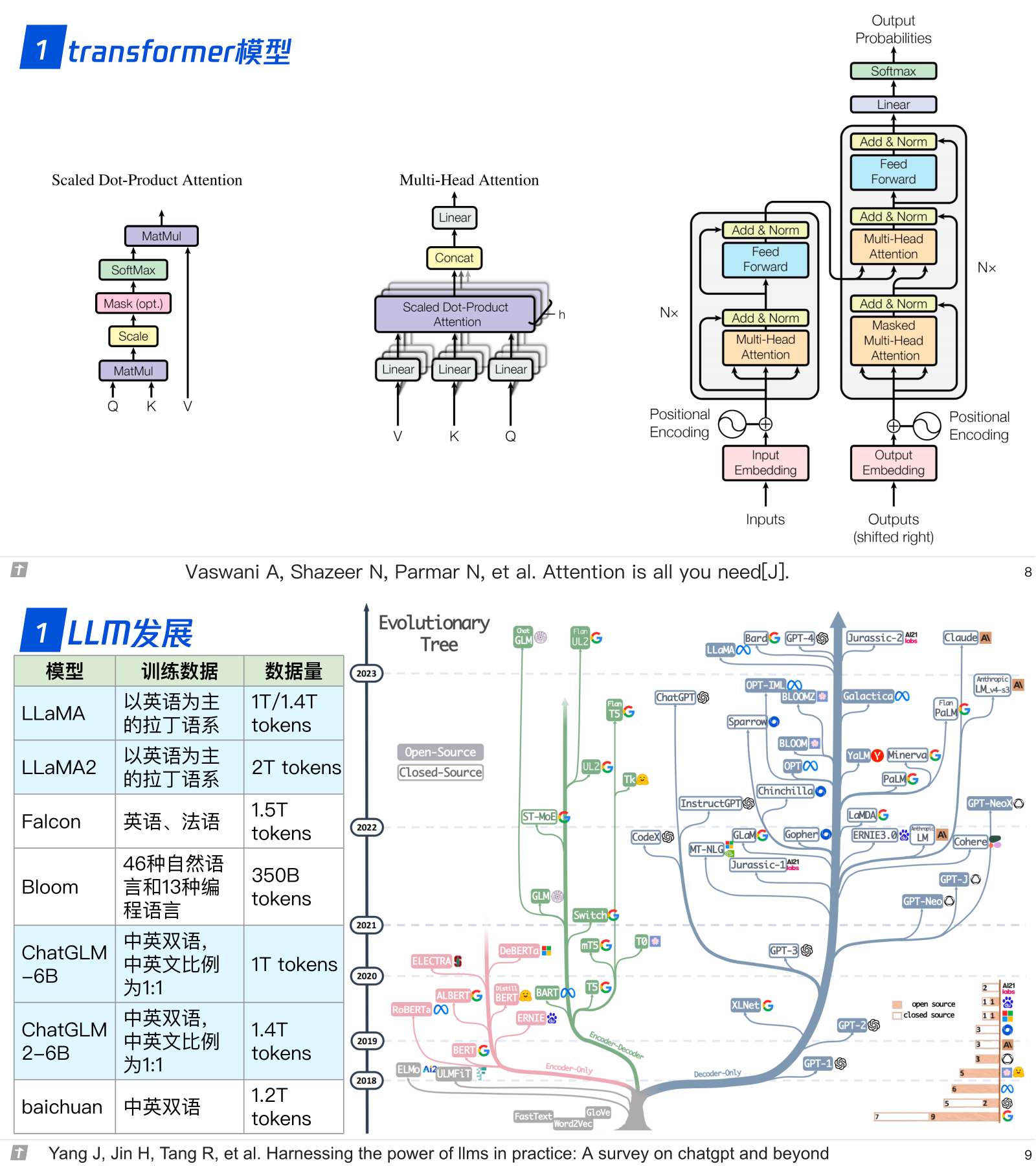

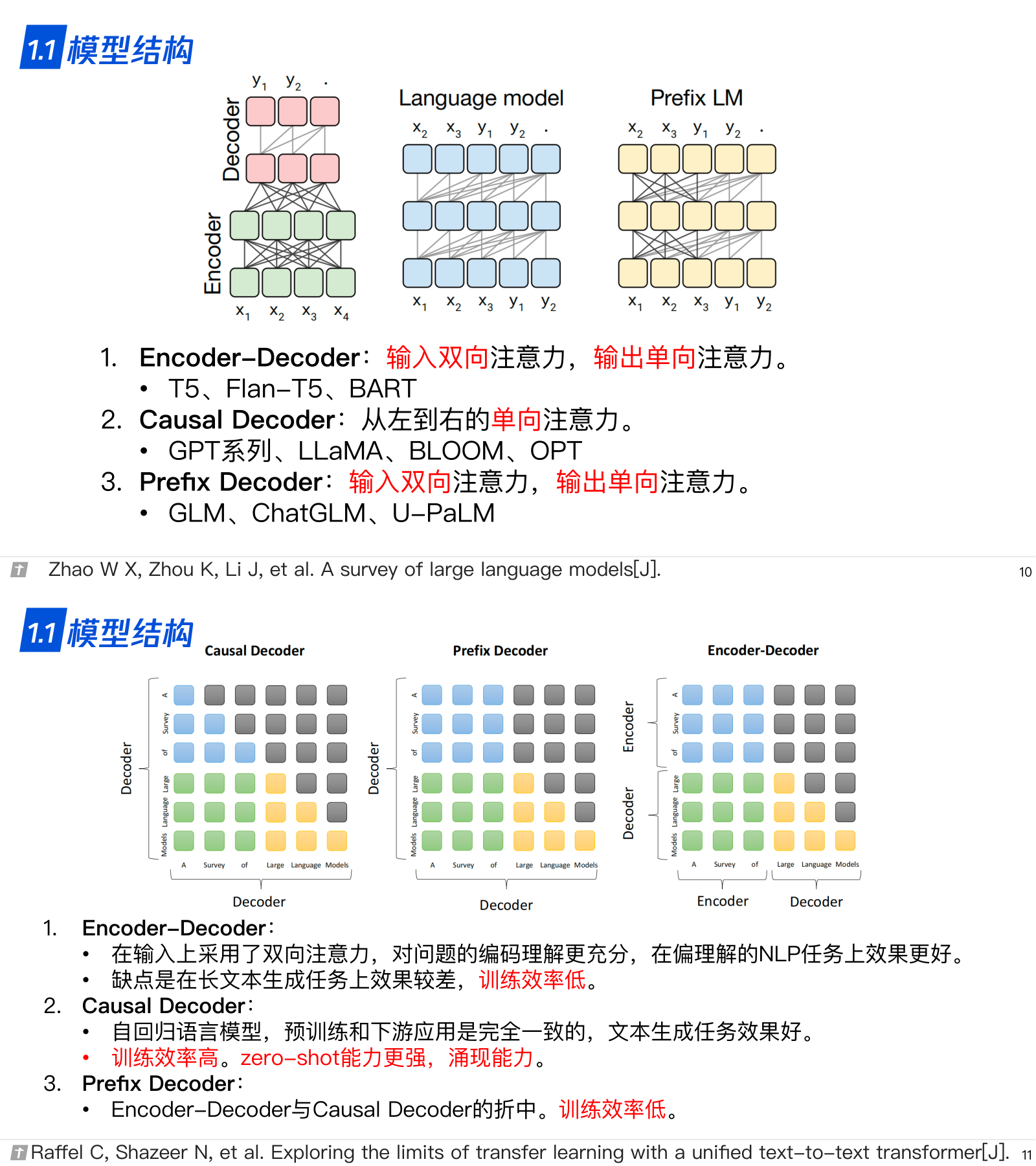

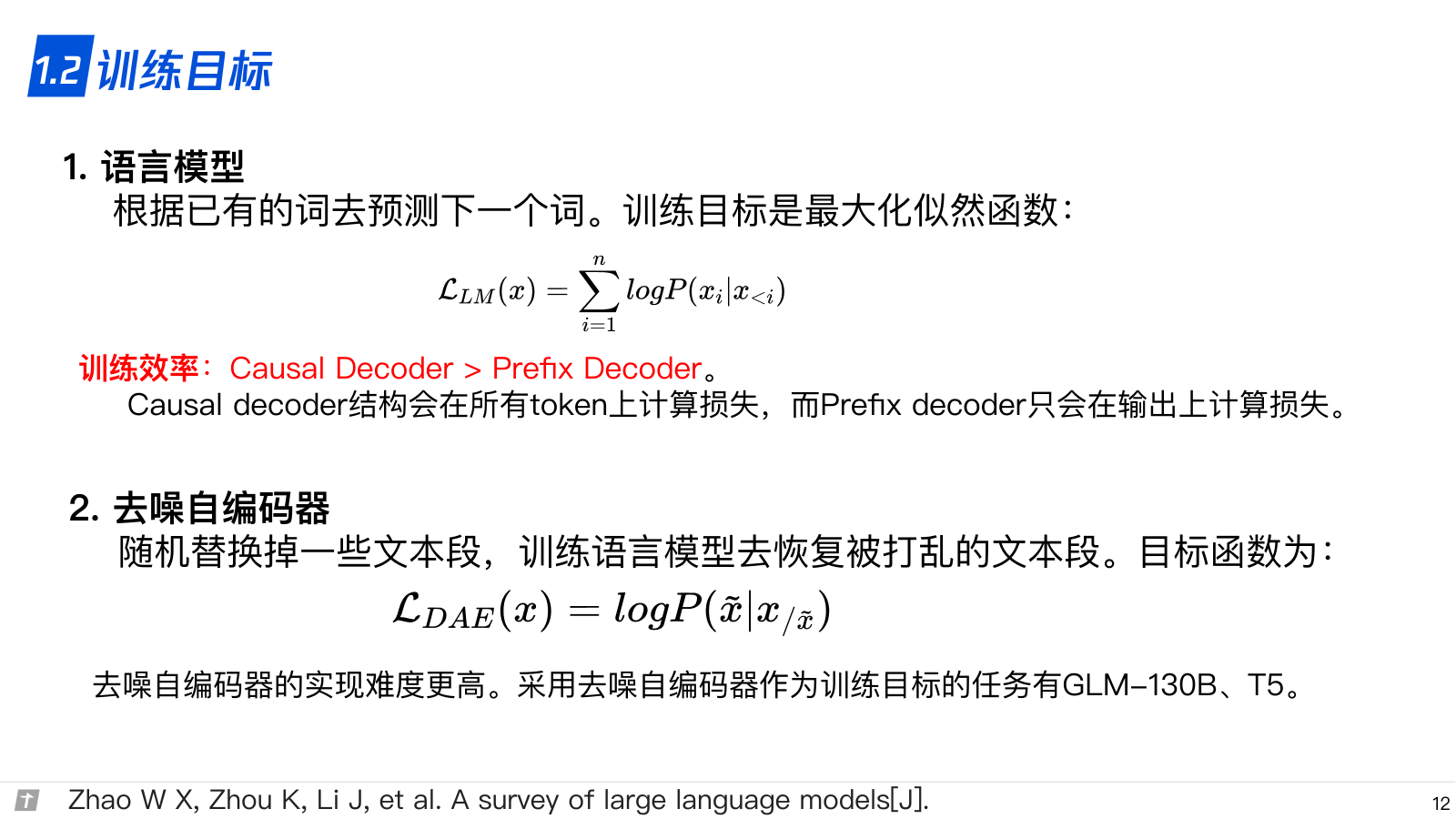

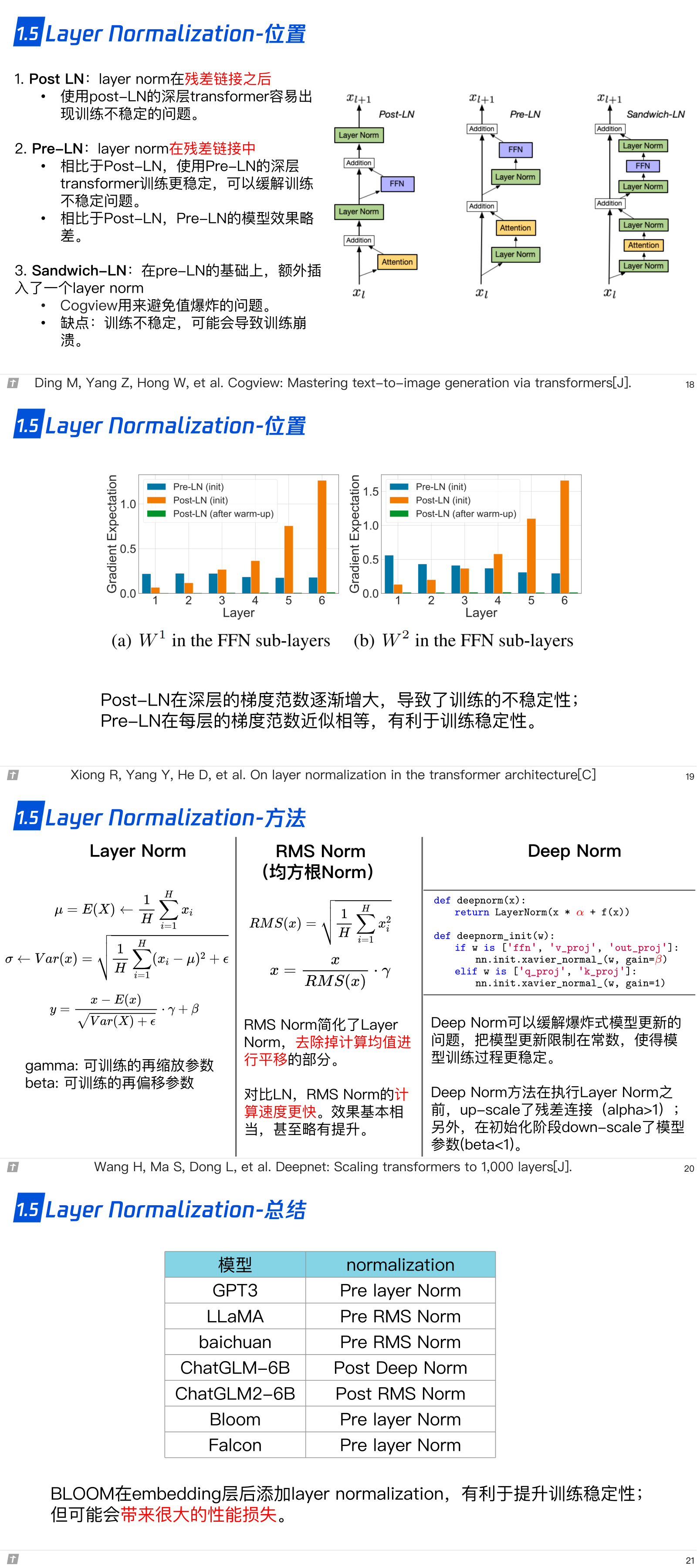

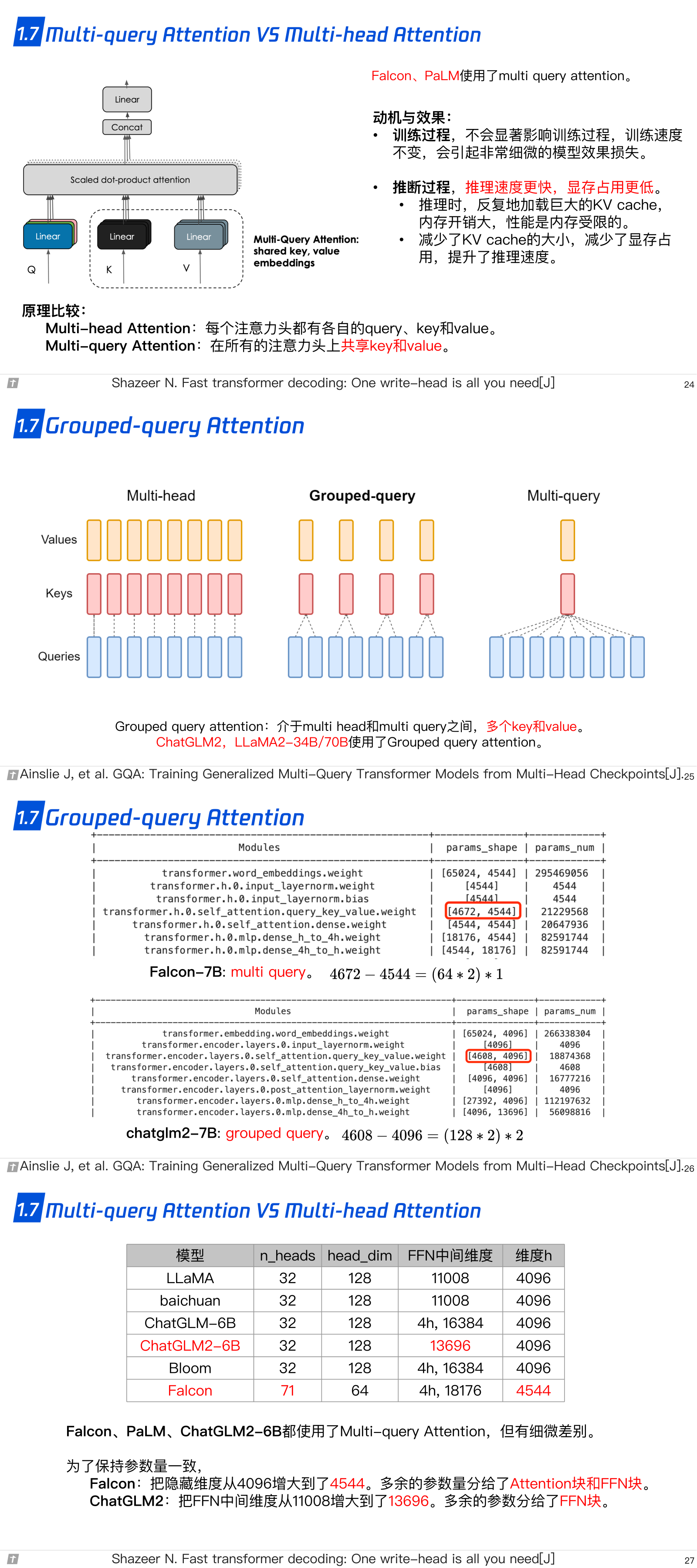

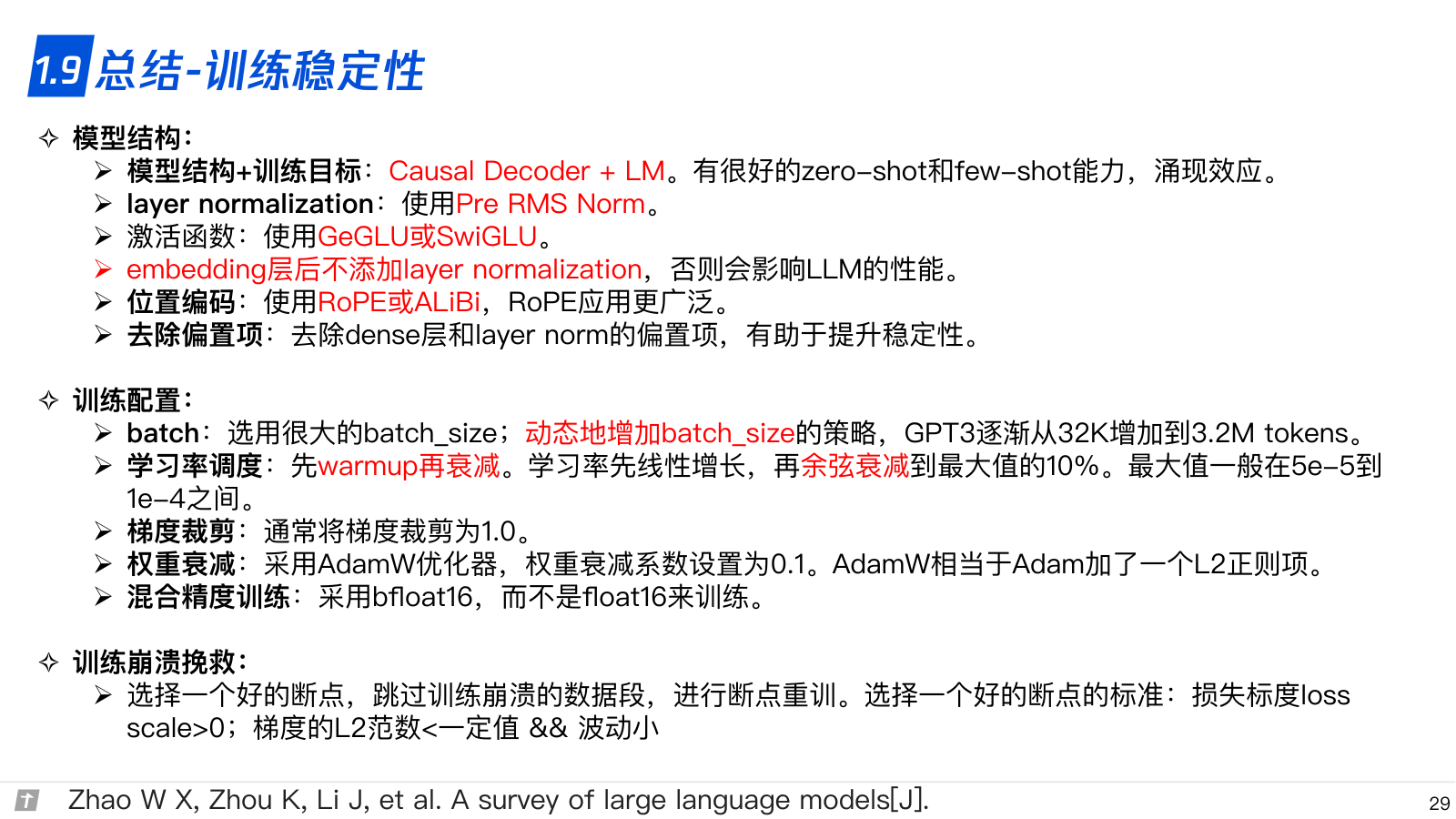

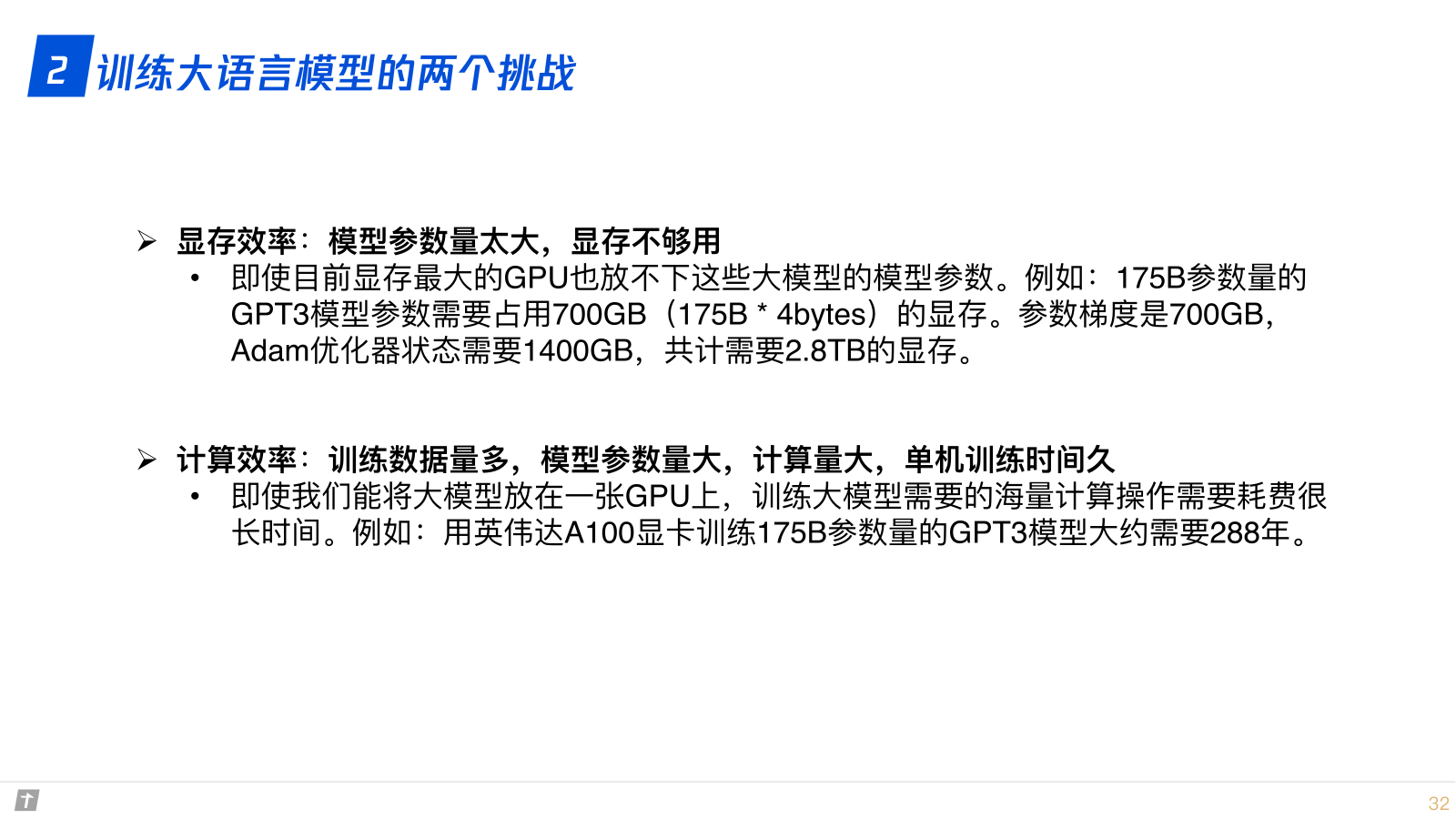

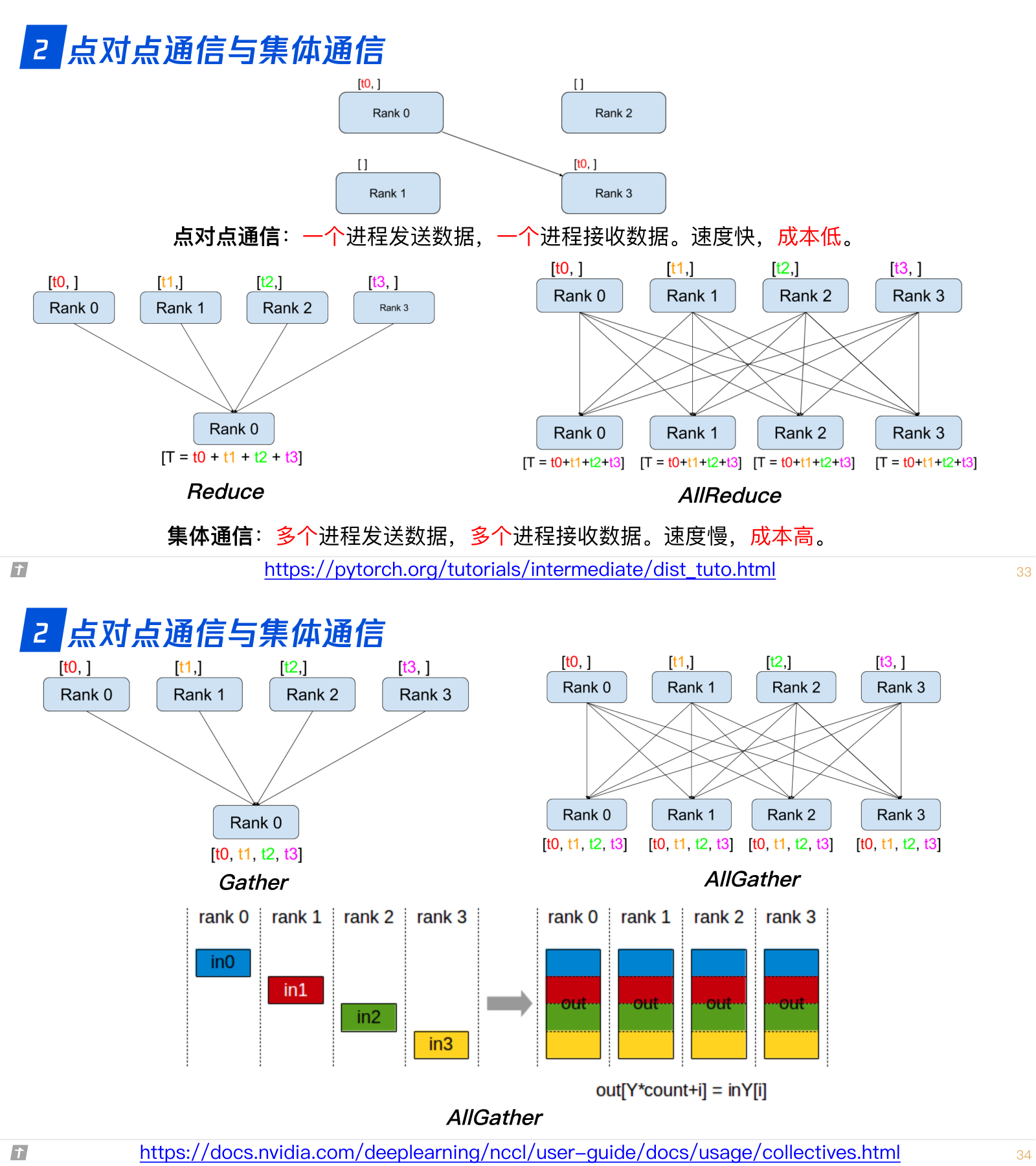

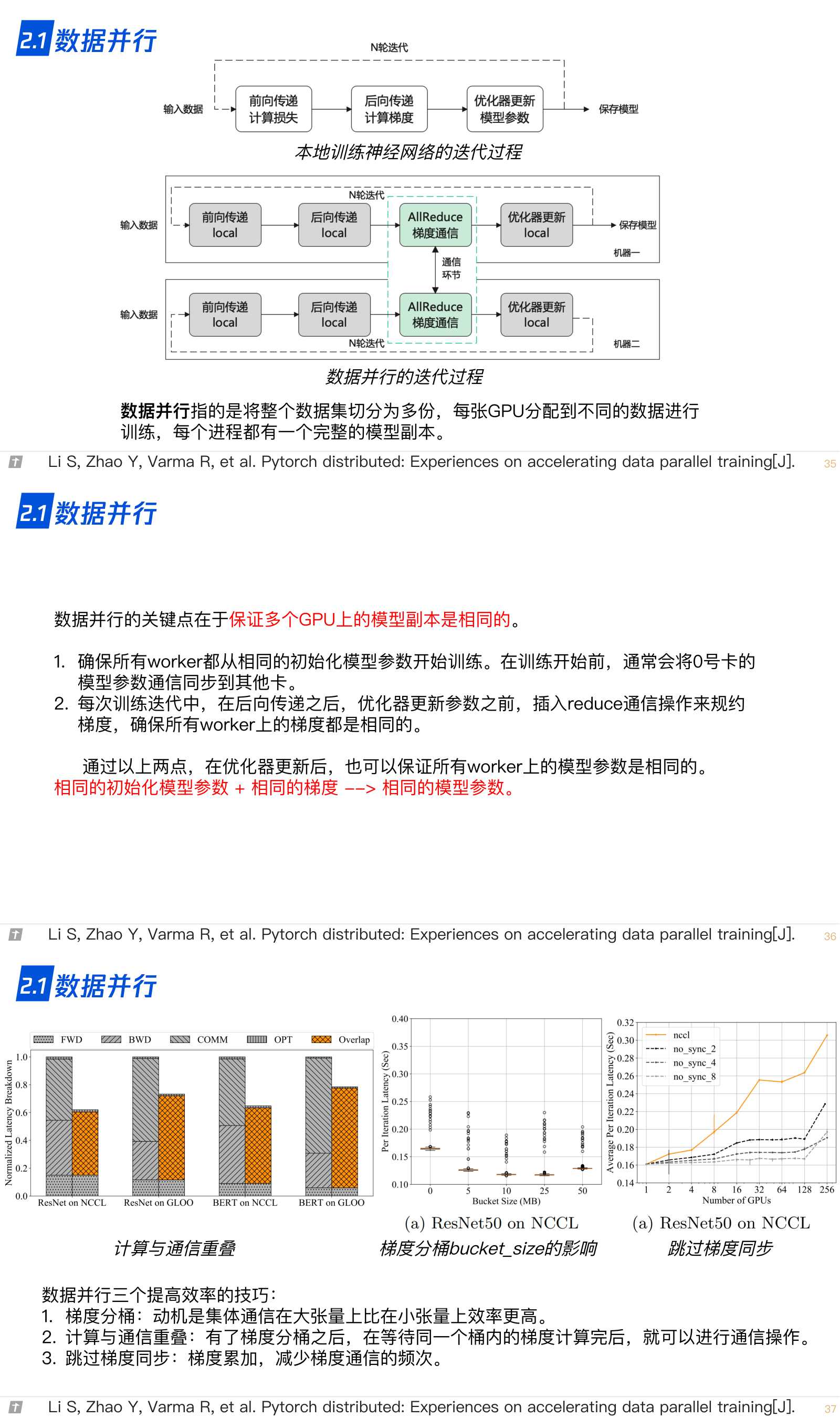

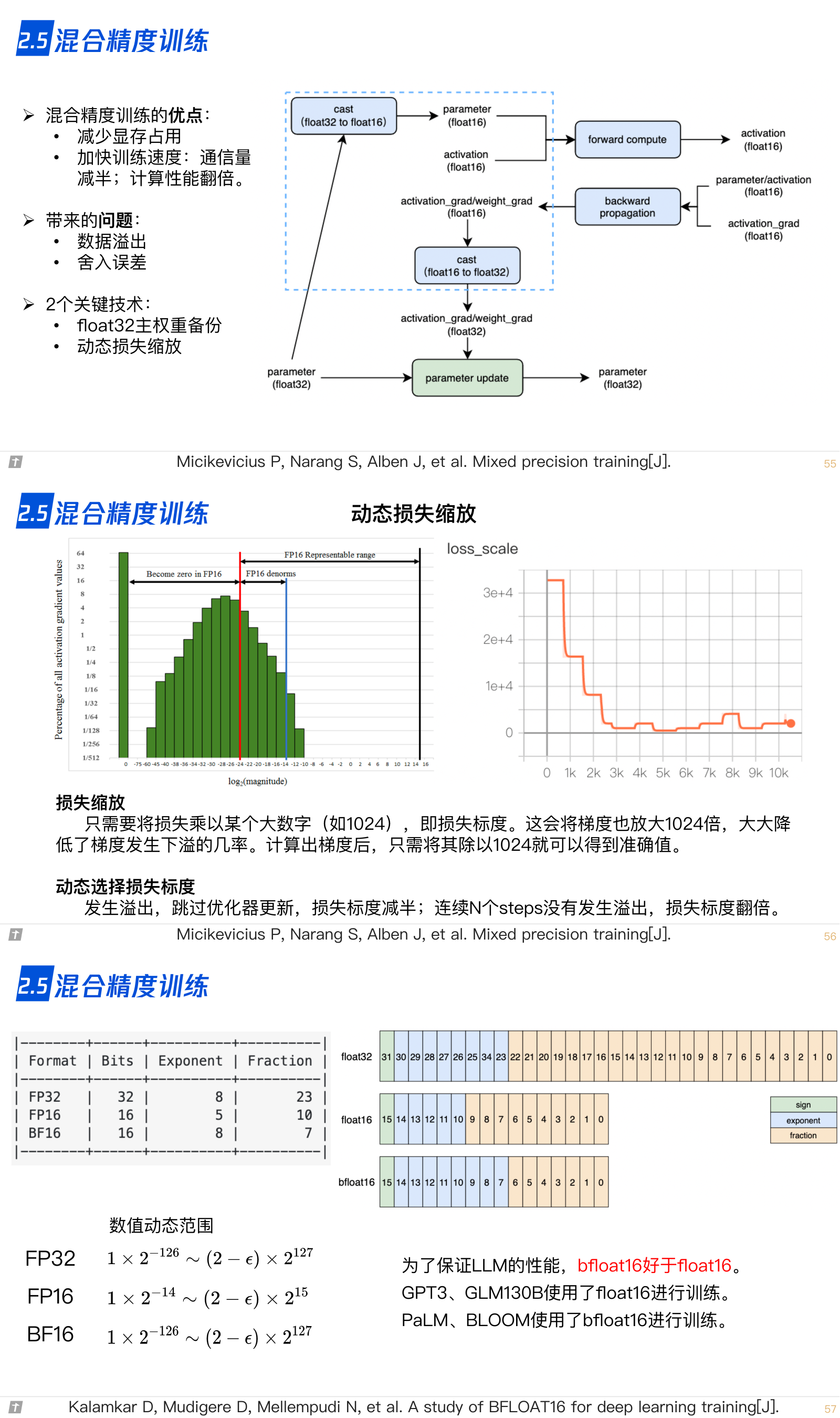

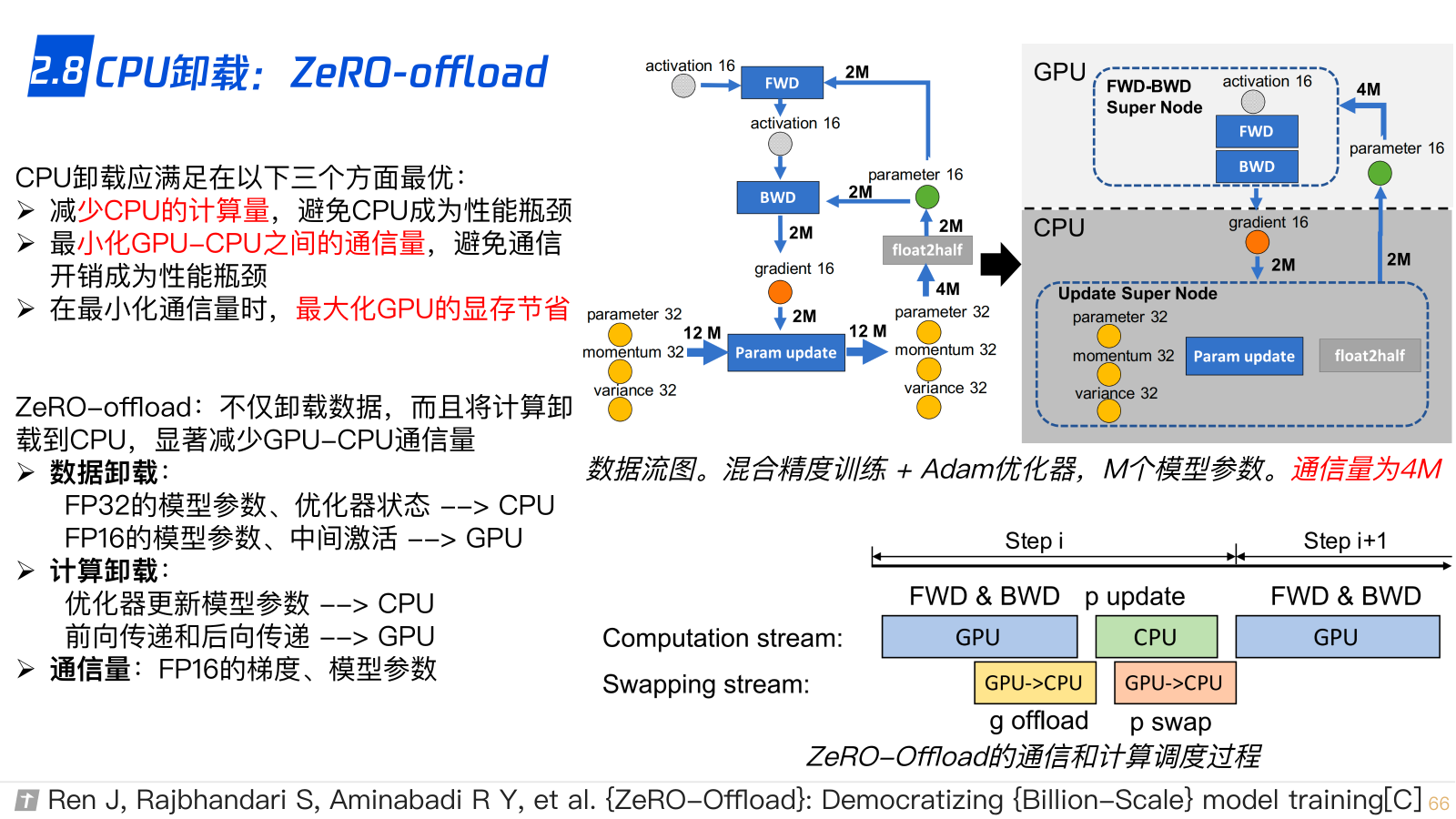

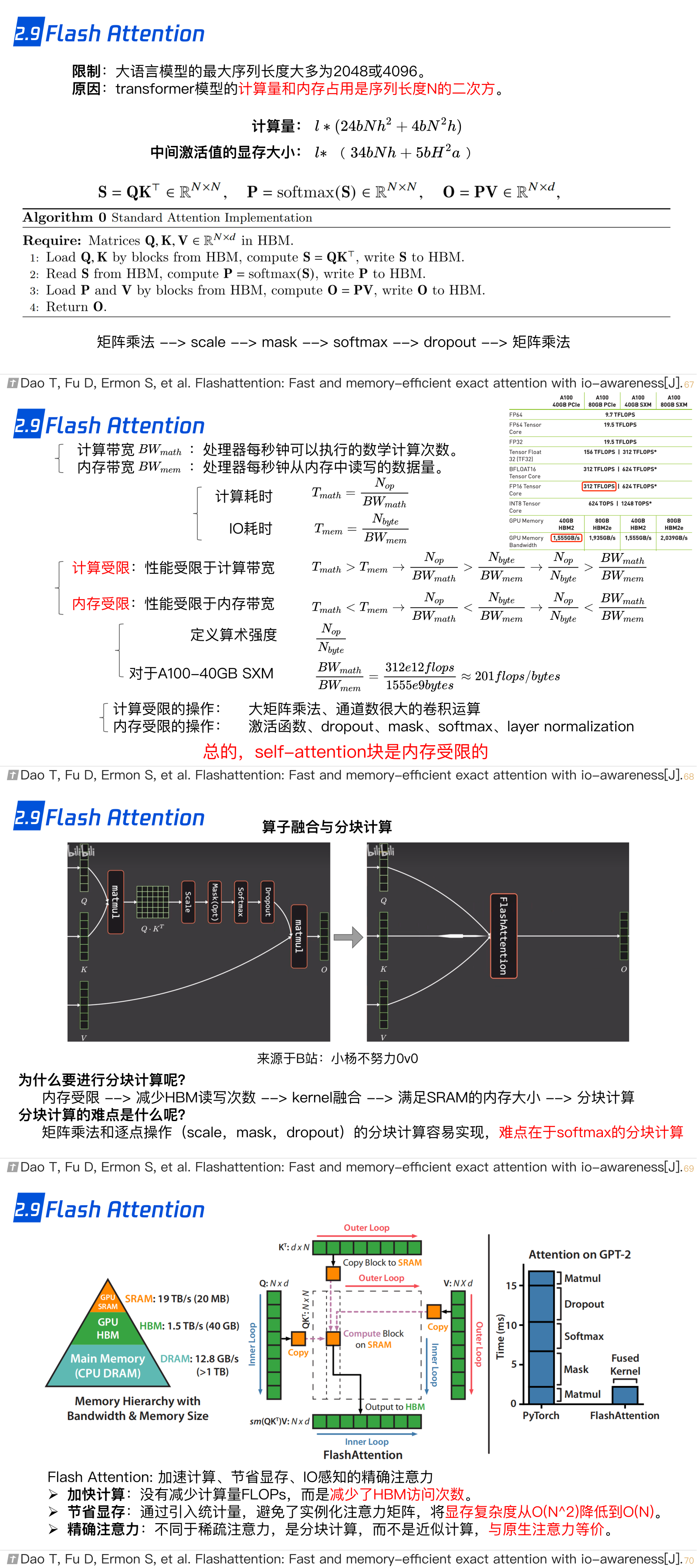

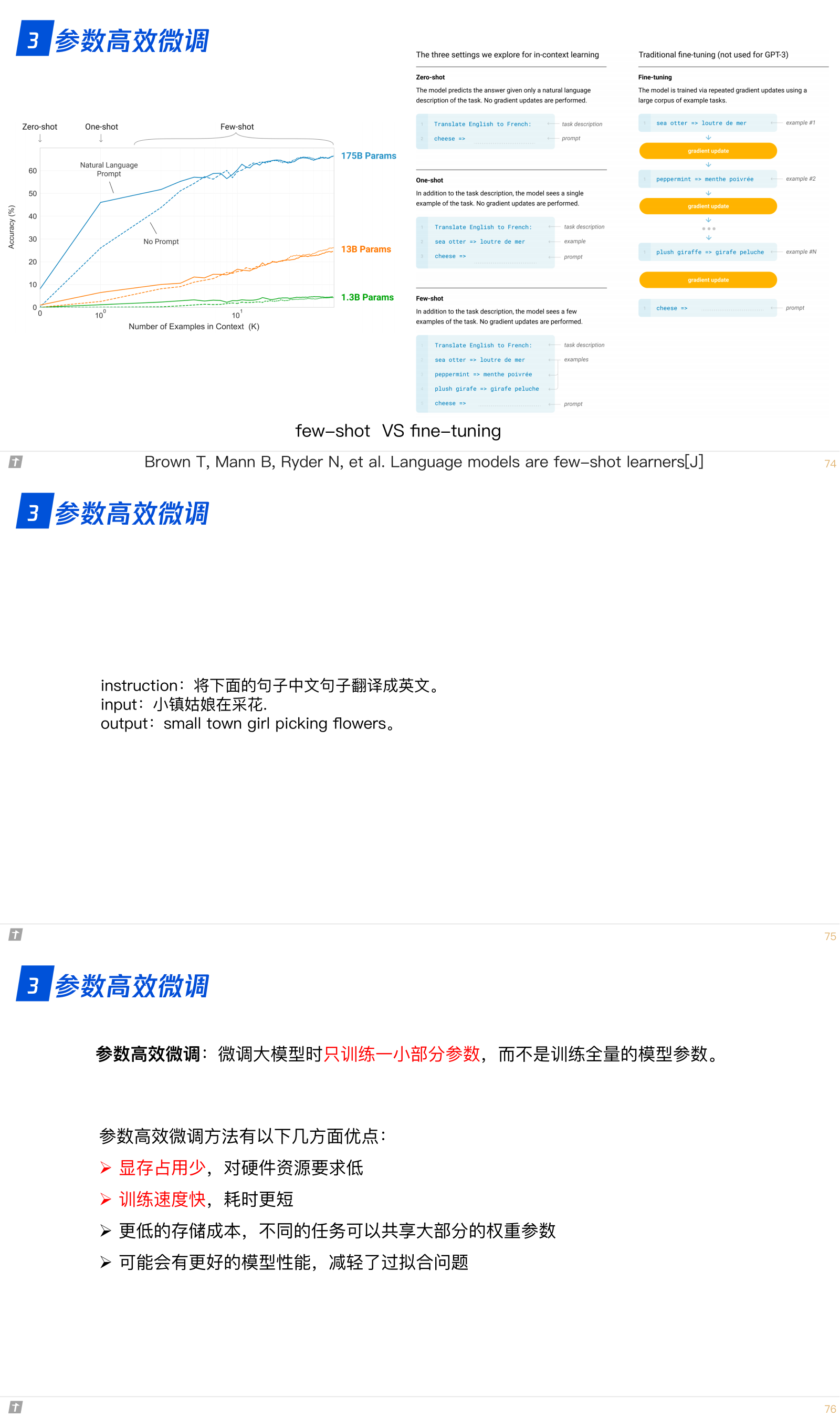

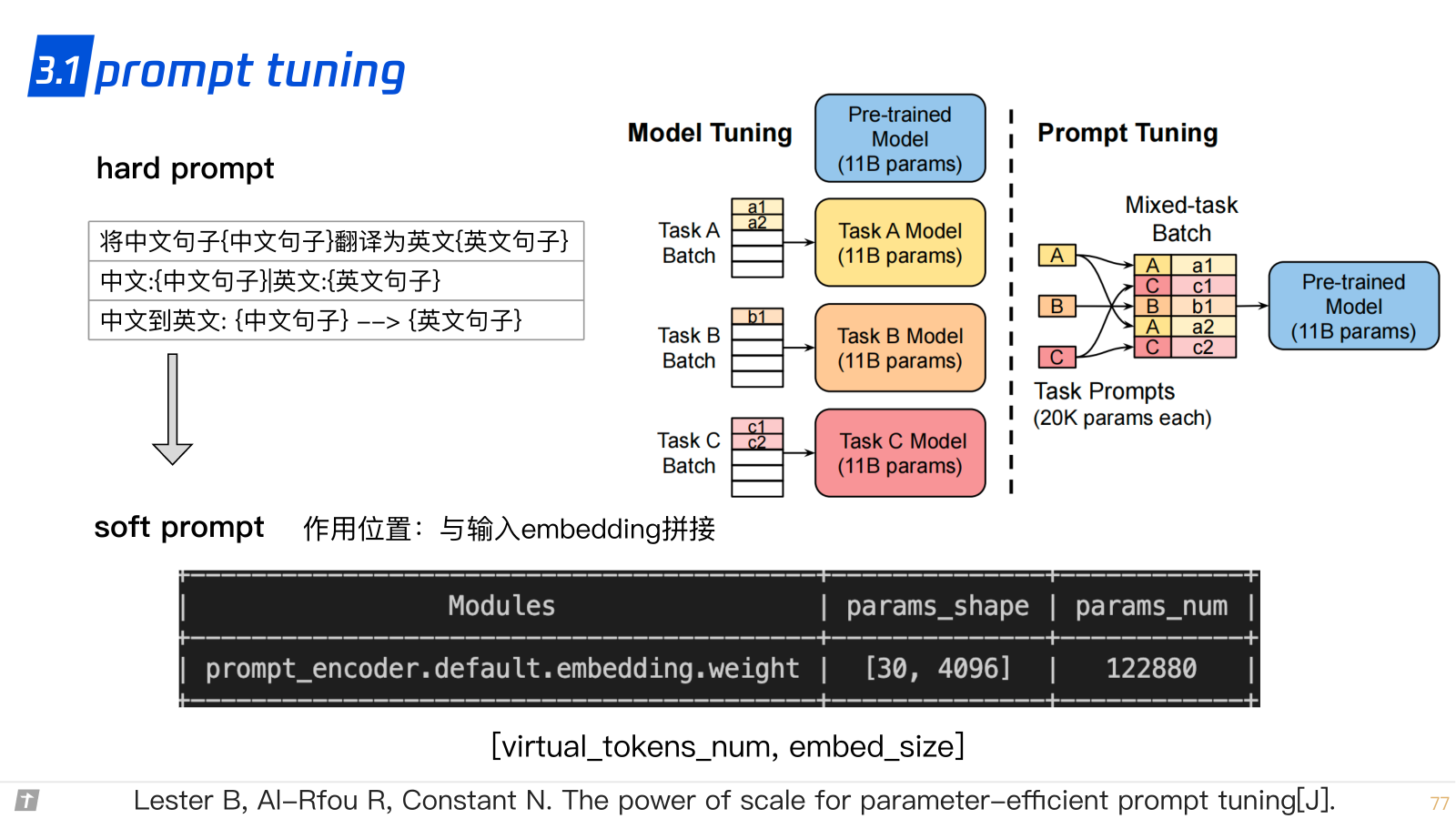

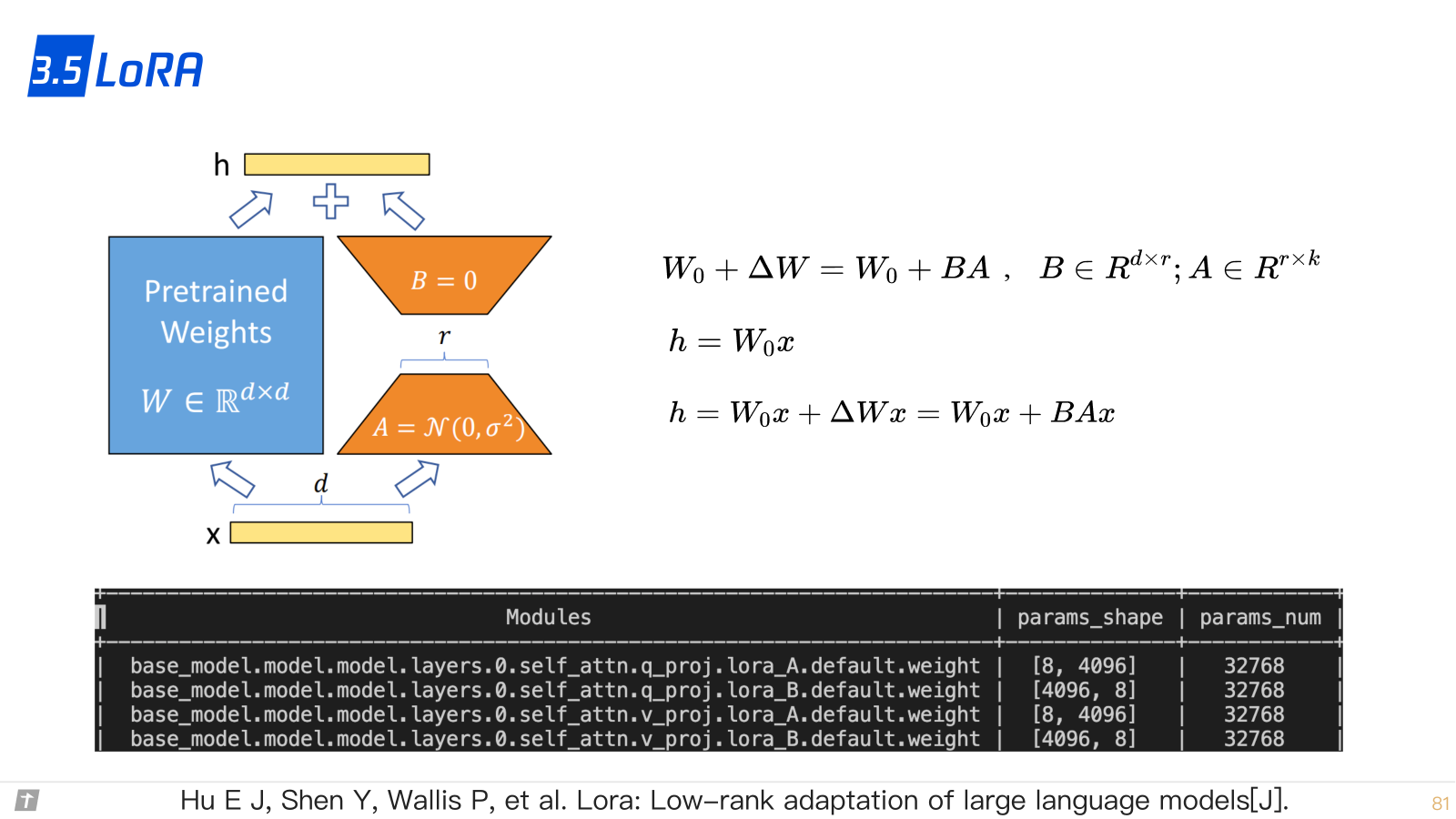

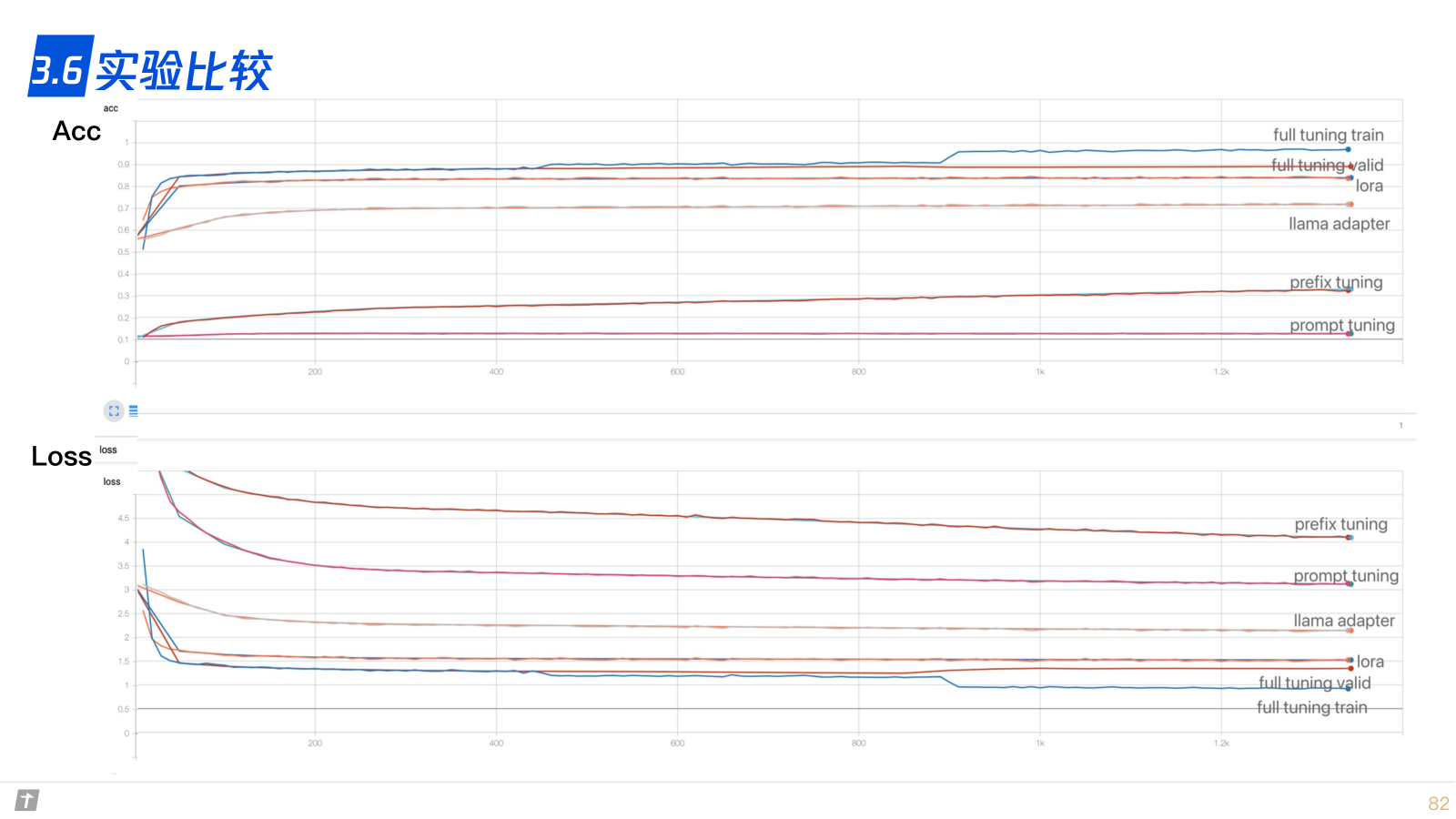

比较 LLaMA、ChatGLM、Falcon 等大语言模型的细节:tokenizer、位置编码、Layer Normalization、激活函数等。2. 大语言模型的分布式训练技术:数据并行、张量模型并行、流水线并行、3D 并行、零冗余优化器 ZeRO、CPU 卸载技术 ZeRo-offload、混合精度训练、激活重计算技术、Flash Attention、Paged Attention。3. 大语言模型的参数高效微调技术:prompt tuning、prefix tuning、adapter、LLaMA-adapter、 LoRA。

![[论文阅读]MVF——基于 LiDAR 点云的 3D 目标检测的端到端多视图融合](https://img-blog.csdnimg.cn/7efb7e02d08042d99ff4171bcccfec9d.png)